Von den Grundlagen, die Ada Lovelace und Charles Babbage legten, bis hin zu Alan Turings bahnbrechender Computerforschung war die Welt von der Verheißung der künstlichen Intelligenz begeistert - dem Traum, maschinelle Wesen zu schaffen, die über menschenähnliche kognitive Fähigkeiten verfügen.

Später jedoch wandte sich die Entwicklung der KI von ihren biologischen Wurzeln ab und konzentrierte sich auf brachiale Rechenleistung und algorithmische Komplexität.

Damit sind die von Science-Fiction inspirierten Träume von lebensechten Robotern ein wenig der Realität von oberflächlicheren großen Sprachmodellen (LLMs) wie ChatGPT gewichen.

Natürlich sind die aktuellen KI-Modelle immer noch faszinierend, aber sie sind eher ein Werkzeug als ein Wesen.

Noch ist es nicht so weit, aber trotz phänomenaler Fortschritte hat das Wettrüsten in Sachen KI Lücken in unserem Streben nach wirklich intelligenten Maschinen aufgedeckt.

Egal, wie leistungsfähig unsere Algorithmen werden, es fehlt ihnen an Eleganz, Anpassungsfähigkeit und Energieeffizienz - den Merkmalen biologischer Systeme.

Die Forscher wissen das - und es frustriert sie.

Professor Tony Prescott und Dr. Stuart Wilson von der Universität Sheffield haben kürzlich hervorgehoben dass die meisten KI-Modelle, wie z. B. ChatGPT, "körperlos" sind, d. h. sie haben keine direkte Verbindung zur physischen Umgebung.

Im Gegensatz dazu hat sich das menschliche Gehirn innerhalb eines physischen Systems - unseres Körpers - entwickelt, das es uns ermöglicht, die Welt direkt wahrzunehmen und mit ihr zu interagieren.

Die Forscher sind bestrebt, die KI von ihrer monolithischen Architektur zu befreien, was zu einem Wiederaufleben der bioinspirierten KI geführt hat, die manchmal auch als neuromorphe KI bezeichnet wird, eine Unterdisziplin, die versucht, die komplexen Prozesse der Natur nachzuahmen, um intelligentere, effizientere Systeme zu schaffen.

Diese Bemühungen stützen sich auf verschiedene biologische Rahmenbedingungen, von den Strukturen, die unser Gehirn bilden, bis hin zur Schwarmintelligenz, die bei Ameisen oder Vögeln beobachtet wird.

Auf der Suche nach Autonomie und Effizienz zwingt uns die bioinspirierte KI, seit langem bestehende Rechenprobleme zu untersuchen, z. B. die Abkehr von ressourcenintensiven Architekturen, die aus Tausenden von stromfressenden GPUs bestehen, hin zu leichteren, komplexeren analogen Systemen.

Prescott, Mitverfasser eines kürzlich erschienenen Artikels, "Verständnis der funktionellen Architektur des Gehirns durch RobotikEs ist viel wahrscheinlicher, dass KI-Systeme eine menschenähnliche Kognition entwickeln, wenn sie mit Architekturen gebaut werden, die auf ähnliche Weise lernen und sich verbessern wie das menschliche Gehirn, indem sie seine Verbindungen zur realen Welt nutzen.

Das menschliche Gehirn ist ein gutes Beispiel dafür - jeder Gedanke und jede Handlung, die Ihr Gehirn hervorruft, benötigt nur die Leistung einer schwachen Glühbirne - etwa 20 Watt.

Und es geht noch weiter. Selbst wenn der Mensch keine Energie von außen durch Nahrung erhält, kann er über einen Monat lang überleben. Extremophile haben Methoden gefunden, um in einigen der unwirtlichsten Umgebungen der Erde zu überleben.

Vergleichen Sie das mit der Infrastruktur, die erforderlich ist, um KI-Modelle wie ChatGPT zu betreiben, das die Leistung einer Kleinstadt benötigt und sich nicht selbst replizieren, heilen oder an seine Umgebung anpassen kann.

Um der KI eine faire Chance zu geben, kann man argumentieren, dass der Vergleich von KI mit biologisch intelligenten Systemen unzureichend ist.

Schließlich sind Computer und Gehirne einfach für unterschiedliche Aufgaben hervorragend geeignet - vielleicht liegt es in der Natur des Menschen, sie in anthropomorphen Visionen von autonomen KI zu verschmelzen, die mit der Umwelt wie die biologischen Wesen interagieren, neben denen wir uns entwickelt haben.

Doch sowohl KI-Forscher als auch Neurowissenschaftler sind bereit, sich in diese intellektuelle Sackgasse zu begeben, und viele würden das Gehirn als "Computer" bezeichnen, der künstlich modelliert und repliziert werden kann.

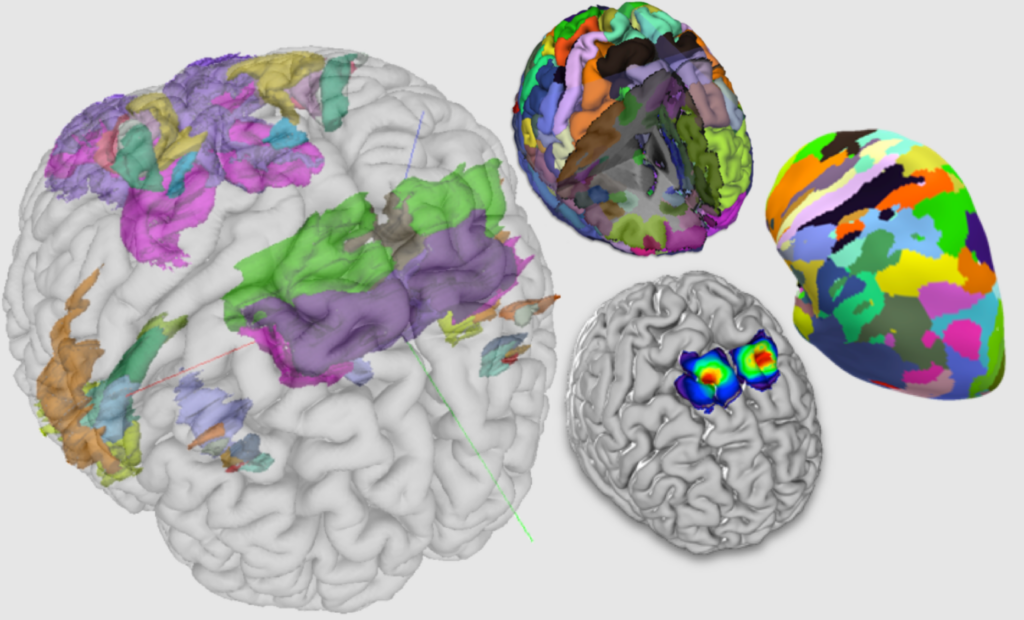

Die Das Human Brain Project (HBP) der EU, ein fast $1 Mrd. schweres multinationales Experiment im Bereich der großen Wissenschaft, war ein Lehrstück dafür, wie sich die Komplexität des Gehirns einer künstlichen Modellierung entzieht.

Das HBP hatte sich zum Ziel gesetzt, das menschliche Gehirn in seiner Gesamtheit zu modellieren, aber es gelang ihm nur, Teile seiner Funktionalität zu modellieren.

Unser Gehirn - als eine einzige Einheit - die kollektiven Gehirne von Tausenden von Forschern, die über enorme Finanzmittel und Rechenleistung verfügen, zu besiegen - es nennen poetische Gerechtigkeit.

Das Bewusstsein und das Wesen der Gedankenbildung ist eine ähnlich ferne Grenze zu den Tiefen des Weltraums. - wWir sind einfach noch nicht so weit.

Im Kern geht es dabei um die Trennung zwischen Biologie und Maschinen.

Während neuronale Netze und andere Formen des maschinellen Lernens (ML) in Analogie zu biologischen Gehirnen modelliert werden, ist die Berechnungsmethode grundlegend anders.

Rodney Brooks, emeritierter Professor für Robotik am MIT, hat über diesen Stillstand nachgedacht, mit der AngabeEs besteht die Sorge, dass seine Version des Rechnens, die auf Funktionen ganzer Zahlen basiert, begrenzt ist. Biologische Systeme unterscheiden sich eindeutig. Sie müssen über lange Zeiträume hinweg auf unterschiedliche Reize reagieren; diese Reaktionen verändern wiederum ihre Umgebung und nachfolgende Reize. Das individuelle Verhalten sozialer Insekten wird zum Beispiel durch die Struktur des Hauses, das sie bauen, und das Verhalten ihrer Geschwister darin beeinflusst.

Brooks fasst dieses Paradoxon mit der Frage zusammen: "Sollten diese Maschinen dem Gehirn nachempfunden werden, da unsere Modelle des Gehirns auf solchen Maschinen ausgeführt werden?"

Die Reise der bioinspirierten KI

Die Natur hatte Millionen von Jahren Zeit für Forschung und Entwicklung, um ihre unglaublich widerstandsfähigen Mechanismen zu perfektionieren.

Der Trend zur bioinspirierten KI kann als Kurskorrektur gesehen werden, als bescheidene Anerkennung der Tatsache, dass unser Streben nach fortschrittlicher KI uns möglicherweise auf einen Weg geführt hat, der zwar in seiner Komplexität immer noch verblüffend ist, aber auf lange Sicht nicht nachhaltig sein kann.

Zumindest wird die derzeitige Entwicklung möglicherweise nicht dem entsprechen, was die Menschheit letztlich von der KI erwartet. Wenn wir in einer "Zukunft" leben wollen, in der Menschen und Roboter Seite an Seite arbeiten (auch wenn das natürlich nicht jeder will), dann müssen wir mehr tun, als immer mehr Grafikprozessoren anzusammeln und immer größere Modelle zu trainieren.

Dennoch gibt es Hoffnung für die leidenschaftlichen Futuristen unter uns, denn die Forscher mulchen schon seit Jahrzehnten Ideen für bioinspiriertes Computing, und einige spekulative Ideen beginnen, sich durchzusetzen.

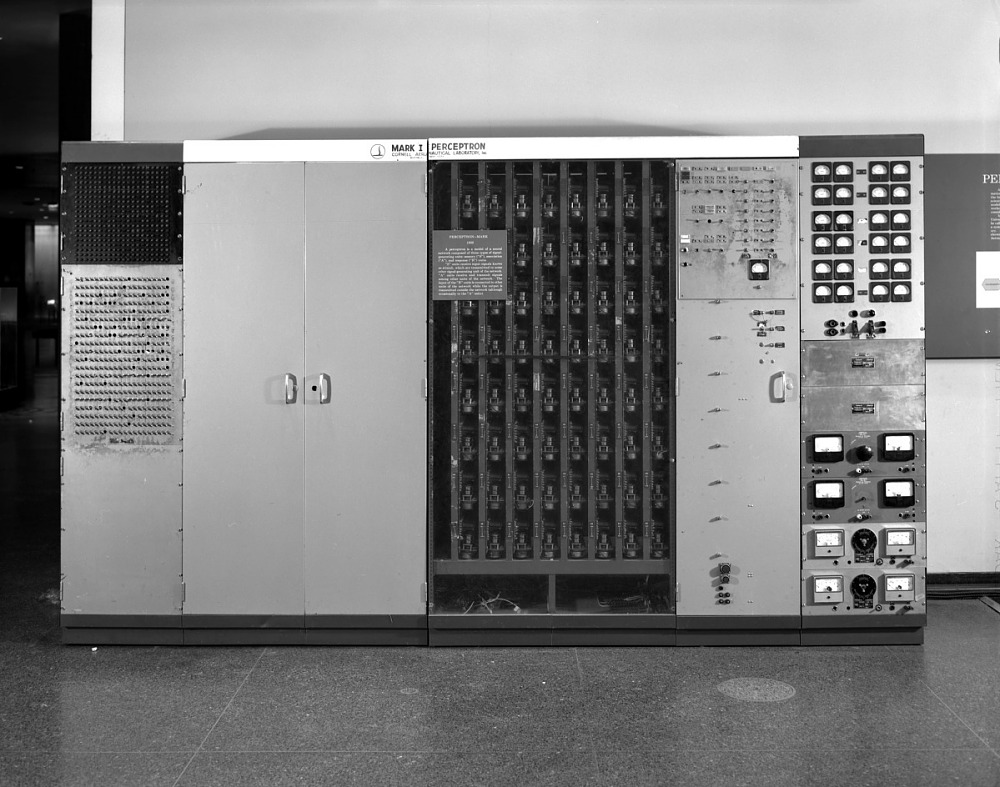

In den späten 50er und frühen 60er Jahren war Frank Rosenblatts Arbeit an der Perceptron bot das erste vereinfachte Modell eines biologischen Neurons.

Das Papier von 1986 "Lernen von Repräsentationen durch Rückübertragung von Fehlern (back-propagating)" von David Rumelhart, Geoffrey Hinton und Ronald Williams hat das Spiel verändert.

Hinton und sein Team führten den Backpropagation-Algorithmus ein, der einen robusten Mechanismus für das Training von mehrschichtigen neuronalen Netzen darstellt und das Feld für Anwendungen von der Verarbeitung natürlicher Sprache (NLP) bis zum Computer Vision (CV) - zwei grundlegende Bereiche der modernen KI - eröffnete.

Bald darauf schlug die Bioinspiration einen anderen Weg ein, indem sie sich auf darwinistische Prinzipien berief. John Hollands 1975 erschienenes Buch "Adaptation in natürlichen und künstlichen Systemen" legte den Grundstein für genetische Algorithmen.

Durch die Simulation von Mechanismen wie Mutation und natürliche Selektion hat dieser Ansatz ein leistungsfähiges Werkzeug für Optimierungsprobleme geschaffen, das in Branchen wie der Luft- und Raumfahrt und dem Finanzwesen Anwendung findet.

Konzepte wie die "Schwarmintelligenz", die man bei Insektenschwärmen und der synchronisierten Bewegung von Vögeln und Fischen beobachten kann, wurden erstmals in den 80er und 90er Jahren in die Informatik eingeführt und haben im Jahr 2023 bemerkenswerte Fortschritte gemacht.

Im August 2023 werden ehemalige Google-Mitarbeiter gründete Sakanaein Startup-Unternehmen, das ein Ensemble kleinerer KI-Modelle entwickeln will, die zusammenarbeiten.

Sakanas Ansatz ist von biologischen Systemen wie Fischschwärmen oder neuronalen Netzen inspiriert, bei denen kleinere Einheiten zusammenarbeiten, um ein komplexeres Ziel zu erreichen.

Angesichts der monolithischen Architekturen moderner KI-Modelle wie ChatGPT verspricht dieser Ansatz, den Energieverbrauch zu senken und die Anpassungsfähigkeit und Widerstandsfähigkeit zu erhöhen - Eigenschaften, die biologischen Organismen eigen sind.

Sogar das Verstärkungslernen (Reinforcement Learning, RL), ein Zweig des maschinellen Lernens, der sich damit befasst, Algorithmen zu lehren, Entscheidungen zu treffen, die auf eine Belohnung abzielen, wurde weitgehend biologisch inspiriert.

Das bahnbrechende Buch von Richard Sutton und Andrew Barto "Reinforcement Learning: Eine Einführung"Die Studie zeigt anhand zahlreicher Beispiele, wie Tiere von ihrer Umwelt lernen, und inspiriert Algorithmen, die sich auf der Grundlage von Belohnungen und Bestrafungen anpassen können.

In dem Buch werden Hunderte von Vergleichen mit dem Verhalten von Tieren angestellt: "Von allen Formen des maschinellen Lernens kommt das verstärkende Lernen dem Lernen von Menschen und anderen Tieren am nächsten."

Auf dem Weg zu bioinspirierter KI

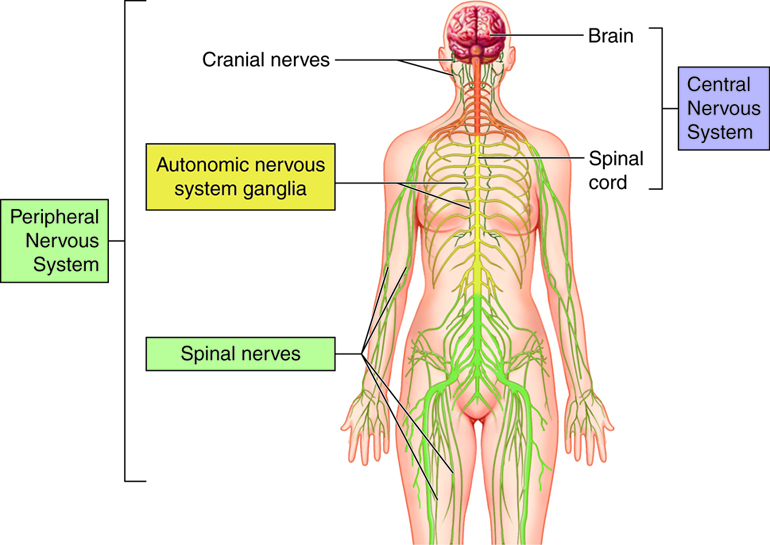

Bei komplexen biologischen Lebewesen wie dem Menschen und anderen Wirbeltieren arbeiten verschiedene Komponenten des Nervensystems zusammen, um ein breites Spektrum von Funktionen zu steuern.

Das zentrale Nervensystem (ZNS) dient als Schaltzentrale, verarbeitet Informationen und steuert Reaktionen.

In der Zwischenzeit fungiert das periphere Nervensystem (PNS) als Kommunikationsnetz, das Signale zwischen dem ZNS und anderen Teilen des Körpers überträgt.

Innerhalb des PNS befindet sich das spezialisierte autonome Nervensystem (ANS), das unwillkürlich arbeitet, um lebenswichtige Funktionen wie Herzfrequenz und Verdauung zu steuern. Jedes System hat seine eigenen Aufgaben, doch sie sind miteinander verbunden und arbeiten nahtlos zusammen, um uns zu helfen, uns in der Umwelt zurechtzufinden.

Einfachere Organismen wie Insekten haben ein schlankeres, sparsameres Nervensystem, wenn auch immer noch unglaublich komplex. Eine Fruchtfliege hat einige 3.000 Neuronen und eine halbe Million Synapsen.

Die Komponenten des biologischen Nervensystems sind anatomisch unterschiedlich, arbeiten aber ganzheitlich und sind über Neuronen miteinander verbunden, die Sinnesreize senden und empfangen und schließlich ein konzeptuelles Verständnis - oder bei komplexeren Wesen ein Bewusstsein - bilden.

Um autonome Roboter mit eng gekoppelten Gehirnen und sensorischen Systemen zu entwickeln, müssen die Forscher vom Brute-Force-Computing wegkommen und leichtgewichtige Systeme schaffen, die auf der sensorischen Realität basieren.

KI-Modelle wie ChatGPT verfügen zwar über ein immenses Wissen, sind aber in gewisser Weise in der Zeit gefangen und von der sensorischen Realität abgeschnitten.

Das verschafft der KI Vorteile, oder besser gesagt, es verleiht ihr Fähigkeiten, die sich von denen biologischer Wesen unterscheiden - was vielleicht der Grund dafür ist, dass die Menschheit bestrebt ist, KI zu entwickeln, um die Unzulänglichkeiten eines biologischen Wesens auszugleichen.

Als Amnon Schaschua HighlightsDie "völlig andere Architektur des Computers begünstigt Strategien, die seine praktisch unbegrenzte Speicherkapazität und Brute-Force optimal ausnutzen".

Wenn wir die KI jedoch jemals aus den Grenzen von Rechenzentren und Webbrowsern befreien wollen, müssen die Forscher diese Herausforderungen lösen und Wege finden, um KI-Systeme mit einem "Körper" zu verbinden oder sie zumindest mit einer soliden sensorischen Grundlage auszustatten.

Dies hat einen unmittelbaren praktischen Nutzen. Nehmen wir das Beispiel der fahrerlosen Autos - ihre sensorischen Systeme müssen ähnlich funktionieren wie unsere, um sicher zu funktionieren. Andernfalls haben sie keine Chance, ein potenzielles Hindernis zu "sehen" und schnell zu reagieren, um eine Katastrophe zu verhindern, was sich als erhebliches Hindernis für ihre Masseneinführung erweist.

In diesem Sinne argumentierte Dennis Bray, Fachbereich Physiologie, Entwicklung und Neurowissenschaften, Universität Cambridge: "Maschinen können uns bei vielen Aufgaben das Wasser reichen, aber sie funktionieren anders als Netzwerke von Nervenzellen. Wenn unser Ziel darin besteht, Maschinen zu bauen, die immer intelligenter und geschickter werden, dann sollten wir Schaltkreise aus Kupfer und Silizium verwenden. Wenn unser Ziel aber darin besteht, das menschliche Gehirn mit seiner eigenartigen Brillanz, seiner Fähigkeit zum Multitasking und seinem Selbstbewusstsein zu reproduzieren, dann müssen wir nach anderen Materialien und anderen Konstruktionen suchen."

Diese Kommentare, die auch heute noch aktuell sind, wurden in einer Diskussionsartikel in der Natur das 2012 zum hundertsten Geburtstag Turings veröffentlicht wurde - und die KI hat sich seitdem rasant weiterentwickelt.

Und wo stehen wir jetzt?

Neuronale Spitzennetze (SNNs) und biologische Hardware

Heute erforschen Forscher die von Bray erwähnten "anderen Materialien und unterschiedlichen Designs", wie z. B. Spiking Neural Networks (SNNs), eine Art neuronales Netzwerk, das der neuronalen Funktionalität sehr ähnlich ist.

SNNs bieten eine spezialisierte Alternative zu den herkömmlichen neuronalen Netzen, denen wir beim maschinellen Lernen häufig begegnen.

Anstatt sich auf kontinuierliche Aktivierungsfunktionen zur Verarbeitung von Eingabedaten zu verlassen, ahmen SNNs die Feinheiten biologischer neuronaler Netze nach, indem sie diskrete Spikes für die interneuronale Kommunikation verwenden.

In diesen Netzen integriert jedes künstliche Neuron im Laufe der Zeit die von den angeschlossenen Neuronen eingehenden Spikes. Wenn das akkumulierte Signal bzw. das Membranpotenzial einen bestimmten Schwellenwert überschreitet, gibt das Neuron selbst eine Spitze ab.

Dieser Spiking-Mechanismus ermöglicht es dem Netzwerk, sowohl räumliche als auch zeitliche Muster zu erfassen und zu verarbeiten, ähnlich wie die Neuronen in biologischen Gehirnen.

Was also macht SNNs zu einem Schwerpunkt in der bioinspirierten KI?

Erstens zeichnen sie sich dadurch aus, dass sie auf natürliche Weise zeitliche Datensequenzen verarbeiten können, so dass keine zusätzlichen Speichereinheiten wie bei rekurrenten neuronalen Netzen (RNN) erforderlich sind.

Zweitens wurden SNNs so konzipiert, dass sie unglaublich energieeffizient sind. Im Gegensatz zu herkömmlichen neuronalen Netzen, bei denen jedes Neuron ständig aktiv ist, ermöglicht die spärliche und ereignisgesteuerte Natur von SNNs, dass die Neuronen größtenteils inaktiv bleiben und nur dann Spikes abfeuern, wenn es notwendig ist. Dadurch wird ihr Energieverbrauch erheblich gesenkt.

Und schließlich haben SNNs durch die genauere Nachahmung biologischer Systeme das Potenzial für mehr Robustheit und Flexibilität, insbesondere in verrauschten oder unvorhersehbaren Umgebungen.

Obwohl das Konzept der SNNs seine Wurzeln im theoretischen Verständnis biologischer neuronaler Systeme hat, haben Fortschritte in der Hardwaretechnologie diese Netze für Berechnungsaufgaben zugänglicher gemacht.

Neuromorphe Chips, die speziell für die effiziente Simulation der Spike-Dynamik entwickelt wurden, haben wesentlich dazu beigetragen, SNNs praktisch nutzbar zu machen.

IBMs bioinspirierter Analogchip und SNNs

In den letzten zwei Jahren wurden wesentliche Fortschritte im Ultraleichtbau erzielt, energieeffiziente KI Lösungen, auch neuromorphe Chips genannt.

Inzwischen gibt es auch andere Arten von neuromorphen Technologien, wie z. B. neuromorphe Kameras nach dem Vorbild biologischer Augen.

Entwickelt im Jahr 2023, IBMs Chip verwendet analoge Komponenten wie Memristoren, um unterschiedliche numerische Werte zu speichern. Außerdem wird ein Phasenänderungsspeicher (PCM) verwendet, um ein Spektrum von Werten anstelle von 0en und 1en zu registrieren.

Diese Eigenschaften ermöglichen eine reduzierte Datenübertragung zwischen Speicher und Prozessor, was einen Vorteil bei der Energieeffizienz darstellt. Das IBM-Design verfügt über "64 analoge In-Memory-Rechenkerne, die jeweils ein 256 mal 256 großes synaptisches Array enthalten". Er erreichte eine beeindruckende Genauigkeit von 92,81% bei einem Computer-Vision (CV)-Benchmark-Test und ist dabei mehr als 15-mal effizienter als mehrere bestehende Chips.

Der IBM-Chip basiert zwar nicht ausdrücklich auf SNNs, ist aber aufgrund seiner analogen Natur und der Verwendung von Memristoren sehr gut mit dem SNN-Modell kompatibel.

Im Grunde genommen könnten die SNNs auf dieser Art von Architektur natürlicher implementiert werden.

Der SNN-basierte Chip des IIT Bombay

Im Jahr 2022 haben Forscher des Indian Institute of Technology in Bombay, einen Chip entworfen die speziell mit SNNs arbeitet.

Dieser Chip verwendet Band-zu-Band-Tunnelstrom (BTBT) für künstliche Neuronen mit extrem niedrigem Energieverbrauch. Laut Professor Udayan Ganguly erreicht der Chip "eine 5.000-mal geringere Energie pro Spike bei ähnlicher Fläche und eine 10-mal geringere Standby-Leistung bei ähnlicher Fläche und Energie pro Spike".

Diese Art von Chip kann direkt in kompakten Geräten wie Mobiltelefonen, unbemannten autonomen Fahrzeugen (UAVs) und IoT-Geräten eingesetzt werden und erfüllt den Bedarf an leichten und energieeffizienten KI-Rechnern.

Beide Ansätze zielen darauf ab, das zu ermöglichen, was Ganguly als "einen extrem stromsparenden neurosynaptischen Kern und die Entwicklung eines Echtzeit-Lernmechanismus auf dem Chip beschreibt, die für autonome, biologisch inspirierte neuronale Netze entscheidend sind. Das ist der heilige Gral".

Diese Systeme könnten das "System des Denkens" mit dem "System des Handelns und der Bewegung" verbinden, ähnlich wie wir es bei biologischen Organismen beobachten.

Dies würde es uns ermöglichen, einen bedeutenden Schritt in Richtung der Schaffung künstlicher Systeme zu machen, die leistungsstark und nachhaltig sind und sich eng an die biologischen Systeme anlehnen, die die KI seit fast einem Jahrhundert inspiriert haben.

Endlich könnte die Menschheit die KI aus ihrer monolithischen Architektur befreien, sie von ihren Energiequellen abtrennen und sie als autonome Wesen in die Welt - und ins Universum - hinausschicken.

Ob dies eine gute Idee ist oder nicht, ist eine Diskussion für ein anderes Mal.