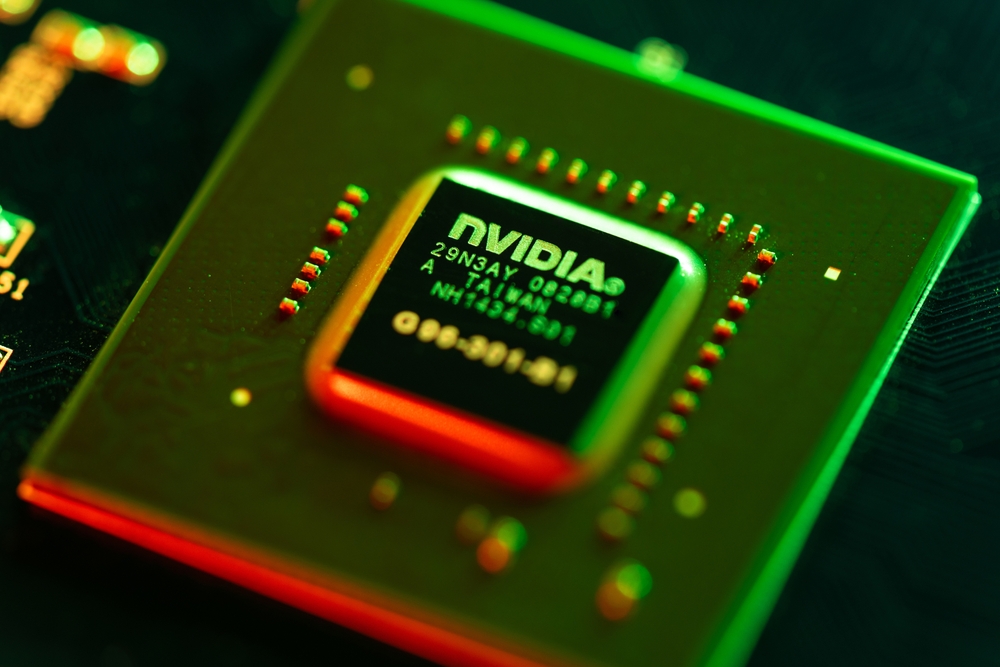

Google Cloud und Nvidia haben ihre Partnerschaft in den Bereichen KI, Computing, Software und Services vertieft.

Die Zusammenarbeit wurde auf der Konferenz Google Cloud Next 2023auf der eine neue KI-Infrastruktur und -Software vorgestellt wurden.

Diese Technologien zielen darauf ab, die Entwicklung und den Einsatz großer generativer KI-Modelle zu erleichtern und datenwissenschaftliche Aufgaben zu beschleunigen.

Nvidia-Gründer und CEO Jensen Huang erklärte: "Wir befinden uns an einem Wendepunkt, an dem beschleunigtes Computing und generative KI zusammenkommen, um Innovationen in einem noch nie dagewesenen Tempo zu beschleunigen. Unsere erweiterte Zusammenarbeit mit Google Cloud wird Entwicklern helfen, ihre Arbeit mit Infrastruktur, Software und Services zu beschleunigen, die die Energieeffizienz erhöhen und die Kosten senken."

Thomas Kurian, CEO von Google Cloud, fügte hinzu: "Google Cloud blickt auf eine lange Geschichte von Innovationen im Bereich KI zurück, um Innovationen für unsere Kunden zu fördern und zu beschleunigen. Viele der Google-Produkte werden auf NVIDIA-GPUs entwickelt und bereitgestellt, und viele unserer Kunden suchen nach beschleunigtem Computing von NVIDIA, um die effiziente Entwicklung von LLMs zur Förderung generativer KI voranzutreiben.

Die Zusammenarbeit zielt darauf ab, den Betrieb von KI-Supercomputern durch die Nutzung von Google Cloud-Diensten, die auf Nvidias Technologien aufbauen, zu optimieren.

Einer der wichtigsten Aspekte dieser Partnerschaft ist die Optimierung des PaxML-Frameworks von Google für die Tensor-Core-GPUs H100 und A100 von Nvidia. Dies wird fortschrittlichere und skalierbare Experimente ermöglichen.

Darüber hinaus umfasst die Partnerschaft Googles Integration von serverlosem Spark mit Nvidia-GPUs durch Googles Dataproc-Service, der Apache Spark-Workloads in der KI-Entwicklung beschleunigen soll.

Die Zusammenarbeit erstreckt sich auch auf die neu eingeführten Google Cloud A3 VMs, die von Nvidia H100 GPUs angetrieben werden und voraussichtlich im September 2023 allgemein verfügbar sein werden.

Diese VMs zielen darauf ab, die KI-Fähigkeiten von Nvidia für ein breiteres Spektrum von Workloads zugänglich zu machen.

Darüber hinaus wird Google Cloud Zugang zu Nvidias DGX GH200 KI-Supercomputer haben, um dessen Fähigkeiten bei der Verarbeitung generativer KI-Workloads zu testen.

Ausmaß der Zusammenarbeit von Nvidia und Google

Hier ist der volle Umfang der Zusammenarbeit von Nvidia und Google gemäß der Nvidia-Pressemitteilung:

- Google Cloud A3 VMs mit NVIDIA H100-GPUs: Diese werden im nächsten Monat allgemein verfügbar sein und sollen die KI-Plattform von NVIDIA für eine breite Palette von Workloads zugänglich machen. Im Vergleich zu den Vorgängermodellen bieten die A3 VMs dreimal schnelleres Training und verbesserte Netzwerkbandbreite.

- NVIDIA H100-GPUs in Vertex AI: Die KI-Plattform Vertex von Google Cloud wird bald NVIDIAs H100-Grafikprozessoren enthalten, wodurch Kunden schneller und effizienter generative KI-Großsprachmodelle (LLMs) entwickeln können.

- Zugang zum NVIDIA DGX GH200 Supercomputer: Google Cloud wird einer der ersten sein, die Zugang zu NVIDIAs DGX GH200 KI-Supercomputer haben, der vom NVIDIA Grace Hopper Superchip angetrieben wird, um generative KI-Forschung zu betreiben.

- NVIDIA DGX Cloud auf Google Cloud: NVIDIAs DGX Cloud AI Supercomputing und Software werden für Google Cloud-Kunden über ihren Webbrowser verfügbar sein und den Zugang zu fortgeschrittenen Trainingsworkloads erleichtern.

- NVIDIA AI Enterprise im Google Cloud Marketplace: Nutzer können über den Google Cloud Marketplace auf NVIDIA AI Enterprise zugreifen, eine sichere Cloud-native Software-Plattform. Diese Plattform vereinfacht die Entwicklung und Bereitstellung einer Reihe von KI-Anwendungen, darunter generative KI, Sprach-KI und Computer Vision.

- Erster Anbieter von NVIDIA L4-GPUs: Google Cloud war der erste Cloud-Anbieter, der NVIDIAs L4 Tensor Core GPUs mit der Einführung der G2 VM angeboten hat. Diese GPUs versprechen eine bis zu 120-fach höhere Leistung und 99% bessere Effizienz für KI-Video-Workloads im Vergleich zu CPUs.

Nvidias eher software-agnostische Haltung im KI-Wettrüsten sorgt für eine massive Nachfrage nach seiner Hardware, die praktisch alle Unternehmen, die eine KI-Umstellung anstreben, kaufen - auch in China und im Nahen Osten. Obwohl die US-Regierung den Handel mit beiden Ländern einschränkt, sind die meisten kürzlich in den Nahen Osten.

Zweifellos sind Google und Nvidia eine hervorragende Kombination, und diese jüngste Ankündigung ist nicht untypisch, da die beiden Unternehmen schon seit Jahrzehnten zusammenarbeiten.