Forscher der britischen Universitäten Durham University, University of Surrey und Royal Holloway University of London entwickelten eine innovative KI-gestützte Technik zur Extraktion von Tastenanschlägen aus akustischen Aufnahmen.

Die Studie hat eine Technik entwickelt, mit der Tastenanschläge von Tastaturen anhand von Audioaufnahmen erfolgreich gelesen werden können.

Diese Technik könnte es Hackern ermöglichen, Tastenanschläge zu analysieren, indem sie das Mikrofon eines Geräts übernehmen und persönliche Informationen wie Passwörter, private Gespräche, Nachrichten und andere sensible Daten sammeln.

Die Tastenanschläge werden über ein Mikrofon aufgezeichnet und von einem Modell für maschinelles Lernen (ML) verarbeitet und analysiert, das die Abstände und die Position auf der Tastatur bestimmt.

Das Modell kann einzelne Tastenanschläge mit einer erschreckenden Genauigkeit von 95% identifizieren, wenn die Anschläge über ein nahe gelegenes Telefonmikrofon aufgezeichnet werden. Die Vorhersagegenauigkeit verringerte sich auf 93%, wenn über Zoom gemachte Aufnahmen zum Trainieren des Algorithmus zur Geräuschklassifizierung verwendet wurden.

Akustische Hackerangriffe werden immer raffinierter, da Geräte mit Mikrofonen, die qualitativ hochwertigen Ton aufnehmen können, weit verbreitet sind.

Wie funktioniert das Modell?

Der Angriff beginnt mit der Aufzeichnung der Tastenanschläge auf der Tastatur der Zielperson. Diese Daten sind entscheidend für das Training des Vorhersagealgorithmus.

Diese Aufnahme kann über ein Mikrofon in der Nähe oder über ein mit Malware infiziertes Telefon der Zielperson erfolgen, das Zugang zu seinem Mikrofon hat.

Alternativ könnte ein böswilliger Teilnehmer eines Zoom-Anrufs die von der Zielperson getippten Nachrichten mit ihrer Tonaufnahme korrelieren. Möglicherweise gibt es auch Möglichkeiten, das Mikrofon des Computers mithilfe von Malware oder Software-Schwachstellen zu hacken.

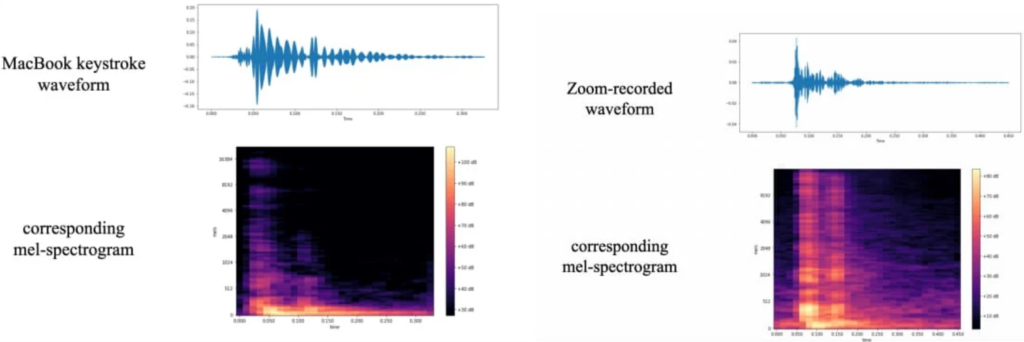

Die Forscher sammelten Trainingsdaten, indem sie jede der 36 Tasten auf einem modernen MacBook Pro 25 Mal drückten und das Geräusch aufzeichneten, das jeder Tastendruck erzeugte. Aus diesen Aufnahmen wurden Wellenformen und Spektrogramme erstellt, die erkennbare Variationen für jede Taste visualisierten.

Die Daten wurden weiter verarbeitet, um die Signale zur Identifizierung der Tastenanschläge zu verbessern.

Diese Spektrogrammbilder wurden verwendet, um "CoAtNet" zu trainieren, einen Bildklassifikator, der verschiedene Audiospektrogramme verschiedenen Tastenanschlägen zuordnet.

Für ihre Tests verwendeten die Forscher einen Laptop mit einer Tastatur, die neueren Apple-Laptops ähnelt. Zu den Mikrofonen und Aufnahmemethoden gehörten ein iPhone 13 Mini, das 17 cm von der Zielperson entfernt aufgestellt wurde, Zoom und Skype.

Der CoANet-Klassifikator zeigte eine Genauigkeit von 95% bei Smartphone-Aufnahmen und 93% bei Aufnahmen, die über Zoom gemacht wurden. Sie testeten auch über Skype aufgezeichnete Tastenanschläge, die eine Genauigkeit von 91,7% ergaben.

Das Forschungspapier schlägt vor, den Tippstil zu ändern oder zufällige Passwörter zu verwenden, um solche Angriffe zu verhindern, aber das ist alles andere als praktisch.

Weitere mögliche Abwehrmaßnahmen sind der Einsatz von Software zur Reproduktion von Tastenanschlaggeräuschen, weißes Rauschen oder softwarebasierte Tastenanschlag-Audiofilter. Die Studie ergab jedoch, dass selbst eine stumme Tastatur erfolgreich auf Tastenanschläge analysiert werden kann.

Dies ist ein weiteres neues Beispiel dafür, wie maschinelles Lernen die ausgeklügelte Betrugstechniken. A aktuelle Studie fanden heraus, dass tiefe, gefälschte Audiostimmen bis zu 25% der Menschen täuschen können.

Audio-Angriffe könnten auf hochrangige Personen wie Politiker und CEOs abzielen, um sensible Informationen zu stehlen oder Ransomware-Angriffe auf der Grundlage gestohlener Gespräche zu starten.