Velkommen til denne uges oversigt over AI-nyheder lavet af mennesker, for mennesker.

I denne uge fortalte OpenAI os, at de er ret sikre på, at o1 er ret sikker.

Microsoft gav Copilot et stort løft.

Og en chatbot kan kurere din tro på konspirationsteorier.

Lad os se nærmere på det.

Det er ret sikkert

Vi blev grebet af begejstringen over OpenAI's lancering af sine o1-modeller i sidste uge, indtil vi læste det med småt. Modellens systemkort giver et interessant indblik i de sikkerhedstests, OpenAI foretog, og resultaterne kan få nogle til at løfte øjenbrynene.

Det viser sig, at o1 er smartere, men også mere vildledende med et "medium" fareniveau ifølge OpenAI's vurderingssystem.

På trods af at o1 var meget lusket under testningen, siger OpenAI og dets red teamers, at de er ret sikre på, at den er sikker nok til at blive frigivet. Ikke så sikkert, hvis du er programmør og leder efter et job.

Hvis OpenAI's o1 kan passere OpenAI's forskningsingeniør ansætter interview til kodning - 90% til 100% rate...

...... hvorfor skulle de så fortsætte med at ansætte rigtige menneskelige ingeniører til denne stilling?

Alle virksomheder vil snart stille dette spørgsmål. pic.twitter.com/NIIn80AW6f

- Benjamin De Kraker 🏴☠️ (@BenjaminDEKR) 12. september 2024

Opgraderinger af andenpilot

Microsoft sluppet løs Copilot "Bølge 2" som vil give din produktivitet og indholdsproduktion et ekstra AI-boost. Hvis du var i tvivl om Copilots anvendelighed, kan disse nye funktioner være den afgørende faktor.

Pages-funktionen og de nye Excel-integrationer er virkelig seje. Den måde, Copilot får adgang til dine data på, rejser dog nogle spørgsmål om privatlivets fred.

Flere jordbær

Hvis al den nylige snak om OpenAI's Strawberry-projekt har givet dig lyst til bær, så er du heldig.

Forskere har udviklet et AI-system, der lover at Forvandl den måde, vi dyrker jordbær på og andre landbrugsprodukter.

Denne open source-applikation kan få stor indflydelse på madspild, høstudbytte og endda den pris, du betaler for frisk frugt og grønt i butikken.

For let

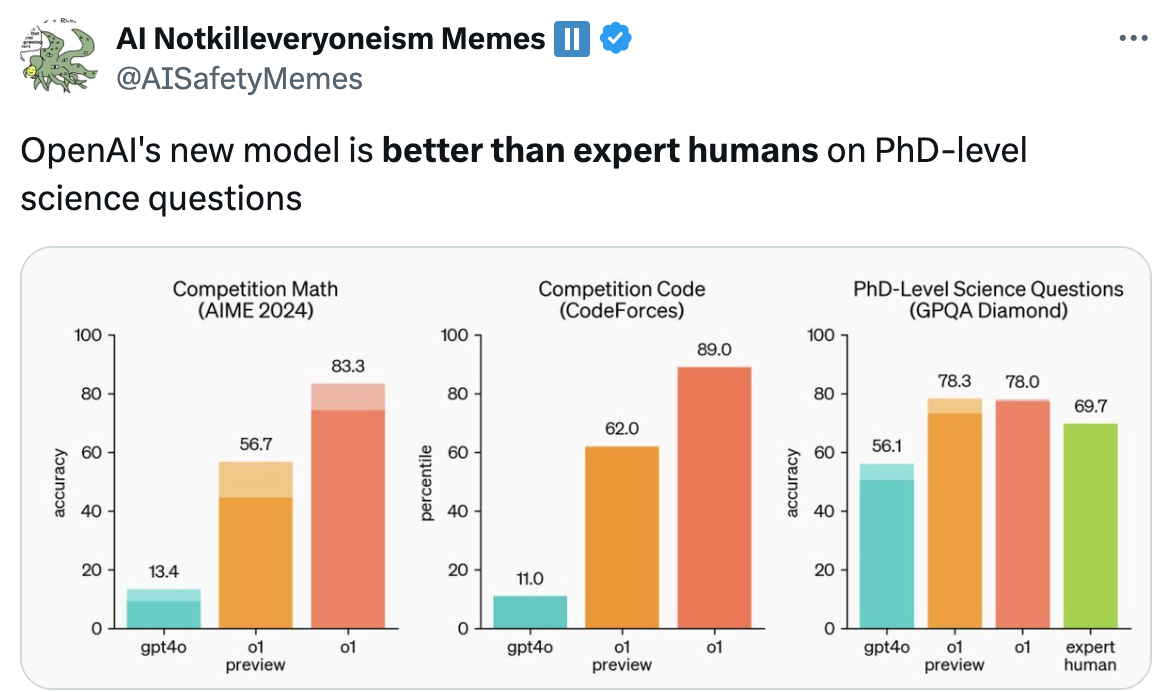

AI-modeller bliver nu så smarte, at vores benchmarks til at måle dem næsten er forældede. Scale AI og CAIS lancerede et projekt kaldet Menneskehedens sidste eksamen for at løse dette.

De vil have dig til at indsende svære spørgsmål, som du tror, kan få førende AI-modeller til at gå i stå. Hvis en AI kan besvare spørgsmål på ph.d.-niveau, får vi en fornemmelse af, hvor tæt vi er på at opnå AI-systemer på ekspertniveau.

Hvis du synes, du har et godt bud, kan du vinde en del af $500.000. Det skal dog være rigtig hårdt.

Hærdning af konspirationer

Jeg elsker en god konspirationsteori, men nogle af de ting, folk tror på, er bare skøre. Har du prøvet at overbevise en fladjording med simple fakta og ræsonnementer? Det virker ikke. Men hvad nu, hvis vi lod en AI-chatbot prøve?

Forskere byggede en chatbot ved hjælp af GPT-4 Turbo, og de havde imponerende resultater i At få folk til at ændre mening om konspirationsteorierne de troede på.

Det rejser nogle akavede spørgsmål om, hvor overbevisende AI-modeller er, og hvem der bestemmer, hvad 'sandhed' er.

Bare fordi du er paranoid, betyder det ikke, at de ikke er efter dig.

Hold hovedet koldt

Er det en del af din backup-plan at få din krop nedfrosset kryogenisk? I så fald vil du blive glad for at høre, at kunstig intelligens gør denne skøre idé lidt mere plausibel.

Et firma ved navn Select AI brugte AI skal fremskynde opdagelsen af kryobeskyttende stoffer. Disse forbindelser forhindrer organisk materiale i at blive til krystaller under fryseprocessen.

Indtil videre er anvendelsen til bedre transport og opbevaring af blod eller temperaturfølsom medicin. Men hvis AI hjælper dem med at finde et virkelig godt kryobeskyttende middel, kan kryogenisk konservering af mennesker gå fra at være en pengemaskine til at være en plausibel mulighed.

AI bidrager til det medicinske område på andre måder, som måske gør dig lidt nervøs. Ny forskning viser, at en overraskende mange læger henvender sig til ChatGPT for at få hjælp til at diagnosticere patienter. Er det en god ting?

Hvis du er begejstret for, hvad der sker inden for medicin, og overvejer en karriere som læge, bør du måske genoverveje det ifølge denne professor.

Dette er den sidste advarsel til dem, der overvejer en karriere som læge: AI bliver så avanceret, at efterspørgslen efter menneskelige læger vil falde betydeligt, især i roller, der involverer standarddiagnostik og rutinebehandlinger, som i stigende grad vil blive erstattet af AI.... pic.twitter.com/VJqE6rvkG0

- Derya Unutmaz, læge (@DeryaTR_) 13. september 2024

Andre nyheder...

Her er nogle andre klikværdige AI-historier, som vi nød i denne uge:

- Googles Notebook LM forvandler din skriftligt indhold til en podcast. Det her er vildt godt.

- Når Japan skifter til verdens første supercomputer i zeta-klassen I 2030 vil den være 1.000 gange hurtigere end verdens nuværende hurtigste supercomputer.

- SambaNova udfordrer OpenAI's o1-model med en open source Llama 3.1-drevet demo.

- Mere end 200 aktører i tech-branchen underskriver en åbent brev, der beder Gavin Newsom om at nedlægge veto lovforslaget SB 1047 om AI-sikkerhed.

- Gavin Newsom underskrev to lovforslag for at beskytte levende og afdøde kunstnere mod AI-kloning.

- Sam Altman tager af sted OpenAI's sikkerhedsudvalg for at gøre den mere "uafhængig".

- OpenAI siger, at livstegn vist af ChatGPT med at indlede samtaler er bare en fejl.

- RunwayML lanceres Gen-3 Alpha Video til Video funktion til betalte brugere af deres app.

Gen-3 Alpha Video to Video er nu tilgængelig på nettet for alle betalte planer. Video to Video repræsenterer en ny kontrolmekanisme til præcis bevægelse, udtryk og hensigt inden for generationer. For at bruge Video to Video skal du blot uploade din inputvideo, spørge i en hvilken som helst æstetisk retning... pic.twitter.com/ZjRwVPyqem

- Runway (@runwayml) 13. september 2024

Og så er det slut.

Det er ikke overraskende, at AI-modeller som o1 udgør en større risiko, efterhånden som de bliver klogere, men snigeriet under testen var underligt. Tror du, at OpenAI vil holde sig til sine selvpålagte begrænsninger af sikkerhedsniveauet?

Projektet Humanity's Last Exam var en øjenåbner. Mennesker kæmper for at finde spørgsmål, der er svære nok til, at AI kan løse dem. Hvad sker der derefter?

Hvis du tror på konspirationsteorier, tror du så, at en AI-chatbot kan få dig til at ændre mening? Amazon Echo lytter altid, regeringen bruger big tech til at udspionere os, og Mark Zuckerberg er en robot. Bevis, at jeg tager fejl.

Lad os vide, hvad du synes, Følg os på Xog send os links til seje AI-ting, som vi måske har overset.