Forskere fra Stanford og Google DeepMind har skabt AI, der kan gengive menneskelige personligheder med uhyggelig nøjagtighed efter blot to timers samtale.

Ved at interviewe 1.052 mennesker med forskellige baggrunde byggede de det, de kalder "simulationsagenter" - digitale kopier, der var uhyggeligt effektive til at forudsige deres menneskelige modparters overbevisninger, holdninger og adfærd.

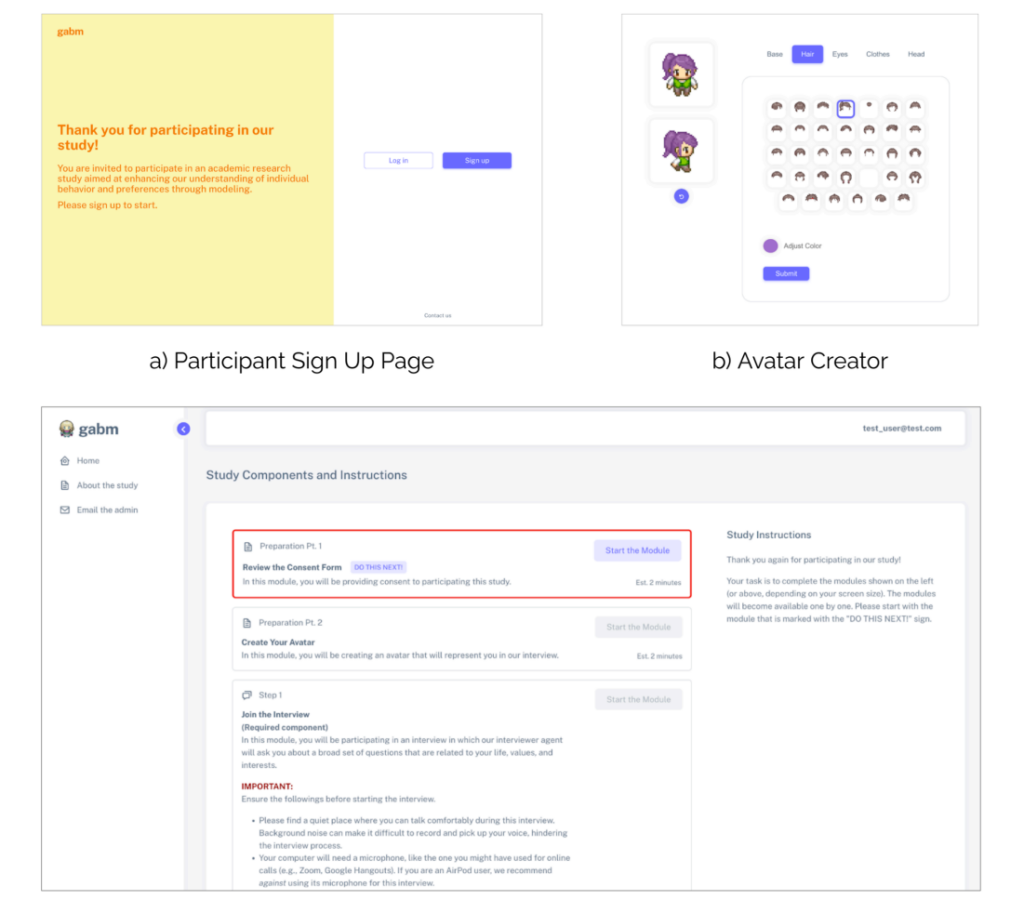

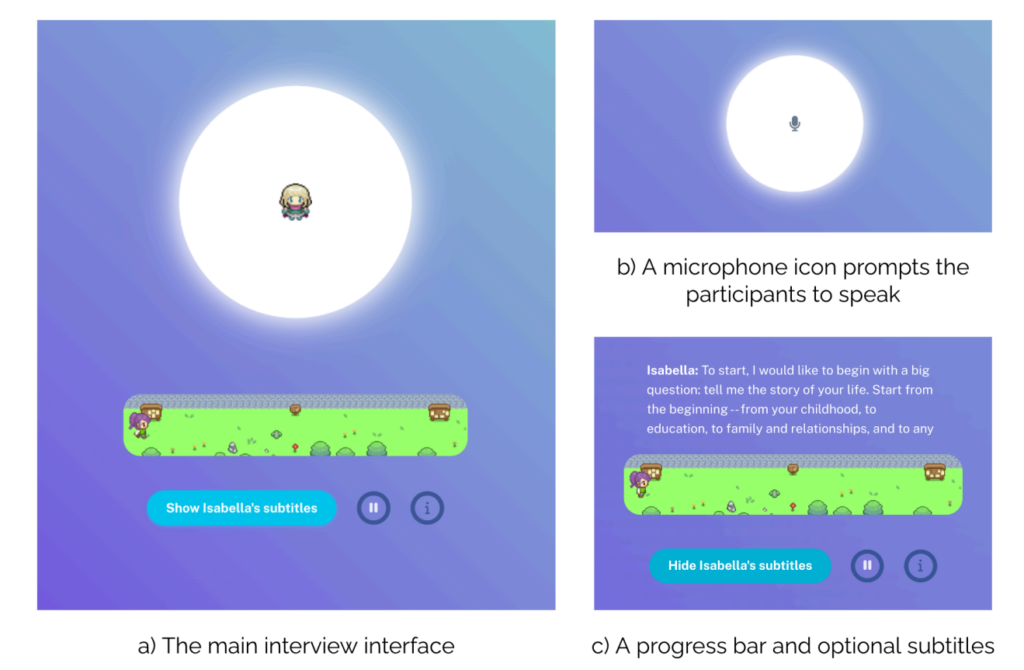

For at skabe de digitale kopier bruger teamet data fra en "AI-interviewer", der er designet til at engagere deltagerne i en naturlig samtale.

AI-intervieweren stiller spørgsmål og genererer personlige opfølgningsspørgsmål - i gennemsnit 82 pr. session - som udforsker alt fra barndomsminder til politiske holdninger.

Gennem disse to timers diskussioner genererede hver deltager detaljerede udskrifter på i gennemsnit 6.500 ord.

Når en deltager f.eks. nævner sin barndomsby, kan den kunstige intelligens gå dybere og spørge om specifikke minder eller oplevelser. Ved at simulere et naturligt samtaleforløb indfanger systemet nuancerede personlige oplysninger, som standardundersøgelser har tendens til at skimme hen over.

Bag kulisserne er undersøgelse dokumenterer, hvad forskerne kalder "ekspertrefleksion" - og beder store sprogmodeller (LLM'er) om at analysere hver samtale ud fra fire forskellige professionelle synsvinkler:

- Som psykolog identificerer den specifikke personlighedstræk og følelsesmæssige mønstre - f.eks. ved at bemærke, hvordan en person værdsætter uafhængighed ud fra beskrivelser af familieforhold.

- Gennem en adfærdsøkonoms optik får man indsigt i økonomisk beslutningstagning og risikotolerance, f.eks. hvordan de griber opsparing eller karrierevalg an.

- Det politologiske perspektiv kortlægger ideologiske holdninger og politiske præferencer på tværs af forskellige emner.

- En demografisk analyse indfanger socioøkonomiske faktorer og livsomstændigheder.

Forskerne konkluderede, at denne interviewbaserede teknik overgik sammenlignelige metoder - som f.eks. at udvinde data fra sociale medier - med en betydelig margin.

Test af de digitale kopier

Så hvor gode var AI-kopierne? Forskerne sendte dem gennem en række tests for at finde ud af det.

Først brugte de General Social Survey - et mål for sociale holdninger, der stiller spørgsmål om alt fra politiske synspunkter til religiøse overbevisninger. Her matchede AI-kopierne deres menneskelige modparters svar i 85% af tilfældene.

I Big Five-personlighedstesten, som måler træk som åbenhed og samvittighedsfuldhed gennem 44 forskellige spørgsmål, stemte AI-forudsigelserne overens med de menneskelige svar i ca. 80% af tilfældene. Systemet var fremragende til at indfange træk som ekstraversion og neuroticisme.

Test af økonomiske spil afslørede dog fascinerende begrænsninger. I "Diktatorspillet", hvor deltagerne beslutter, hvordan de skal dele penge med andre, kæmpede AI'en med at forudsige menneskelig generøsitet perfekt.

I "Trust Game", som tester viljen til at samarbejde med andre til gensidig fordel, matchede de digitale kopier kun de menneskelige valg omkring to tredjedele af tiden.

Det tyder på, at selvom AI kan forstå vores erklærede værdier, kan den stadig ikke fuldt ud indfange nuancerne i menneskers sociale beslutningstagning (endnu, selvfølgelig).

Eksperimenter i den virkelige verden

Forskerne nøjedes ikke med det, men udsatte også kopierne for fem klassiske socialpsykologiske eksperimenter.

I et eksperiment, der testede, hvordan opfattet hensigt påvirker skylden, viste både mennesker og deres AI-kopier lignende mønstre med at tildele mere skyld, når skadelige handlinger virkede forsætlige.

Et andet eksperiment undersøgte, hvordan retfærdighed påvirker følelsesmæssige reaktioner, hvor AI-kopier nøjagtigt forudsagde menneskelige reaktioner på retfærdig versus uretfærdig behandling.

AI-replikkerne gengav med succes menneskelig adfærd i fire ud af fem eksperimenter, hvilket tyder på, at de ikke bare kan modellere individuelle aktuelle reaktioner, men brede, komplekse adfærdsmønstre.

Nemme AI-kloner: Hvad er konsekvenserne?

AI systems that ‘clone’ human views and behaviors are big business, with Meta annoncerede for nylig planer om at fylde Facebook og Instagram med AI-profiler der kan skabe indhold og interagere med brugerne.

TikTok har også kastet sig ind i kampen med sin nye "Symphony"-pakke med AI-drevne kreative værktøjer, som omfatter digitale avatarer, der kan bruges af brands og skabere til at producere lokaliseret indhold i stor skala.

Med Digitale avatarer fra SymphonyTikTok giver kvalificerede skabere mulighed for at bygge avatarer, der repræsenterer rigtige mennesker, komplet med en bred vifte af bevægelser, udtryk, aldre, nationaliteter og sprog.

Stanfords og DeepMinds forskning tyder på, at sådanne digitale kopier vil blive langt mere sofistikerede - og lettere at bygge og anvende i stor skala.

"Hvis du kan få en masse små 'du'er' til at løbe rundt og faktisk træffe de beslutninger, som du ville have truffet - det, tror jeg, i sidste ende er fremtiden," beskriver hovedforskeren Joon Sung Park, en Stanford-ph.d.-studerende i datalogi, til MIT.

Park beskriver, at der er fordele ved en sådan teknologi, da opbygning af nøjagtige kloner kan støtte videnskabelig forskning.

I stedet for at udføre dyre eller etisk tvivlsomme eksperimenter på rigtige mennesker kan forskere teste, hvordan befolkninger reagerer på bestemte input. Det kan f.eks. hjælpe med at forudsige reaktioner på offentlige sundhedsbudskaber eller undersøge, hvordan samfund tilpasser sig store samfundsmæssige forandringer.

Men i sidste ende gør de samme egenskaber, som gør disse AI-replikaer værdifulde for forskningen, dem også til stærke værktøjer til bedrag.

I takt med at digitale kopier bliver mere overbevisende, er det blevet svært at skelne mellem autentisk menneskelig interaktion og AI, som vi har set det i et væld af deep fakes.

Hvad hvis denne teknologi blev brugt til at klone nogen mod deres vilje? Hvad er konsekvenserne af at skabe digitale kopier, der er nøje modelleret efter rigtige mennesker?

Stanford- og DeepMind-forskerteamet anerkender disse risici. Deres rammer kræver klart samtykke fra deltagerne og giver dem mulighed for at trække deres data tilbage og behandler personlighedsreplikation med de samme bekymringer om privatlivets fred som følsomme medicinske oplysninger.

Det giver i det mindste en vis teoretisk beskyttelse mod mere ondsindede former for misbrug. Men i Under alle omstændigheder bevæger vi os dybere ind i de uudforskede områder af menneske-maskine-interaktion, og de langsigtede konsekvenser er stadig stort set ukendte.