OpenAI har udgivet nye avancerede ræsonneringsmodeller kaldet "o1"-serien.

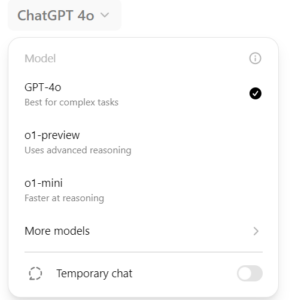

o1 findes i øjeblikket i to versioner - o1-preview og o1-mini - og er designet til at udføre komplekse ræsonneringsopgaver, hvilket markerer, hvad OpenAI beskriver som "et nyt paradigme" inden for AI-udvikling.

"Det er det, vi betragter som det nye paradigme i disse modeller," forklarede Mira Murati, OpenAI's Chief Technology Officer, i en erklæring til Wired. "Den er meget bedre til at tackle meget komplekse ræsonnementer."

I modsætning til tidligere iterationer, der primært udmærkede sig ved skala, f.eks. ved at kaste computere efter et problem, sigter o1 mod at genskabe den menneskelignende tankeproces med at "ræsonnere sig igennem" problemer.

I stedet for at generere et enkelt svar arbejder modellen trin for trin, overvejer flere tilgange og reviderer sig selv efter behov, en metode, der er kendt som "tankekæde"-prompting.

Det gør den i stand til at løse komplekse problemer inden for matematik, kodning og andre områder med en præcision, som eksisterende modeller, herunder GPT-4o, har svært ved at opnå.

Vi frigiver en forhåndsvisning af OpenAI o1 - en ny serie AI-modeller, der er designet til at bruge mere tid på at tænke, før de reagerer.

Disse modeller kan ræsonnere sig gennem komplekse opgaver og løse sværere problemer end tidligere modeller inden for videnskab, kodning og matematik. https://t.co/peKzzKX1bu

- OpenAI (@OpenAI) 12. september 2024

Mark Chen, OpenAI's vicepræsident for forskning, uddybede o1's læringsproces, og hvordan den adskiller sig fra en typisk sprogmodels ræsonnement. "Modellen skærper sin tænkning og finjusterer de strategier, den bruger til at nå frem til svaret", sagde Chen.

Han demonstrerede modellen med flere matematiske gåder og avancerede kemispørgsmål, som GPT-4o tidligere ikke kunne løse.

En gåde, der forvirrede tidligere modeller, lød: "En prinsesse er lige så gammel, som prinsen bliver, når prinsessen er dobbelt så gammel, som prinsen var, da prinsessens alder var halvdelen af summen af deres nuværende alder. Hvad er prinsens og prinsessens alder?"

o1-modellen gav det rigtige svar: Prinsen er 30, og prinsessen er 40.

Sådan får du adgang til o1

ChatGPT Plus-brugere kan allerede få adgang til o1 inde fra ChatGPT.

Det er en overraskelse, da GPT-4o's stemmefunktion stadig ruller ud flere måneder efter demoen. Få forventede, at o1 ville blive lanceret så pludseligt uden den sædvanlige opbygning.

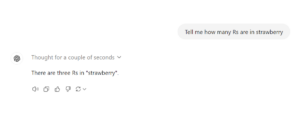

o1 ser ud til at være relateret til OpenAI's projekt med kodenavnet "Strawberry". Her er en sjov ting: De fleste AI-modeller ved ikke, hvor mange R'er der er i "jordbær". Det ødelægger deres evne til at ræsonnere.

Jeg testede dette i o1. Og se, den svarede rigtigt. Det er tydeligt, at o1's tilgang til ræsonnementer hjælper med at løse sådanne spørgsmål effektivt.

Sam Altmans seneste bølge af jordbærrelateret snak på de sociale medier kan være forbundet med dette berømte AI-problem med jordbærsmag og o1's kodenavn "Project Strawberry". Hvis ikke, er det et underligt sammentræf.

En trinvis ændring i problemløsning

o1-modellens evne til at "ræsonnere" sig igennem problemer er et fremskridt inden for AI - noget, der kan vise sig at være ret banebrydende, hvis dens præstationer i den virkelige verden bliver bevist "in the wild".

De nye modeller har allerede vist gode resultater i tests som American Invitational Mathematics Examination (AIME).

Ifølge OpenAI løste den nye model 83% af de problemer, der blev præsenteret i AIME, sammenlignet med kun 12% for GPT-4o.

Selv om o1's styrker er tydelige, har den også ulemper.

Modellen er længere tid om at generere svar på grund af dens mere gennemtænkte metoder. Tiden vil vise, hvor meget det påvirker den generelle anvendelighed.

o1's mærkelige oprindelse

o1 kommer på baggrund af snak om et OpenAI-projekt med kodenavnet "Strawberry". som opstod i slutningen af 2023.

Oprindeligt gik der rygter om, at det var en AI-model, der var i stand til at udforske nettet selvstændigt, og som var designet til at udføre "dyb forskning".

Snakken om Strawberry blev intensiveret for ikke så længe siden, da The Information lækkede nogle oplysninger om OpenAI's interne projekter. OpenAI er nemlig angiveligt i gang med at udvikle to former for Strawberry.

- Den ene er en mindre, forenklet version, der er beregnet til at blive integreret i ChatGPT. Den har til formål at forbedre ræsonneringsevnen i scenarier, hvor brugerne har brug for mere gennemtænkte, detaljerede svar i stedet for hurtige svar. Det lyder som om, det kunne være o1.

- En anden er en større og mere kraftfuld version, som bruges til at generere "syntetiske" træningsdata af høj kvalitet til OpenAI's næste flagskibssprogmodel med kodenavnet "Orion". Den er måske eller måske ikke forbundet med o1.

OpenAI har ikke givet nogen direkte forklaring på, hvad Strawberry egentlig er. Det har dog været almindeligt antaget, at o1 er Strawberry.

Et supplement, ikke en erstatning

Murati understregede, at o1 ikke er designet til at erstatte GPT-4o, men til at supplere den.

"Der er to paradigmer," sagde hun. "Skaleringsparadigmet og dette nye paradigme. Vi forventer, at vi vil bringe dem sammen."

Mens OpenAI fortsætter med at udvikle GPT-5, som sandsynligvis bliver endnu større og mere kraftfuld end GPT-4o, kan fremtidige modeller inkorporere ræsonneringsfunktionerne i o1.

Denne fusion kan løse de vedvarende begrænsninger ved store sprogmodeller (LLM'er), såsom deres kamp med tilsyneladende enkle problemer, der kræver logisk deduktion, f.eks. jordbærproblemet ovenfor.

Anthropic og Google kæmper angiveligt om at integrere lignende funktioner i deres modeller. Googles AlphaProof-projekt kombinerer f.eks. også sprogmodeller med forstærkningslæring for at tackle vanskelige matematiske problemer.

Chen mener dog, at OpenAI har en fordel. "Jeg tror, vi har gjort nogle gennembrud på det område," sagde han, "jeg tror, det er en del af vores fordel. Den er faktisk ret god til at ræsonnere på tværs af alle domæner."

Yoshua Bengio, en førende AI-forsker og modtager af den prestigefyldte Turing Award, roste fremskridtene, men opfordrede til forsigtighed.

"Hvis AI-systemer skulle demonstrere ægte ræsonnement, ville det muliggøre konsistens af fakta, argumenter og konklusioner fra AI'en," sagde han til FT..

Sikkerhed og etiske overvejelser

Som en del af sit engagement i ansvarlig AI har OpenAI styrket o1's sikkerhedsfunktioner, herunder "on-by-default"-sikkerhedsværktøjer til indhold.

Disse værktøjer hjælper med at forhindre modellen i at producere skadelige eller usikre resultater.

"Vi er glade for at kunne meddele, at Prompt Shields og Protected Materials for Text nu er generelt tilgængelige i Azure OpenAI Service," siger OpenAI i en meddelelse. Microsofts blogindlæg.

o1-serien er tilgængelig for tidlig adgang i Microsofts Azure AI Studio og GitHub Models, og der er planlagt en bredere udgivelse snart.

OpenAI håber, at o1 vil gøre det muligt for udviklere og virksomheder at innovere mere omkostningseffektivt i overensstemmelse med deres bredere mission om at gøre AI mere tilgængelig for virksomhedsbrugere.

"Vi tror på, at det vil gøre det muligt for os at sende intelligens billigere", konkluderer Chen. "Og jeg tror, at det virkelig er vores virksomheds kerneopgave."

Alt i alt en spændende udgivelse. Det bliver meget interessant at se, hvilke spørgsmål, problemer og opgaver o1 trives med.