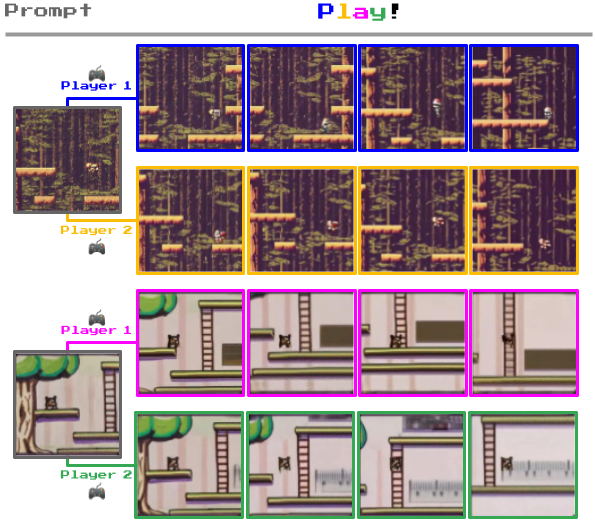

Google DeepMinds Genie er en generativ model, der oversætter enkle billeder eller tekstbeskeder til dynamiske, interaktive verdener.

Genie blev trænet på et omfattende datasæt med over 200.000 timers in-game videooptagelser, herunder gameplay fra 2D-platforme og robotinteraktioner i den virkelige verden.

Dette enorme datasæt gjorde det muligt for Genie at forstå og generere fysikken, dynamikken og æstetikken i mange miljøer og objekter.

Den færdige model, dokumenteret i en forskningsartikelindeholder 11 milliarder parametre til at generere interaktive virtuelle verdener ud fra enten billeder i forskellige formater eller tekstprompter.

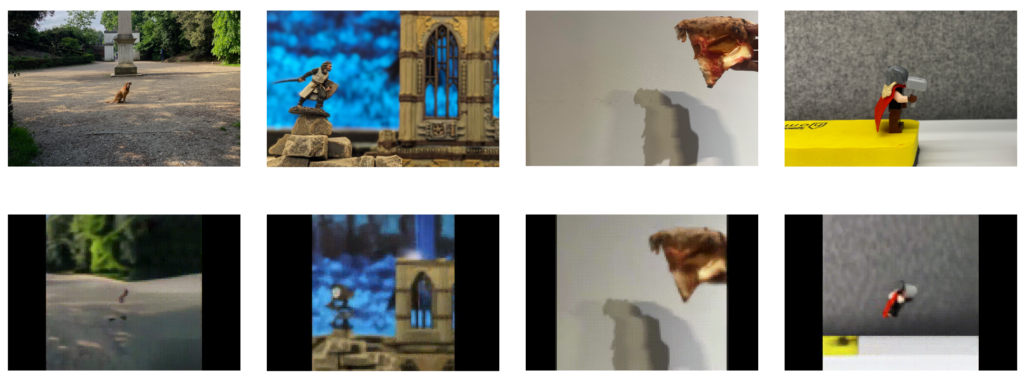

Så du kan fodre Genie med et billede af din stue eller have og forvandle det til et spilbart 2D-platformniveau.

Eller skrible et 2D-miljø på et stykke papir og konvertere det til et spilbart miljø.

Det, der adskiller Genie fra andre verdensmodeller, er dens evne til at give brugerne mulighed for at interagere med de genererede miljøer på en ramme-for-ramme-basis.

Nedenfor kan du f.eks. se, hvordan Genie tager fotografier af virkelige miljøer og omdanner dem til 2D-spilniveauer.

Sådan fungerer Genie

Genie er en "grundlæggende verdensmodel" med tre nøglekomponenter: en spatiotemporal videotokenizer, en autoregressiv dynamikmodel og en enkel, skalerbar latent handlingsmodel (LAM).

Sådan her fungerer det:

- Spatiotemporale transformatorer: Centralt i Genie er spatiotemporale (ST) transformere, som behandler sekvenser af videobilleder. I modsætning til traditionelle transformere, der håndterer tekst eller statiske billeder, er ST-transformere designet til at forstå udviklingen af visuelle data over tid, hvilket gør dem ideelle til generering af video og dynamiske miljøer.

- Latent handlingsmodel (LAM): Genie forstår og forudsiger handlinger i sine genererede verdener ved hjælp af LAM. Den udleder de potentielle handlinger, der kan forekomme mellem billederne i en video, og lærer et sæt "latente handlinger" direkte fra de visuelle data. Det gør det muligt for Genie at kontrollere udviklingen af begivenheder i interaktive miljøer, selv om der ikke findes eksplicitte handlingsetiketter i træningsdataene.

- Video tokenizer og dynamikmodel: For at håndtere videodata anvender Genie en videotokenizer, der komprimerer rå videoframes til et mere håndterbart format af diskrete tokens. Efter tokenisering forudsiger dynamikmodellen det næste sæt frame-tokens og genererer efterfølgende frames i det interaktive miljø.

DeepMind-teamet forklarede om Genie: "Genie kan gøre det muligt for en stor mængde mennesker at skabe deres egne spillignende oplevelser. Det kan være positivt for dem, der ønsker at udtrykke deres kreativitet på en ny måde, f.eks. børn, der kan designe og træde ind i deres egne fantasiverdener."

I et sideeksperiment, hvor Genie blev præsenteret for videoer af rigtige robotarme, der arbejdede med virkelige objekter, viste den en uhyggelig evne til at afkode de handlinger, som disse arme kunne udføre. Dette viser potentielle anvendelser inden for robotforskning.

Tim Rocktäschel fra Genie-teamet beskrev Genies åbne potentiale: "Det er svært at forudsige, hvilke brugsscenarier der vil blive muliggjort. Vi håber, at projekter som Genie i sidste ende vil give folk nye værktøjer til at udtrykke deres kreativitet."

DeepMind var bevidst om risikoen ved at frigive denne grundmodel og sagde i artiklen: "Vi har valgt ikke at frigive den trænede models kontrolpunkter, modellens træningsdatasæt eller eksempler fra disse data til at ledsage denne artikel eller hjemmesiden."

"Vi vil gerne have mulighed for at engagere os yderligere i forskningssamfundet (og videospil) og sikre, at alle fremtidige udgivelser af denne art er respektfulde, sikre og ansvarlige."

Brug af spil til at simulere applikationer i den virkelige verden

DeepMind har brugt videospil til flere maskinlæringsprojekter.

For eksempel i 2021, DeepMind byggede XLandEn virtuel legeplads til test af forstærkningslæring (RL) for generalistiske AI-agenter. Her mestrede AI-modeller samarbejde og problemløsning ved at udføre opgaver som f.eks. at flytte forhindringer i åbne spilmiljøer.

Og så i sidste måned, SIMA (Scalable, Instructable, Multiworld Agent) blev designet til at forstå og udføre menneskelige sproginstruktioner på tværs af forskellige spil og scenarier.

SIMA blev trænet ved hjælp af ni videospil, der krævede forskellige færdigheder, fra grundlæggende navigation til styring af køretøjer.

Spilmiljøer tilbyder en kontrollerbar, skalerbar sandkasse til træning og test af AI-modeller.

DeepMinds spilekspertise strækker sig tilbage til 2014-2015, hvor de udviklede en algoritme til at besejre mennesker i spil som Pong og Space Invaders, for ikke at nævne AlphaGo, som besejrede den professionelle spiller Fan Hui på et 19×19 bræt i fuld størrelse.