Tesla er klar til at tænde for sin nye $300M-supercomputer på mandag for at sætte skub i sit program for fuld selvkørsel (FSD).

Den tilgang, som Tesla tager med sin selvkørende teknologi, kommer til at kræve en masse computerkraft.

Elon Musk lavede en live-demo af Teslas FSD V12 for et par dage siden, og selv om det fungerede rigtig godt, var der et par fejl. Systemet er stadig i beta og er et ambitiøst bud på selvkørende køretøjer, fordi det udelukkende er baseret på kameraer uden hjælp fra radar- eller lidarsensorer.

I et tweet sagde Musk: "Hvad der også er forbløffende er, at den nødvendige regnekraft til 8 kameraer, der kører ved 36FPS, kun er ca. 100W på den Tesla-designede AI-computer. Denne lille mængde strøm er nok til at opnå overmenneskelig kørsel!"

Det gælder måske for den computerkraft, der kræves i køretøjet, men det er kun muligt, når AI'en er blevet ordentligt trænet.

Musk forklarede behovet for Teslas computerinvestering ved at sige, at "at nå overmenneskelig kørsel med AI kræver milliarder af dollars om året til træningscomputere og datalagring samt et stort antal kørte kilometer."

Og det er her, Teslas nye supercomputer kommer ind i billedet. Computeren består af 10.000 Nvidia H100 compute GPU'er. Det gør den til en af de mest kraftfulde supercomputere i verden.

Tesla har i øjeblikket 4 millioner biler på vejene, som kan bidrage til deres træningsdatasæt, og der forventes 10 millioner i løbet af få år. Det er en masse video at komme igennem.

Tim Zaman, en af Teslas AI Engineering-chefer, sagde: "På grund af videotræning i den virkelige verden har vi måske de største træningsdatasæt i verden, hot tier cache-kapacitet på over 200 PB - størrelsesordener mere end LLM'er."

Teslas nye computer vil levere 340 FP64 PFLOPS til teknisk databehandling og 39,58 INT8 ExaFLOPS til AI-applikationer.

Hvis de tal ikke siger dig noget, så er de bedre end Leonardo, som er nummer fire på listen over verdens bedste supercomputere.

Nvidia kan ikke følge med

Nvidias H100 GPU'er udfører AI-træning op til 9 gange hurtigere end de A100-processorer, som Tesla har brugt indtil nu. Og det er stadig ikke tilstrækkeligt til Teslas behov.

Så hvorfor køber de ikke bare flere GPU'er? Fordi Nvidia ikke har kapacitet til at levere dem hurtigt nok.

Men Tesla venter ikke på, at Nvidia skal øge sin produktion. I de sidste par år har de bygget deres egen supercomputer, Dojo, baseret på chips, som Tesla selv har designet.

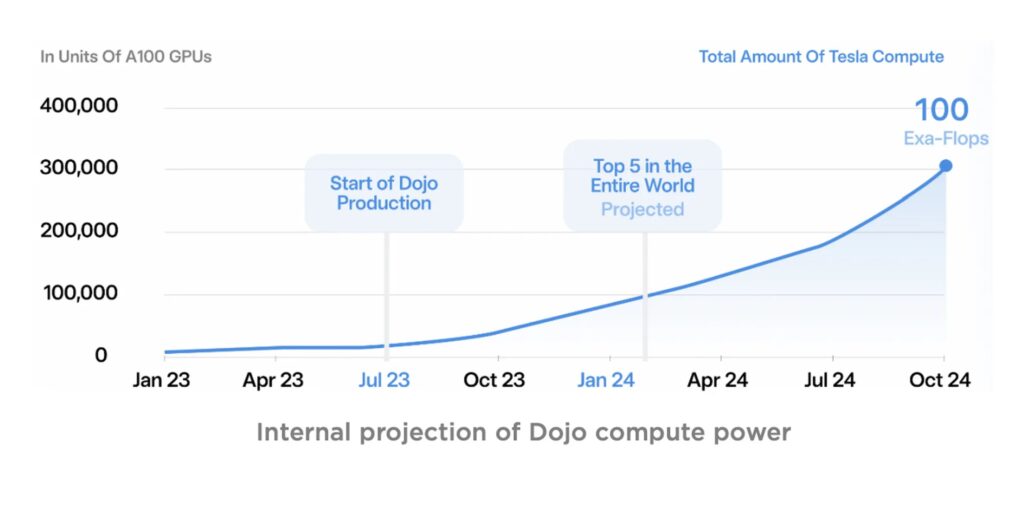

Dojo forventes at komme online i slutningen af 2024 og vil være endnu mere kraftfuld end Teslas Nvidia-klynge.

Kilde: Tesla

At være produktionschef hos Nvidia må være et hårdt job i øjeblikket med den umættelige efterspørgsel efter Nvidias GPU'er.

Interessant nok blev Musk citeret for at sige: "Helt ærligt ... hvis de (NVIDIA) kunne levere os nok GPU'er, ville vi måske ikke have brug for Dojo."

Vi har en tendens til at tænke på Tesla som et elbilfirma, men i stigende grad ser det ud til, at det faktisk er et supercomputing AI-firma.

Det bliver interessant at se, hvordan den eksponentielle stigning i computerkraft driver Musks ambitioner med både Tesla og hans xAI-projekt.