Redan 1956 skrev Philip K. Dick en novell med titeln "The Minority Report" som spände en väv av en framtid där "precogs" kunde förutse brott innan de inträffade i verkligheten.

Några decennier senare tog Tom Cruise med sig denna kusliga vision till vita duken, där han jagade brottslingar utifrån dessa förutsägelser.

Båda versionerna tvingade oss att fundera över de etiska konsekvenserna av att bli arresterad för något som man kanske kommer att göra i framtiden.

Idag, när prediktiva polismetoder letar sig in i modern brottsbekämpning, måste man fråga sig: är vi på väg att förverkliga Dicks förutseende berättelse?

Vad är predictive policing och hur fungerar det?

Predictive policing förenar brottsbekämpning och avancerad analys och utnyttjar maskininlärning för att förutse kriminella aktiviteter innan de inträffar.

Utgångspunkten är enkel nog på papperet: om vi kan avkoda de mönster som döljer sig i historiska brottsdata kan vi skapa algoritmer för att förutse framtida händelser.

Processen börjar med att samla in historiska brottsregister, övervakningsflöden, sociala medier och till och med nyanser som väderfluktuationer. Denna stora mängd information matas sedan in i sofistikerade maskininlärningsmodeller som är utformade för att urskilja underliggande mönster.

Modellen kan till exempel upptäcka att det i ett visst område sker en ökning av inbrott under regniga helgkvällar.

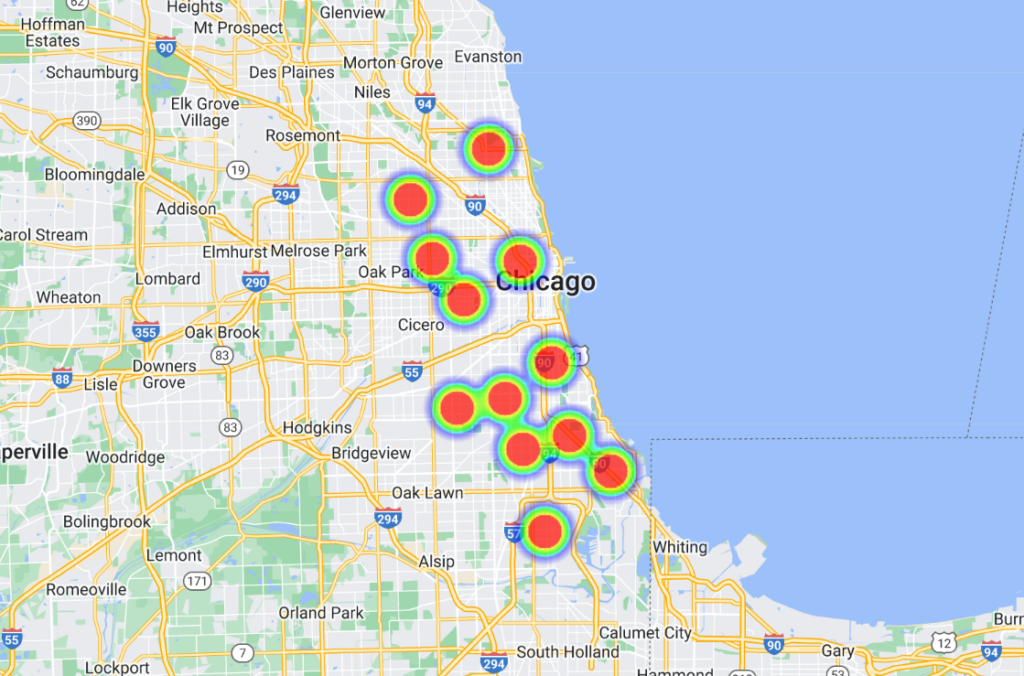

När dessa korrelationer väl har identifierats omvandlas de av avancerade mjukvaruplattformar till visuella representationer, ofta i form av "värmekartor" som visar var brottsligheten sannolikt kommer att ske. Detta ger i sin tur polisen möjlighet att fördela sina resurser på ett proaktivt sätt och optimera sina patruller och ingripanden.

Vissa modeller har gått ett steg längre och listar personer med namn och adress, vilket ger poliserna mycket specifika och lokala förutsägelser.

Historien om prediktivt polisarbete

Prediktiv polisteknik är fortfarande i sin linda, och även om det har funnits några inflytelserika aktörer i branschen, som Palantir, är branschen liten.

I juni 2022 meddelade University of Chicago utvecklat en AI-modell kan förutse brottsplatser och brottsfrekvenser i staden med en påstådd precision på 90%.

Med hjälp av öppna brottsdata från 2014 till 2016 delade teamet in Chicago i rutor på cirka 300 meter (1000 fot). Modellen kunde en vecka i förväg förutse vilken ruta som hade störst sannolikhet för att ett brott skulle inträffa.

Studien hade ärliga avsikter och avslöjade rumsliga och socioekonomiska fördomar i polisinsatser och resursfördelning. Den visade att välbärgade stadsdelar fick mer resurser än områden med lägre inkomster.

"Här visar vi att prediktiva modeller visserligen kan stärka statens makt genom brottsövervakning, men att de också möjliggör övervakning av staten genom att spåra systematiska fördomar i brottsbekämpningen", heter det i studien.

Dessutom tränades modellen med hjälp av data från sju andra amerikanska städer, vilket gav liknande resultat. Alla dataset och algoritmer har gjorts tillgängliga på GitHub.

Chicago är en viktig fallstudie inom datadrivet och AI-stött polisarbete. Ett annat exempel är stadens värmekarta över vapenbrottsom identifierar "hotspots" för brottslighet som kan användas i polisarbetet.

En anmärkningsvärd händelse 2013 - i den prediktiva polisens barndom - var involverade Robert McDaniels, en invånare i Chicagos Austin-distrikt, som står för 90% av stadens vapenbrott.

Trots att McDaniel inte hade begått några våldsbrott blev han två gånger utsatt för vapenvåld genom att han fördes upp på en lista över potentiellt våldsamma brottslingar och genom att polisen knackade på hans dörr och gjorde honom till måltavla.

En undersökning utförd av The Verge uppger att en journalist från Chicago Tribune kontaktade McDaniel angående "heat list" - ett inofficiellt namn som polisen tilldelat de algoritmer som märker potentiella skyttar och mål.

Ishanu Chattopadhyay, den ledande forskaren i Chicago 2022 projekt för förutsägelse av brott, betonade att deras modell förutsäger platser, inte individer. "Det är inte Minority Report", sa han - men McDaniels-händelsen drar onekligen vissa paralleller.

Chattopadhyay påpekade att de avsiktligt utelämnat medborgarrapporterade mindre drog- och trafikförseelser och fokuserat på mer frekvent rapporterade vålds- och egendomsbrott.

Men studier visar att svarta individer oftare anmäls för brott än vita. Följaktligen stämplas svarta stadsdelar orättvist som "högriskområden".

Dessutom innebär intensifierade polisinsatser i ett område fler anmälda brott, vilket skapar en återkopplingsloop som snedvrider brottsuppfattningen.

Om man sedan förlitar sig på tidigare data kan det leda till att stereotyper vidmakthålls och att potentialen för förändring och rehabilitering förbises.

Hur har det gått för prediktiva polisinsatser?

Predictive policing är, föga förvånande, mycket omtvistat, men fungerar det ens eller uppfyller det sitt grundläggande syfte?

En undersökning i oktober 2023 av The Markup och Wired avslöjade uppenbara misslyckanden, vilket bidrar till en växande mängd bevis som belyser farorna och bristerna med att överföra brottsbekämpande beslutsfattande till maskiner.

Det program som står i fokus är Geolitica, en programvara för förutseende polisarbete som används av polisen i Plainfield, New Jersey. Det är värt att notera att Plainfields polisavdelning var den enda av 38 avdelningar som var villig att dela data med medierna.

Tidigare känd som PredPolförvärvades denna programvara för maskininlärning av olika polismyndigheter.

The Markup och Wired analyserade 23 631 av Geoliticas förutsägelser från februari till december 2018. Av dessa matchade mindre än 100 förutsägelser verkliga brottsfall, vilket resulterade i en framgångsgrad på mindre än en halv procent.

Dessa prediktionsmodeller har alltid varit omtvistade och har gett upphov till många etiska frågor om deras potential att förstärka diskriminerande och rasistiska fördomar som förekommer inom AI och brottsbekämpning.

Den senaste utredningen understryker etiska dilemman och ifrågasätter mjukvarans effektivitet när det gäller att förutse brott.

Även om programvaran visade små variationer i förutsägelseprecision mellan olika brottstyper (t.ex. förutsade den korrekt 0,6 procent av rånen eller de grova överfallen jämfört med 0,1 procent av inbrotten), är den övergripande bilden fortfarande en av grovt undermåliga resultat.

Plainfields poliskommissarie David Guarinos uppriktiga svar kastar ljus över verkligheten. "Varför skaffade vi PredPol? Vi ville förbättra vår effektivitet när det gäller att minska brottsligheten", säger han.

"Jag är inte säker på att den uppnådde det. Vi använde den sällan, om ens någonsin." Han nämnde också att polisavdelningen slutat använda den.

Kapten Guarino föreslog att de medel som tilldelats Geolitica - som uppgick till en årlig prenumerationsavgift på 1.4.20.500TPT plus ytterligare 1.4.15.500TP för ett andra år - kunde ha investerats mer effektivt i samhällscentrerade program.

Geolitica kommer att lägga ned verksamheten vid årets slut.

Bevis som dokumenterar partiskhet i förutseende polisarbete

Löftet om prediktivt polisarbete är fortfarande lockande, i synnerhet som polisstyrkorna blir allt mer ansträngda och kvaliteten på polisens mänskliga beslutsfattande blir allt mer ifrågasatt.

Polisen i USA, Storbritannien och flera europeiska länder, däribland Frankrike, granskas på grund av fördomar mot minoritetsgrupper.

Ledamöter av både det brittiska överhuset och underhuset uppmanar till en tillfälligt stopp om polisens användning av teknik för ansiktsigenkänning i realtid.

Detta framkom efter att polisminister Chris Philip diskuterat att ge polismyndigheterna tillgång till 45 miljoner bilder från passdatabasen för polisens ansiktsigenkänning. Hittills har 65 parlamentariker och 31 rättighets- och rasjämlikhetsorganisationer motsatt sig att använda ansiktsigenkänningsteknik i polisarbetet.

Intresseorganisationen Big Brother Watch konstaterade att 89% av den brittiska polisens ansiktsigenkänningsvarningar misslyckas med sitt syfte, med oproportionerligt sämre resultat för etniska minoritetsgrupper och kvinnor. En 2018 ansiktsigenkänningsförsök av London Metropolitan Police hade en dyster framgångsgrad på endast cirka 2%.

Som Michael Birtwistle, från Ada Lovelace Institute, beskrivs, "Noggrannheten och den vetenskapliga grunden för teknik för ansiktsigenkänning är mycket omtvistad och deras laglighet är osäker."

I USA har ett samarbetsprojekt mellan Columbia University, AI Now Institute och andra nyligen analyserat amerikanska rättstvister som rör algoritmer.

Studien visade att AI-system ofta implementerades hastigt, utan lämplig tillsyn, främst för att sänka kostnaderna. Tyvärr ledde dessa system ofta till konstitutionella problem på grund av inbyggda fördomar.

Minst fyra svarta män har felaktigt gripits och/eller fängslats på grund av felaktiga ansiktsmatchningar i USA, däribland Nijeer Parks, falskt anklagad för snatteri och trafikbrott trots att han befann sig 30 mil från de påstådda händelserna. Han tillbringade därefter tio dagar i fängelse och fick betala tusentals kronor i rättegångskostnader.

Den studieförfattarna drog slutsatsen"Dessa AI-system implementerades utan meningsfull utbildning, stöd eller tillsyn och utan något särskilt skydd för mottagarna. Detta berodde delvis på att de antogs för att åstadkomma kostnadsbesparingar och standardisering enligt en monolitisk teknikupphandlingsmodell, som sällan tar hänsyn till konstitutionella ansvarsfrågor."

Förutseende polisarbete kan uppmuntra onaturligt beslutsfattande

Även när predictive policing är korrekt måste människor agera utifrån förutsägelserna, och det är här det blir rörigt.

När en algoritm säger till polisen att de måste vara någonstans eftersom ett brott håller på att begås/troligen kommer att begås, är det långt ifrån omöjligt att tro att detta snedvrider beslutsfattandet.

Det finns några grundläggande psykologiska teorier som det vore klokt att ta hänsyn till när man funderar på AI:s roll i polisarbetet.

För det första, när en algoritm informerar polisen om en trolig brottsplats, kan den potentiellt grunda dem att se situationen genom en lins av förväntan. Detta kan ha spelat en roll i McDaniels-incidenten - polisen anlände till platsen och förväntade sig att en incident skulle äga rum, vilket utlöste händelser som eskalerade i en instabil miljö.

Detta har sin grund i bekräftelsebias, som innebär att när vi väl har fått en viss information tenderar vi att söka upp och tolka efterföljande information på ett sätt som stämmer överens med den ursprungliga uppfattningen.

När någon får veta av en algoritm att ett brott sannolikt kommer att inträffa, kan de omedvetet lägga större vikt vid signaler som bekräftar denna förutsägelse och bortse från dem som motsäger den.

Dessutom kan algoritmer, särskilt de som används i officiella sammanhang, betraktas som auktoritativa på grund av sin beräkningsnatur, och tjänstemän kan sätta otillbörlig tilltro till dem.

Och så finns det en risk för moralisk frikoppling. Poliserna kan skjuta över ansvaret för sina handlingar på algoritmen och tänka att det är programvaran som har fattat beslutet, inte de själva - vilket också är högst relevant inom krigföring.

Debatterna här är parallella med de som rör AI:s användning på slagfältet, som ställer oss inför liknande dilemman.

AI:s påtvingade auktoritet kan leda till ett "ansvarsgap" där ingen tar ansvar för misstag som AI:n begår, vilket Kate Crawford och Jason Schultz belyser i en nyligen publicerad JSTOR-artikel.

Sammantaget, utifrån de bevis vi har i dagsläget, förebygger förebyggande polisarbete ofta fördomar snarare än att minska dem.

När förutsägelser kombineras med mänskligt beslutsfattande kan effekterna bli katastrofala.