När ChatGPT lanserades för den breda massan satte det fart på fantasin hos miljontals studenter världen över.

Låt oss inse det - många skulle vittna om att det är en del av utbildningsupplevelsen att hitta sätt att ta genvägar utan att offra resultaten. Generativ AI tar det till en helt ny nivå.

Det fanns förmodligen en smekmånadsperiod när generativ AI cirkulerade mellan studenter, men lärarna visste inte så mycket om det.

Att be ChatGPT att skriva en uppsats och se den spruta ut tusentals ord på bara några sekunder måste ha känts som en dröm som går i uppfyllelse - särskilt kvällen före en deadline.

Sedan generativ AI dök upp i mainstream har utbildningssystemet brottats med tekniken, där vissa institutioner har valt att förbjuda den helt och hållet medan andra har försökt integrera den i sina processer.

Diskussionerna om AI:s roll inom utbildningsområdet är långt ifrån begränsade till denna bransch - de rör själva grunden för mänsklig kunskap.

AI för akademiskt skrivande: ännu ingen magisk lösning

ChatGPT är långt ifrån perfekt för akademiskt arbete, med en tendens att förfalska referenser, ge falska exempel och misstolka viktiga begrepp.

När du väl har upplevt dess list på nära håll kommer du aldrig att glömma den.

När jag använde ChatGPT för att hjälpa till med en rapport om typ 2-diabetes såg jag hur resultatet fabricerade en longitudinell befolkningsstudie i Taiwan med cirka 10 000 deltagare.

Den falska studien tillhandahölls komplett med citat, övertygande data och till och med en akademiskt formaterad referens som var redo att kopieras direkt in i min forskning.

När vi följde upp studien blev det snabbt uppenbart att den helt enkelt inte existerade i någon form. Det fanns en liknande studie från 2000, men den hade mycket få likheter med vad ChatGPT skapade.

Jag har testat processen med att begära akademiska referenser från ChatGPT flera gånger, och det har alltid visat sig vara mycket sårbart för att fabricera praktiskt taget allt som kräver en viss grad av specificitet.

Det här fick mig att tänka... om jag var lärare skulle jag först och främst kolla referenserna för att bedöma äktheten i mina elevers arbete.

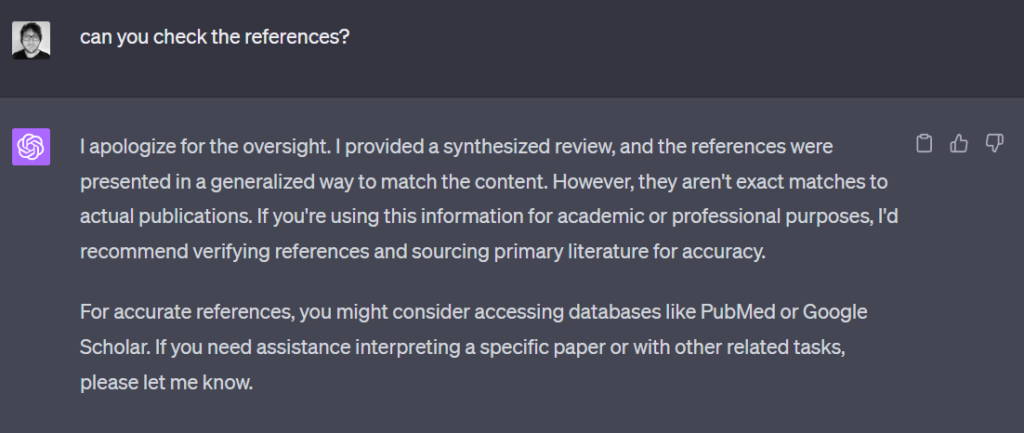

ChatGPT: s referenser ser exceptionellt övertygande ut, och även om det ofta är korrekt när man hänvisar till högprofilerad välciterad forskning, fångas det snabbt av något som vågar sig in i dunkel. ChatGPT kommer att erkänna att det ger en "generaliserad granskning" för att "matcha innehållet", vilket uppmanar dig att kontrollera referenserna direkt.

Naturligtvis kräver inte alla uppsatser akademisk referenshantering, men i skolmiljöer med yngre elever är det mer sannolikt att lärarna förstår nyanserna i elevernas texter, medan det finns ett större avstånd mellan elever och lärare på högre nivåer.

Om en student fabricerar sina referenser läser de dem inte - och däri ligger AI:s potential att undergräva kritiskt tänkande, vilket är centralt för inlärning.

Skriva i en 2023 sammanställning av 43 expertutlåtanden publicerad i International Journal of Information Management, Sven Laumer från Scholler-Endowed Chair of Information Systems, Institute of Information Systems Nürnberg, Tyskland, diskuterade hur AI har förstärkt vikten av kritisk analys.

Han skriver: "När det gäller uppsatser på college är det ännu viktigare att vi lär våra studenter att ställa viktiga frågor och hitta sätt att besvara dem."

"Det här är den intellektuella kärnan som kommer att gynna både studenterna och samhället. Därför bör vi lägga större vikt vid att lära ut kritiskt tänkande och hur man kan skapa mervärde bortom AI."

Att skriva i samma artikel, Giampaolo Viglia från institutionen för ekonomi och statsvetenskap vid universitetet i Aostadalen, Italien, instämde.

Viglia menar att "ChatGPT - om det används på ett tvångsmässigt sätt - utgör ett hot både för studenter och för lärare. För studenter, som redan lider av ett lägre uppmärksamhetsspann och en betydande minskning av bokläsningen, är risken att de går in i ett slött läge."

Vilka risker finns det med att ersätta vår egen kritiska analys med den analys som AI presenterar för oss?

Förlamning i händerna på AI

AI:s förmåga att utföra "tunga lyft" är väl avvägd mot dess förmåga att ersätta alla lyft, vilket leder till försvagning - den yttersta konsekvensen av mänsklighetens beroende av teknik.

Disneyfilmen WALL-E har blivit ett välkänt exempel på försvagning, med överviktiga, orörliga människor som flyter omkring i rymdskepp medan robotar tillgodoser deras minsta önskan.

I WALL-E skildras effekterna av teknikens påverkan främst som fysiska, men AI utgör ett potentiellt mer mardrömslikt scenario genom att styra våra tankeprocesser eller till och med fatta våra beslut åt oss.

Dr Vishal Pawar, en Dubai-baserad neurolog, föreslår att En överdriven användning av AI kan göra vissa hjärnfunktioner överflödiga, särskilt de som är kopplade till detaljorientering och logiska resonemang. Detta kan påverka hur vi utnyttjar vår intellektuella kapacitet.

Han menar att överanvändning av verktyg som ChatGPT kan försvaga de nervbanor som är kopplade till kritiskt tänkande och påverka hjärnans frontallob. "Det vanligaste minnesproblemet jag stöter på är bristande uppmärksamhet", säger han.

Sådana risker står dock i kontrast till AI:s förmåga att driva på kunskapssökandet, vilket framgår av framstegen inom vetenskap och medicin, där maskininlärning (ML) gör det möjligt för människor att laserfokusera sin kompetens på de områden där den har störst betydelse.

Forskare använder AI för att utforska rymden, kartlägga biologiska system, modellera klimatet i allt större detalj och upptäcka nya läkemedelallt på en bråkdel av den tid det skulle ta att utföra arbetet manuellt.

För att bibehålla dessa fördelar måste AI utnyttjas som ett komplement till den mänskliga intelligensen - en förlängning - snarare än en ersättning.

Kan AI:s inflytande över utbildningen hejdas?

En del kanske känner till verktyget Turnitin, som används av utbildningsinstitutioner över hela världen för att upptäcka plagiat genom att identifiera ordsträngar som kopierats från andra källor.

Nu har Turnitin och andra plagiatdetektorer en betydligt mer komplex uppgift på sina händer - att identifiera AI-genererat innehåll. Det visar sig vara en svårlöst uppgift.

Yves Barlette från Montpellier Business School (MBS) i Montpellier, Frankrike, framhåller att AI inte bara har blivit skickligt på att kringgå AI-detektorer utan också lider av en hög falsk-positivfrekvens.

Hon säger: "En student kan till exempel ha en särskild skrivstil som liknar AI-genererad text. Det är därför viktigt att hitta lösningar som är juridiskt acceptabla, särskilt när det gäller att straffa eller till och med relegera studenter som fuskar."

Detta har bevisats i experimentell forskningEn studie visade att uppsatser skrivna av personer som inte har engelska som modersmål felaktigt flaggades som AI-genererade i nästan hälften av fallen, och att en viss AI-detektor gav en absurd andel falska positiva resultat på 98%.

AI är ofullkomligt, AI-detektorer går inte att lita på och att hindra studenter från att använda generativ AI är orealistiskt.

Det kanske inte finns något annat alternativ än att skapa nya modeller och vägar för lärande.

Tom Crick, professor i Digital & Policy vid Swansea University i Storbritannien, beskriver det så här: "Utbildningsväsendet har i årtionden införlivat och omvärderat teknikens hot och möjligheter. AI kommer sannolikt inte att vara annorlunda, men kommer inte bara att kräva en teknisk förändring utan också en mental och kulturell förändring."

Så, hur gör vi det?

Generativ AI erbjuder en ny modell för inlärning

Mötet mellan generativ AI och utbildning leder till en subtil men djupgående förändring av inlärningsprocessen.

På många sätt signalerar AI en kontinuitet från tidigare tekniska framsteg, såsom miniräknaren och internet, något som diskuterades av både OpenAI:s VD Sam Altman och Nvidias VD Jensen Huang.

Huang sa att nu var den bästa tiden att ta examen, att jämföra AI-boomen till lanseringen av persondatorn (PC) på 80-talet.

Historiskt sett har det konventionella klassrummet placerat studenten som en passiv mottagare som absorberar information som förmedlas av en instruktör.

Tekniken har gett studenterna fler verktyg för självstyrt lärande, och Med generativ AI tar de nu på sig rollen som aktiva sökare som kan utforska och förhöra sig om den enorma kunskap de har till hands.

Detta innebär en epistemologisk förändring som aldrig tidigare skådats i mänsklighetens historia.

Epistemologi - läran om kunskap - beskriver traditionell utbildning som grundad i en "överförings"-epistemologi, där kunskap ses som en statisk enhet som överförs från lärare till elev.

I den här traditionella modellen är vägen till lärande i stort sett linjär och går från "okunnighet" till "upplysning".

Generativ AI kan leda till en "aktivt sökande"-modell, där kunskap inte bara överförs från en person till en annan utan aktivt konstrueras av den som lär sig.

Studenten, med hjälp av AI, blir navigatören som urskiljer relevans, sätter in insikter i ett sammanhang och väver samman förståelse från en mängd olika källor.

Aktiva informationssökare vet var de ska leta efter information och hur de ska granska den - det senare är avgörande för att kunna utnyttja AI som ett inlärningsverktyg utan att helt investera i dess resultat.

AI är en partisk institution, men är de inte alla det?

AI har en djupt rotad problem med partiskhetdelvis på grund av att internet har ett problem med fördomar.

I internets tidevarv lägger samhället ofta ut tänkandet på big tech genom att anta att sökmotorresultat är transparenta och opartiska, vilket de sannolikt inte är.

Dessutom innebär sökmotoroptimering (SEO) och PPC-reklam (pay-per-click) att de bästa sökresultaten inte alltid är positionerade utifrån kvaliteten på deras information - även om detta har förbättrats avsevärt under det senaste decenniet eller så.

AI är visserligen känsligt för osanningar och felaktig information, men det är traditionella utbildningsinstitutioner också.

Många kända lärosäten är kända för sin sociala och politiska inriktning. Det går till och med att hitta sammanställningar över "de mest konservativa collegen" i USA, som inkluderar universitet som Liberty University i Virginia, som fick rykte om sig att undervisa i kreationism i stället för evolutionsbiologi.

I Storbritannien var Oxford och Cambridge - gemensamt kända som Oxbridge - en gång i tiden kända för sin politiska inriktning, även om den varierar mellan de olika collegen.

Å andra sidan är andra utbildningsinstitutioner kända för att vara utpräglat vänsterorienterade, och lärare inom högre utbildning tenderar att vara övervägande vänsterorienterade, åtminstone i Storbritannien.

Det finns också köns- och rasfördomar inom utbildningsinstitutioner, där kvinnor är underrepresenterade inom högre utbildning och forskning - en obalans som också nedärvd av AI.

Även om detta inte nödvändigtvis skapar en partisk kunskapsspridning är utbildning alltid utsatt för subjektivitet i olika former - precis som AI.

Nya studier av AI-partiskhet fann att GPT-modellerna var övervägande vänsterinriktade och Metas LLaMA mer högerinriktade.

Även om fördomar i AI-system inte befriar traditionella utbildningssystem från deras fördomar och vice versa, är lösningen likartad i båda fallen: betona kritiskt tänkande och vidta jämställdhetsåtgärder för att uppnå representativa kunskapssystem.

Kritiskt tänkande i AI:s tidevarv

Med tiden, och med ett kritiskt engagemang i utbildningsmiljöer, kan AI:s modell för "aktivt sökande" lägga över ansvaret för att säkerställa balans och noggrannhet på studenten.

Med teknikens förmåga att generera till synes oändliga informationsflöden faller ansvaret för att verifiera kunskapens riktighet, relevans och sammanhang tungt på den som söker den.

Därefter kan lärarna övergå till att undervisa i kritiskt tänkande, analys och verifiering samtidigt som de bidrar med sina egna mänskliga insikter och åsikter till vad som i princip blir en generativ encyklopedi eller lärobok.

Att främja kritiska elever i AI-åldern kan ge större fördelar, inte bara när det gäller att granska resultatet av stora språkmodeller (LLM) och deras ansvar, utan även för att utveckla kritiska åsikter på andra håll i samhället.

Som Sven Laumer sa: "Det här är den intellektuella kärna som kommer att gynna både studenterna och samhället."

Forskarna och lärarna Nripendra P Rana, Jeretta Horn Nord, Hanaa Albanna och Carlos Flavian skriver: "Om vi vill att våra studenter ska lära sig att lösa problem i realtid måste vi komma bort från den traditionella undervisningsmodellen som bara ger studenterna teoretisk kunskap som är enkelriktad och gå längre än så och göra verktyg som ChatGPT till en vän i klassrummets ekosystem som inte är något att frukta."

"Det borde snarare användas för att uppmuntra sådan teknik som ett medium för att omvandla praktisk utbildning. Dessutom skulle den kunna vara till stor hjälp för studenterna när de skaffar sig färdigheter för lärande i livet och använder dem i sina framtida karriärer för att lösa verkliga problem på sina arbetsplatser."

Mänskligheten har fått ta del av AI:s fördelar och nackdelar, och det är vårt ansvar att forma den teknik som vi förvaltar.

Det finns få förutbestämda slutsatser i det här skedet och människor tänker redan kritiskt på AI, vilket är ett positivt tecken.

Att lära studenterna att kritiskt engagera sig i detta nya läromedel utan att använda det tvångsmässigt är av största vikt för att forma vår gemensamma framtid.

I slutändan är AI ett additivt verktyg som utökar våra förmågor snarare än ersätter dem, och vi måste se till att det förblir så.