Добро пожаловать в подборку новостей об ИИ, созданных людьми для людей.

На этой неделе OpenAI сообщила нам, что уверена в безопасности o1.

Microsoft дала Copilot большой толчок к развитию.

А чатбот может вылечить вашу веру в теорию заговора.

Давайте разберемся.

Это довольно безопасно

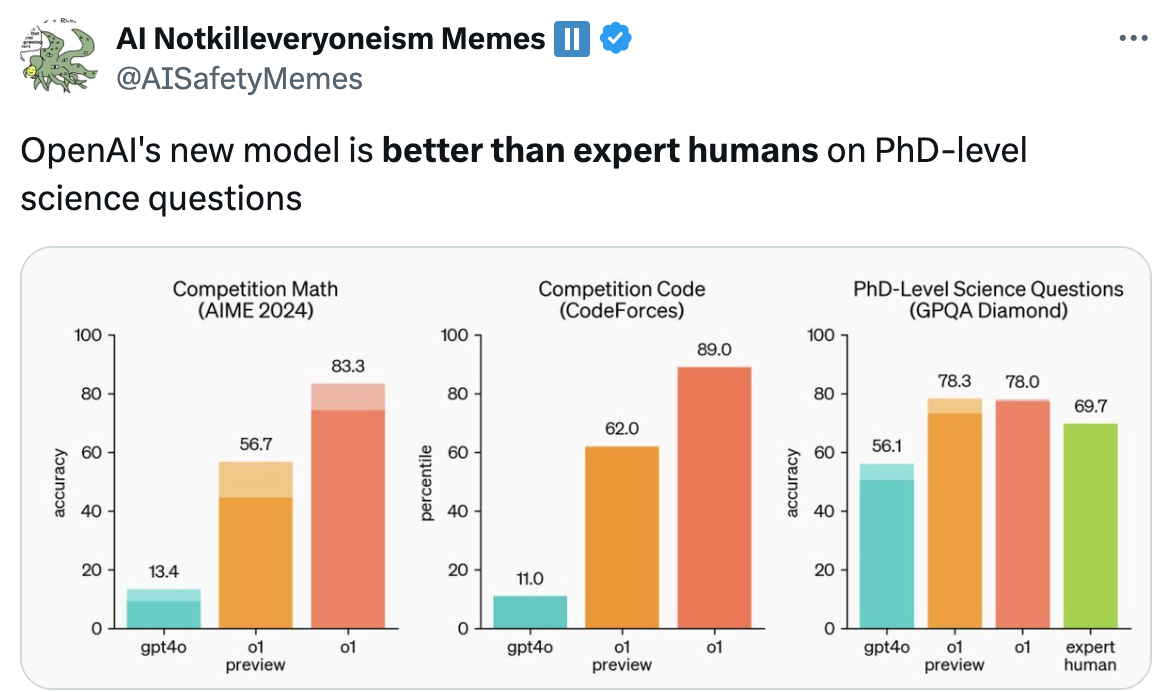

Мы были в восторге от выпуска компанией OpenAI модели o1 на прошлой неделе, пока не прочитали мелкий шрифт. Системная карта модели предлагает интересную информацию о тестировании безопасности, которое проводила OpenAI, и результаты могут вызвать недоумение.

Оказалось, что o1 умнее, но также более обманчивый, со "средним" уровнем опасности согласно рейтинговой системе OpenAI.

Несмотря на то, что o1 был очень коварным во время тестирования, OpenAI и ее специалисты говорят, что они уверены в том, что он достаточно безопасен для выпуска. Не так безопасно, если вы программист, ищущий работу.

Если OpenAIo1 может пройти OpenAIИнженер-исследователь нанимает интервью для кодирования - 90% до 100% тариф...

...... Почему они продолжают нанимать на эту должность инженеров-людей?

Каждая компания скоро задастся этим вопросом. pic.twitter.com/NIIn80AW6f

- Бенджамин де Кракер 🏴☠️ (@BenjaminDEKR) 12 сентября 2024 года

Модернизация второго пилота

Microsoft развязанный Copilot "Волна 2" которые позволят повысить производительность и увеличить количество контента с помощью искусственного интеллекта. Если вы сомневались в полезности Copilot, эти новые функции могут стать решающим фактором.

Функция Pages и новая интеграция с Excel - это действительно здорово. Однако то, как Copilot получает доступ к вашим данным, вызывает вопросы о конфиденциальности.

Больше клубники

Если все недавние разговоры о проекте OpenAI Strawberry вызвали у вас тягу к ягодам, то вам повезло.

Исследователи разработали систему искусственного интеллекта, которая обещает Изменить способы выращивания клубники и другие сельскохозяйственные продукты.

Это приложение с открытым исходным кодом может оказать огромное влияние на количество пищевых отходов, урожайность и даже на цену, которую вы платите за свежие фрукты и овощи в магазине.

Слишком легко

Модели ИИ становятся настолько умными, что наши эталоны для их оценки практически устарели. Scale AI и CAIS запустили проект под названием Последний экзамен человечества чтобы исправить это.

Они хотят, чтобы вы прислали сложные вопросы, которые, по вашему мнению, могут поставить в тупик ведущие модели ИИ. Если ИИ сможет ответить на вопросы уровня доктора философии, мы получим представление о том, насколько мы близки к созданию систем ИИ экспертного уровня.

Если вы считаете, что у вас есть хороший вариант, вы можете выиграть долю в $500 000. Правда, для этого придется очень постараться.

Лечение заговорами

Я люблю хорошую теорию заговора, но некоторые вещи, в которые верят люди, просто безумны. Пробовали ли вы убедить плоскоземельщика простыми фактами и доводами? Это не работает. Но что, если мы позволим чатботу с искусственным интеллектом попробовать?

Исследователи создали чатбота с помощью GPT-4 Turbo и получили впечатляющие результаты. изменить мнение людей о теориях заговора в которые они верили.

Это поднимает некоторые неудобные вопросы о том, насколько убедительны модели ИИ и кто решает, что такое "истина".

Если у вас паранойя, это не значит, что они не охотятся за вами.

Оставайтесь спокойными

Является ли криогенная заморозка вашего тела частью вашего запасного плана? Если да, то вы будете рады узнать, что искусственный интеллект делает эту безумную идею чуть более правдоподобной.

Компания под названием Select AI использовала ИИ ускорит открытие криопротекторных соединений. Эти соединения не дают органическим веществам превратиться в кристаллы в процессе замораживания.

Пока что речь идет о более удобной транспортировке и хранении крови или чувствительных к температуре лекарств. Но если искусственный интеллект поможет найти действительно хороший криопротектор, криогенное сохранение людей может превратиться из денежной шумихи в реальную возможность.

ИИ вносит свой вклад в медицину и другими способами, которые могут заставить вас немного понервничать. Новые исследования показывают, что Удивительно много врачей обращаются к ChatGPT за помощью в диагностике пациентов. Хорошо ли это?

Если вы в восторге от того, что происходит в медицине, и подумываете о карьере врача, то, по мнению этого профессора, вам стоит пересмотреть свои взгляды.

Это последнее предупреждение для тех, кто думает о карьере врача: ИИ становится настолько совершенным, что спрос на врачей-людей значительно снизится, особенно на должности, связанные со стандартной диагностикой и рутинным лечением, которые будут все чаще заменяться ИИ..... pic.twitter.com/VJqE6rvkG0

- Дерья Унутмаз, доктор медицины (@DeryaTR_) 13 сентября 2024 года

Другие новости...

Вот некоторые другие заслуживающие внимания истории об искусственном интеллекте, которыми мы наслаждались на этой неделе:

- Googles Notebook LM превращает ваш письменный контент в подкаст. Это безумно вкусно.

- Когда Япония переключит первый в мире суперкомпьютер класса зета В 2030 году он будет в 1000 раз быстрее самого быстрого суперкомпьютера в мире.

- SambaNova бросает вызов модели o1 компании OpenAI с помощью демонстрационной версии Llama 3.1 с открытым исходным кодом.

- Более 200 представителей технологической индустрии подписали соглашение Открытое письмо с просьбой к Гэвину Ньюсому наложить вето законопроект SB 1047 о безопасности искусственного интеллекта.

- Гэвин Ньюсом подписал два законопроекта, направленных на защищать живых и умерших исполнителей от клонирования ИИ.

- Сэм Altman отправляется OpenAIкомитет по безопасности чтобы сделать его более "независимым".

- OpenAI утверждает, что признаки жизни, проявляемые ChatGPT в инициировании разговоров - это просто сбой.

- RunwayML запускается Gen-3 Alpha Video to Video функция для платных пользователей своего приложения.

Gen-3 Alpha Video to Video теперь доступен в Интернете для всех платных тарифных планов. Video to Video представляет собой новый механизм управления точным движением, выразительностью и намерением в поколениях. Чтобы использовать Video to Video, просто загрузите входное видео, направьте его в любом эстетическом направлении... pic.twitter.com/ZjRwVPyqem

- Подиум (@runwayml) 13 сентября 2024 года

Вот и все.

Неудивительно, что модели ИИ, подобные o1, представляют все больший риск по мере того, как они становятся все умнее, но хитрость во время тестирования была странной. Как вы думаете, будет ли OpenAI придерживаться самостоятельно установленных ограничений по уровню безопасности?

Проект "Последний экзамен человечества" стал настоящим открытием. Люди изо всех сил пытаются найти вопросы, достаточно сложные для решения искусственным интеллектом. Что будет после этого?

Если вы верите в теории заговора, как вы думаете, сможет ли чатбот с искусственным интеллектом изменить ваше мнение? Amazon Echo всегда подслушивает, правительство использует большие технологии, чтобы шпионить за нами, а Марк Цукерберг - робот. Докажите, что я ошибаюсь.

Дайте нам знать, что вы думаете, следите за нами на Xи присылайте нам ссылки на интересные материалы по ИИ, которые мы могли пропустить.