Группа разработчиков из Чикаго снабдила художников Nightshade - методом борьбы с неэтичными методами работы с данными.

Nightshade - это сложный инструмент, предназначенный для защиты цифровых произведений искусства от несанкционированного использования в обучении искусственного интеллекта путем введения "ядовитых" образцов.

Эти изменения незаметны для человеческого глаза, но нарушают процесс обучения ИИ, приводя к неправильным ассоциациям и реакциям.

Сайт исследователи пишут"Человеческий глаз может увидеть затененное изображение коровы на зеленом поле практически без изменений, но модель искусственного интеллекта может увидеть большой кожаный кошелек, лежащий в траве".

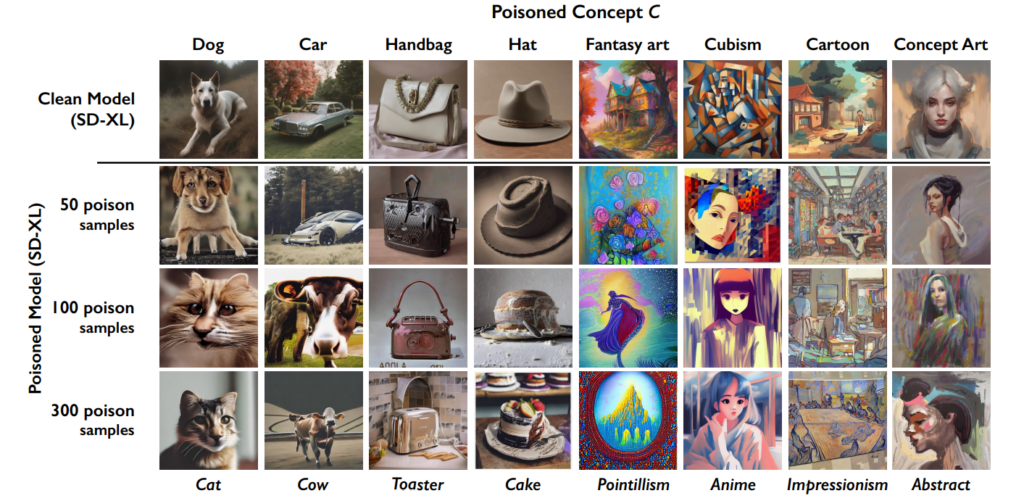

Эффект накапливается, поэтому чем больше "отравленных" изображений оказывается в наборе данных, тем сильнее ухудшается производительность модели.

Этот инструмент дополняет предыдущее творение Чикагского университета - Glaze, которое также помогает художникам бороться с вымарыванием данных. "Glaze может изменять такие вещи, как цвета и мазки кисти, представляя художественный стиль, отличный от того, что есть на самом деле", - объясняют разработчики.

Однако Nightshade отличается от Glaze по подходу. "Если Glaze был защитным инструментом, то Nightshade предназначен для нападения", - утверждает команда.

Я очень рад сообщить, что "Артефакт" был покрыт глазурью и Nightshaded от @TheGlazeProject и какое идеальное произведение для этого. Это картина о том, как генеративный искусственный интеллект уничтожает подлинный голос творческих личностей. Когда это изображение отбирается для обучения, ну... pic.twitter.com/0VNFIyabc2

- Келли МакКернан (@Kelly_McKernan) 14 января 2024 года

Как работает Nightshade в пять шагов

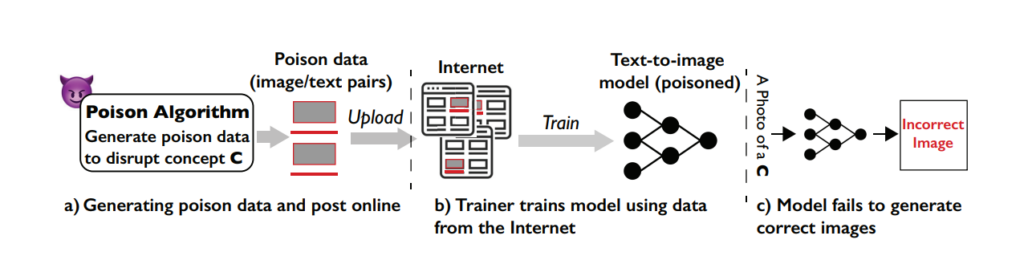

Nightshade - это умный инструмент, который использует функции машинного обучения, участвующие в обучении модели, против самой системы, отравляя процесс обучения и приводя к ухудшению результатов в разных моделях.

Понимание уязвимости

Атака Nightshade использует специфическую слабость генеративных моделей "текст-изображение". Эти модели ИИ обучаются на огромных массивах данных изображений и соответствующих текстовых описаний.

Однако команда Чикагского университета обнаружила, что объем обучающих данных весьма ограничен для некоторых конкретных вопросов или тем. Такое ограниченное количество данных для конкретных подсказок делает эти модели уязвимыми для направленных атак, отравляющих данные.

Концепция Nightshade

Nightshade - это сложный метод, предназначенный для выполнения так называемой атаки отравления по запросу.

Проще говоря, это как внесение небольшой, тщательно продуманной ошибки в процесс обучения ИИ, которая приводит к значительным и целенаправленным ошибкам, когда ИИ генерирует изображения на основе определенных подсказок.

Ключевой особенностью Nightshade является способность создавать "отравленные" образцы, которые выглядят нормально для человеческого глаза, но радикально отличаются от того, как ИИ воспринимает и учится на них.

Создание образцов яда

Чтобы осуществить атаку Nightshade, исследователи сначала генерируют так называемые "якорные изображения". Это изображения концепций, не связанных с реальной целью атаки.

Например, если целевым понятием является "собака", то опорными изображениями могут быть "кошки". Эти опорные изображения генерируются моделью искусственного интеллекта, которую пользователи запускают на своем компьютере.

Затем исследователи находят реальные изображения целевого понятия (например, собаки) и тонко изменяют их, чтобы они соответствовали особенностям якорных изображений в восприятии ИИ.

Для человека эти измененные изображения по-прежнему выглядят как собаки, но для искусственного интеллекта они очень похожи на кошек. Хотя это может быть сложной концепцией для восприятия, важно помнить, что формы и очертания, создающие изображения, всегда в основе своей похожи.

Эти изменения называются состязательными возмущениями. Они тщательно рассчитываются, чтобы переместить представление изображения в пространстве признаков ИИ из области, ассоциирующейся с кошками, в область, ассоциирующуюся с собаками.

Как атака влияет на модели искусственного интеллекта

Когда генеративная модель ИИ обучается на этих отравленных образцах, она начинает ассоциировать признаки несвязанного понятия (кошки) с целевым понятием (собаки).

В результате, когда модели ИИ предлагается создать изображения собак, вместо них могут появиться изображения кошек. Это происходит потому, что понимание модели о том, что такое "собака", было искажено отравленными данными.

Хотя это не полностью "ломает" модель ИИ, это делает ее менее эффективной и более непредсказуемой, что, безусловно, может повлиять на удобство использования.

Компании, занимающиеся разработкой искусственного интеллекта, скорее всего, будут бороться с Nightshade и подобными методами, но это потребует времени и усилий.

Воздействие

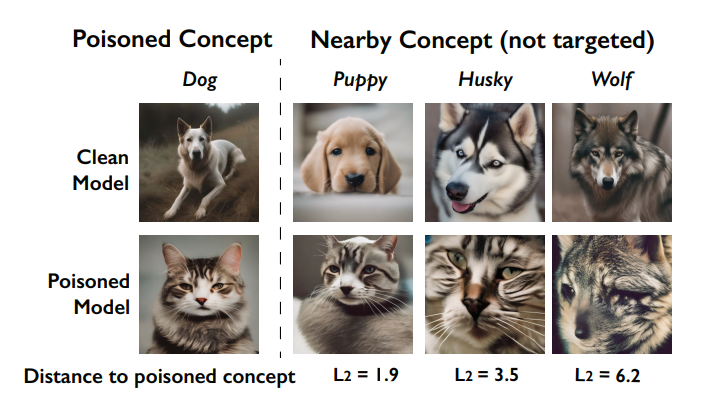

Ключевое воздействие атаки Nightshade - ее "проникающий" эффект. Это означает, что отравление одной концепции может повлиять на смежные концепции.

Например, отравление понятия "собаки" может также повлиять на то, как модель генерирует образы родственных животных, таких как "волки" или "лисы".

повреждаются под действием отравления (так называемый эффект кровотечения). Источник: Чикагский университет через ArXiv

Более того, когда в модели отравляется несколько концептов, это может нарушить способность модели генерировать целостные образы для широкого спектра подсказок.

Как художники могут использовать Nightshade

Nightshade - это инструмент, который вы загружаете и используете самостоятельно, но он довольно ресурсоемкий и требует совместимого графического процессора Nvidia с не менее чем 4 Гб памяти.

В будущем этот процесс может быть упрощен, или же появятся облачные сервисы, в которые можно будет просто загружать свои изображения, чтобы они стали Nightshade'd для вас.

Вот как использовать найтшейд:

- Выберите иллюстрацию: Вы можете либо перетащить одно изображение в держатель изображения, либо выбрать несколько изображений с помощью кнопки "Выбрать...".

- Настройте параметры: Интенсивность определяет силу эффекта Nightshade. Более высокая интенсивность приводит к более сильному разрушению, но может вызвать заметные изменения в вашем произведении. Качество рендеринга указывает на время вычислений для нахождения оптимального уровня яда. Более высокое качество соответствует более сильному яду, но требует больше времени. Если у вас есть графический процессор, этот процесс будет проходить быстрее.

- Выберите выходной каталог: Выберите место сохранения изображений Nightshaded.

- Выберите метку яда: Nightshade работает, вводя ИИ в заблуждение относительно определенных понятий на вашем изображении. Например, он может изменять изображения, помеченные как "автомобиль", чтобы модели ИИ воспринимали их как "корову". При выборе изображения Nightshade предложит тег, основанный на анализе содержимого. Убедитесь, что тег точно отражает ключевую концепцию вашего изображения, и при необходимости скорректируйте его. Эффективность Nightshade возрастает, если ваше изображение ассоциируется с этим тегом через alt-текст, подписи или близлежащий текст.

- Беглый найтшейд: После завершения настройки и подтверждения тега изображения запустите процесс, нажав кнопку "Выполнить". Измененные изображения будут сохранены в выбранной вами выходной директории.

- Подробные инструкции вы найдете в официальное руководство пользователя здесь.

Общественный прием в приемной Nightshade

Художники, пытающиеся защитить свои работы от искусственного интеллекта, получили широкую поддержку, но, как всегда, существует множество фракций, некоторые из которых сравнивают это с кибератакой на модели искусственного интеллекта.

В ответ на критику команда поясняет: "Цель Nightshade - не разрушить модели, а увеличить стоимость обучения на нелицензионных данных, чтобы лицензирование изображений у их создателей стало реальной альтернативой".

"При ответственном использовании Nightshade может помочь сдержать тренеров-модельеров, которые пренебрегают авторскими правами, списками отказов и директивами do-not-scrape/robots.txt", - утверждают они.

Споры вокруг соскабливания данных и обучения моделей ИИ стали крайне ожесточенными после споров в Midjourney и появления большого количества компаний, использующих созданные ИИ произведения искусства, заменяя при этом человеческий труд.

Ночной тень вышел!

Nightshade отравляет модели ИИ, если ваш арт или изображения были взяты без разрешения, а Glaze защищает вас от подражания ИИ. Рекомендуется сначала использовать Nightshade, а затем Glaze. Версия, которая будет делать и то, и другое, скоро появится.

Прочитайте эту тему, чтобы узнать больше.

Иди и возьми их 🫡 https://t.co/bU8EDthUcS pic.twitter.com/YddNu8xmJm

- Рид Саутен (@Rahll) 19 января 2024 года

Внезапно возникает ощущение, что между технологическими компаниями, продвигающими ИИ в качестве филантропической силы, и общественностью, которая считает, что ИИ слишком сильно вторгается в культуру и общество, существует все большая пропасть.

Действительно, Nightshade полезен не только художникам. Люди поощряют как можно больше людей использовать эти инструменты, создавая тем самым меньший пул высококачественных данных для ИИ-компаний.

Однако достаточно ли у компаний данных? Возможно, пока, но чтобы поддерживать модели в актуальном состоянии, разработчикам ИИ придется вводить в свои системы новые данные.

#nightshade

Совет: используйте Nightshade на всем, что вы выкладываете в сеть (не только на своем творчестве), на фотографиях в социальных сетях, на ежедневных снимках, посвященных вашей еде, семье, щенкам и котятам, на случайных селфи и снимках с улицы - и пусть игра начнется.- редактировать балай 🌿 (@eballai) 19 января 2024 года

В Glaze и Nightshade мы наблюдаем зарождающуюся технологическую и этическую битву между создателями и компаниями, занимающимися искусственным интеллектом.

Это становится все интереснее и интереснее, и, возможно, существуют похожие способы обмана и отравления языковых моделей?

В сочетании с судебными тяжбами это может привести к тому, что генеративный ИИ вступит в нестабильный период. Это будет огромный год для технологии.