Сенаторы Ричард Блюменталь (демократы) и Джош Хоули (республиканцы) предложили двухпартийную законодательную базу, которая призывает к более строгому регулированию моделей искусственного интеллекта.

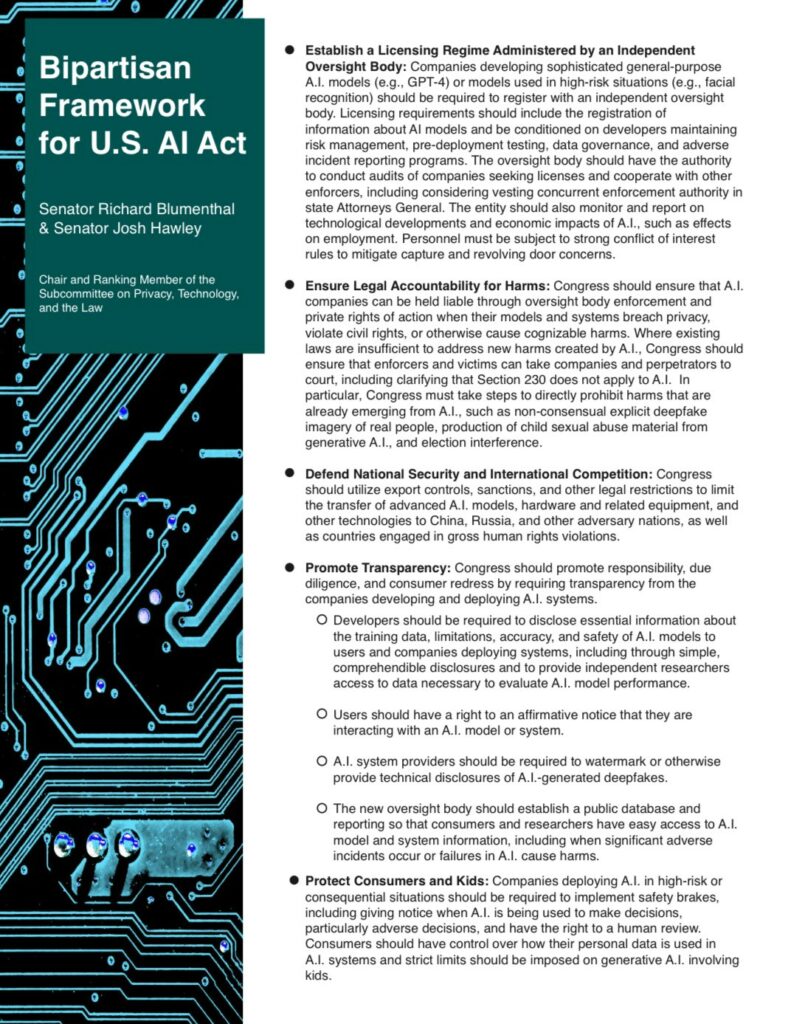

Под их предложениеКомпаниям потребуется государственная лицензия на разработку мощных или рискованных моделей искусственного интеллекта, в том числе используемых для распознавания лиц.

В заявлении, опубликованном на сайте X, приводится точная формулировка: "сложные модели ИИ общего назначения (например, GPT-4) или модели, используемые в ситуациях повышенного риска (например, распознавание лиц)".

Законодательный проект предлагает создать новый федеральный орган или специализированную группу для надзора за технологиями искусственного интеллекта.

Чтобы получить лицензию, компании должны будут тестировать модели ИИ на предмет потенциального вреда перед запуском, раскрывать информацию о любых негативных инцидентах после запуска и разрешать независимые аудиторские проверки третьих сторон.

Белый дом недавно объявила о создании добровольной рамочной программы что потребует от компаний, занимающихся разработкой ИИ на высшем уровне, подвергать свои модели тестированию, "частично проводимому независимыми экспертами".

В этом недавнем двухпартийном документе также предлагается, чтобы компании публично раскрывали обучающие данные, используемые для моделей ИИ, и предполагается, что защита ответственности за технологические нарушения не защитит компании, если они нанесут вред, связанный с ИИ.

В некотором роде это напоминает Закон ЕС об искусственном интеллектеКатегория "высокого риска", в соответствии с которой модели, попадающие под это определение, подвергаются самым строгим формам соответствия и регулирования.

Спорные моменты

У этой концепции есть и свои скептики.

Критики из либертарианской политической группы "Американцы за процветание" и некоммерческой организации Electronic Frontier Foundation, занимающейся защитой цифровых прав, выразили опасения по поводу подавления инноваций и снижения конкурентоспособности.

В ответ на это сенаторы рекомендуют ввести строгие правила, касающиеся конфликта интересов, для сотрудников, контролирующих регулирование ИИ.

Это законодательное предложение появилось в тот момент, когда правительство США усиливает внимание к регулированию ИИ.

На следующей неделе сенаторы Блюменталь и Хоули проведут слушания в подкомитете Сената по вопросам подотчетности ИИ, на которых выступят президент Microsoft Брэд Смит и главный научный сотрудник Nvidia Уильям Дэлли.

В США разгорается интерес к регулированию ИИ. Сенатор Чак Шумер проводит серию недавно объявленных "Форумов по изучению ИИ", чтобы обсудить регулирование искусственного интеллектаОн называет это "одной из самых сложных задач, за которые мы когда-либо брались".

Первый форум установлен на состоится 13 сентября В проекте участвуют Элон Маск, генеральный директор Nvidia Дженсен Хуанг, генеральный директор Meta Марк Цукерберг, генеральный директор OpenAI Сэм Альтман и многие другие.

Более широкие последствия

Предложение Блюменталя и Хоули свидетельствует о готовности Конгресса применить более строгий подход к регулированию ИИ, чем существующие добровольные рамки.

Белый дом также сигнализирует о необходимости ужесточения регулирования: специальный советник по вопросам ИИ Бен Бьюкенен заявил, что для обеспечения безопасности общества от вреда ИИ "потребуется законодательство".

После предстоящих переговоров с Шумером сенаторы Блюменталь и Хоули ускоряют дебаты по этике и регулированию ИИ, создавая условия для того, что может стать критическим периодом в управлении ИИ.