Экспоненциальный рост систем искусственного интеллекта опережает темпы исследований и регулирования, в результате чего правительства оказываются в затруднительном положении, пытаясь найти баланс между преимуществами и рисками.

На разработку законов и придание им юридической силы уходят годы. ИИ развивается еженедельно.

Именно такая дихотомия стоит перед лидерами и политиками в области ИИ, поскольку первый значимый нормативный акт в области ИИ на Западе - Закон ЕС об ИИ - будет принят в 2026 году. Еще год назад о ChatGPT только шептались.

31 мая в Лулео (Швеция) состоялась встреча высших должностных лиц США и ЕС в рамках Совета по торговле и технологиям США-ЕС (TTC). Маргрете Вестагер, европейский комиссар по цифровым технологиям, которая за неделю до этого встречалась с генеральным директором Google Сундаром Пичаи, чтобы обсудить потенциальный "Пакт об искусственном интеллекте", сказала: "Демократия должна показать, что мы так же быстры, как и технологии".

Официальные лица признают, что между темпами развития технологий и темпами законотворчества существует огромный разрыв. Говоря о генеративном ИИ, таком как ChatGPT, Джина Раймондо, министр торговли США, сказала: "Он развивается такими темпами, как никакая другая технология".

Чего же удалось добиться на заседании ТТС?

Водяные знаки, внешний аудит, петли обратной связи - лишь некоторые из идей, обсуждавшихся с @AnthropicAI и @sama @OpenAI для #AI #C CodeOfConduct Сегодня на выставке #TTC в #Luleå @SecRaimondo С нетерпением ждем обсуждения с международными партнерами. pic.twitter.com/wV08KDNs3h

- Маргрете Вестагер (@vestager) 31 мая 2023 года

В первую очередь участники обсудили необязательные или добровольные рамки, касающиеся рисков и прозрачности, которые будут представлены G7 осенью.

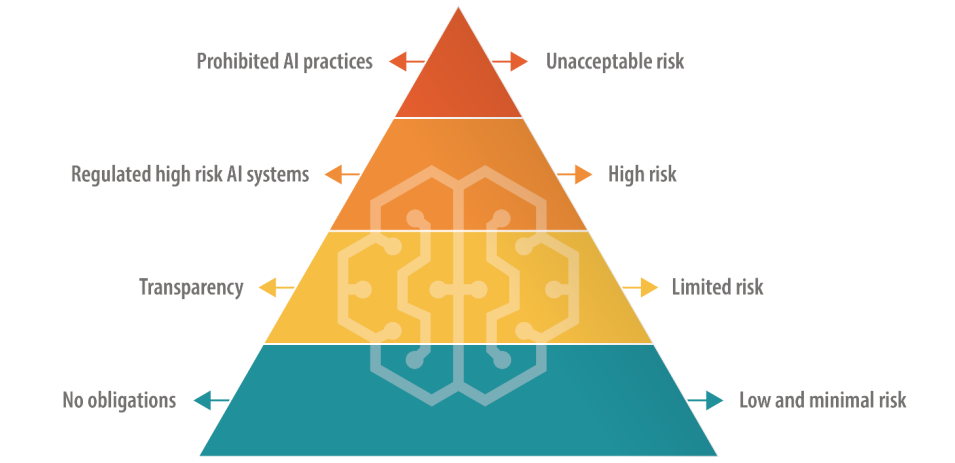

ЕС, который имеет прямой подход к цифровому законодательству, выбирает многоуровневый подход к регулированию ИИ, где ИИ сортируются по категориям в зависимости от степени риска.

Это включает в себя запрещенный уровень "неприемлемого риска" и уровень "высокого риска", который, как опасаются технологические боссы вроде генерального директора OpenAI Сэма Альтмана, поставит под угрозу функциональность их продуктов.

США не предлагают таких окончательных правил, предпочтение добровольным правилам.

Потребуется еще много встреч между ЕС, США и крупными технологиями, чтобы согласовать взгляды с реальными практическими действиями.

Сработают ли добровольные правила искусственного интеллекта?

Существует множество примеров добровольных правил В других секторах и отраслях, таких как добровольные системы безопасности данных и раскрытия информации ESG, но ни одна из них не находится так близко к передовой, как добровольная система управления ИИ.

В конце концов, мы имеем дело с угрозой вымирания, считают ведущие технологические лидеры и ученые, подписавшие Заявление Центра безопасности ИИ о рисках ИИ на этой неделе.

Крупные компании, такие как OpenAI и Google, уже имеют центральные отделы, занимающиеся вопросами управления и внутреннего соответствия, поэтому приведение их продуктов и сервисов в соответствие с добровольными рамочными программами может быть просто вопросом переписывания внутренних документов.

Добровольные правила - это лучше, чем ничего, но, поскольку на столе лежит множество предложений, политикам и руководителям ИИ рано или поздно придется выбирать, с чем работать.