I ricercatori di Stanford e Google DeepMind hanno creato un'intelligenza artificiale in grado di replicare le personalità umane con una precisione sorprendente dopo appena due ore di conversazione.

Intervistando 1.052 persone di diversa provenienza, hanno costruito quelli che chiamano "agenti di simulazione": copie digitali che si sono rivelate spaventosamente efficaci nel prevedere le convinzioni, gli atteggiamenti e i comportamenti delle loro controparti umane.

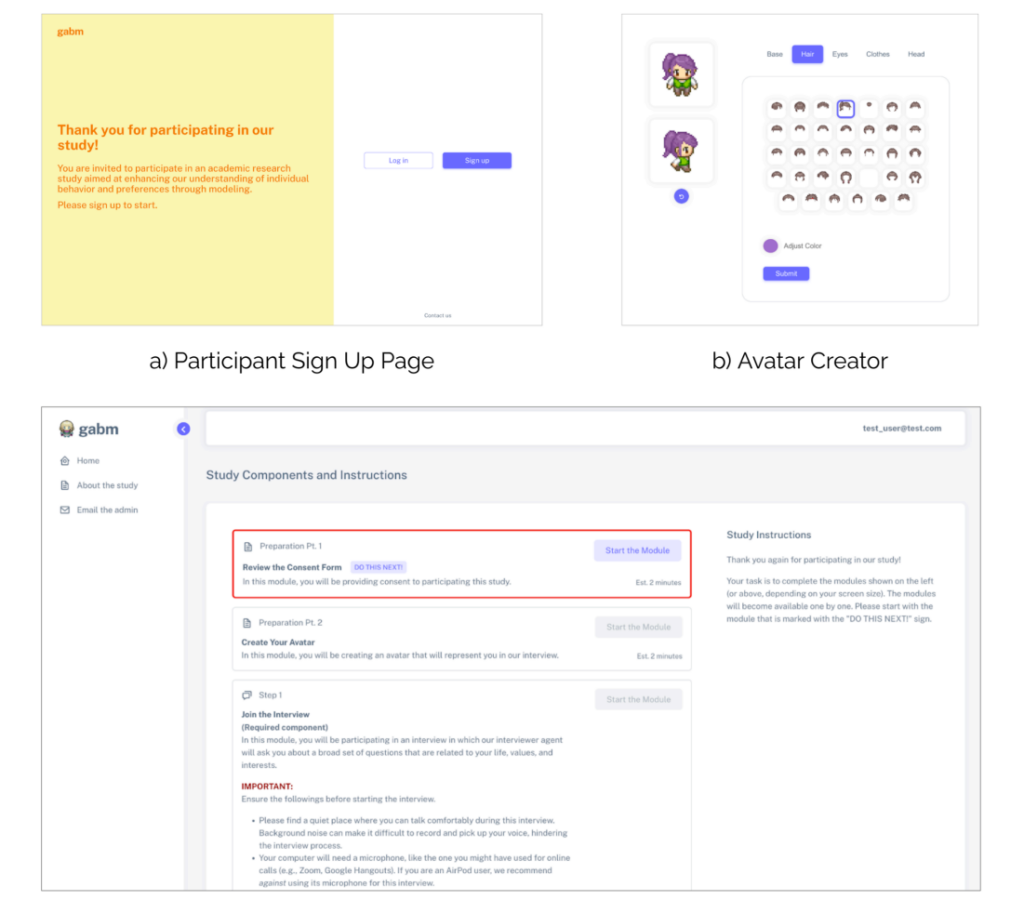

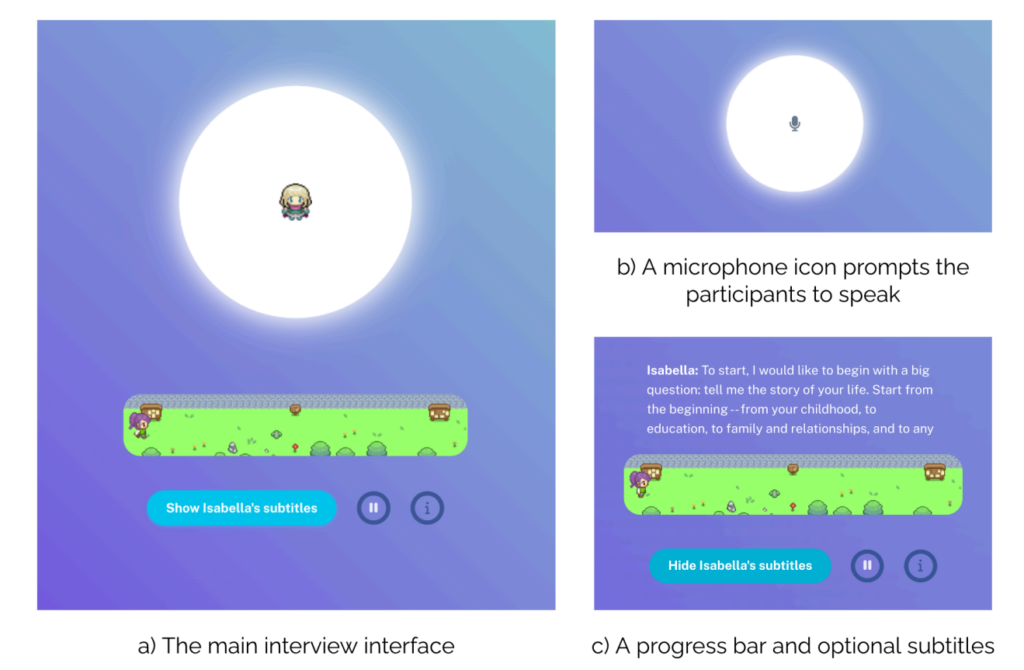

Per creare le copie digitali, il team utilizza i dati di un "intervistatore AI" progettato per coinvolgere i partecipanti in una conversazione naturale.

L'intervistatore IA pone domande e genera domande di follow-up personalizzate - in media 82 per sessione - esplorando qualsiasi cosa, dai ricordi d'infanzia alle opinioni politiche.

Attraverso queste discussioni di due ore, ogni partecipante ha generato trascrizioni dettagliate con una media di 6.500 parole.

Ad esempio, quando un partecipante menziona la sua città d'infanzia, l'intelligenza artificiale potrebbe indagare più a fondo, chiedendo di raccontare ricordi o esperienze specifiche. Simulando il flusso naturale di una conversazione, il sistema cattura informazioni personali sfumate che i sondaggi standard tendono a ignorare.

Dietro le quinte, il studio documenta quella che i ricercatori chiamano "riflessione esperta", chiedendo ai modelli linguistici di grandi dimensioni (LLM) di analizzare ogni conversazione da quattro punti di vista professionali distinti:

- Come uno psicologo, identifica tratti specifici della personalità e modelli emotivi, ad esempio notando come una persona apprezzi l'indipendenza in base alle sue descrizioni delle relazioni familiari.

- Attraverso la lente di un economista comportamentale, estrae informazioni sul processo decisionale finanziario e sulla tolleranza al rischio, come ad esempio l'approccio al risparmio o le scelte di carriera.

- Il punto di vista dello scienziato politico mappa le inclinazioni ideologiche e le preferenze politiche su vari temi.

- Un'analisi demografica rileva i fattori socioeconomici e le circostanze di vita.

I ricercatori hanno concluso che questa tecnica basata sulle interviste ha superato di gran lunga metodi analoghi, come l'estrazione dei dati dai social media.

Prova delle copie digitali

Quanto erano valide le copie dell'IA? I ricercatori le hanno sottoposte a una serie di test per scoprirlo.

In primo luogo, hanno utilizzato il General Social Survey, una misura degli atteggiamenti sociali che pone domande su tutto, dalle opinioni politiche alle credenze religiose. In questo caso, le copie dell'intelligenza artificiale hanno risposto alle loro controparti umane per l'85% delle volte.

Nel test di personalità Big Five, che misura tratti come l'apertura e la coscienziosità attraverso 44 domande diverse, le previsioni dell'intelligenza artificiale si sono allineate con le risposte umane circa 80% delle volte. Il sistema è stato eccellente nel cogliere tratti come l'estroversione e il nevroticismo.

I test sui giochi economici hanno tuttavia rivelato limiti affascinanti. Nel "Gioco del dittatore", in cui i partecipanti decidono come dividere il denaro con gli altri, l'intelligenza artificiale ha faticato a prevedere perfettamente la generosità umana.

Nel "Gioco della fiducia", che mette alla prova la disponibilità a cooperare con gli altri per ottenere un vantaggio reciproco, le copie digitali corrispondevano alle scelte umane solo per circa due terzi del tempo.

Ciò suggerisce che, sebbene l'IA sia in grado di cogliere i nostri valori dichiarati, non può ancora catturare appieno le sfumature del processo decisionale sociale umano (ovviamente).

Esperimenti nel mondo reale

Non solo, i ricercatori hanno anche sottoposto le copie a cinque classici esperimenti di psicologia sociale.

In un esperimento che ha testato come l'intento percepito influisca sulla colpa, sia gli esseri umani che le loro copie AI hanno mostrato modelli simili di attribuzione di maggiore colpa quando le azioni dannose sembravano intenzionali.

Un altro esperimento ha esaminato il modo in cui l'equità influenza le reazioni emotive, con copie dell'IA che hanno previsto con precisione le reazioni umane a un trattamento equo rispetto a uno ingiusto.

Le repliche dell'intelligenza artificiale hanno riprodotto con successo il comportamento umano in quattro esperimenti su cinque, suggerendo che possono modellare non solo singole risposte topiche ma anche modelli comportamentali ampi e complessi.

Cloni di IA facili: Quali sono le implicazioni?

AI systems that ‘clone’ human views and behaviors are big business, with Meta ha recentemente annunciato l'intenzione di riempire Facebook e Instagram con profili AI che possono creare contenuti e coinvolgere gli utenti.

Anche TikTok si è buttato nella mischia con la sua nuova suite "Symphony" di strumenti creativi basati sull'intelligenza artificiale, che comprende avatar digitali che possono essere utilizzati da marchi e creatori per produrre contenuti localizzati su scala.

Con Avatar digitali SymphonyTikTok permette ai creatori idonei di costruire avatar che rappresentano persone reali, completi di un'ampia gamma di gesti, espressioni, età, nazionalità e lingue.

La ricerca di Stanford e DeepMind suggerisce che tali repliche digitali diventeranno molto più sofisticate e più facili da costruire e distribuire su scala.

"Se si può avere un gruppo di piccoli 'voi' che vanno in giro e prendono effettivamente le decisioni che avreste preso voi, questo, credo, è in definitiva il futuro", descrive il ricercatore principale Joon Sung Park, dottorando in informatica a Stanford. MIT.

Park descrive i lati positivi di questa tecnologia, in quanto la costruzione di cloni accurati potrebbe supportare la ricerca scientifica.

Invece di condurre esperimenti costosi o eticamente discutibili su persone reali, i ricercatori potrebbero testare come le popolazioni potrebbero rispondere a determinati input. Ad esempio, potrebbe aiutare a prevedere le reazioni ai messaggi di salute pubblica o a studiare come le comunità si adattano ai grandi cambiamenti della società.

In definitiva, però, le stesse caratteristiche che rendono queste repliche dell'IA preziose per la ricerca le rendono anche potenti strumenti di inganno.

Man mano che le copie digitali diventano più convincenti, distinguere l'autentica interazione umana dall'IA è diventato difficile, come abbiamo osservato da un'ondata di falsi profondi.

E se questa tecnologia fosse usata per clonare qualcuno contro la sua volontà? Quali sono le implicazioni della creazione di copie digitali modellate su persone reali?

Il team di ricerca di Stanford e DeepMind riconosce questi rischi. La loro struttura richiede un chiaro consenso da parte dei partecipanti e consente loro di ritirare i propri dati, trattando la replica della personalità con gli stessi problemi di privacy delle informazioni mediche sensibili.

Questo fornisce almeno una certa protezione teorica contro le forme di abuso più dannose. Ma, in In ogni caso, ci stiamo addentrando nei territori inesplorati dell'interazione uomo-macchina e le implicazioni a lungo termine restano in gran parte sconosciute.