Un nuovo studio dimostra che, mentre gli esseri umani faticano a distinguere le voci umane da quelle dell'intelligenza artificiale, i nostri cervelli rispondono in modo diverso quando le sentono.

Come AI clonazione vocale diventa più avanzata, solleva problemi etici e di sicurezza a cui gli esseri umani non erano esposti prima.

La voce all'altro capo della telefonata appartiene a un essere umano o è stata generata dall'intelligenza artificiale? Pensi che saresti in grado di capirlo?

I ricercatori del Dipartimento di Psicologia dell'Università di Oslo hanno testato 43 persone per verificare se fossero in grado di distinguere le voci umane da quelle generate dall'intelligenza artificiale.

I partecipanti si sono dimostrati ugualmente pessimi nell'identificare correttamente le voci umane (accuratezza di 56%) e quelle generate dall'intelligenza artificiale (accuratezza di 50,5%).

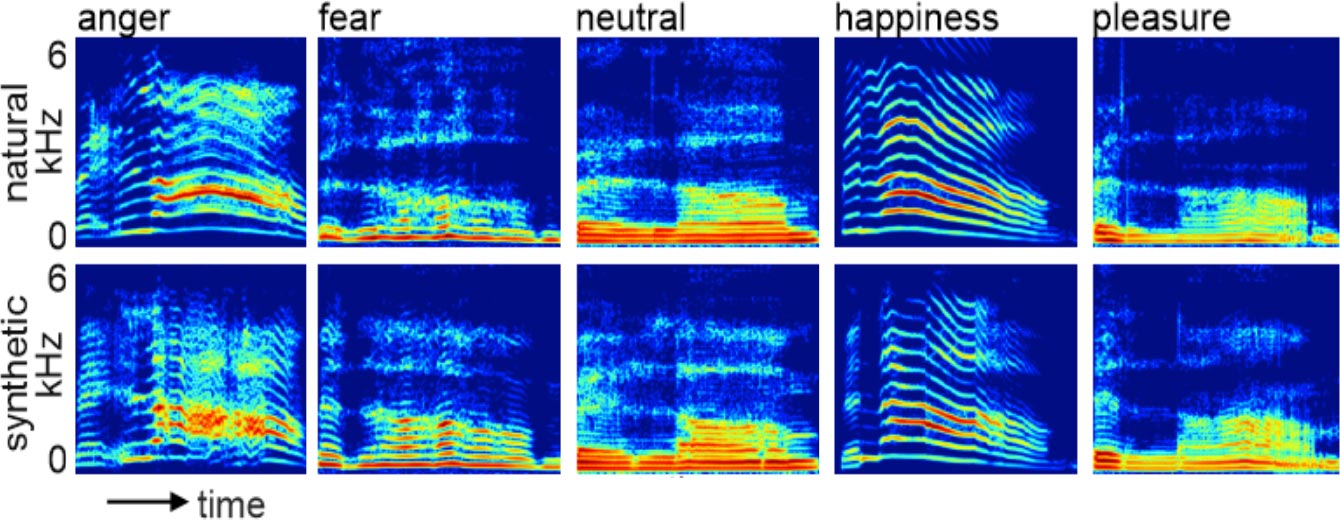

L'emozione della voce ha influito sulla probabilità di identificarla correttamente. Le voci neutre dell'intelligenza artificiale sono state identificate con un'accuratezza di 74,9% rispetto all'accuratezza di 23% delle voci umane neutre.

Le voci umane felici sono state identificate correttamente per 77% del tempo, mentre le voci AI felici sono state identificate con una precisione piuttosto bassa, pari a 34,5%.

Quindi, se sentiamo una voce generata dall'intelligenza artificiale che sembra felice, siamo più propensi a pensare che sia umana.

Anche se consapevolmente facciamo fatica a identificare correttamente una voce AI, il nostro cervello sembra cogliere le differenze a livello subconscio.

I ricercatori hanno eseguito scansioni fMRI del cervello dei partecipanti mentre ascoltavano le diverse voci. Le scansioni hanno rivelato differenze significative nell'attività cerebrale in risposta alle voci IA e umane.

I ricercatori hanno osservato che "le voci AI hanno attivato la corteccia mediana anteriore destra, la corteccia prefrontale dorsolaterale destra e il talamo sinistro, il che potrebbe indicare una maggiore vigilanza e regolazione cognitiva.

"Al contrario, le voci umane hanno suscitato risposte più forti nell'ippocampo destro e nelle regioni associate all'elaborazione emotiva e all'empatia, come il giro frontale inferiore destro, la corteccia cingolata anteriore e il giro angolare".

Per noi potrebbe essere difficile capire se una voce è generata dall'intelligenza artificiale o umana, ma il nostro cervello sembra in grado di distinguere. Risponde con una maggiore attenzione alle voci dell'intelligenza artificiale e con un senso di parentela quando ascolta una voce umana.

I partecipanti hanno valutato le voci umane come più naturali, affidabili e autentiche, soprattutto le voci felici e le espressioni di piacere.

La ricercatrice Christine Skjegstad, che ha condotto lo studio insieme al professor Sascha Frühholz, ha dichiarato: "Sappiamo già che le voci generate dall'intelligenza artificiale sono diventate così avanzate da essere quasi indistinguibili dalle voci umane reali.

"Oggi è possibile clonare la voce di una persona a partire da pochi secondi di registrazione e i truffatori hanno utilizzato questa tecnologia per imitare una persona cara in difficoltà e indurre le vittime a trasferire denaro.

"Mentre gli esperti di apprendimento automatico hanno sviluppato soluzioni tecnologiche per rilevare le voci dell'intelligenza artificiale, si sa molto meno sulla risposta del cervello umano a queste voci".

Questa ricerca indica che il nostro cervello percepisce qualcosa che non va quando elabora una voce sintetica e diventa più cauto.

Potremmo aver bisogno di un aiuto maggiore di questo, dato che le voci generate dall'intelligenza artificiale diventano più "umane".