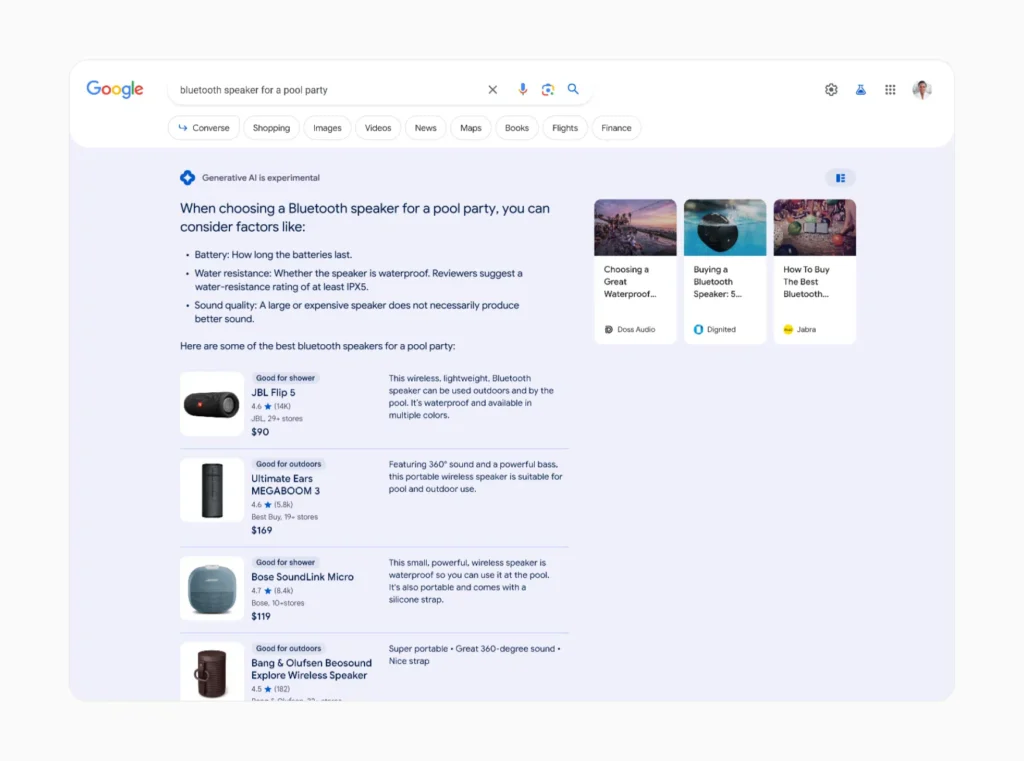

L'ultima conferenza I/O di Google ha visto l'azienda raddoppiare la sua Search Generative Experience (SGE), che incorporerà l'intelligenza artificiale generativa in Google Search.

SGE, che mira a portare risposte generate dall'intelligenza artificiale a oltre un miliardo di utenti entro la fine del 2024, si basa su Gemini, la famiglia di modelli linguistici di grandi dimensioni (LLM) di Google, per generare risposte simili a quelle umane alle query di ricerca.

Invece di una ricerca tradizionale su Google, che mostra principalmente i link, vi verrà presentato un riepilogo generato dall'intelligenza artificiale insieme ad altri risultati.

Questa "panoramica sull'intelligenza artificiale" è stata criticata perché fornire informazioni senza sensoe Google sta rapidamente lavorando a soluzioni prima di iniziare il rollout di massa.

Ma oltre a consigliare di aggiungere la colla alla pizza e a dire che i pitoni sono mammiferi, c'è un altro problema nella nuova strategia di ricerca guidata dall'intelligenza artificiale di Google: la sua impronta ambientale.

Perché l'SGE è ad alta intensità di risorse

Mentre i motori di ricerca tradizionali si limitano a recuperare le informazioni esistenti su Internet, i sistemi di intelligenza artificiale generativa come SGE devono creare contenuti completamente nuovi per ogni interrogazione.

Questo processo richiede una potenza di calcolo e un'energia molto maggiori rispetto ai metodi di ricerca convenzionali.

Si stima che ogni giorno vengano effettuate da 3 a 10 miliardi di ricerche su Google. L'impatto dell'applicazione dell'intelligenza artificiale anche a una piccola percentuale di queste ricerche potrebbe essere incredibile.

Sasha Luccioni, ricercatore dell'azienda di AI Hugging Face che studia l'impatto ambientale di queste tecnologie, ha recentemente discusso del forte aumento del consumo energetico che le SGE potrebbero innescare.

Luccioni e il suo team stimano che la generazione di informazioni di ricerca con l'IA potrebbe richiedere 30 volte più energia di una ricerca convenzionale.

"È logico, no? Mentre una banale query di ricerca trova dati esistenti su Internet, le applicazioni come AI Overviews devono creare informazioni completamente nuove". ha dichiarato a Scientific American.

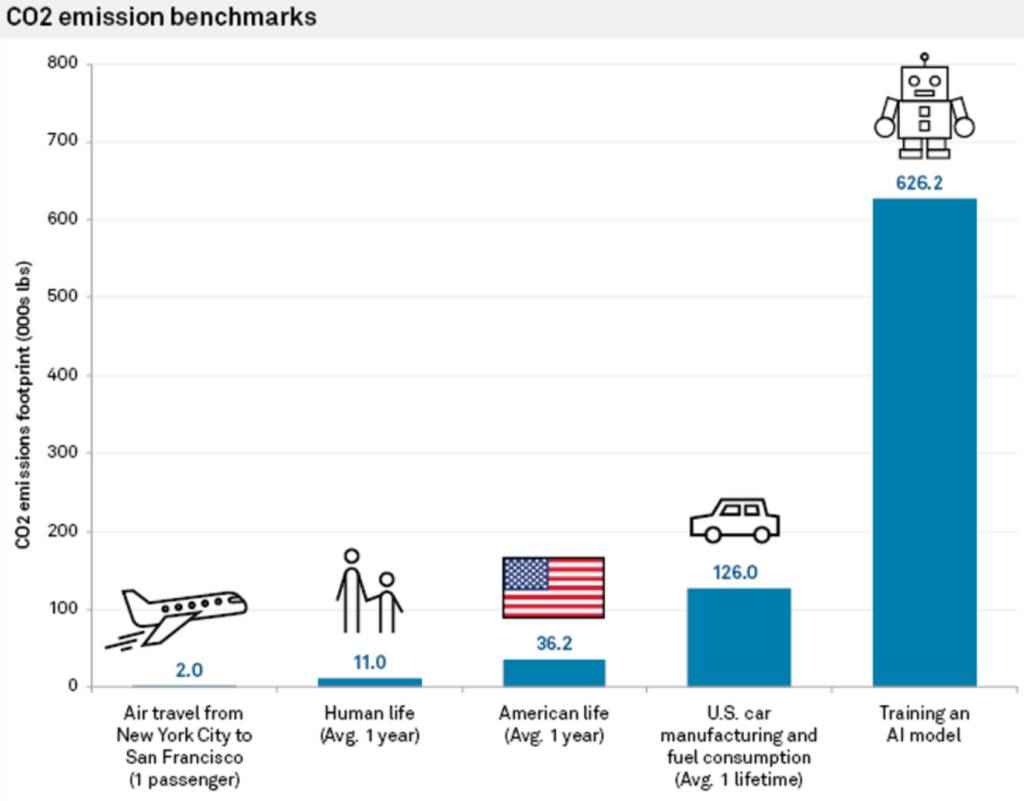

Nel 2023, Luccioni e i suoi colleghi hanno scoperto che l'addestramento del LLM BLOOM emetteva gas a effetto serra equivalenti a 19 chilogrammi di CO2 per giorno di utilizzo, ovvero la quantità generata dalla guida di 49 miglia con un'auto media a gas. Hanno anche scoperto che la generazione di due sole immagini utilizzando l'intelligenza artificiale può consumare tanta energia quanto la ricarica completa di uno smartphone medio.

Studi precedenti hanno stimato che le emissioni di CO2 associate all'addestramento di un modello di intelligenza artificiale potrebbero superare quelle di centinaia di voli commerciali o di un'automobile media nel corso della sua vita.

In un intervista rilasciata a Reuters lo scorso annoJohn Hennessy, presidente della società madre di Google, Alphabet, ha ammesso lui stesso l'aumento dei costi associati alla ricerca alimentata dall'intelligenza artificiale.

"Uno scambio con un modello linguistico di grandi dimensioni potrebbe costare dieci volte di più di una ricerca tradizionale", ha dichiarato, prevedendo però che i costi diminuiranno man mano che i modelli verranno perfezionati.

La ricerca AI mette a dura prova infrastrutture e risorse

Si prevede che i data center che ospitano i server di intelligenza artificiale raddoppieranno il loro consumo energetico entro il 2026, arrivando a consumare potenzialmente tanto quanto potere come un piccolo paese.

Con i produttori di chip come NVIDIA che stanno lanciando chip più grandi e più potenti, potrebbe presto prendere il equivalente a più centrali nucleari per eseguire carichi di lavoro AI su larga scala.

Quando le aziende che si occupano di AI rispondono alle domande su come questo possa essere sostenuto, in genere citano l'aumento dell'efficienza e della capacità delle fonti rinnovabili e la maggiore efficienza energetica dell'hardware dell'AI.

Tuttavia, la transizione verso le fonti di energia rinnovabile per i data center si sta rivelando lenta e complessa.

Come ha spiegato Shaolei Ren, ingegnere informatico dell'Università della California, Riverside, che studia l'IA sostenibile, "c'è uno squilibrio tra domanda e offerta di energia rinnovabile. La natura intermittente della produzione di energia rinnovabile spesso non è all'altezza della potenza costante e stabile richiesta dai data center".

A causa di questo disallineamento, gli impianti a combustibili fossili vengono mantenuti in funzione più a lungo del previsto nelle aree ad alta concentrazione di infrastrutture tecnologiche.

Un'altra soluzione ai problemi energetici è rappresentata dall'hardware AI ad alta efficienza energetica. NVIDIA nuovo chip Blackwell è molte volte più efficiente dal punto di vista energetico rispetto ai suoi predecessori, e altre compagnie come Delta stanno lavorando su un hardware efficiente per i centri dati.

Rama Ramakrishnan, professore della MIT Sloan School of Management, ha spiegato che mentre il numero di ricerche che passano attraverso gli LLM è destinato ad aumentare, il costo per query sembra diminuire man mano che le aziende lavorano per rendere più efficienti hardware e software.

Ma sarà sufficiente a compensare la crescente domanda di energia? "È difficile da prevedere", afferma Ramakrishnan. "La mia ipotesi è che probabilmente aumenterà, ma non in modo drammatico".

Con l'accelerazione della corsa all'intelligenza artificiale, è diventato necessario mitigare l'impatto ambientale. La necessità è la madre dell'invenzione e le aziende tecnologiche sono costrette a creare soluzioni per mantenere lo slancio dell'IA.

Hardware efficiente dal punto di vista energetico, energie rinnovabili e anche l'energia da fusione può aprire la strada a un futuro più sostenibile per l'IA, ma il viaggio è pieno di incertezze.

La SGE potrebbe mettere a dura prova anche le riserve idriche

Possiamo anche ipotizzare le richieste di acqua create dalla SGE, che potrebbero rispecchiare i grandi aumenti del consumo idrico dei data center attribuiti all'industria dell'IA generativa.

Secondo i recenti rapporti ambientali di Microsoft, il consumo di acqua ha è aumentato fino a 50% in alcune regioni, con il consumo idrico del data center di Las Vegas raddoppiato rispetto al 2022. Anche i rapporti di Google hanno registrato un aumento di 20% nella spesa idrica dei data center nel 2023 rispetto al 2022.

Ren attribuisce la maggior parte di questa crescita all'IA, affermando: "È giusto dire che la maggior parte della crescita è dovuta all'IA, compresi i forti investimenti di Microsoft nell'IA generativa e la partnership con OpenAI".

Ren ha stimato che ogni interazione con ChatGPT, composta da 5-50 messaggi, consuma ben 500 ml di acqua.

In un carta pubblicato nel 2023, il team di Ren ha scritto: "La domanda globale di intelligenza artificiale potrebbe essere responsabile di 4,2-6,6 miliardi di metri cubi di prelievo d'acqua nel 2027, una cifra superiore al prelievo annuale totale di 4-6 Danimarca o della metà del Regno Unito".

Utilizzando la ricerca di Ren, possiamo fare alcuni calcoli su come l'SGE di Google potrebbe influire su queste previsioni.

Supponiamo che Google elabori una media di 8,5 miliardi di ricerche giornaliere in tutto il mondo. Supponendo che anche solo una frazione di queste ricerche, ad esempio 10%, utilizzi l'SGE e generi risposte basate sull'intelligenza artificiale con una media di 50 parole per risposta, il consumo di acqua potrebbe essere fenomenale.

Utilizzando la stima di Ren di 500 millilitri di acqua per ogni 5-50 richieste (ad esempio, una singola sessione su Google SGE), possiamo calcolare approssimativamente che 850 milioni di ricerche alimentate da SGE (10% delle ricerche giornaliere di Google) consumerebbero circa 425 milioni di litri di acqua al giorno.

Questo equivale alla funzione giornaliero consumo idrico di una città con una popolazione di oltre 2,5 milioni di abitanti.

In realtà, il consumo effettivo di acqua può variare in base a fattori quali l'efficienza dei data center di Google e l'implementazione specifica e la scala dell'SGE.

Tuttavia, è molto ragionevole ipotizzare che l'SGE e altre forme di ricerca dell'IA aumenteranno ulteriormente l'utilizzo delle risorse dell'IA.

Le esperienze globali di intelligenza artificiale come SGE saranno sostenibili su vasta scala? I fattori in gioco sono numerosi, ma non sarà una passeggiata.