La corsa all'hardware AI più potente ed efficiente ha avuto un'impennata questa settimana con l'annuncio da parte di Intel e Google di nuovi chip che li aiuteranno a diventare meno dipendenti dalla tecnologia NVIDIA.

Sembra che ogni settimana vengano rilasciati nuovi modelli di intelligenza artificiale. Dietro ogni rilascio ci sono settimane di addestramento su data center di cloud computing, la maggior parte dei quali è alimentata da GPU NVIDIA.

Intel e Google hanno annunciato nuovi chip AI in-house in grado di addestrare e distribuire modelli AI di grandi dimensioni in modo più rapido e con un consumo energetico inferiore.

Il chip acceleratore di intelligenza artificiale Gaudi 3 di Intel

Intel è probabilmente più conosciuta per i chip che alimentano i vostri PC, ma martedì l'azienda annunciato il suo nuovo chip AI chiamato Gaudi 3.

H100 di NVIDIA Le GPU hanno costituito la maggior parte dei data center AI, ma Intel afferma che Gaudi 3 offre "50% di inferenza mediamente migliore e 40% di efficienza energetica mediamente migliore rispetto a Nvidia H100 - a una frazione del costo".

Un importante contributo all'efficienza energetica di Gaudi 3 è dato dal fatto che Intel ha utilizzato il processo a 5 nm di Taiwan Semiconductor Manufacturing Co per realizzare i chip.

Intel non ha fornito informazioni sui prezzi, ma quando gli è stato chiesto come si confronta con i prodotti di NVIDIA, Das Kamhout, vicepresidente del software Xeon di Intel, ha dichiarato: "Ci aspettiamo che sia altamente competitivo".

Dell Technologies, Hewlett Packard Enterprise, Lenovo e Supermicro saranno i primi a implementare Gaudi 3 nei loro data center AI.

Pat Gelsinger, CEO di Intel, ha riassunto le ambizioni dell'azienda in materia di IA affermando che "Intel sta portando l'IA ovunque nell'azienda, dal PC al data center fino all'edge".

Il #IntelGaudi 3 #AI offre un'alternativa altamente competitiva all'H100 di NVIDIA con prestazioni più elevate, maggiore scalabilità e integrazione di PyTorch. Esplorate altri vantaggi chiave del prodotto. https://t.co/sXdQKjYFw0 pic.twitter.com/iJSndBQkvT

- Intel AI (@IntelAI) 9 aprile 2024

Gli aggiornamenti del braccio e del TPU di Google

Martedì scorso Google ha annunciato la sua prima versione personalizzata CPU basate su Arm che intende utilizzare per alimentare i propri data center. Il nuovo chip, denominato Axion, è un concorrente diretto delle CPU di Intel e AMD.

Google sostiene che Axion offre "30% di prestazioni migliori rispetto alle più veloci istanze generiche basate su Arm oggi disponibili nel cloud, fino a 50% di prestazioni migliori e fino a 60% di efficienza energetica migliore rispetto a istanze comparabili basate su x86 di attuale generazione".

Google ha spostato molti dei suoi servizi, come YouTube e Google Earth, sui suoi server di attuale generazione basati su Arm, che saranno presto aggiornati con i chip Axion.

La presenza di una potente opzione basata su Arm rende più facile per i clienti migrare le loro applicazioni di formazione, inferenza e altre applicazioni AI basate su CPU alla piattaforma cloud di Google senza doverle riprogettare.

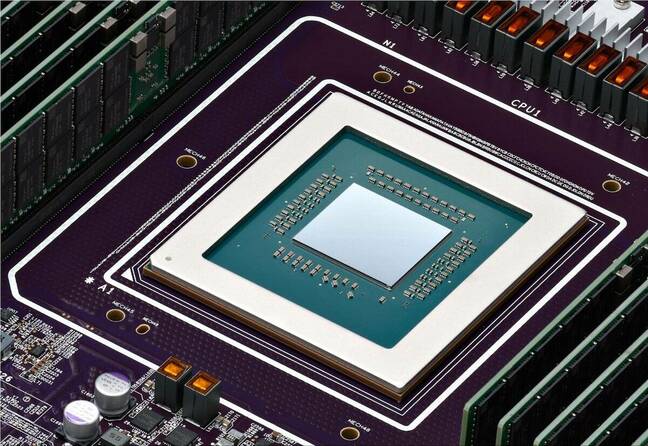

Per l'addestramento di modelli su larga scala, Google si è affidata in larga misura ai suoi chip TPU come alternativa all'hardware di NVIDIA. Anche questi saranno aggiornati con una nuova TPU v5p che contiene più del doppio del numero di chip dell'attuale TPU v4.

TPU v5p, la nostra TPU più potente e scalabile, è ora generalmente disponibile! #GoogleCloudNext pic.twitter.com/mmfWlzHeqs

- Google Cloud Tech (@GoogleCloudTech) 9 aprile 2024

Google non sta cercando di vendere i suoi nuovi chip Arm o le TPU. L'azienda sta cercando di promuovere i suoi servizi di cloud computing piuttosto che diventare un diretto concorrente hardware di NVIDIA.

Le TPU aggiornate daranno una spinta al sistema di Google. Ipercomputer AI che consente l'addestramento di modelli AI su larga scala. L'Hypercomputer AI utilizza anche GPU NVIDIA H100 che, secondo Google, saranno presto sostituite con le nuove GPU NVIDIA H100. GPU Blackwell.

La domanda di chip per l'intelligenza artificiale non è destinata a rallentare a breve, e la corsa di NVIDIA non sembra più una corsa a senso unico rispetto al passato.