Google ha giocato un'altra carta con Gemini 1.5 Pro, un modello che si basa sui risultati ottenuti dal suo predecessore, Gemini 1.0.

Con Google Bard morto e sepolto, la famiglia Gemini sembra moltiplicarsi più velocemente di quanto la comunità dell'intelligenza artificiale possa fare.

Ora arriva Gemini 1.5 Pro, più efficiente del precedente modello di punta di Google, Gemini Ultra.

In effetti, Gemini 1.5 Pro è superiore a Ultra in una manciata di test di benchmark, ma avremo bisogno di ulteriori informazioni per un confronto completo.

Gemini 1.5 Pro offre una nuova architettura Mixture-of-Experts (MoE) e supera Gemini Pro (ora chiamato Gemini 1.0 Pro) in 87% di benchmark.

È disponibile attraverso la nuova piattaforma AI a pagamento di Google, denominata Google One AI Premium, che sostituisce Gemini Pro nonostante Google abbia solo aggiornamento di un paio di settimane fa.

Quindi, qual è lo scopo di un modello che batte il 1.0 Pro ma è simile all'Ultra?

Oltre a una maggiore efficienza di calcolo rispetto a Ultra e a prestazioni superiori in alcune aree, la caratteristica principale di Gemini 1.5 Pro è il suo Finestra contestuale da 128.000 token, espandibile fino a 1 milione di token. Questo batte GPT-4 Turbo a 128.000 e Claude 2.1 a 200.000.

Per contestualizzare una finestra da 1 milione, si tratta in linea di massima di 700.000 parole, 11 ore di audio o 1 ora di video.

Ciò consente di elaborare e interpretare serie di dati colossali, compresi interi libri. Tuttavia, Google sottolinea che Gemini 1.5 Pro è ancora un modello multimodale "di medie dimensioni" progettato per essere scalabile e versatile.

Gemini 1.5 è quindi un GPT-4 killer? Certamente not nelle prestazioni di forza bruta, ma dovrebbe superarlo per compiti specifici con quantità molto elevate di informazioni, come Google ha voluto dimostrare.

Applicazioni e capacità di Gemini

Come i suoi predecessori, le capacità di Gemini 1.5 Pro si estendono a più modalità, dal testo al video e all'audio.

La finestra di contesto estesa consente al modello di elaborare e ragionare su grandi quantità di informazioni, come lunghi documenti, estese basi di codice o ore di contenuti video.

In una demo di Google, Gemini 1.5 Pro è in grado di comprendere e identificare i dettagli delle 402 pagine di trascrizioni della missione dell'Apollo 11 sulla Luna.

Un'altra sfida consisteva nell'individuare scene specifiche di "Sherlock Jr." di Buster Keaton utilizzando descrizioni e schizzi, cosa che 1,5 Pro sono riusciti a fare nonostante in alcuni casi ci sia voluto anche un minuto.

In un altro compito, Gemini 1.5 Pro ha dovuto tradurre l'inglese nella complessa lingua guineana, il Kalamang, e viceversa.

Questo è stato particolarmente scoraggiante perché Kalamang non è rappresentata nei dati di addestramento del modello.

Google ha fornito al modello materiale didattico nel suo contesto di input, tra cui circa 500 pagine di grammatica di riferimento, un elenco di parole bilingue (dizionario) con circa 2.000 voci e un insieme di circa 400 frasi parallele.

Questi materiali comprendevano circa 250.000 gettoni, che rientravano nella finestra contestuale estesa del modello.

Con il solo materiale didattico fornito, Gemini 1.5 Pro ha tradotto con successo frasi tra l'inglese e il kalamang. Questo esperimento ha dimostrato la capacità del modello di assorbire e applicare nuove regole linguistiche e vocabolario dal contesto, imparando efficacemente una nuova lingua al volo.

La qualità delle traduzioni prodotte da Gemini 1.5 Pro è stata valutata da esperti umani che hanno confrontato le prestazioni del modello con quelle di un apprendente di lingue umano a cui è stato sottoposto lo stesso insieme di materiali.

Un'altra dimostrazione ha misurato le prestazioni del modello nell'analisi e nella risoluzione di problemi su 100.000 linee di codice.

Spunti dal documento di ricerca di Gemini 1.5 Pro

Google ha pubblicato un documento di ricerca di accompagnamento su Gemini 1.5, intitolato "Gemini 1.5: sbloccare la comprensione multimodale attraverso milioni di token di contesto."

È chiaro che Google intende spingere la finestra contestuale estesa di Gemini 1.5 Pro, che attualmente domina gli altri LLM nella fascia alta del milione di gettoni.

Gemini 1.5 Pro raggiunge un richiamo quasi perfetto su compiti di recupero di contesti lunghi in diverse modalità e stabilisce nuovi standard nell'AQ di documenti lunghi, nell'AQ di video lunghi e nell'ASR di contesti lunghi.

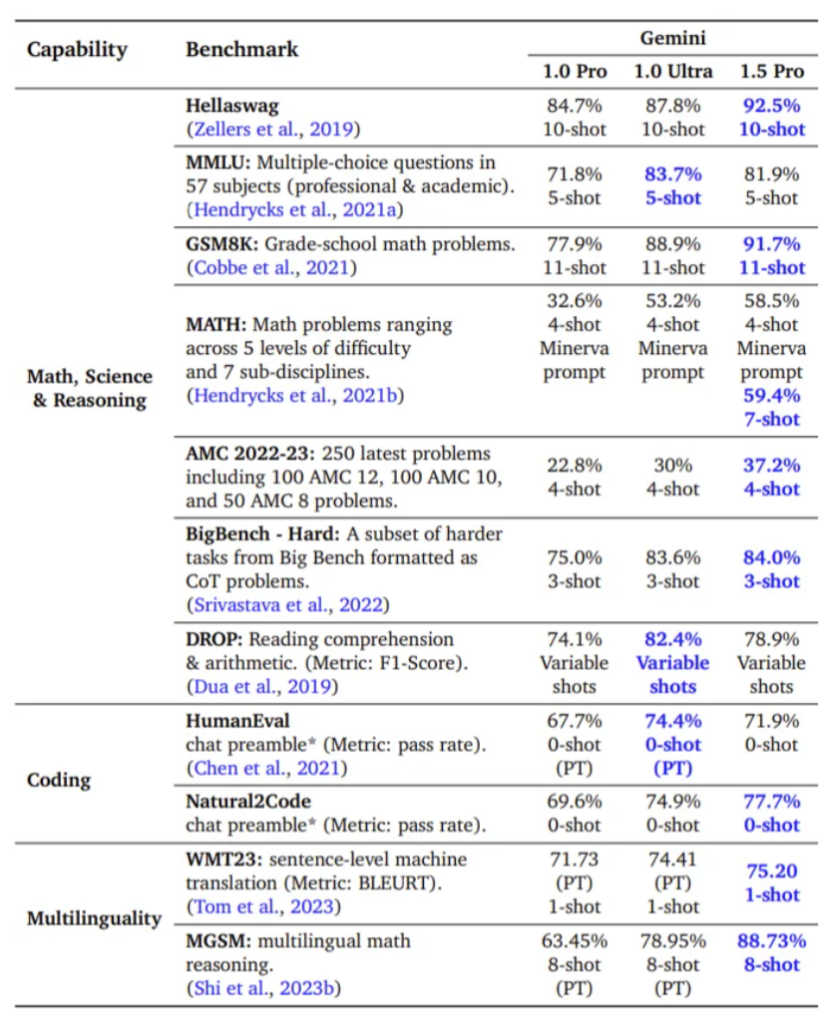

Il documento illustra in dettaglio le prestazioni di Gemini 1.5 Pro in varie funzionalità fondamentali, confrontandole con i modelli Gemini 1.0:

- Miglioramenti del tasso di vincita: Gemini 1.5 Pro mostra una percentuale di vittoria di 87,1% rispetto a Gemini 1.0 Pro e una percentuale di vittoria di 54,8% rispetto a Gemini 1.0 Ultra in diversi benchmark, dimostrando i suoi miglioramenti.

- Prestazioni specifiche dell'area: Nei compiti legati al testo, il modello raggiunge una percentuale di vittoria di 100% contro Gemini 1.0 Pro e di 77% contro Gemini 1.0 Ultra. Nei compiti legati alla visione, le percentuali di vittoria sono 77% e 46% contro Gemini 1.0 Pro e Ultra, rispettivamente. I compiti audio mostrano una percentuale di vittoria di 60% contro Gemini 1.0 Pro e di 20% contro Gemini 1.0 Ultra.

Nel complesso, Gemini 1.5 Pro è una buona Modello GPT-3,5 livelli con una finestra di contesto più lunga rispetto alla concorrenza.

È abbastanza per attirare le persone lontano da ChatGPT? La verità è che, a meno che non abbiate interi libri da analizzare, i vantaggi possono essere scarsi o inesistenti.

Come utilizzare Gemini 1.5 Pro

Gemini 1.5 è attualmente disponibile in anteprima limitata per gli sviluppatori e i clienti aziendali.

Le domande sui prezzi a lungo termine e sull'accessibilità non hanno ancora trovato risposta. Google ha accennato a livelli di prezzo che varieranno in base alle dimensioni della finestra contestuale, dai 128.000 gettoni standard al milione completo.

Il costo esatto non è ancora stato reso noto, facendo nascere speculazioni sul potenziale investimento necessario per sfruttare questa finestra contestuale avanzata.

Alcuni hanno sottolineato che quando Gemini 1.5 Pro sarà disponibile per le masse, la concorrenza si sarà già spostata.

Google si differenzia grazie a un prodotto che solo pochi utenti possono sperimentare. Questo sembra un po' alienante.

La famiglia Gemelli: accessibile o esoterica?

Nell'arco di due o tre mesi circa, Google ha sollevato e ucciso Bard, scambiarlo con Gemini Pro e rilasciando Ultra, Nano e ora Gemini 1.5 Pro.

Ciò ha comportato la ridenominazione di Gemini Pro (che era solo Gemini?) in Gemini 1.0 Pro.

Come risultato di questa spesa per l'intelligenza artificiale, La pagina di destinazione di DeepMind per la famiglia Gemini è francamente contorto e affollato.

OpenAI, per molti versi, ha messo in atto un astuto trucco di marketing mantenendo i suoi modelli sotto l'ombrello "ChatGPT" fin dall'inizio e mantenendo l'accesso più o meno limitato al GPT-3.5 gratuito e al GPT-4 a pagamento per gli utenti che non utilizzano l'API.

Gemini è Google che sta puntando sull'IA generativa, ma potrebbe impantanarsi in un'offerta di prodotti sempre più ambigua.