L'addestramento di modelli di intelligenza artificiale come il GPT-4 si è basato principalmente su set di dati costituiti da testo e immagini. Il dataset di percezione multimodale Ego-Exo4D di Meta offre agli scienziati dei dati un nuovo e ricco set di dati di addestramento.

Si può imparare una nuova abilità leggendo un libro, ma è molto più facile quando qualcuno ti mostra come fare qualcosa e te lo spiega. Questo è l'obiettivo del team FAIR (Fundamental Artificial Intelligence Research) di Meta per Ego-Exo4D.

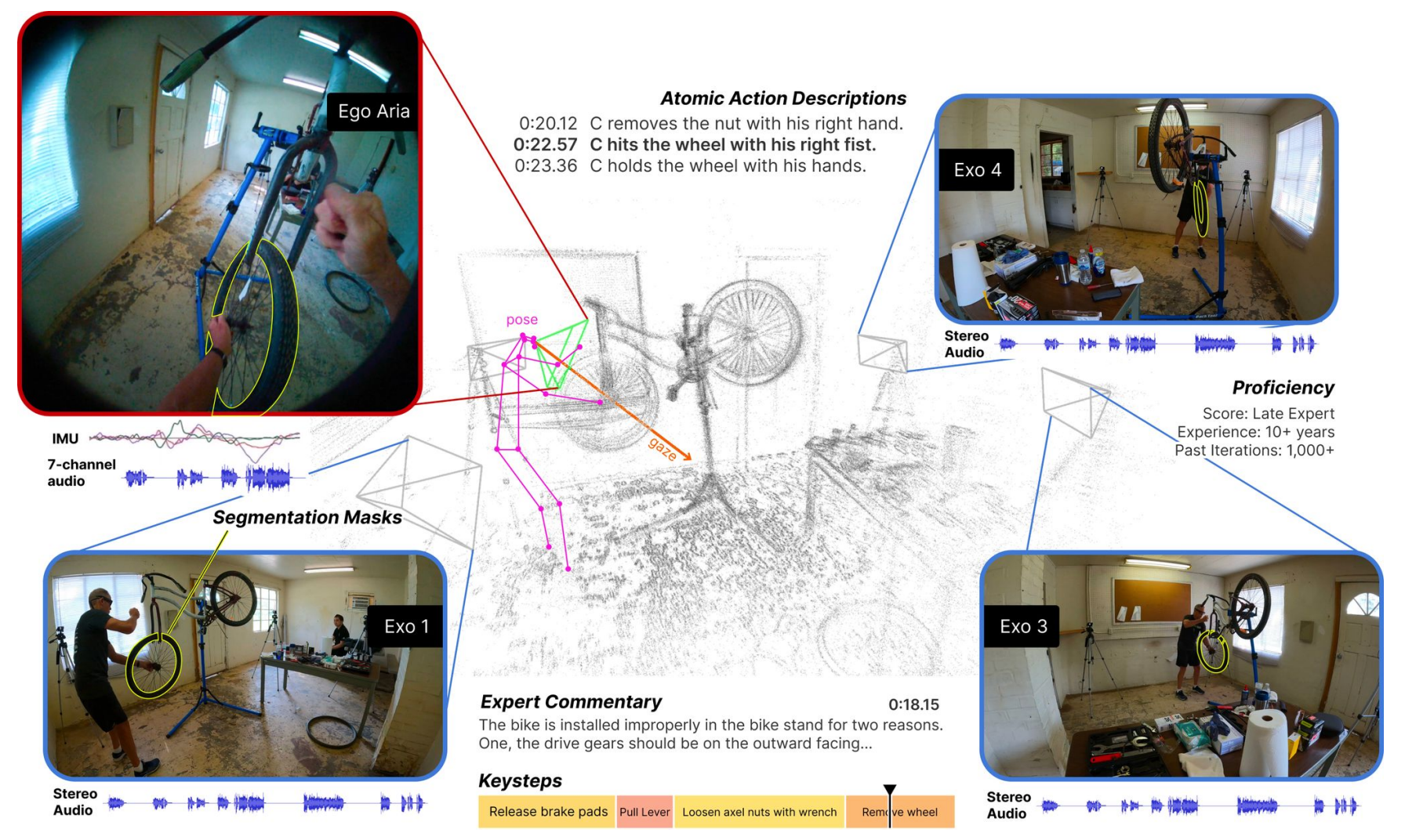

Il set di dati è costituito da video con prospettiva in prima persona (Ego) e in terza persona (Exo) di persone che svolgono diverse attività umane qualificate. Si può trattare di attività come cucinare, ballare, suonare o riparare una bicicletta. I dati sono stati raccolti in 13 città di tutto il mondo da 839 persone che indossavano la telecamera, catturando 1422 ore di video.

I video, girati simultaneamente, sono poi integrati con ulteriori modalità di dati grazie agli occhiali Project Aria di Meta.

Gli occhiali Project Aria sono computer indossabili sotto forma di occhiali. Catturano il video e l'audio di chi li indossa, oltre alle informazioni sul tracciamento degli occhi e sulla posizione. Gli occhiali rilevano anche le pose della testa e le nuvole di punti 3D dell'ambiente.

Il risultato è un insieme di video simultanei di un'attività in corso, con narrazioni in prima persona da parte di chi indossa la telecamera che descrivono le proprie azioni, e il tracciamento della testa e degli occhi della persona che esegue l'attività.

Presentiamo Ego-Exo4D, un set di dati fondamentali e una suite di benchmark incentrati sulle attività umane qualificate per supportare la ricerca sull'apprendimento video e sulla percezione multimodale. Si tratta del più grande dataset pubblico di questo tipo.

Maggiori dettagli ➡️ https://t.co/82OR4msehv pic.twitter.com/NTI1kdj1RN

- AI a Meta (@AIatMeta) 4 dicembre 2023

Meta ha poi aggiunto descrizioni in terza persona delle azioni di chi indossa la telecamera. Meta ha anche ingaggiato esperti in diversi settori per aggiungere commenti di esperti in terza persona che criticassero il modo in cui la persona nel video svolgeva il compito.

Raccogliendo viste egocentriche ed esocentriche, il set di dati Ego-Exo4D può mostrare ai ricercatori come appaiono le attività da diverse prospettive. Questo potrebbe aiutarli a sviluppare algoritmi di visione artificiale in grado di riconoscere ciò che una persona sta facendo da qualsiasi prospettiva.

Ego-Exo4D apre nuove opportunità di apprendimento

Uno degli ostacoli principali alla realizzazione dell'intelligenza artificiale o all'addestramento più efficiente dei robot è la mancanza di percezione sensoriale dei computer. Come esseri umani, abbiamo così tanti input sensoriali dall'ambiente che spesso diamo per scontati quando impariamo nuove abilità.

Ego-Exo4D sarà una risorsa estremamente utile per colmare questo divario.

Gedas Bertasius, professore assistente presso il Dipartimento di Informatica dell'Università del North Carolina, ha dichiarato: "Ego-Exo4D non si limita a raccogliere dati, ma cambia il modo in cui l'IA comprende, percepisce e apprende. Con un apprendimento e una prospettiva incentrati sull'uomo, l'IA può diventare più utile nella nostra vita quotidiana, assistendoci in modi che abbiamo solo immaginato".

Meta spera che Ego-Exo4D "consenta ai robot del futuro di acquisire conoscenze su manipolazioni complesse e destre osservando esperti umani in azione".

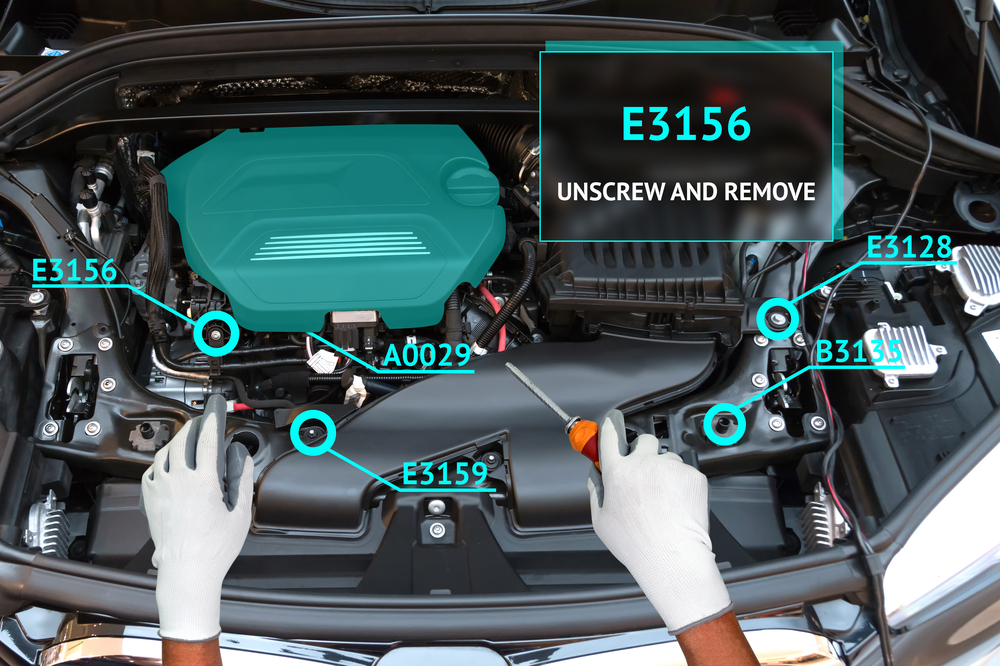

Questo set di dati, combinato con gli occhiali Project Aria, consentirà presto un'esperienza di apprendimento veramente coinvolgente per gli esseri umani. Immaginate di eseguire un compito mentre gli occhiali utilizzano la realtà aumentata (AR) per sovrapporre un video tutorial o per guidarvi durante il compito.

Potreste imparare a suonare il pianoforte e avere un'immagine in sovrimpressione che vi mostra dove le mani devono muoversi, con consigli audio in tempo reale mentre lo fate. Oppure potreste aprire il cofano della vostra auto ed essere guidati nella risoluzione di un problema al motore.

Sarà interessante vedere se Meta Concetto di apprendimento Ego How-To Il progetto Aria sarà adottato meglio di quanto non lo sia stato il prodotto fallito Google Glass. Non si sa ancora quando saranno disponibili per l'acquisto.

Meta renderà il set di dati Ego-Exo4D disponibile per il download prima della fine di dicembre.