Durante la sua visita nel Regno Unito per il Vertice sulla sicurezza dell'IA, il vicepresidente degli Stati Uniti Kamala Harris ha annunciato che 30 Paesi si sono uniti agli Stati Uniti nell'approvare le linee guida proposte per l'uso militare dell'IA.

Annuncio della "Dichiarazione politica sull'uso militare responsabile dell'intelligenza artificiale e dell'autonomia". è stato pubblicato sul sito web del Dipartimento di Stato degli Stati Uniti il 1° novembre e ulteriori dettagli sul quadro normativo sono stati pubblicati il 9 novembre.

Nella sua dichiarazione sul quadro di riferimento, la Harris ha affermato: "Per garantire ordine e stabilità nel mezzo del cambiamento tecnologico globale, credo fermamente che dobbiamo essere guidati da una serie di intese comuni tra le nazioni".

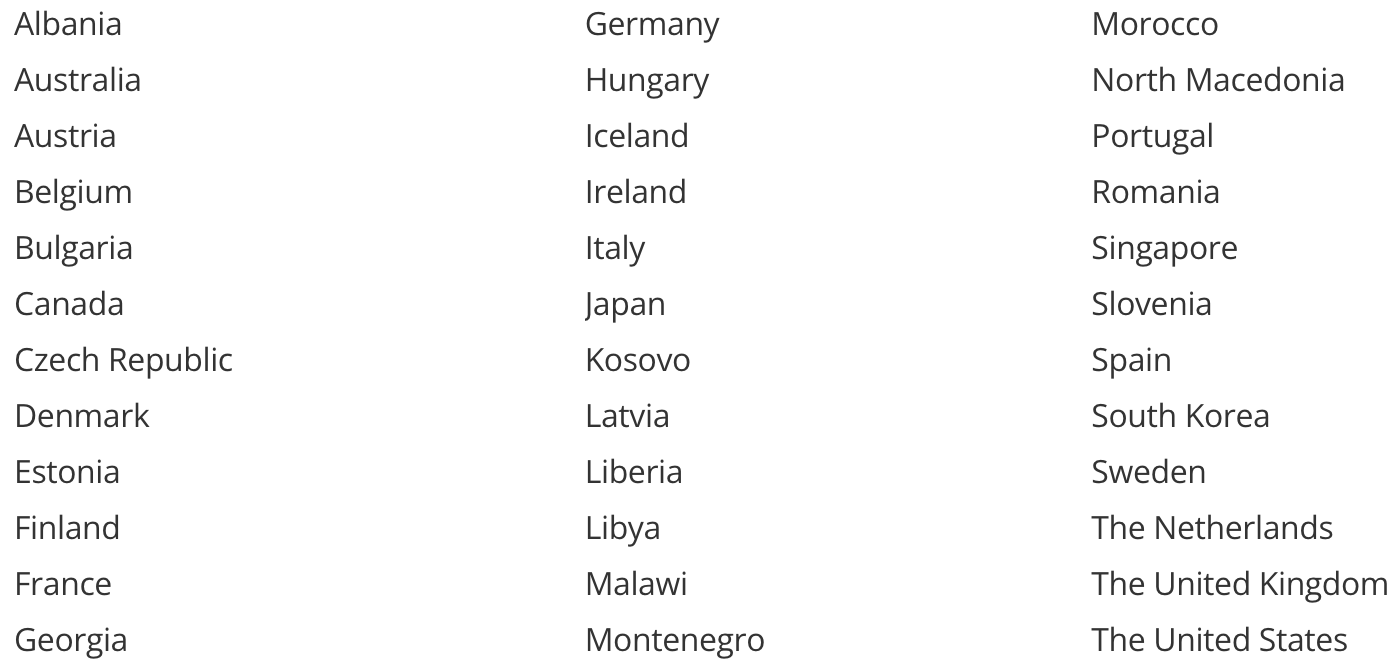

Questi sono i Paesi che si sono impegnati a sostenere l'iniziativa.

Da questo elenco sono assenti, in particolare, la Cina e la Russia. La Cina ha appoggiato il Dichiarazione di Bletchley, impegnandosi a sostenere in linea di principio lo sviluppo sicuro dell'IA in generale.

La decisione di Russia e Cina di non approvare la dichiarazione sull'IA militare potrebbe avere a che fare più con gli autori del documento che con le loro opinioni sulla sua sostanza.

Un altro vuoto nella lista è lasciato da due Paesi che attualmente ricevono miliardi di sostegno militare da alcuni degli Stati sostenitori, Israele e Ucraina.

In quanto alleati degli Stati Uniti, la loro decisione di non approvare l'impegno è più probabilmente dovuta al fatto che entrambi i Paesi utilizzano attualmente l'IA nei conflitti in cui sono impegnati.

Israele utilizza l'IA in diverse applicazioni militari, tra cui la sua Cupola di ferro sistema. L'Ucraina ha suscitato polemiche con il suo droni autonomi AI che prendono di mira i soldati e attrezzature militari nel conflitto con la Russia.

A cosa si stanno impegnando?

Se volete leggere i dettagli completi di ciò che i firmatari stanno accettando è possibile farlo qui.

Ecco la versione breve che potrebbe sacrificare un po' di sostanza per la brevità:

- Assicuratevi che il vostro esercito adotti e utilizzi questi principi di IA.

- L'uso dell'IA militare deve rispettare il diritto internazionale e proteggere i civili.

- I vertici devono gestire lo sviluppo e l'impiego dell'IA militare.

- Ridurre proattivamente le distorsioni involontarie nelle capacità di IA militare.

- Fate attenzione quando create o utilizzate le armi dell'IA.

- Assicuratevi che la vostra tecnologia di difesa dell'intelligenza artificiale sia trasparente e verificabile.

- Formare coloro che utilizzano o approvano l'uso delle capacità di IA militare in modo che non si fidino ciecamente dell'IA quando sbaglia.

- Definite chiaramente cosa intendete fare con la vostra tecnologia AI militare e progettatela in modo che faccia solo questo.

- Continuare a testare l'autoapprendimento e aggiornare continuamente le capacità dell'intelligenza artificiale militare per verificare se sono ancora sicure.

- Disporre di un interruttore di spegnimento nel caso in cui l'arma dell'IA si comporti male.

Si tratta di ideali lodevoli, ma non è certo che siano tecnologicamente o logisticamente alla portata delle organizzazioni di difesa.

Saranno applicabili? La firma dell'impegno è una conferma dell'approvazione di principio, ma non comporta alcun obbligo legale.

Firmare un documento che dice: "Faremo attenzione quando useremo l'IA nelle nostre forze armate", implica anche che il Paese intende usare l'IA come arma, anche se in modo "responsabile ed etico".

Almeno questi Paesi riconoscono il potenziale dell'IA di amplificare i danni che le armi convenzionali già causano. Questo quadro ha reso il mondo un po' più sicuro o ha solo acceso i riflettori su ciò che inevitabilmente ci aspetta?