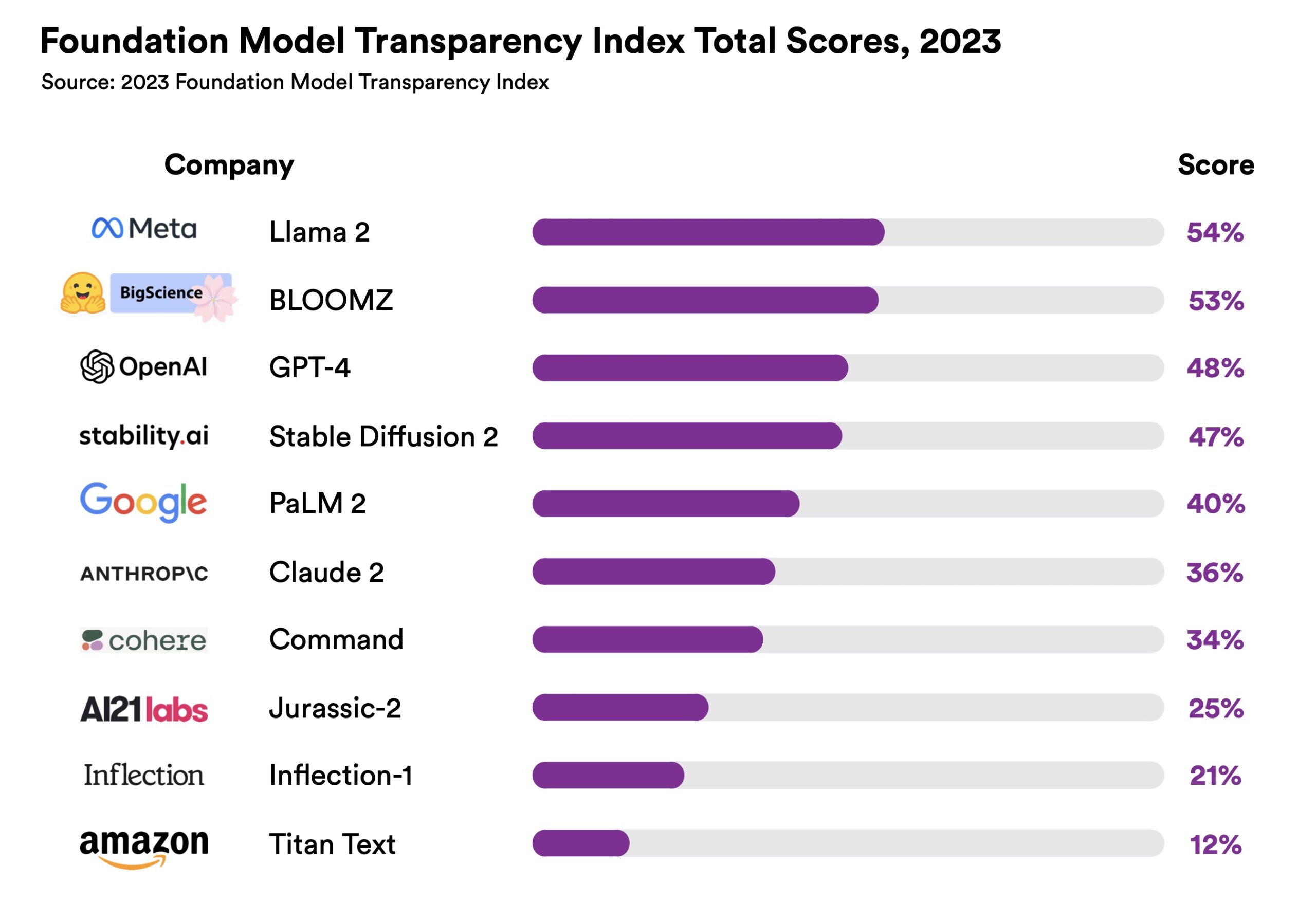

Ricercatori di Stanford, MIT e Princeton hanno creato un indice per valutare la trasparenza delle aziende di IA e dei loro modelli. I risultati non sono stati brillanti.

L'Indice di trasparenza dei modelli di fondazione (FMTI) valuta la trasparenza di 10 aziende produttrici di modelli di fondazione in base a 100 diversi aspetti della trasparenza. I criteri riguardano il modo in cui un'azienda costruisce un modello di fondazione, il suo funzionamento e l'esperienza dell'utente a valle.

Meta's Llama 2 si è piazzato in cima alla classifica, ma il suo punteggio di 54% non è esattamente un risultato da urlo. OpenAI è arrivato terzo con un punteggio di trasparenza di 48%. Considerando l'attuale dibattito open source vs proprietarioÈ interessante vedere che il divario tra questi due non era molto più grande.

La trasparenza è un fattore importante quando le organizzazioni cercano di scegliere quale modello aziendale adottare. Se la vostra azienda o istituzione educativa utilizza un modello di IA, volete sapere se potete fidarvi di esso.

Il modo in cui è stato realizzato il modello è in linea con i principi della vostra istituzione? Potreste esporvi a controversie legali a causa di violazioni del copyright?

L'indice raggiunge due importanti risultati. Dimostra che c'è ancora molta strada da fare prima di avere soluzioni di IA veramente trasparenti. E, pur dovendo ancora raggiungere questo obiettivo, ci mostra quali aziende stanno facendo un lavoro migliore di altre.

Il elenco dei criteri è una lettura interessante. Si pone domande come: "Le informazioni geografiche relative alle persone coinvolte nel lavoro sui dati sono divulgate per ogni fase della pipeline dei dati?". Lavoratori fantasma sono stati una controversa mosca etica nell'ingranaggio dell'IA.

Un altro dei criteri chiede: "La quantità di energia spesa nella costruzione del modello è divulgata?". Un punto importante se si vuole fare un ambientale scelta consapevole tra due modelli.

Si tratta di questioni innegabilmente importanti, ma scarsamente divulgate dalle aziende di IA. Nell'introduzione all'FMTI, il Center for Research Foundation Models afferma: "Mentre l'impatto sociale di questi modelli è in aumento, la trasparenza è in declino".

Si spera che l'attribuzione di un numero possa creare un senso di competizione tra le grandi aziende tecnologiche dell'IA per raggiungere i vertici della classifica FMTI.

Con la convergenza della parità di prestazioni tra i modelli migliori, è possibile che il punteggio FMTI possa influenzare l'adozione di un modello rispetto a un altro.