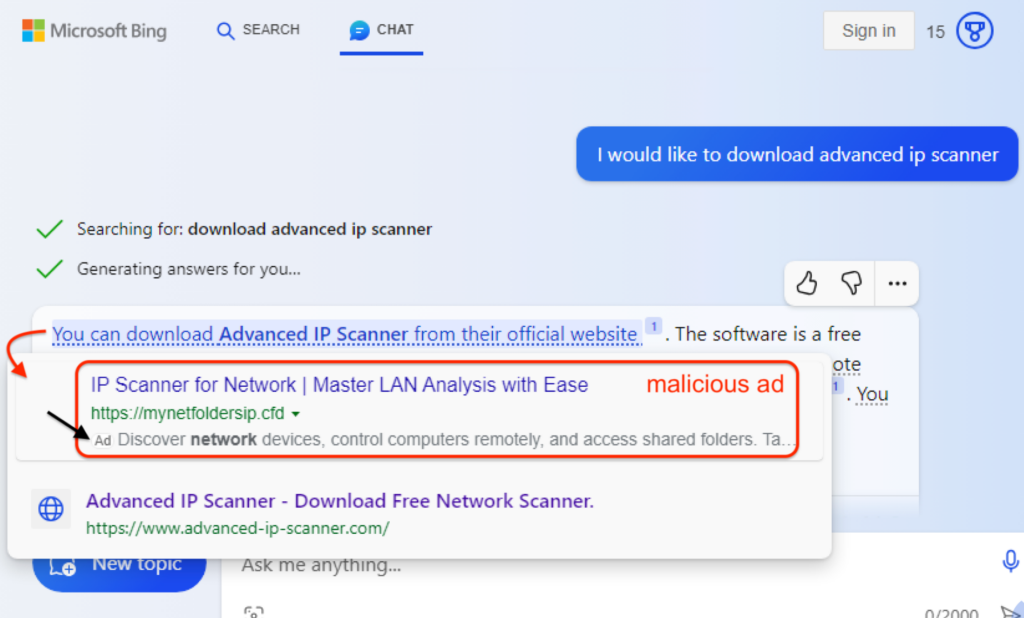

Lo strumento di ricerca guidato dall'intelligenza artificiale di Microsoft, Bing Chat, basato sul GPT-4 di OpenAI, integra annunci malevoli nella sua interfaccia.

Un avviso dettagliato di Malwarebytes ha evidenziato le vulnerabilità presenti nella piattaforma Bing Chat. Gli utenti possono essere facilmente indotti ad accedere a siti web dannosi durante la ricerca di download di software, scaricando di conseguenza malware sui loro sistemi.

Il processo funziona così:

- All'interno dell'interfaccia di Bing Chat, gli annunci vengono visualizzati prima dei risultati della ricerca quando gli utenti passano il mouse su determinati link.

- Sebbene questi link siano contrassegnati da un piccolo indicatore "Ad", il loro posizionamento discreto potrebbe far sì che gli utenti percepiscano il link come un risultato di ricerca legittimo.

- All'insaputa dell'utente, fare clic su tali annunci può reindirizzarlo verso siti di phishing progettati per assomigliare molto alle piattaforme ufficiali.

- Questi siti invitano poi gli utenti a scaricare quello che sembra un programma di installazione legittimo. In realtà, questi programmi di installazione contengono payload dannosi.

La ricerca di Malwarebytes ha identificato un incidente in cui è stato compromesso l'account pubblicitario di una vera azienda australiana.

Utilizzando l'account di annunci violato, l'attore malintenzionato ha inserito con successo due annunci ingannevoli rivolti a professionisti come amministratori di rete e avvocati. Malwarebytes evidenzia che una pubblicità continua a essere una strada interessante per i criminali informatici grazie alla sua portata e al suo impatto.

Le vulnerabilità della piattaforma Bing Chat sono state portate all'attenzione di Microsoft da Malwarebytes, che però non ha ancora reagito.

Il ruolo dell'intelligenza artificiale nelle frodi e nella sicurezza informatica è duplice, in quanto può aiutare sia i professionisti della sicurezza informatica sia i truffatori.