Artisti e creatori stanno mettendo sotto torchio gli sviluppatori di intelligenza artificiale per una potenziale violazione del copyright.

Digitando una richiesta in un generatore di immagini AI come DALL-E, MidJourney o Stable Diffusion, si otterrà in pochi secondi un'immagine apparentemente unica.

Nonostante la loro apparente unicità, il te immagini sono generate da miliardi di altre immagini attraverso quella che può essere descritta come una complessa tecnica di collage digitale.

Le immagini di partenza provengono da fonti "pubbliche" o "aperte".

Se chiedete a ChatGPT come funziona un generatore di immagini come DALL-E, vi risponderà qualcosa del tipo: "Pensate a DALL-E come a un artista digitale super avanzato, che ha visto milioni di immagini e può disegnarne una nuova in base alla vostra descrizione, cercando di renderla il più accurata possibile. Lo fa mescolando e abbinando gli elementi che ha imparato dalle sue precedenti 'osservazioni'".

È un po' come girare per le gallerie d'arte del mondo e fotografare ogni opera, solo che non si può essere cacciati.

Internet non ha guardie di sicurezza e telecamere che sorvegliano le persone per evitare la pirateria o il furto, e la pratica del data scraping - che consiste nel raccogliere dati da Internet con il servizio di bot - ha sempre occupato un territorio legale nebuloso.

Gli artisti sostengono che l'addestramento delle IA da testo a immagine su set di dati pubblici equivale alla più grande rapina d'arte del mondo.

Come si sentono gli artisti con i rilevatori di intelligenza artificiale?

Per alcuni artisti di successo, il cui lavoro è stato copiato migliaia o addirittura milioni di volte, l'impatto dell'arte generata dall'IA ha reso difficile distinguere tra il proprio lavoro e le copie dell'IA.

Le differenze estetiche sono semplicemente troppo piccole, probabilmente perché le immagini popolari appaiono in modo prolifico nei set di dati.

Tra questi c'è Greg Rutowski, che ha dichiarato: "Il mio lavoro è stato utilizzato nell'IA più di Picasso".

Le illustrazioni fantasy di Rutowki sono presenti in franchise come Dungeons and Dragons e Magic: The Gathering e possono essere replicate tramite generatori di testo-immagine semplicemente aggiungendo il nome dell'artista alla richiesta, ad esempio "Crea un drago che combatte un orco nello stile di Greg Rutowski".

Lui ha dichiarato alla BBCIl primo mese in cui l'ho scoperto, mi sono reso conto che la mia carriera ne risentirà in modo evidente e non sarò in grado di riconoscere e trovare le mie opere su Internet", aggiungendo: "I risultati saranno associati al mio nome, ma non sarà la mia immagine. Non sarà creata da me. Quindi si creerà confusione per le persone che stanno scoprendo le mie opere".

E ha continuato: "Tutto ciò su cui abbiamo lavorato per tanti anni ci è stato portato via così facilmente con l'IA".

L'ultima affermazione centra in pieno il bersaglio, poiché la riproduzione da parte dell'IA di opere complesse e di talento richiede pochi secondi, il che significa che non solo il lavoro degli artisti diventa superfluo, ma anche le competenze utilizzate per crearlo vanno perse.

L'umanitàL'assenza di competenze e conoscenze autentiche è uno dei rischi più pressanti dell'IA, soprannominato "indebolimento,", illustrata dal film Disney WALL-E, dove gli esseri umani perdono la capacità di muoversi a causa della tecnologia.

Un altro artista che ha parlato della riproduzione delle proprie opere da parte dell'intelligenza artificiale è Kelly McKernan, un'illustratrice del Tennessee che ha scoperto che più di 50 sue opere erano state inserite come dati di addestramento nel Large-scale Artificial Intelligence Open Network (LAION).

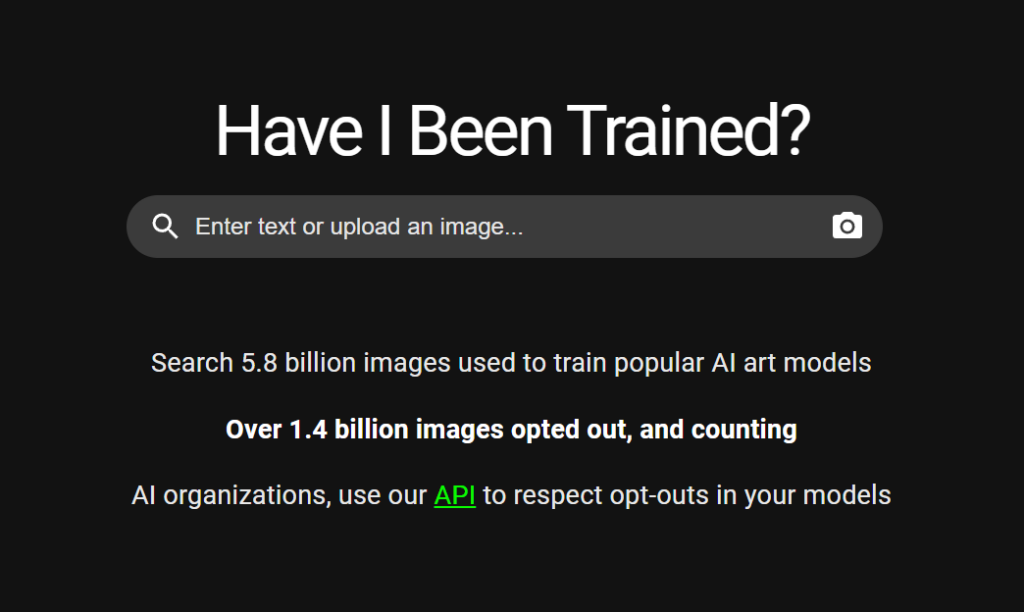

È possibile cercare circa 5,8 miliardi di immagini presenti nei set di addestramento dell'intelligenza artificiale con lo strumento "Sono stato addestrato?", che è il modo in cui McKernan si è imbattuto nel suo lavoro.

LAION è un'organizzazione no-profit che crea modelli e set di dati open-sourced, molti dei quali sono stati utilizzati per addestrare modelli text-to-image di alto profilo, tra cui Stable Diffusion e Imagen.

"Improvvisamente tutti questi dipinti con cui avevo un rapporto personale e un viaggio hanno assunto un nuovo significato, cambiando il mio rapporto con quelle opere d'arte", ha detto McKernan.

Le battaglie legali sono in corso

McKernan, insieme alle artiste Sarah Anderson e Karla Ortiz, ha intrapreso un'azione legale contro Stability AI, DeviantArt e Midjourney.

La loro causa si aggiunge a una marea di azioni legali contro le aziende di IA da parte di scrittori e artisti visivi.

Anche grandi aziende stanno facendo causa o hanno intenzione di fare causa agli sviluppatori di AI, tra cui Getty Images, che ha affermato che Stability AI ha copiato ed elaborato illegalmente 12 milioni di sue immagini senza autorizzazione.

McKernan ha dichiarato: "Così com'è, il copyright può essere applicato solo alla mia immagine completa. Spero che [la causa] incoraggi la protezione degli artisti, in modo che l'AI non possa essere usata per sostituirci. Se vinciamo, spero che molti artisti vengano pagati. Si tratta di lavoro gratuito e alcune persone stanno traendo profitto dallo sfruttamento".

Lo stile di McKernan, che si vede qui sotto, è stato richiesto in circa 12.000 richieste di MidJourney.

Visualizza questo post su Instagram

Un problema fondamentale è che la legge sul diritto d'autore non è stata costruita per l'era dell'intelligenza artificiale.

Liam Budd del sindacato delle arti e dello spettacolo Equity ha sostenuto la necessità di aggiornare le leggi che riflettono le potenziali opportunità commerciali offerte dall'IA generativa.

Lui dichiaratoAbbiamo bisogno di maggiore chiarezza nella legge e ci stiamo battendo per l'aggiornamento della legge sul copyright".

In risposta alla marea crescente di violazioni del copyright da parte dell'IA, diverse giurisdizioni, come l'UE, hanno proposto che gli sviluppatori di IA rivelino qualsiasi materiale protetto da copyright utilizzato per l'addestramento.

Sarà sufficiente? Gli sviluppatori di IA hanno già dimostrato di poterla fare franca?

Dopotutto, la maggior parte di questi set di dati è già stata assemblata e le aziende di IA potrebbero sostenere che stanno semplicemente aggiornando i modelli per eludere la necessità di dichiarare il materiale protetto da copyright.

Le cause hanno una solida base legale?

L'attuale serie di azioni legali collettive ruota in gran parte intorno a due argomenti.

- In primo luogo, l'affermazione che le società hanno violato i diritti d'autore degli artisti utilizzando le loro opere senza autorizzazione.

- In secondo luogo, l'affermazione che i risultati dell'IA sono essenzialmente contenuti derivati a causa della loro inclusione nei dati di addestramento.

L'applicazione di queste argomentazioni è diversa in tutto il mondo, ad esempio negli Stati Uniti, dove le leggi sul "fair use" sono generalmente più liberali rispetto all'UE. Ciò complica ulteriormente il panorama del copyright dell'IA. Se le aziende operano nel Regno Unito, ad esempio, potrebbero trovare più difficile sostenere il "fair use".

Inoltre, sono le aziende di IA generativa a essere citate in giudizio, non le entità che compilano i set di dati, come LAION nel caso di MidJourney. Eliana Torres, avvocato specializzato in proprietà intellettuale presso lo studio legale Nixon Peabody, sottolinea che se LAION ha creato il set di dati, la presunta violazione si è verificata in quel momento, non quando il set di dati è stato utilizzato per addestrare i modelli.

Inoltre, dimostrare che le opere generate dall'IA sono riproduzioni di opere originali è difficile a causa della natura complessa dell'IA, che utilizza un'elaborazione algoritmica per scomporre e riassemblare le immagini.

Gli enti normativi sono stati colti di sorpresa dalle implicazioni legali dell'IA generativa e, pur essendo in fase di sviluppo soluzioni provvisorie come filtri automatici e disposizioni di opt-out per gli artisti, potrebbero non essere sufficienti.

Finché i giudici non si pronunceranno sui singoli casi, cosa che potrebbe richiedere mesi, le aziende di IA generativa si espongono a rischi legali significativi in molte giurisdizioni.

La storia indica che la legge sul diritto d'autore può adattarsi alle nuove tecnologie, ma finché non emerge un consenso, sia gli artisti che gli sviluppatori di IA sono molto all'oscuro.

I giudici mettono il freno alle cause legali

Finora i giudici hanno dato agli artisti poco da essere ottimisti.

Ad esempio, il giudice distrettuale statunitense William Orrick ha messo in dubbio la causa di Kelly McKernan.

Secondo il giudice OrrickMcKernan e gli altri querelanti dovevano "fornire più fatti" sulla presunta violazione del copyright e differenziare chiaramente le loro rivendicazioni nei confronti di ciascuna società (Stability AI, DeviantArt e Midjourney).

Orrick ha osservato che i sistemi sono stati addestrati su "cinque miliardi di immagini compresse", quindi gli artisti devono fornire prove più solide che le loro opere siano state specificamente coinvolte nella presunta violazione del copyright. A sito web che segue questa causa ha recentemente caricato informazioni tecniche su come questi modelli funzionano interpolando il contenuto delle immagini nel loro set di addestramento.

Il caso è rappresentato dallo studio Studio legale Joseph Saveriche sta rappresentando almeno altre 5 cause simili contro aziende di IA.

E ancora, il diritto d'autore è potenzialmente violato nel momento in cui i dati vengono raccolti piuttosto che generati.

La sezione 1202(b) del Digital Millennium Copyright Act americano "riguarda "copie" identiche di un'opera, non frammenti e adattamenti", per cui sostenere che le opere sono "copiate" dal processo del modello AI è potenzialmente inconsistente.

Le opinioni di Orrick sollevano anche dubbi sulla responsabilità di aziende come MidJourney e DeviantArt, che incorporano la tecnologia Stable Diffusion di Stability AI nei propri sistemi di IA generativa.

ISe agli sviluppatori di IA, come OpenAI, Meta, ecc. viene attribuita una certa responsabilità per la violazione dei diritti d'autore degli artisti, essi sono vulnerabili a ulteriori azioni legali.

Anche gli autori e gli scrittori stanno lanciando cause legali

In un altro recente causa legaleLa comica e autrice statunitense Sarah Silverman e gli autori Christopher Golden e Richard Kadrey sostengono che le loro parole sono state utilizzate illegalmente per addestrare modelli di intelligenza artificiale come ChatGPT e LLaMA.

L'azione legale presenta rivendicazioni parallele a quelle presentate dagli artisti visivi, ma questa volta le IA sono addestrate su dati testuali pubblici.

La causa sostiene che ChatGPT era in grado di riassumere accuratamente libri come "The Bedwetter" di Silverman, "Ararat" di Golden e "Sandman Slim" di Kadrey. In particolare, il livello di dettaglio fornito dai riassunti non può essere spiegato dagli estratti dei libri caricati su Wikipedia o sui siti web delle librerie.

I querelanti accusano OpenAI e Meta di aver utilizzato senza consenso libri protetti da copyright provenienti da "biblioteche ombra".

Le biblioteche ombra, come Bibliotik, Library Genesis e Z-Library, ospitano grandi quantità di informazioni copiate illegalmente.

Sebbene sia evidente che le aziende di IA abbiano monetizzato prodotti con l'aiuto di opere protette da copyright, esse godono di diversi livelli di protezione, tra cui la natura intrinsecamente complessa dei loro modelli e lo spazio idiosincratico che occupano nel panorama morale, etico e legale.

Cosa devono decidere i tribunali?

Mentre le autorità di regolamentazione stanno ancora deliberando le regole sull'IA, i giudici potrebbero avere il primo tentativo di plasmare il futuro panorama del copyright.

Questo potrebbe Il risultato è un mosaico di leggi limitato dalle specificità di ogni caso e dalla giurisdizione in cui è stato deciso.

Attualmente ci sono molte domande a cui rispondere, tra cui:

D1: La formazione di un modello su materiale protetto da copyright richiede una licenza?

- Uso corretto e licenza: I tribunali potrebbero dover decidere se la copia temporanea di dati durante la formazione rientri nel "fair use", che ne consentirebbe l'uso senza licenza. Ciò potrebbe dipendere da fattori quali lo scopo della copia, la natura dell'opera protetta da copyright, la quantità e la consistenza della parte utilizzata e l'effetto sul valore di mercato dell'opera protetta da copyright.

- Prospettive internazionali: Le diverse giurisdizioni possono avere posizioni diverse su questo argomento. Ad esempio, la direttiva sul copyright dell'UE potrebbe essere interpretata in modo diverso dalla legge sul copyright degli Stati Uniti.

D2: I risultati dell'IA generativa violano il copyright dei materiali su cui il modello è stato addestrato?

- Determinazione del lavoro derivato: L'output generativo è semplicemente una trasformazione o crea effettivamente un'opera derivata che viola il diritto d'autore? Questa domanda potrebbe richiedere un'analisi complessa della somiglianza e della creatività.

- Problemi di responsabilità: In caso di violazione, chi è responsabile? Il creatore dell'IA? L'utente dell'IA? Il distributore?

D3: L'IA generativa viola le restrizioni sulla rimozione, l'alterazione o la falsificazione delle informazioni di gestione del copyright?

- Casi specifici: L'analisi di algoritmi specifici come la Diffusione stabile potrebbe essere necessaria per determinare se le opere generate potrebbero riprodurre o manipolare accidentalmente watermark o altre informazioni sul copyright.

- Intenzione e violazione accidentale: I tribunali potrebbero dover stabilire se c'era l'intenzione di rimuovere o alterare le informazioni sul copyright o se si è trattato di una conseguenza non intenzionale del funzionamento dell'IA.

D4: Generare un lavoro nello stile di qualcuno viola i diritti di quella persona?

- Definizione del diritto di pubblicità: Il diritto di pubblicità varia da giurisdizione a giurisdizione. I tribunali potrebbero dover interpretare se la creazione di opere nello stile di qualcuno equivalga all'utilizzo delle sue sembianze o della sua identità.

- Uso commerciale e non commerciale: L'applicazione può variare a seconda che i risultati dell'IA siano utilizzati o meno a fini commerciali.

D5: Come si applicano le licenze open-source all'addestramento dei modelli di IA e alla distribuzione dei risultati ottenuti?

- Comprendere le licenze open source: I tribunali potrebbero dover stabilire come le licenze open source si applichino ai dati di addestramento dell'IA e ai risultati generati.

Al momento manca una cosa: una sentenza. In questo momento, sarebbe folle prevedere se lo scraping gratuito di dati rimarrà accettabile. Se i creatori dovessero trovare una falla nell'armatura legale dell'industria dell'IA, il danno potrebbe essere considerevole. Ma sembra un grande "se".

Quando le sentenze inizieranno a filtrare e ci avvicineremo all'entrata in vigore delle normative, la direzione futura dell'IA dovrebbe diventare più chiara. - fino alla prossima serie di sfide.