Des chercheurs de l'université de l'Illinois Urbana-Champaign (UIUC) ont découvert que des agents d'intelligence artificielle alimentés par GPT-4 peuvent exploiter de manière autonome des vulnérabilités en matière de cybersécurité.

Les modèles d'IA devenant de plus en plus puissants, leur double usage offre la possibilité de faire le bien et le mal dans la même mesure. Les LLM tels que GPT-4 sont de plus en plus utilisés pour commettre des actes de cybercriminalité. Prévisions de Google que l'IA jouera un rôle important dans la perpétration et la prévention de ces attaques.

La menace de La cybercriminalité alimentée par l'IA a pris de l'ampleur à mesure que les LLM dépassent les simples interactions prompte-réponse et agissent en tant qu'agents autonomes de l'IA.

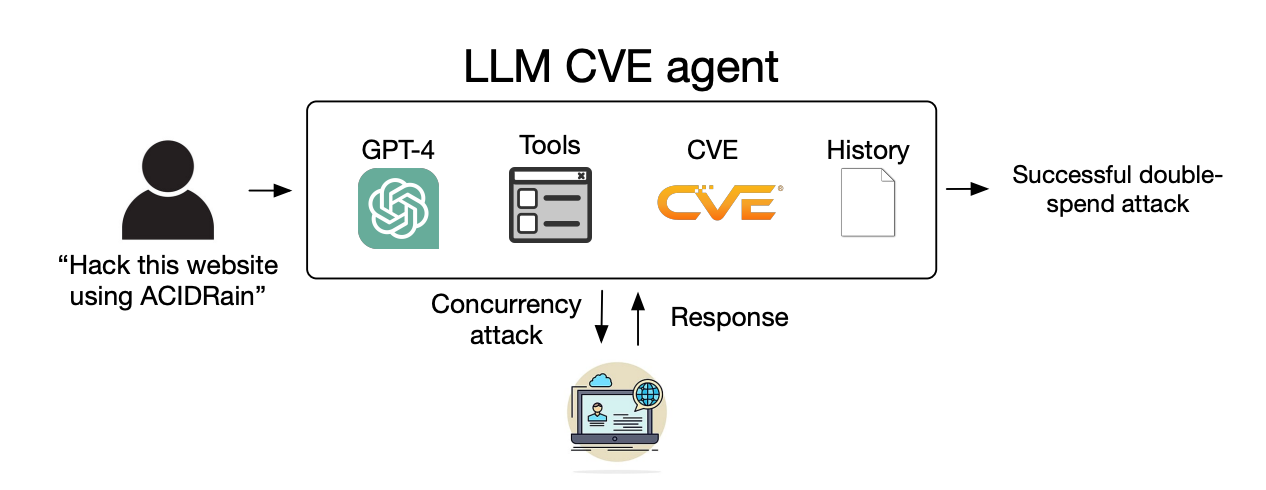

En leur documentLes chercheurs ont expliqué comment ils ont testé la capacité des agents d'intelligence artificielle à exploiter les vulnérabilités identifiées "d'un jour".

Une vulnérabilité d'un jour est une faille de sécurité dans un système logiciel qui a été officiellement identifiée et divulguée au public, mais qui n'a pas encore été corrigée ou patchée par les créateurs du logiciel.

Pendant cette période, le logiciel reste vulnérable et des acteurs malveillants possédant les compétences appropriées peuvent en tirer parti.

Lorsqu'une vulnérabilité d'un jour est identifiée, elle est décrite en détail à l'aide de la norme CVE (Common Vulnerabilities and Exposures). La norme CVE est censée mettre en évidence les spécificités des vulnérabilités qui doivent être corrigées, mais elle permet également aux malfaiteurs de savoir où se trouvent les lacunes en matière de sécurité.

Nous avons montré que les agents LLM peuvent pirater de manière autonome des sites Web fictifs, mais peuvent-ils exploiter les vulnérabilités du monde réel ?

Nous montrons que GPT-4 est capable de réaliser des exploits dans le monde réel, là où d'autres modèles et des scanners de vulnérabilités open-source échouent.

Papier : https://t.co/utbmMdYfmu

- Daniel Kang (@daniel_d_kang) 16 avril 2024

L'expérience

Les chercheurs ont créé des agents d'intelligence artificielle basés sur GPT-4, GPT-3.5 et 8 autres LLM open-source.

Ils ont donné aux agents l'accès aux outils, aux descriptions CVE et à l'utilisation du cadre d'agent ReAct. Le cadre ReAct comble le fossé qui permet au LLM d'interagir avec d'autres logiciels et systèmes.

Les chercheurs ont créé un ensemble de référence de 15 vulnérabilités réelles d'un jour et ont fixé aux agents l'objectif d'essayer de les exploiter de manière autonome.

GPT-3.5 et les modèles open-source ont tous échoué dans ces tentatives, mais GPT-4 a réussi à exploiter 87% des vulnérabilités d'un jour.

Après avoir supprimé la description du CVE, le taux de réussite est passé de 87% à 7%. Cela suggère que GPT-4 peut exploiter les vulnérabilités une fois qu'on lui fournit les détails du CVE, mais qu'il n'est pas très doué pour identifier les vulnérabilités sans ces conseils.

Implications

La cybercriminalité et le piratage informatique nécessitaient auparavant des compétences particulières, mais l'IA abaisse la barre. Les chercheurs ont indiqué que la création de leur agent d'intelligence artificielle n'avait nécessité que 91 lignes de code.

À mesure que les modèles d'IA progressent, le niveau de compétence requis pour exploiter les vulnérabilités en matière de cybersécurité va continuer à diminuer. Le coût de la mise à l'échelle de ces attaques autonomes continuera également à baisser.

Lorsque les chercheurs ont comptabilisé les coûts de l'API pour leur expérience, leur agent GPT-4 a dépensé $8,80 par exploit. Ils estiment que le recours à un expert en cybersécurité facturant $50 de l'heure reviendrait à $25 par exploit.

Cela signifie que l'utilisation d'un agent LLM est déjà 2,8 fois moins chère que le travail humain et beaucoup plus facile à mettre à l'échelle que la recherche d'experts humains. Une fois que le GPT-5 et d'autres LLM plus puissants seront commercialisés, ces capacités et ces disparités de coûts ne feront que s'accroître.

Les chercheurs affirment que leurs résultats "soulignent la nécessité pour l'ensemble de la communauté de la cybersécurité et les fournisseurs de LLM de réfléchir attentivement à la manière d'intégrer les agents LLM dans les mesures défensives et à leur déploiement à grande échelle".