Le colonialisme numérique fait référence à la domination des géants de la technologie et des entités puissantes sur le paysage numérique, façonnant le flux d'informations, de connaissances et de culture pour servir leurs intérêts.

Cette domination ne consiste pas seulement à contrôler l'infrastructure numérique, mais aussi à influencer les récits et les structures de connaissances qui définissent notre ère numérique.

Le colonialisme numérique, et maintenant le colonialisme de l'IA, sont des termes largement reconnus, et des institutions telles que MIT a effectué des recherches et écrit sur les a largement diffusés.

Des chercheurs de haut niveau d'Anthropic, de Google, de DeepMind et d'autres entreprises technologiques ont ouvertement discuté de la portée limitée de l'IA pour ce qui est de servir les personnes d'origines diverses, en particulier pour ce qui est de biais dans les systèmes d'apprentissage automatique.

Systèmes d'apprentissage automatique fLes données sur lesquelles elles sont formées reflètent fondamentalement les données sur lesquelles elles sont formées - des données qui peuvent être utilisées pour la formation.ous pourrions considérer que l'Internet est un produit de notre zeitgeist numérique - un ensemble de récits, d'images et d'idées qui dominent le monde en ligne.

Mais qui est en mesure de façonner ces forces d'information ? Quelles sont les voix qui sont amplifiées et celles qui sont atténuées ?

Lorsque l'IA apprend à partir de données d'apprentissage, elle hérite de visions du monde spécifiques qui ne sont pas nécessairement en résonance avec les cultures et expériences mondiales ou qui ne les représentent pas. En outre, les contrôles qui régissent les résultats des outils d'IA générative sont façonnés par des vecteurs socioculturels sous-jacents.

Cela a conduit des développeurs comme Anthropic à rechercher des méthodes démocratiques de façonner le comportement de l'IA en s'appuyant sur l'opinion publique.

Comme le décrit Jack Clark, responsable politique d'Anthropic, un expérience récente Nous essayons de trouver un moyen de développer une constitution qui soit élaborée par un grand nombre de tiers, plutôt que par des personnes qui se trouvent travailler dans un laboratoire à San Francisco".

Les paradigmes actuels de formation à l'IA générative risquent de créer une chambre d'écho numérique où les mêmes idées, valeurs et perspectives sont continuellement renforcées, ce qui renforce la domination de ceux qui sont déjà surreprésentés dans les données.

À mesure que l'IA s'intègre dans des processus décisionnels complexes, des protection sociale et le recrutement à décisions financières et les diagnostics médicauxUne représentation déséquilibrée entraîne des préjugés et des injustices dans le monde réel.

Les ensembles de données sont géographiquement et culturellement situés

Un récent étude de la Data Provenance Initiative a examiné 1 800 ensembles de données populaires destinés au traitement du langage naturel (NLP), une discipline de l'intelligence artificielle qui se concentre sur le langage et le texte.

Le NLP est la méthodologie d'apprentissage automatique dominante derrière les grands modèles de langage (LLM), y compris ChatGPT et les modèles Llama de Meta.

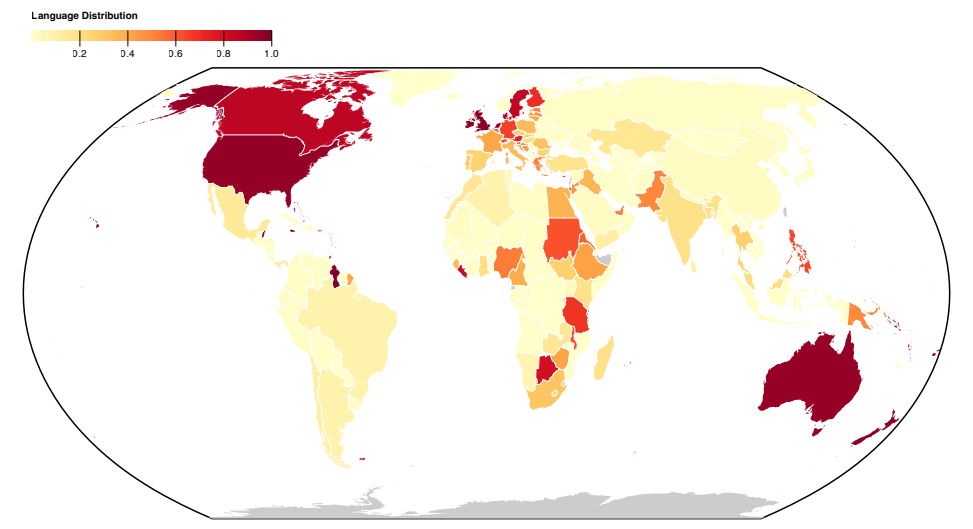

L'étude révèle que la représentation des langues dans les ensembles de données est centrée sur l'Occident, l'anglais et les langues d'Europe occidentale définissant les données textuelles.

Les langues des nations asiatiques, africaines et sud-américaines sont nettement sous-représentées.

Par conséquent, les LLM ne peuvent espérer représenter avec précision les nuances culturelles et linguistiques de ces régions dans la même mesure que les langues occidentales.

Même lorsque des langues du Sud semblent être représentées, la source et le dialecte de la langue proviennent principalement de créateurs et de sources web nord-américains ou européens.

A précédent Expérience anthropique a constaté que le fait de changer de langue dans des modèles tels que ChatGPT continuait à produire des points de vue centrés sur l'Occident et des stéréotypes dans les conversations.

Les chercheurs anthropologues ont conclu : "Si un modèle linguistique représente de manière disproportionnée certaines opinions, il risque d'avoir des effets potentiellement indésirables, tels que la promotion de visions du monde hégémoniques et l'homogénéisation des points de vue et des croyances des gens".

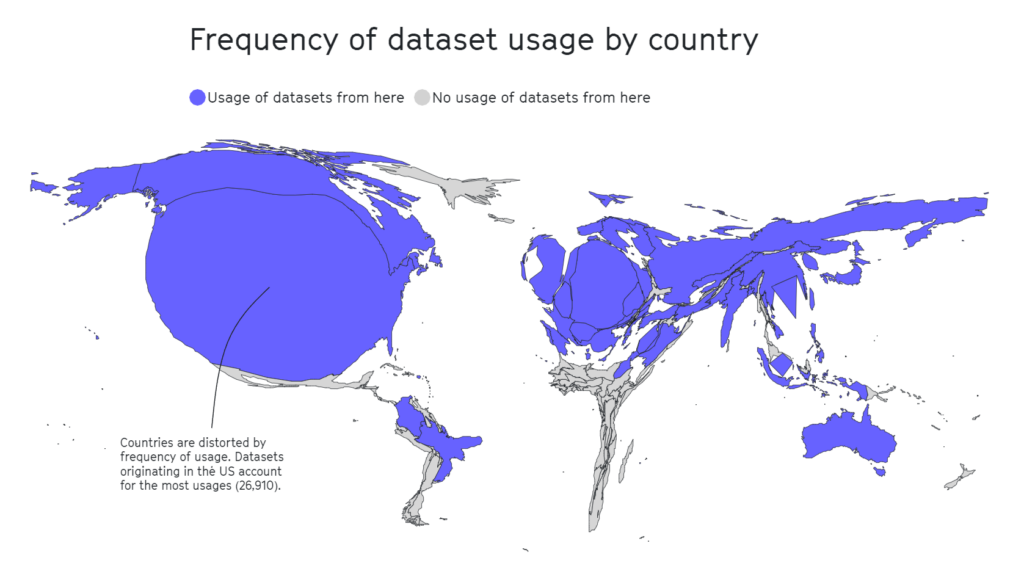

L'étude sur la provenance des données a également permis de disséquer le paysage géographique de la conservation des ensembles de données. Les organisations universitaires apparaissent comme les principaux moteurs, contribuant à 69% des ensembles de données, suivies par les laboratoires industriels (21%) et les instituts de recherche (17%).

Les plus gros contributeurs sont notamment AI2 (12,3%), l'Université de Washington (8,9%) et Facebook AI Research (8,4%).

A étude distincte pour 2020 souligne que la moitié des ensembles de données utilisés pour l'évaluation de l'IA dans quelque 26 000 articles de recherche proviennent de 12 universités et entreprises technologiques de premier plan.

Une fois encore, des régions géographiques telles que l'Afrique, l'Amérique du Sud et l'Amérique centrale, ainsi que l'Asie centrale, se sont révélées terriblement sous-représentées, comme le montre le tableau ci-dessous.

Dans d'autres recherches, des ensembles de données influents comme Tiny Images du MIT ou Labeled Faces in the Wild contenaient principalement des images d'hommes occidentaux blancs, avec quelque 77,5% d'hommes et 83,5% d'individus à la peau blanche dans le cas de Labeled Faces in the Wild.

Dans le cas de Tiny Images, un Analyse de 2020 par The Register a constaté que de nombreuses Tiny Images contenaient des étiquettes obscènes, racistes et sexistes.

Antonio Torralba, du MIT, a déclaré qu'ils n'étaient pas au courant des étiquettes et que l'ensemble de données a été supprimé. M. Torralba a déclaré : "Il est clair que nous aurions dû les trier manuellement."

L'anglais domine l'écosystème de l'IA

Pascale Fung, informaticienne et directrice du Centre de recherche sur l'IA de l'Université des sciences et technologies de Hong Kong, a évoqué les problèmes liés à l'IA hégémonique.

Fung se réfère à plus de 15 documents de recherche portant sur les compétences multilingues des LLM et les trouve systématiquement insuffisantes, en particulier lorsqu'il s'agit de traduire l'anglais dans d'autres langues. Par exemple, les langues dont l'écriture n'est pas latine, comme le coréen, révèlent les limites de l'apprentissage tout au long de la vie.

En plus d'un support multilingue médiocre, autres études suggèrent que la majorité des critères et mesures de partialité ont été élaborés en tenant compte des modèles de langue anglaise.

Les repères de biais non anglophones sont rares, ce qui entraîne une lacune importante dans notre capacité à évaluer et à rectifier les biais dans les modèles linguistiques multilingues.

Il y a des signes d'amélioration, comme les efforts de Google avec son modèle de langage PaLM 2 et son modèle d'apprentissage de la langue. Meta's Discours massivement multilingue (MMS) qui peut identifier plus de 4 000 langues parlées, soit 40 fois plus que les autres approches. Cependant, le MMS reste expérimental.

Les chercheurs créent des ensembles de données diversifiés et multilingues, mais la quantité écrasante de données textuelles en anglais, souvent gratuites et faciles d'accès, en fait le choix de facto pour les développeurs.

Au-delà des données : les enjeux structurels du travail dans l'IA

La vaste revue du MIT sur le colonialisme de l'IA a attiré l'attention sur un aspect relativement caché du développement de l'IA : les pratiques d'exploitation de la main-d'œuvre.

L'IA a entraîné une forte augmentation de la demande de services d'étiquetage des données. Des entreprises comme Appen et Sama ont émergé en tant qu'acteurs clés, offrant des services de marquage de textes, d'images et de vidéos, de tri de photos et de transcription audio pour alimenter les modèles d'apprentissage automatique.

Les spécialistes des données humaines étiquettent également manuellement les types de contenu, souvent pour trier les données qui contiennent des contenus illégaux, illicites ou contraires à l'éthique, tels que des descriptions d'abus sexuels, de comportements préjudiciables ou d'autres activités illégales.

Si les entreprises spécialisées dans l'IA automatisent certains de ces processus, il est toujours essentiel de maintenir les "humains dans la boucle" pour garantir l'exactitude des modèles et le respect des règles de sécurité.

La valeur marchande de ce "travail fantôme", comme l'ont qualifié l'anthropologue Mary Gray et le chercheur en sciences sociales Siddharth Suri, devrait s'élever à monter en flèche pour atteindre $13,7 milliards d'euros d'ici 2030.

Le travail au noir implique souvent l'exploitation d'une main-d'œuvre bon marché, en particulier dans les pays économiquement vulnérables. Le Venezuela, par exemple, est devenu une source principale de main-d'œuvre liée à l'IA en raison de sa crise économique.

Alors que le pays était confronté à la pire catastrophe économique qu'il ait connue en temps de paix et à une inflation astronomique, une grande partie de sa population instruite et connectée à l'internet s'est tournée vers les plateformes de crowdworking pour survivre.

La confluence d'une main-d'œuvre bien formée et d'une situation économique désespérée a fait du Venezuela un marché attrayant pour les entreprises d'étiquetage de données.

Il ne s'agit pas d'un point controversé - lorsque le MIT publie des articles avec des titres tels que "L'intelligence artificielle crée un nouvel ordre mondial colonialEn évoquant des scénarios de ce type, il est clair que certains acteurs de l'industrie cherchent à lever le voile sur ces pratiques de travail sournoises.

Comme le rapporte le MIT, pour de nombreux Vénézuéliens, l'industrie florissante de l'IA a été une arme à double tranchant. Si elle a constitué une bouée de sauvetage économique dans un contexte de désespoir, elle a également exposé les gens à l'exploitation.

Julian Posada, doctorant à l'université de Toronto, souligne les "énormes déséquilibres de pouvoir" dans ces arrangements de travail. Les plateformes dictent les règles, laissant aux travailleurs peu d'influence et une compensation financière limitée malgré les difficultés rencontrées sur le lieu de travail, telles que l'exposition à des contenus dérangeants.

Cette dynamique rappelle étrangement les pratiques coloniales historiques où les empires exploitaient la main-d'œuvre des pays vulnérables, en tirant des bénéfices et en les abandonnant une fois que l'opportunité s'est réduite, souvent parce qu'une "meilleure valeur" était disponible ailleurs.

Des situations similaires ont été observées à Nairobi, au Kenya, où un groupe d'anciens modérateurs de contenu travaillant sur ChatGPT a déposé une pétition avec le gouvernement kenyan.

Ils ont allégué des "conditions d'exploitation" pendant leur période d'emploi chez Sama, une société américaine de services d'annotation de données sous contrat avec l'OpenAI. Les pétitionnaires ont affirmé avoir été exposés à des contenus dérangeants sans bénéficier d'un soutien psychosocial adéquat, ce qui a entraîné de graves problèmes de santé mentale, notamment le syndrome de stress post-traumatique, la dépression et l'anxiété.

Documents revue par TIME a indiqué qu'OpenAI avait signé avec Sama des contrats d'une valeur d'environ $200 000. Ces contrats portaient sur l'étiquetage de descriptions d'abus sexuels, de discours haineux et de violence.

L'impact sur la santé mentale des travailleurs a été profond. Mophat Okinyi, un ancien modérateur, a parlé des conséquences psychologiques, décrivant comment l'exposition à des contenus graphiques a conduit à la paranoïa, à l'isolement et à des pertes personnelles importantes.

Les salaires pour un travail aussi pénible étaient scandaleusement bas - un porte-parole de Sama a révélé que les travailleurs gagnaient entre $1,46 et $3,74 de l'heure.

Résister au colonialisme numérique

Si l'industrie de l'IA est devenue une nouvelle frontière du colonialisme numérique, la résistance devient déjà plus cohésive.

Les activistes, souvent soutenus par des chercheurs en IA, plaident en faveur de la responsabilisation, de la modification des politiques et du développement de technologies qui accordent la priorité aux besoins et aux droits des communautés locales.

Nanjala Nyabola's Projet de droits numériques en kiswahili offre un exemple innovant de la manière dont les projets locaux peuvent installer l'infrastructure nécessaire pour protéger les communautés de l'hégémonie numérique.

Le projet prend en compte l'hégémonie des réglementations occidentales lorsqu'il s'agit de définir les droits numériques d'un groupe, car tout le monde n'est pas protégé par les lois sur la propriété intellectuelle, les droits d'auteur et la protection de la vie privée que beaucoup d'entre nous considèrent comme allant de soi. En effet, tout le monde n'est pas protégé par les lois sur la propriété intellectuelle, les droits d'auteur et la protection de la vie privée que beaucoup d'entre nous considèrent comme allant de soi.

Conscients que les discussions autour des droits numériques sont émoussées si les gens ne peuvent pas communiquer sur ces questions dans leur langue maternelle, Mme Nyabola et son équipe ont traduit les principaux termes relatifs aux droits numériques et à la technologie en kiswahili, langue principalement parlée en Tanzanie, au Kenya et au Mozambique.

Nyabola décrit le projetAu cours de ce processus [de l'initiative Huduma Namba], nous ne disposions pas vraiment du langage et des outils nécessaires pour expliquer aux communautés kenyanes non spécialisées ou ne parlant pas l'anglais les implications de l'initiative.

Dans le cadre d'un projet local similaire, Te Hiku Media, une station de radio à but non lucratif diffusant principalement en langue Māori, possède une vaste base de données d'enregistrements couvrant des décennies, dont beaucoup font écho à des phrases ancestrales qui ne sont plus prononcées.

Les modèles de reconnaissance vocale classiques, similaires aux LLM, ont tendance à ne pas être à la hauteur lorsqu'ils sont sollicités dans différentes langues ou dialectes anglais.

Les Te Hiku Media a collaboré avec des chercheurs et des technologies libres pour former un modèle de reconnaissance vocale adapté à la langue Māori. L'activiste Māori Te Mihinga Komene a fourni quelque 4 000 phrases à d'innombrables autres participants au projet.

Les modèle résultant et les données sont protégées par la Licence Kaitiakitanga - Kaitiakitanga est un mot Māori qui n'a pas de définition spécifique en anglais, mais qui est similaire à "gardien" ou "dépositaire".

Keoni Mahelona, cofondateur de Te Hiku Media, a fait remarquer de manière poignante que "les données sont la dernière frontière de la colonisation".

Ces projets ont inspiré d'autres communautés indigènes et autochtones soumises à la pression du colonialisme numérique et à d'autres formes de bouleversements sociaux, telles que les peuples Mohawk en Amérique du Nord et les Hawaïens indigènes.

L'IA open-source devenant moins chère et plus facile d'accès, l'itération et l'affinement des modèles à l'aide d'ensembles de données uniques et localisés devraient devenir plus simples, améliorant ainsi l'accès interculturel à la technologie.

Bien que le secteur de l'IA soit encore jeune, il est temps de mettre ces défis en évidence afin que les gens puissent élaborer collectivement des solutions.

Les solutions peuvent être à la fois au niveau macro, sous la forme de réglementations, de politiques et d'approches de formation à l'apprentissage automatique, et au niveau micro, sous la forme de projets locaux et de base.

Ensemble, les chercheurs, les militants et les communautés locales peuvent trouver des méthodes pour que l'IA profite à tous.