OpenAI no presentó ningún modelo nuevo en su evento Dev Day, pero las nuevas funciones de la API entusiasmarán a los desarrolladores que quieran utilizar sus modelos para crear aplicaciones potentes.

OpenAI ha pasado unas semanas difíciles, con su CTO, Mira Murati, y otros investigadores principales sumándose a la lista cada vez mayor de antiguos empleados. La empresa se ve cada vez más presionada por otros modelos emblemáticos, incluidos los de código abierto, que ofrecen a los desarrolladores opciones más baratas y muy capaces.

Las nuevas funciones que OpenAI presentó fueron la API en tiempo real (en fase beta), el ajuste de la visión y herramientas de mejora de la eficiencia como el almacenamiento en caché y la destilación de modelos.

API en tiempo real

La API en tiempo real es la novedad más interesante, aunque en fase beta. Permite a los desarrolladores crear experiencias de voz a voz de baja latencia en sus aplicaciones sin necesidad de utilizar modelos separados para el reconocimiento de voz y la conversión de texto a voz.

Con esta API, los desarrolladores ya pueden crear aplicaciones que permitan conversaciones en tiempo real con IA, como asistentes de voz o herramientas de aprendizaje de idiomas, todo ello a través de una única llamada a la API. No es una experiencia tan fluida como la que ofrece el modo de voz avanzado de GPT-4o, pero casi.

Pero no es barato: aproximadamente $0,06 por minuto de entrada de audio y $0,24 por minuto de salida de audio.

La nueva API en tiempo real de OpenAI es increíble...

Mira cómo pide 400 fresas llamando a la tienda con twillio. Todo con la voz. 🍓🎤 pic.twitter.com/J2BBoL9yFv

- Ty (@FieroTy) 1 de octubre de 2024

Ajuste de la visión

El ajuste fino de la visión dentro de la API permite a los desarrolladores mejorar la capacidad de sus modelos para comprender imágenes e interactuar con ellas. Al ajustar GPT-4o mediante imágenes, los desarrolladores pueden crear aplicaciones que destacan en tareas como la búsqueda visual o la detección de objetos.

Esta función ya está siendo aprovechada por empresas como Grab, que mejoró la precisión de su servicio de cartografía afinando el modelo para reconocer las señales de tráfico a partir de imágenes a pie de calle.

OpenAI también dio un ejemplo de cómo GPT-4o podría generar contenido adicional para un sitio web después de haber sido ajustado para que coincidiera estilísticamente con el contenido existente del sitio.

Caché de avisos

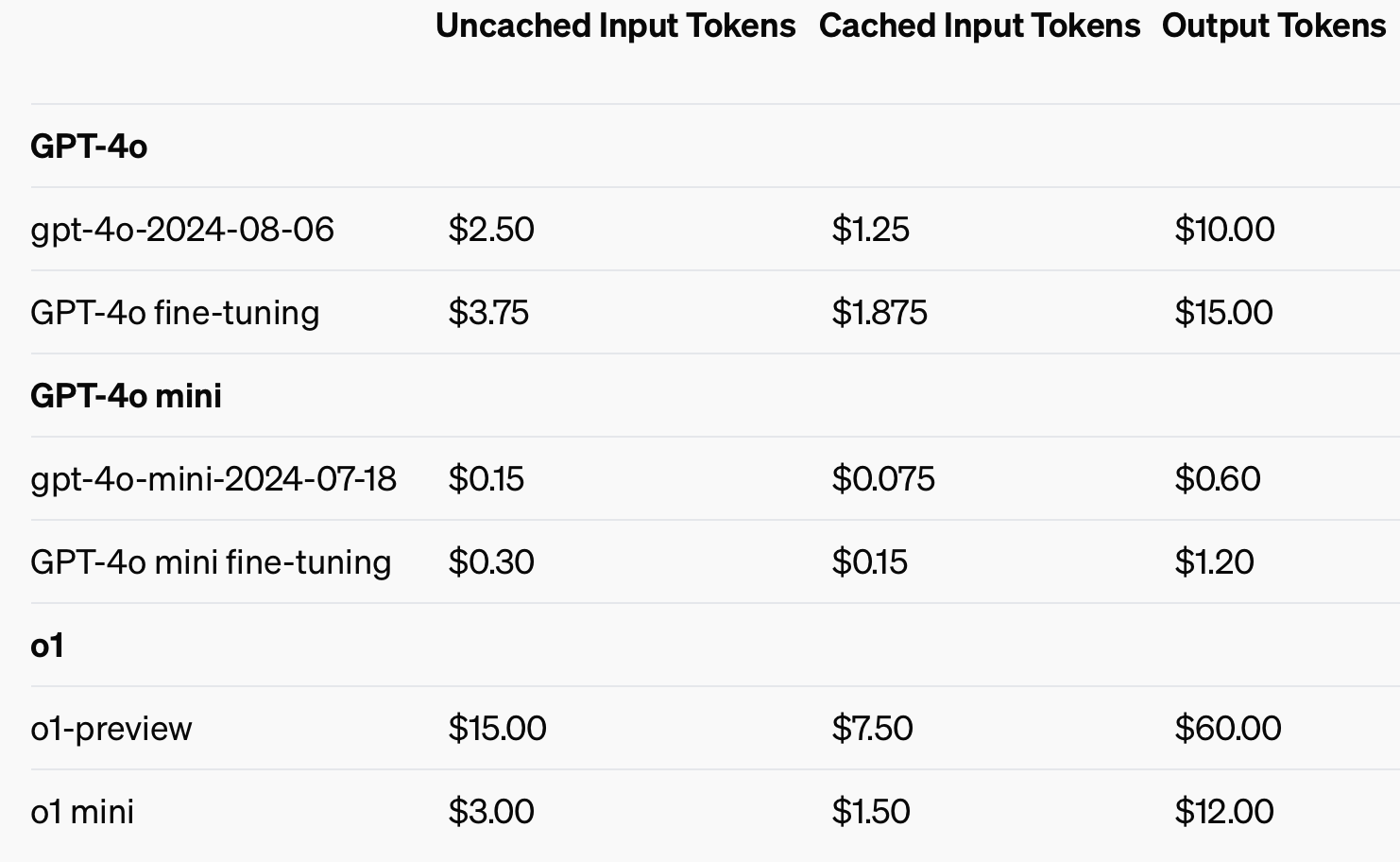

Para mejorar la eficiencia de costes, OpenAI introdujo el caché de solicitudes, una herramienta que reduce el coste y la latencia de las llamadas a la API utilizadas con frecuencia. Al reutilizar entradas procesadas recientemente, los desarrolladores pueden recortar costes en 50% y reducir los tiempos de respuesta. Esta función es especialmente útil para aplicaciones que requieren largas conversaciones o contextos repetidos, como los chatbots y las herramientas de atención al cliente.

El uso de entradas en caché podría ahorrar hasta 50% en costes de fichas de entrada.

Modelo de destilación

La destilación de modelos permite a los desarrolladores afinar modelos más pequeños y rentables utilizando los resultados de modelos más grandes y capaces. Esto cambia las reglas del juego, porque antes la destilación requería múltiples pasos y herramientas desconectadas, lo que la convertía en un proceso lento y propenso a errores.

Antes de la función integrada Model Distillation de OpenAI, los desarrolladores tenían que orquestar manualmente distintas partes del proceso, como la generación de datos a partir de modelos más grandes, la preparación de conjuntos de datos de ajuste fino y la medición del rendimiento con diversas herramientas.

Ahora, los desarrolladores pueden almacenar automáticamente pares de resultados de modelos más grandes, como GPT-4o, y utilizarlos para ajustar modelos más pequeños, como GPT-4o-mini. Todo el proceso de creación, ajuste y evaluación de conjuntos de datos puede realizarse de forma más estructurada, automatizada y eficiente.

La agilización del proceso de desarrollo, la menor latencia y la reducción de costes harán del modelo GPT-4o de OpenAI una perspectiva atractiva para los desarrolladores que deseen implantar aplicaciones potentes con rapidez. Será interesante ver qué aplicaciones permiten las funciones multimodales.