La IA tiene infinidad de usos, pero una de sus aplicaciones más preocupantes es la creación de medios de comunicación falsos y desinformación profunda.

Un nuevo estudiar de Google DeepMind y Rompecabezas, una incubadora tecnológica de Google que vigila las amenazas sociales, analizó el uso indebido de la IA entre enero de 2023 y marzo de 2024.

El estudio evaluó unos 200 incidentes reales de uso indebido de la IA y reveló que la forma más común de uso malintencionado de la IA es la creación y difusión de medios de comunicación engañosos y falsos, especialmente los dirigidos a políticos y personalidades públicas.

Los "deep fakes", medios sintéticos generados mediante algoritmos de inteligencia artificial para crear imágenes, vídeos y audio falsos pero de gran realismo, son cada vez más reales y omnipresentes.

Incidentes como cuando imágenes falsas explícitas de Taylor Swift aparecidas en X demostraron que tales imágenes pueden llegar a millones de personas antes de ser borradas.

Pero lo más insidioso son las falsificaciones profundas dirigidas a cuestiones políticas, como el conflicto entre Israel y Palestina. En algunos casos, ni siquiera los verificadores de hechos encargados de etiquetarlos como "generados por IA" pueden detectar con fiabilidad su autenticidad.

El estudio de DeepMind recopiló datos de diversas fuentes, como plataformas de redes sociales como X y Reddit, blogs en línea e informes de los medios de comunicación.

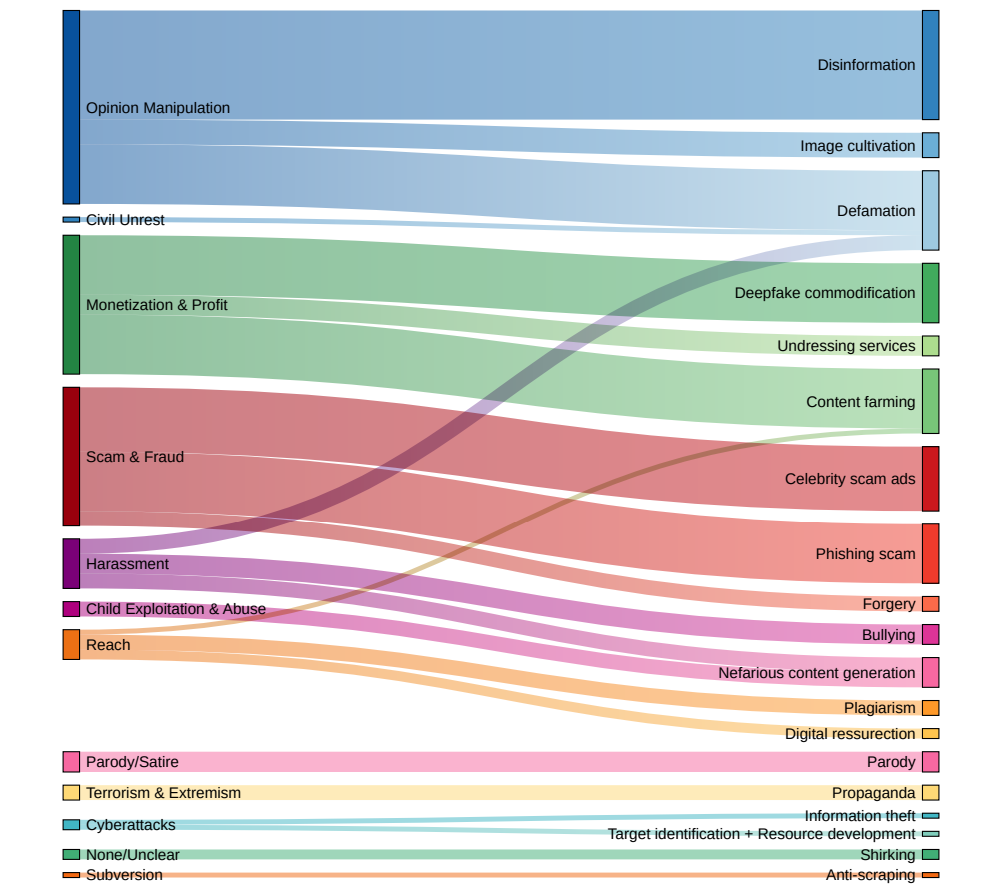

Cada incidente se analizó para determinar el tipo específico de tecnología de IA utilizada indebidamente, el objetivo perseguido y el nivel de conocimientos técnicos necesarios para llevar a cabo la actividad maliciosa.

Las falsificaciones profundas son la forma dominante de uso indebido de la IA

Los resultados ofrecen una imagen alarmante del panorama actual del uso malintencionado de la IA:

- Las falsificaciones profundas se convirtieron en la forma dominante de uso indebido de la IA, con casi el doble de incidentes que la siguiente categoría más frecuente.

- El segundo tipo de abuso de IA observado con más frecuencia fue el uso de modelos lingüísticos y chatbots para generar y difundir desinformación en línea. Al automatizar la creación de contenidos engañosos, los malos actores pueden inundar las redes sociales y otras plataformas con noticias falsas y propaganda a una escala sin precedentes.

- Influir en la opinión pública y en la narrativa política fue la motivación principal de más de una cuarta parte (27%) de los casos de uso indebido de IA analizados. Esto ilustra la amenaza que las falsificaciones profundas y la desinformación generada por IA suponen para los procesos democráticos y la integridad de las elecciones en todo el mundo, que hemos observado desde incidentes recientes de gran repercusión.

- El beneficio económico se identificó como el segundo motor más común de la actividad de IA maliciosa, con actores sin escrúpulos que ofrecen servicios de pago para crear falsificaciones profundas, incluidas imágenes explícitas no consentidas, y que aprovechan la IA generativa para producir en masa contenidos falsos con fines lucrativos.

- En la mayoría de los incidentes de uso indebido de la IA se utilizaron herramientas y servicios de fácil acceso que requerían unos conocimientos técnicos mínimos para su funcionamiento. Esta baja barrera de entrada amplía enormemente el abanico de posibles actores maliciosos, facilitando más que nunca que individuos y grupos se dediquen al engaño y la manipulación basados en IA.

La Dra. Nahema Marchal, de DeepMind, explicó el cambiante panorama del uso indebido de la IA al Financial Times: "Había una gran preocupación comprensible en torno a los ciberataques bastante sofisticados facilitados por estas herramientas", continuando, "Vimos usos indebidos bastante comunes de GenAI [como falsificaciones profundas que] podrían pasar un poco más desapercibidas."

Los responsables políticos, las empresas tecnológicas y los investigadores deben trabajar juntos para desarrollar estrategias integrales para detectar y contrarrestar los deepfakes, la desinformación generada por IA y otras formas de uso indebido de la IA.

Pero lo cierto es que ya lo han intentado, y en gran medida han fracasado. Recientemente, hemos observado más incidentes de niños atrapados en falsos incidentesque demuestran que el daño social que infligen puede ser grave.

En la actualidad, las empresas tecnológicas no pueden detectar de forma fiable las falsificaciones a gran escala, y con el tiempo serán cada vez más realistas y difíciles de detectar.

Y cuando aterricen sistemas de conversión de texto en vídeo como Sora, de OpenAI, habrá que hacer frente a toda una nueva dimensión de falsificaciones profundas.