Hemos entrado de lleno en una era en la que no se puede confiar en lo que se ve en Internet.

Aunque esta afirmación ha sido parcialmente cierta durante décadas, la IA ha elevado la manipulación de contenidos a nuevos niveles, superando con creces la concienciación pública.

La tecnología de falsificación profunda de la IA puede crear y alterar imágenes, vídeos y grabaciones de audio, poniendo palabras en boca de personajes públicos o haciéndoles aparecer en situaciones que nunca ocurrieron.

En muchos casos, se necesita más de un segundo vistazo para determinar la autenticidad de un contenido, y los medios falsos pueden acumular millones de impresiones antes de ser identificados.

Ahora estamos siendo testigos de falsificaciones profundas que potencialmente pueden interrumpir los procesos democráticos, aunque es demasiado pronto para medir impactos tangibles en el comportamiento electoral.

Examinemos algunos de los incidentes más notables de falsificación profunda de IA política que hemos presenciado hasta la fecha.

Joe Biden Incidente en New Hampshire

Enero 2024, A New Hampshire, US, a robocall imitando la voz de Biden animó a los votantes a "guardar su voto para las elecciones de noviembre", sugiriendo erróneamente que participar en las primarias beneficiaría inadvertidamente a Donald Trump.

Se atribuyó a Kathy Sullivan, ex presidenta estatal del Partido Demócrata, un número de teléfono móvil personal. Sullivan condenó el acto como una forma flagrante de interferencia electoral y acoso personal.

La Fiscalía General de New Hampshire afirmó que se trataba de un intento ilegal de perturbar las primarias presidenciales y suprimir la participación electoral.

Se identificó que el audio fabricado se había generado con ElevenLabs, líder del sector en síntesis de voz.

ElevenLabs suspendió posteriormente al culpable de la falsa voz de Biden y afirmó: "Nos dedicamos a prevenir el uso indebido de las herramientas de IA de audio y nos tomamos muy en serio cualquier incidente de uso indebido".

El Canciller alemán Olaf Scholz profundiza en el falso incidente

En noviembre de 2023, Alemania fue testigo de un deep fake de AI en el que se mostraba falsamente al canciller Olaf Scholz apoyando la prohibición del partido de extrema derecha Alternativa para Alemania (AfD).

Este vídeo profundamente falso formaba parte de una campaña de un grupo de arte-activismo, el Centro de Belleza Política (CPB)y pretende llamar la atención sobre la creciente influencia de la AfD. Las críticas a la AfD se enmarcan en la historia alemana de los años treinta.

Dirigido por el filósofo y artista Philipp Ruch, el grupo CPB pretende crear "poesía política" y "belleza moral", abordando temas contemporáneos clave como las violaciones de los derechos humanos, la dictadura y el genocidio.

La CPB ha participado en numerosos proyectos controvertidos, como el Instalación "Search for Us" cerca del Bundestagque, según ellos, contenía tierra de antiguos campos de exterminio y restos de víctimas del Holocausto.

Aunque el apoyo a la AfD ha crecido, numerosas protestas en toda Alemania demuestran una fuerte oposición a las ideologías de la AfD.

Un portavoz del grupo que está detrás del deep fake declaró: "A nuestros ojos, el extremismo de derechas de Alemania que se sienta en el Parlamento es más peligroso."

Los responsables de la AfD calificaron la campaña de deep fake de táctica engañosa destinada a desacreditar al partido e influir en la opinión pública.

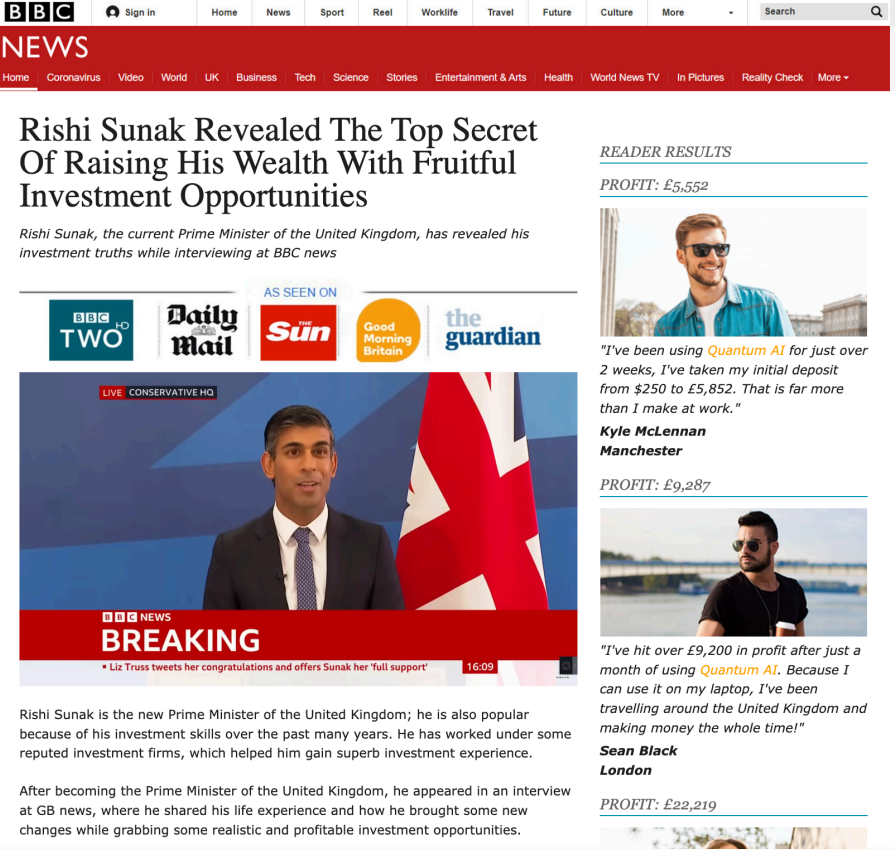

El primer ministro británico Rishi Sunak, implicado en estafas

En enero de 2024, una empresa de investigación británica descubrió que el PM Rishi Sunak estaba implicado en más de 100 anuncios de vídeo engañosos difundidos principalmente en Facebook, que llegaron a unas 400.000 personas.

Estos anuncios, procedentes de varios países, entre ellos Estados Unidos, Turquía, Malasia y Filipinas, promocionaban planes de inversión fraudulentos falsamente asociados a figuras de alto perfil como Elon Musk.

El estudio, realizado por la empresa de comunicación en línea empresa Fenimore HarperEl informe de la Comisión Europea sobre el uso de las redes sociales en los medios de comunicación destaca que las empresas de medios sociales no están respondiendo a este tipo de contenido en un plazo razonable.

Marcus Beard, fundador de Fenimore Harper, explicó cómo la IA democratiza la desinformación: "Con la llegada de la clonación facial y de voz barata y fácil de usar, se necesitan muy pocos conocimientos y experiencia para utilizar el parecido de una persona con fines maliciosos."

Beard también criticó la inadecuación de la moderación de contenidos en las redes sociales, señalando: "Estos anuncios van en contra de varias de las políticas publicitarias de Facebook. Sin embargo, muy pocos de los anuncios que encontramos parecen haber sido retirados".

El gobierno británico respondió al riesgo de falsificaciones profundas fraudulentas: "Estamos trabajando intensamente en todo el gobierno para asegurarnos de que estamos preparados para responder rápidamente a cualquier amenaza a nuestros procesos democráticos a través de nuestro grupo de trabajo de defensa de la democracia y equipos gubernamentales dedicados".

El Primer Ministro de Pakistán, Imran Khan, aparece en un mitin virtual

En diciembre de 2023, el ex primer ministro de Pakistán, Imran Khan, actualmente encarcelado acusado de filtrar secretos de Estado, apareció en un mitin virtual gracias a la IA.

A pesar de estar entre rejas, el avatar digital de Khan fue notablemente seguido por millones de personas. El mitin contenía imágenes de discursos anteriores de su partido político, Pakistan Tehreek-e-Insaaf (PTI).

El discurso de Khan, de cuatro minutos de duración, habló de resistencia y desafío frente a la represión política que sufren los miembros del PTI.

articuló la voz AI: "A nuestro partido no se le permite celebrar mítines públicos. Secuestran a los nuestros y acosan a sus familias", y continuó: "La historia recordará vuestros sacrificios".

Confundiendo la situación, el gobierno pakistaní intentó supuestamente bloquear el acceso a la manifestación.

NetBlocks, una organización de vigilancia de Internet, declaró: "Las mediciones muestran que las principales plataformas de medios sociales estuvieron restringidas en Pakistán durante [casi] 7 horas el domingo por la noche durante una reunión política en línea; el incidente coincide con casos anteriores de censura de Internet dirigida contra el líder de la oposición Imran Khan y su partido PTI".

ℹ️ ICYMI: Las métricas muestran que las principales plataformas de medios sociales fueron restringidas en #Pakistán durante unas 7 horas el domingo por la noche durante una reunión política en línea; el incidente es coherente con casos anteriores de censura en Internet contra el líder de la oposición Imran Khan y su partido PTI https://t.co/AS9SdfwqoH pic.twitter.com/XXMYBhknXd

- NetBlocks (@netblocks) 18 de diciembre de 2023

Usama Khilji, defensor de la libertad de expresión en Pakistán, comentó: "En plena represión del derecho a la libertad de asociación y expresión del PTI mediante detenciones de sus dirigentes, el uso por el partido de la inteligencia artificial para emitir un discurso virtual con las palabras de su presidente encarcelado y ex primer ministro Imran Khan marca un nuevo punto en el uso de la tecnología en la política pakistaní."

Audio falso del ex presidente sudanés Omar al-Bashir en TikTok

Una campaña impulsada por IA en TikTok explotó la voz de ex presidente sudanés Omar al-Bashir en medio de la actual agitación civil del país.

Desde finales de agosto de 2023, una cuenta anónima publica lo que dice ser "grabaciones filtradas" de al-Bashir. Sin embargo, los analistas determinaron que las grabaciones eran falsificaciones generadas por IA.

al-Bashir" ha estado ausente de la escena pública desde que fue expulsado del país en 2019 debido a graves acusaciones de crímenes de guerra.

La estafa del audio del día de las elecciones en Eslovaquia

El día de las elecciones eslovacas, se difundió un polémico audio en el que se escuchaba a Michal Šimečka, líder del partido Eslovaquia Progresista, y a la periodista Monika Tódová hablando de prácticas corruptas como la compra de votos.

Estos hechos salieron a la luz durante el apagón mediático previo a las elecciones en Eslovaquia, por lo que las personas implicadas no pudieron desmentir públicamente su implicación antes de tiempo.

Ambas partes implicadas denunciaron posteriormente la grabación como una falsificación profundalo que confirmó una agencia de verificación de hechos.

Falsificación profunda de Volodymyr Zelenskiy

En 2023, un vídeo falso del presidente ucraniano, Volodymyr Zelenskiy, que sugería de forma poco profesional que estaba llamando a los soldados a abandonar sus puestos, fue rápidamente identificado como falso y retirado por las principales plataformas de redes sociales.

Las elecciones turcas, un falso drama

En vísperas de las elecciones parlamentarias y presidenciales de Turquía, se difundió por Internet un vídeo en el que se mostraba falsamente al principal contrincante del presidente Recep Tayyip Erdoğan, Kemal Kılıçdaroğlu, recibiendo apoyo del PKK.

Donald Trump falsificaciones profundas

A principios de 2023, asistimos a falsificaciones profundas de aspecto realista de la detención de Donald Trump y a un vídeo de campaña de Ron DeSantis con imágenes generadas por IA de Trump abrazando a Anthony Fauci.

Falsedad profunda de Trump en un partido político belga

Un incidente anterior en 2018 en Bélgica causó revuelo político cuando un profundo vídeo falso creado por un partido político provocó una protesta pública.

El vídeo presentaba falsamente al presidente Donald Trump aconsejando a Bélgica que se retirara del acuerdo climático de París.

El vídeo formaba parte de una falsificación de alta tecnología, reconocida posteriormente por el equipo de prensa del partido. Demostró hasta qué punto pueden utilizarse falsificaciones profundas para fabricar declaraciones de líderes mundiales con el fin de influir en la opinión pública y la política.

Falsedad profunda de Nancy Pelosi

Un vídeo manipulado de Nancy Pelosi en 2020, hecho para que pareciera que arrastraba las palabras y estaba intoxicada, se difundió rápidamente en las redes sociales.

Esto demostró el potencial de las falsificaciones profundas para desacreditar y avergonzar a figuras públicas, que a menudo persiste después de que el contenido se considere falso.

Audio deepfake de Keir Starmer

Otro incidente en la política británica fue un clip de audio en el que supuestamente se escuchaba al líder de la oposición, Sir Keir Starmer, insultando a su personal.

El clip, ampliamente difundido en las redes sociales, se reveló más tarde como una falsificación profunda generada por IA.

A medida que las empresas tecnológicas exploren formas de hacer frente a las falsificaciones a gran escala, los modelos de IA utilizados para crear medios falsos serán cada vez más sofisticados y fáciles de usar.

El camino que queda por recorrer exige un esfuerzo de colaboración entre tecnólogos, responsables políticos y ciudadanos para aprovechar las ventajas de la IA y salvaguardar al mismo tiempo los pilares de confianza e integridad de nuestra sociedad.

La confianza en la política y las instituciones públicas ya es, cuando menos, endeble. Las falsificaciones profundas la socavarán aún más.