Amazon und andere Online-Händler werden weiterhin mit KI-generierten Büchern überschwemmt. Die Belletristik mag passabel sein, aber einige der Selbsthilfe- und Ratgeberbücher könnten sogar tödlich sein.

Die New York Mycological Society hat vor kurzem eine öffentliche Bekanntmachung auf X veröffentlicht, um vor den möglichen Folgen von mutmaßlich durch KI erstellten Büchern über Pilzsuche zu warnen.

Es ist bekanntlich schwierig, essbare Pilze von solchen zu unterscheiden, die Sie heftig krank machen oder sogar töten können. Wenn Sie nicht die Methode "Versuch und Irrtum" bevorzugen, ist ein zuverlässiger Führer unerlässlich.

Eine schnelle Suche auf Amazon nach Büchern über die Identifizierung von Speisepilzen" liefert etwa 2.000 Ergebnisse, von denen viele zweifellos von Experten geschrieben wurden.

Eine Reihe der im Selbstverlag erschienenen Titel tragen die Namen von Autoren, die außerhalb von Amazon nicht zu finden sind. Viele von ihnen wurden auch erst veröffentlicht, nachdem KI-Schreibwerkzeuge wie ChatGPT ins Leben gerufen wurden.

🚨: PSA-Alarm!

🔗: Link in Bio@Amazon und andere Einzelhandelsgeschäfte wurden mit Büchern über die Suche und Identifizierung von KI überschwemmt.Bitte kaufen Sie nur Bücher von bekannten Autoren und Sammlern, es kann buchstäblich über Leben und Tod entscheiden. pic.twitter.com/FSqQLDhh42

- newyorkmyc (@newyorkmyc) 27. August 2023

Nach 404 Medien ein paar verdächtige Bücher durch einen KI-Detektor laufen ließ, schien dieser zu bestätigen, dass die Bücher nicht von einem Menschen verfasst wurden. Als sie sich wegen der Titel an Amazon wandten, wurden die Bücher umgehend aus dem Online-Store entfernt. Sie können sich ein Archiv der Buchliste hier.

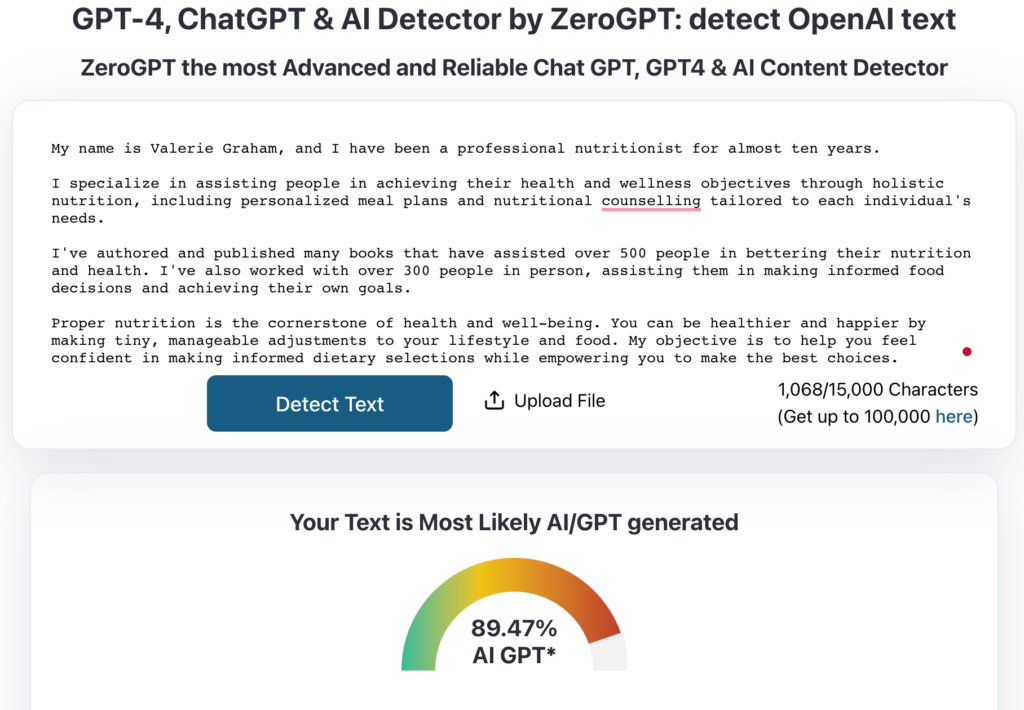

Aber viele weitere Bücher über Pilze bleiben auf Amazon, obwohl sie aussehen, als könnten sie von einer KI geschrieben sein. Wie dieses Buch von einer Autorin namens Valerie Graham. Ihre Bioseite enthielt kein Foto, und wenn man die Bioseite durch ZeroGPT laufen lässt, erhält man ein AI-Ergebnis von 89%.

Quelle: ZeroGPT

Ich bin mir nicht sicher, ob ich "Valerie" trauen würde, mir zu sagen, ob der Pilz, den ich im Wald gefunden habe, sicher zu essen ist.

KI-Tools wie ChatGPT verfügen über Leitplanken, um zu verhindern, dass sie Desinformationen oder gefährliche Ratschläge ausgeben, aber wenn es um die feinen Unterschiede zwischen köstlich und tödlich geht, würde man ihren Fähigkeiten, Pilze zu erkennen, kaum trauen.

Bei Amazon gibt es kein Prüfverfahren für die Fülle der Informationen in den auf dem Marktplatz verkauften Büchern, so dass wahrscheinlich immer wieder Titel wie diese auftauchen werden, die von KI verfasst wurden.

Zu Beginn dieses Jahres berichteten wir über eine AI-Rezeptplaner die Bleiche als Zutat vorschlug. Vor zwei Wochen schlug ein KI-generierter Artikel auf MSN eine Lebensmittelbank in Ottawa als Touristenziel vor.

Es liegt auf der Hand, dass man KI nicht ungeprüft trauen sollte. Das Problem ist, dass die meisten Menschen glauben, dass etwas, das veröffentlicht wird, auch wahr sein muss.

Ein Besuch bei der Lebensmittelbank in Ottawa mag ein unangenehmes Urlaubserlebnis sein, aber einen tödlichen Pilz zu essen, ist eine ganz andere Aussicht.