Willkommen zu den KI-Nachrichten dieser Woche, die von Menschen für Menschen gemacht wurden.

Diese Woche hat uns OpenAI mitgeteilt, dass es ziemlich sicher ist, dass o1 ziemlich sicher ist.

Microsoft hat Copilot einen großen Schub gegeben.

Und ein Chatbot kann Ihren Glauben an Verschwörungstheorien heilen.

Schauen wir genauer hin.

Es ist ziemlich sicher

Wir waren begeistert von der Veröffentlichung der o1-Modelle von OpenAI letzte Woche, bis wir das Kleingedruckte gelesen haben. Die Systemkarte des Modells bietet interessante Einblicke in die Sicherheitstests, die OpenAI durchgeführt hat, und die Ergebnisse könnten einige Augenbrauen aufwerfen.

Es stellt sich heraus, dass o1 schlauer ist, aber auch eher trügerisch mit einer "mittleren" Gefahrenstufe nach dem Bewertungssystem von OpenAI.

Obwohl o1 während der Tests sehr heimtückisch war, sagen OpenAI und seine Red Teamer, dass sie ziemlich sicher sind, dass es sicher genug ist, um es zu veröffentlichen. Nicht so sicher, wenn Sie ein Programmierer auf der Suche nach einem Job sind.

Wenn OpenAIo1 kann passieren OpenAIForschungsingenieur Einstellung Interview für die Codierung - 90% bis 100% Rate...

....... Warum sollten sie dann noch echte Ingenieure für diese Stelle einstellen?

Jedes Unternehmen wird sich diese Frage bald stellen. pic.twitter.com/NIIn80AW6f

- Benjamin De Kraker 🏴☠️ (@BenjaminDEKR) 12. September 2024

Kopiloten-Upgrades

Microsoft entfesselt Copilot "Welle 2" was Ihrer Produktivität und der Produktion von Inhalten einen zusätzlichen KI-Schub geben wird. Wenn Sie noch unschlüssig über die Nützlichkeit von Copilot sind, könnten diese neuen Funktionen den Ausschlag geben.

Die Pages-Funktion und die neuen Excel-Integrationen sind wirklich cool. Die Art und Weise, wie Copilot auf Ihre Daten zugreift, wirft allerdings einige Fragen zum Datenschutz auf.

Mehr Erdbeeren

Wenn Sie bei all dem Gerede über das Erdbeerprojekt von OpenAI Lust auf eine Beere bekommen haben, dann haben Sie Glück.

Forscher haben ein KI-System entwickelt, das verspricht die Art und Weise, wie wir Erdbeeren anbauen, verändern und andere landwirtschaftliche Erzeugnisse.

Diese Open-Source-Anwendung könnte enorme Auswirkungen auf die Lebensmittelverschwendung, die Ernteerträge und sogar auf den Preis haben, den Sie im Laden für frisches Obst und Gemüse zahlen.

Zu leicht

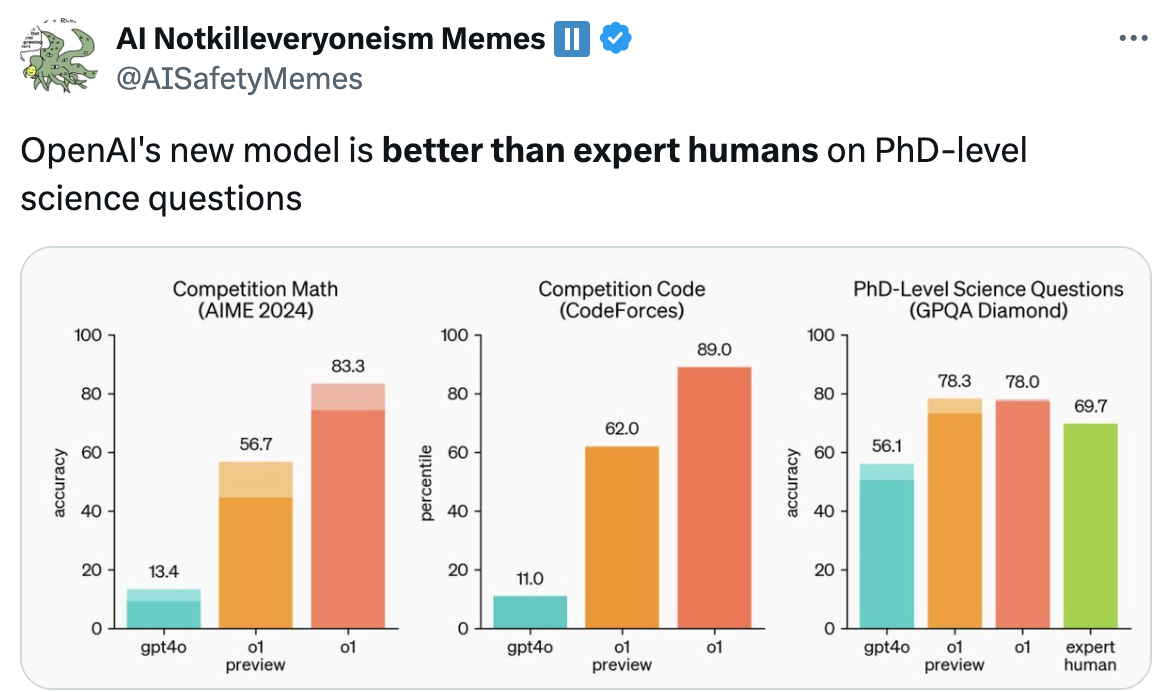

KI-Modelle werden inzwischen so intelligent, dass unsere Benchmarks zu ihrer Messung fast überflüssig sind. Scale AI und CAIS haben ein Projekt mit der Bezeichnung Die letzte Prüfung der Menschheit um dies zu beheben.

Sie möchten, dass Sie schwierige Fragen einreichen, von denen Sie glauben, dass sie führende KI-Modelle überfordern könnten. Wenn eine KI Fragen auf dem Niveau eines Doktors beantworten kann, bekommen wir ein Gefühl dafür, wie nah wir an der Entwicklung von KI-Systemen auf Expertenniveau sind.

Wenn Sie glauben, dass Sie einen guten Tipp haben, können Sie einen Anteil von $500.000 gewinnen. Dazu müssen Sie aber wirklich hart arbeiten.

Heilung von Verschwörungen

Ich liebe gute Verschwörungstheorien, aber einige der Dinge, an die die Leute glauben, sind einfach verrückt. Haben Sie schon einmal versucht, einen Anhänger der flachen Erde mit einfachen Fakten und Argumenten zu überzeugen? Das klappt nicht. Aber was wäre, wenn wir es einen KI-Chatbot versuchen lassen würden?

Die Forscher bauten einen Chatbot mit GPT-4 Turbo und erzielten beeindruckende Ergebnisse bei die Meinung der Menschen über die Verschwörungstheorien zu ändern an die sie glaubten.

Es wirft einige unangenehme Fragen darüber auf, wie überzeugend KI-Modelle sind und wer entscheidet, was "Wahrheit" ist.

Nur weil du paranoid bist, heißt das nicht, dass sie nicht hinter dir her sind.

Cool bleiben

Gehört es zu Ihrem Notfallplan, Ihren Körper kryogenisch einfrieren zu lassen? Wenn ja, wird es Sie freuen zu hören, dass die KI diese verrückte Idee etwas plausibler macht.

Ein Unternehmen namens Select AI verwendete AI soll die Entdeckung von Kälteschutzmitteln beschleunigen. Diese Verbindungen verhindern, dass sich organische Stoffe während des Gefriervorgangs in Kristalle verwandeln.

Im Moment geht es um den besseren Transport und die Lagerung von Blut oder temperaturempfindlichen Medikamenten. Aber wenn die KI ihnen hilft, ein wirklich gutes Kryoprotektionsmittel zu finden, könnte die kryogene Konservierung von Menschen von einer lukrativen Angelegenheit zu einer plausiblen Option werden.

Die KI leistet auch auf andere Weise einen Beitrag zur Medizin, der Sie vielleicht ein wenig nervös macht. Neue Untersuchungen zeigen, dass eine überraschend viele Ärzte wenden sich an ChatGPT um Hilfe bei der Diagnose von Patienten. Ist das eine gute Sache?

Wenn Sie begeistert sind von dem, was in der Medizin passiert, und eine Karriere als Arzt in Erwägung ziehen, sollten Sie das vielleicht noch einmal überdenken, meint dieser Professor.

Dies ist die letzte Warnung für alle, die eine Karriere als Arzt in Betracht ziehen: Die KI ist so weit fortgeschritten, dass der Bedarf an menschlichen Ärzten deutlich zurückgehen wird, insbesondere in den Bereichen der Standarddiagnostik und Routinebehandlungen, die zunehmend durch KI ersetzt werden.... pic.twitter.com/VJqE6rvkG0

- Derya Unutmaz, MD (@DeryaTR_) 13. September 2024

Weitere Nachrichten...

Hier sind einige andere klickwürdige AI-Geschichten, die uns diese Woche gefallen haben:

- Googles Notebook LM verwandelt Ihr geschriebene Inhalte in einen Podcast. Das ist wahnsinnig gut.

- Wenn Japan die der weltweit erste Supercomputer der Zeta-Klasse im Jahr 2030 wird er 1.000-mal schneller sein als der derzeit schnellste Supercomputer der Welt.

- SambaNova stellt das o1-Modell von OpenAI mit einer Open-Source-Demo auf Basis von Llama 3.1 in Frage.

- Mehr als 200 Akteure der Technologiebranche unterzeichnen ein Offener Brief mit der Aufforderung an Gavin Newsom, sein Veto einzulegen das Gesetz SB 1047 über die Sicherheit von AI.

- Gavin Newsom unterzeichnete zwei Gesetzesentwürfe zur lebende und verstorbene Künstler vor KI-Klonen zu schützen.

- Sam Altman verlässt OpenAIder Sicherheitsausschuss um sie "unabhängiger" zu machen.

- OpenAI sagt, dass die Lebenszeichen, die von ChatGPT bei der Gesprächsanbahnung sind nur eine Panne.

- RunwayML startet Gen-3 Alpha Video zu Video Funktion für zahlende Nutzer der App.

Gen-3 Alpha Video to Video ist jetzt im Web für alle kostenpflichtigen Pläne verfügbar. Video to Video stellt einen neuen Kontrollmechanismus für präzise Bewegung, Ausdruckskraft und Absicht innerhalb von Generationen dar. Um Video to Video zu nutzen, laden Sie einfach Ihr Eingangsvideo hoch, geben Sie eine beliebige ästhetische Richtung vor... pic.twitter.com/ZjRwVPyqem

- Startbahn (@runwayml) 13. September 2024

Und das war's dann auch schon.

Es ist nicht überraschend, dass KI-Modelle wie o1 ein größeres Risiko darstellen, je intelligenter sie werden, aber die Heimlichtuerei während der Tests war seltsam. Glauben Sie, dass sich OpenAI an die selbst auferlegten Einschränkungen des Sicherheitsniveaus halten wird?

Das Projekt Humanity's Last Exam war ein Augenöffner. Der Mensch kämpft darum, Fragen zu finden, die so schwierig sind, dass die KI sie lösen kann. Was passiert danach?

Wenn Sie an Verschwörungstheorien glauben, glauben Sie dann, dass ein KI-Chatbot Ihre Meinung ändern könnte? Amazon Echo hört immer zu, die Regierung nutzt Big Tech, um uns auszuspionieren, und Mark Zuckerberg ist ein Roboter. Beweisen Sie mir das Gegenteil.

Lassen Sie uns wissen, was Sie denken, Folgen Sie uns auf Xund schicken Sie uns Links zu coolen KI-Themen, die wir vielleicht verpasst haben.