Jensen Huang, CEO von NVIDIA, nutzte die Eröffnungsrede auf der Computex 2024 in Taiwan, um die Technologie der nächsten Generation und die Roadmap vorzustellen, die das Unternehmen verfolgen wird, um die führende KI-Hardwareplattform zu werden.

Huang stellte neue Chips, schnellere KI-Netzwerke und eine ehrgeizige Entwicklungs-Roadmap vor, die unter dem Motto "Accelerate everything" stand. Von KI-PCs bis hin zu riesigen KI-Fabriken - NVIDIA will der Wegbereiter für die nächsten Schritte in Sachen KI sein.

"Die Zukunft des Computings ist beschleunigt", sagte Huang. "Mit unseren Innovationen in den Bereichen KI und Accelerated Computing verschieben wir die Grenzen des Möglichen und treiben die nächste Welle des technologischen Fortschritts voran."

Hier ein kurzer Überblick über einige der Ankündigungen:

Neue Chips

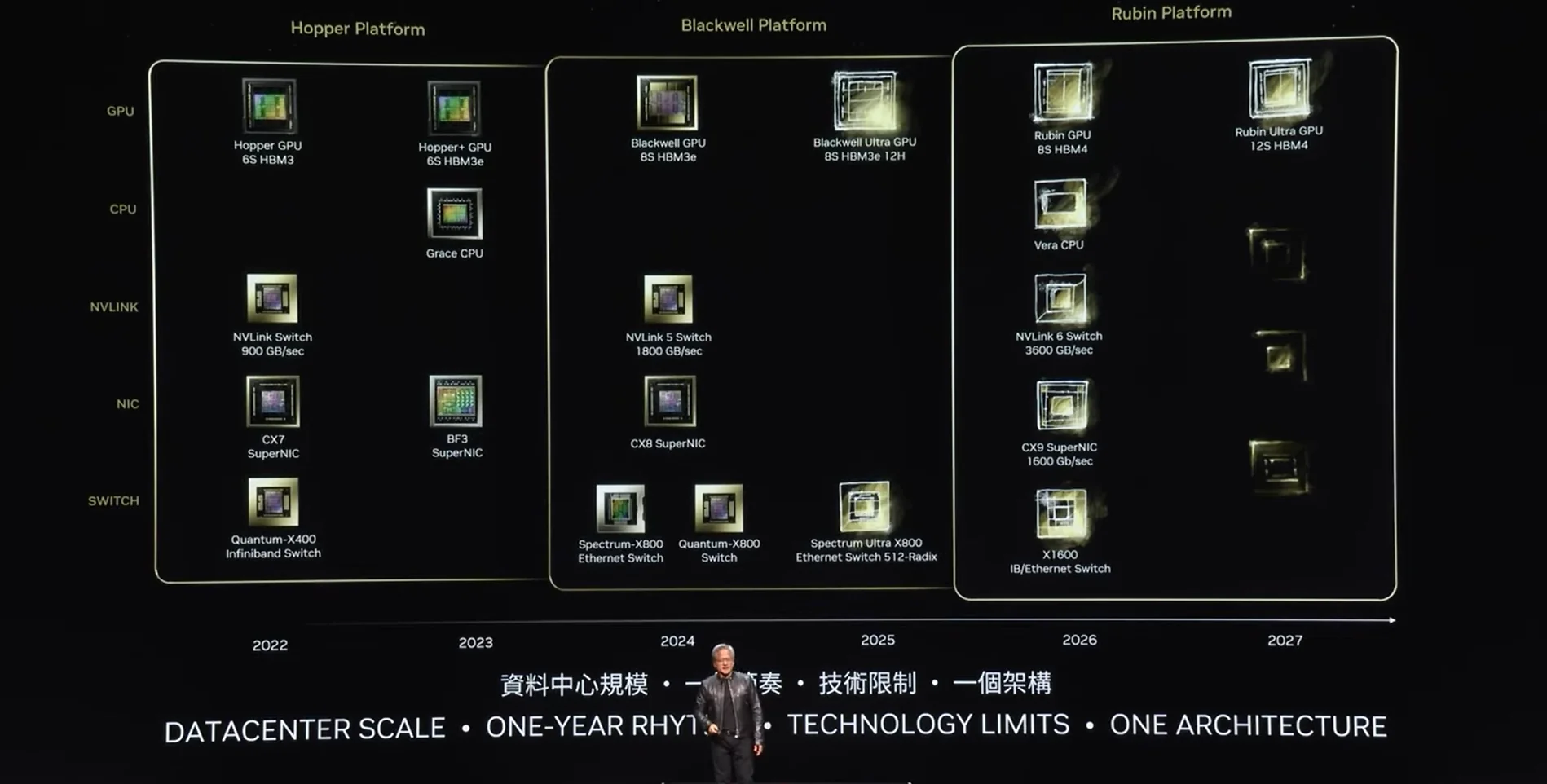

Die Blackwell-GPUs laufen gerade vom Band, aber Huang sagt, dass wir noch in diesem Jahr eine aktualisierte Blackwell Ultra GPU erwarten können. Er sagte, dass NVIDIAs Entwicklungsplan vorsieht, jedes Jahr eine neue Chip-Familie zu veröffentlichen.

"Unser Unternehmen hat einen einjährigen Rhythmus. Unsere Grundphilosophie ist sehr einfach: Wir bauen das gesamte Rechenzentrum auf, zerlegen es und verkaufen Ihnen Teile im Jahresrhythmus und treiben alles an die technologischen Grenzen", erklärt Huang.

Huang kündigte an, dass seine Rubin-Plattform 2026 die Blackwell-GPU-Familie ablösen wird.

KI-Fabriken

Huang nannte mehrere Computing-Firmen, die "KI-Fabriken" bauen werden, die Cloud-, On-Premises-, Embedded- und Edge-KI-Systeme mit NVIDIA-GPUs und Netzwerken bereitstellen werden.

Huang sagte: "Die nächste industrielle Revolution hat begonnen. Unternehmen und Länder arbeiten mit NVIDIA zusammen, um die Billionen Dollar teuren traditionellen Rechenzentren auf beschleunigtes Computing umzustellen und eine neue Art von Rechenzentrum zu bauen - KI-Fabriken - um einen neuen Rohstoff zu produzieren: künstliche Intelligenz."

NVIDIA MGX (Modular Server Reference Architecture) ist eine Blaupause für den Aufbau von Servern in Rechenzentren mit Schwerpunkt auf beschleunigtem Computing. Sie verwendet einen standardisierten Ansatz für den Aufbau von Servern mit NVIDIA-Produkten, was den Aufbau dieser KI-Fabriken erheblich erleichtert.

NVIDIA Spectrum-X

NVIDIA verwendet NVLink, um Daten zwischen GPUs zu übertragen, aber die Übertragung von Daten zwischen GPU-Pods innerhalb oder zwischen Rechenzentren stellt eine zusätzliche Herausforderung dar.

NVIDIA Spectrum-X ist die weltweit erste Ethernet-Netzwerkplattform, die speziell zur Steigerung der Leistung von KI-Workloads entwickelt wurde. Natürlich ist NVIDIA Spectrum-X für die Hardware von NVIDIA optimiert.

Laut NVIDIA beschleunigt Spectrum-X die Leistung generativer KI-Netzwerke um das 1,6-fache gegenüber herkömmlichen Ethernet-Fabrics.

Letzte Woche haben wir berichtet, dass große Tech-Unternehmen an der Entwicklung eines offener Standard für beschleunigte KI-Netzwerke ohne die Mitwirkung von NVIDIA.

Dennoch, so Huang, wird Spectrum-X bereits von Unternehmen wie Dell Technologies, Hewlett Packard Enterprise und Lenovo eingesetzt.

NIM

NVIDIA NIM, die Abkürzung für NVIDIA Inference Microservices, ist eine Reihe von Tools, die den Einsatz von generativen KI-Modellen vereinfachen und beschleunigen sollen.

Bevor Sie ein KI-Modell verwenden können, müssen Entwickler es bereitstellen. Die NVIDIA NIMs vereinfachen die Bereitstellung, indem sie KI-Modelle automatisch containerisieren und für NVIDIA-Hardware optimieren, anstatt sich mit den Details dieses Prozesses auseinanderzusetzen.

Es ist wie der Unterschied zwischen dem Einkaufen, Zerkleinern und Zusammenstellen aller Zutaten für eine Mahlzeit und dem Einschieben eines Fertiggerichts in den Ofen.

Huang kündigte an, dass das Llama 3 NIM jetzt als kostenloser Download für Entwickler zum Ausprobieren verfügbar ist. Huang stellte auch Nvidia Ace NIMs vor, darunter ein Digital Human Modell, das KI-Menschenmodelle mit lebensechter Haut erzeugen kann.

Sie können sich die gesamte Keynote ansehen, um mehr über AI RTX-betriebene PCs und Laptops, Nividias Isaac ROS 3.0 Robotik-Plattform und darüber zu erfahren, wie Fabriken NVIDIAs Technologie nutzen, um digitale Zwillinge in ihren Fabriken zu erstellen und Roboter zu trainieren.