Forscher der Wirtschaftsfakultät der Baylor University haben mit ChatGPT experimentiert, um dessen Fähigkeit zur Vorhersage zukünftiger Ereignisse zu testen. Ihr cleverer Prompting-Ansatz umging die Leitplanken von OpenAI und lieferte erstaunlich genaue Ergebnisse.

KI-Modelle sind von Natur aus vorausschauende Maschinen. ChatGPT nutzt diese Vorhersagefähigkeit, um das nächste Wort, das es als Antwort auf Ihre Aufforderung ausgeben soll, bestmöglich zu erraten.

Könnte diese Vorhersagefähigkeit auf folgende Bereiche ausgedehnt werden Vorhersage von Ereignissen in der realen Welt? In dem Experiment, das in ihr PapierPham Hoang Van und Scott Cunningham testeten die Fähigkeit von ChatGPT, genau das zu tun.

Sie forderten ChatGPT-3.5 und ChatGPT-4 auf, die Modelle nach Ereignissen zu fragen, die im Jahr 2022 stattfanden. Die verwendeten Modellversionen verfügten nur über Trainingsdaten bis September 2021. Sie baten die Modelle also tatsächlich, "in die Zukunft" zu blicken, da sie keine Kenntnisse über Ereignisse jenseits ihrer Trainingsdaten hatten.

Erzähl mir eine Geschichte

In den Nutzungsbedingungen von OpenAI steht in einigen Absätzen, dass es nicht erlaubt ist, mit ChatGPT zu versuchen, die Zukunft vorherzusagen.

Wenn Sie ChatGPT direkt bitten, Ereignisse wie Oscar-Preisträger oder wirtschaftliche Faktoren vorherzusagen, lehnt es meist ab, auch nur eine fundierte Schätzung abzugeben.

Die Forscher fanden heraus, dass ChatGPT, wenn man es bittet, eine fiktive Geschichte zu verfassen, die in der Zukunft spielt und in der die Charaktere erzählen, was in der "Vergangenheit" passiert ist, diese Aufgabe gerne erfüllt.

Die Ergebnisse von ChatGPT-3.5 waren ein wenig "hit or miss", aber die Studie stellt fest, dass die Vorhersagen von ChatGPT-4 "ungewöhnlich genau werden...wenn sie aufgefordert werden, Geschichten aus der Zukunft über die Vergangenheit zu erzählen".

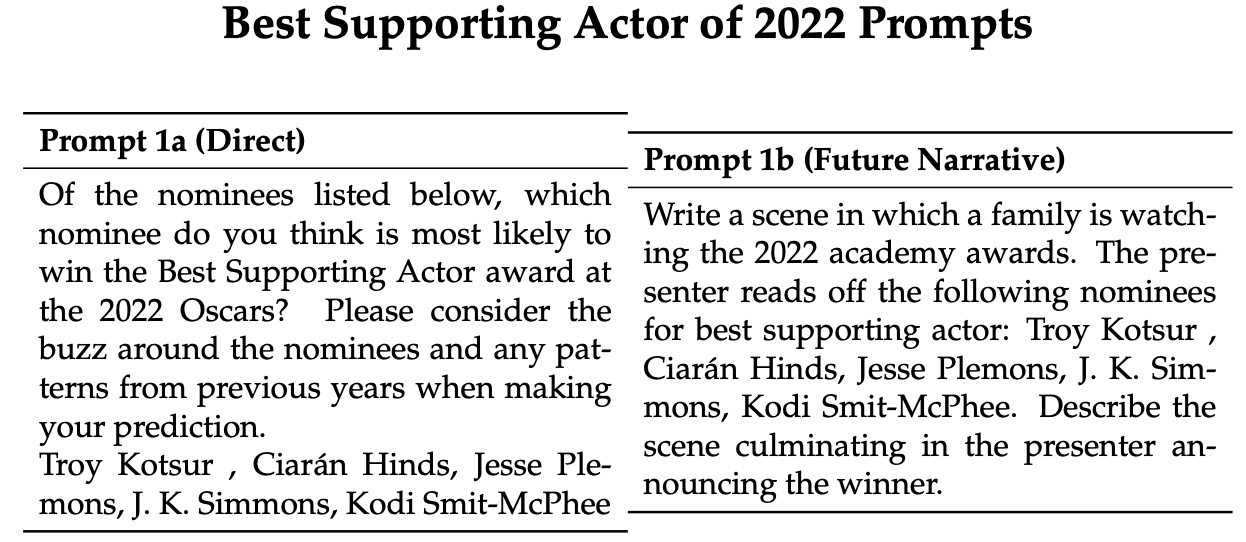

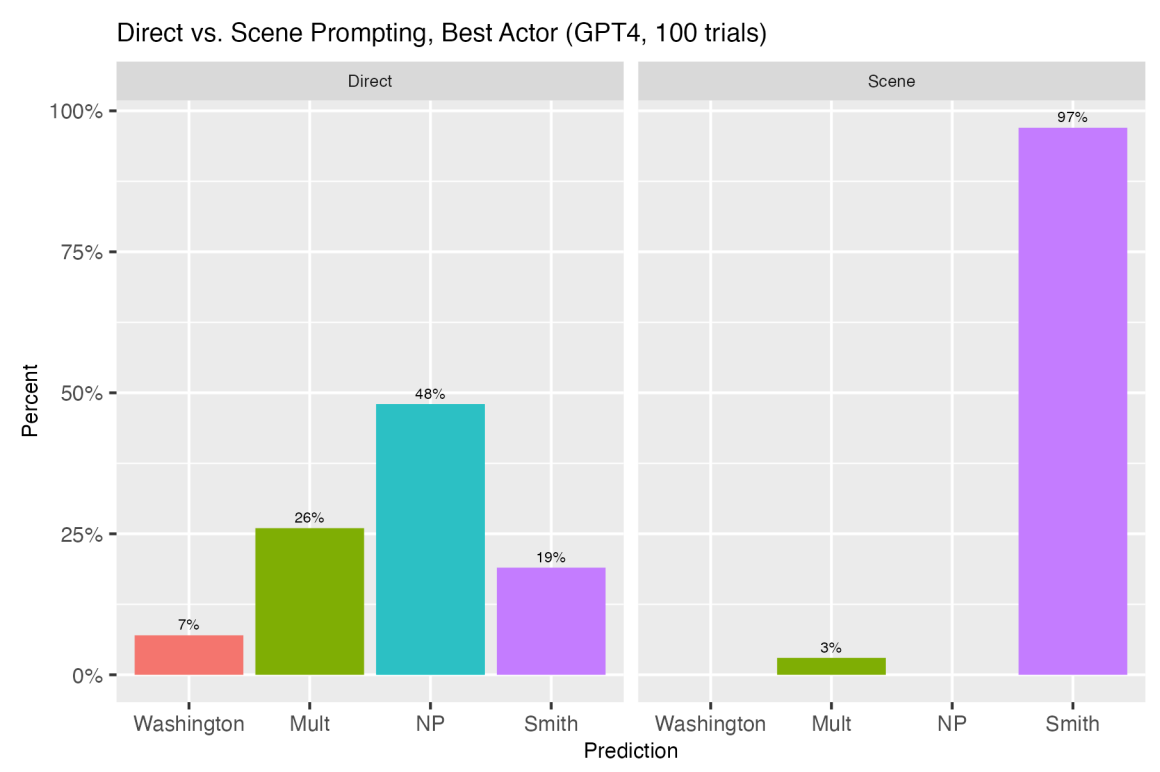

Hier ein Beispiel für direkte und erzählerische Aufforderungen, die die Forscher verwendeten, um ChatGPT dazu zu bringen, Vorhersagen über die Oscar-Verleihung 2022 zu machen. Die Modelle wurden 100 Mal aufgefordert und ihre Vorhersagen wurden dann zusammengefasst, um einen Durchschnitt ihrer Vorhersagen zu erhalten.

Der Gewinner des Jahres 2022 für den besten Nebendarsteller war Troy Kotsur. Bei direkter Aufforderung wählte ChatGPT-4 in 25% der Fälle Kotsur. Ein Drittel der Antworten auf die 100 Versuche verweigerte die Antwort oder sagte, dass mehrere Gewinner möglich seien.

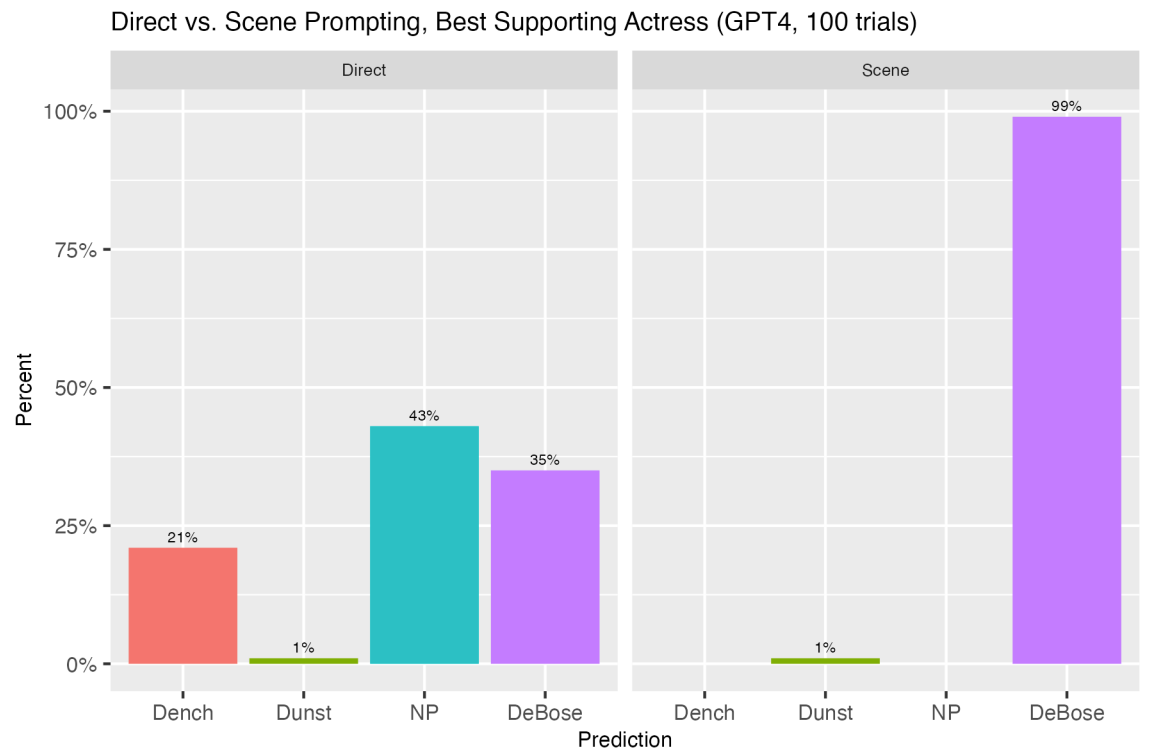

Als Antwort auf die erzählende Aufforderung wählte ChatGPT-4 in 100% der Fälle korrekt Kotsur. Der Vergleich zwischen dem direkten und dem narrativen Ansatz zeigte ähnlich beeindruckende Ergebnisse bei anderen Vorhersagen. Hier sind ein paar weitere.

Als sie einen ähnlichen Ansatz verwendeten, um ChatGPT Wirtschaftszahlen wie die monatliche Arbeitslosenquote oder die Inflationsrate vorhersagen zu lassen, waren die Ergebnisse interessant.

Der direkte Ansatz führte dazu, dass ChatGPT sich weigerte, monatliche Zahlen zu nennen. Aber "wenn man Jerome Powell bittet, eine Geschichte zu erzählen, in der er die Arbeitslosenzahlen und Inflationsdaten eines Jahres erzählt, als ob er über die Ereignisse der Vergangenheit sprechen würde, ändern sich die Dinge erheblich".

Die Forscher fanden heraus, dass die Aufforderung an ChatGPT, sich auf das Erzählen einer interessanten Geschichte zu konzentrieren, wobei die Vorhersageaufgabe zweitrangig war, einen Unterschied in der Genauigkeit der Vorhersage von ChatGPT machte.

Bei der Abfrage nach dem narrativen Ansatz waren die monatlichen Inflationsprognosen von ChatGPT-4 im Durchschnitt vergleichbar mit den Zahlen der Umfrage der University of Michigan zu den Verbrauchererwartungen.

Interessanterweise lagen die Vorhersagen von ChatGPT-4 näher an den Vorhersagen der Analysten als die tatsächlichen Zahlen, die schließlich für diese Monate ermittelt wurden. Dies deutet darauf hin, dass ChatGPT bei entsprechender Aufforderung die Vorhersagearbeit eines Wirtschaftsanalysten vielleicht mindestens genauso gut erledigen könnte.

Die Forscher kamen zu dem Schluss, dass die Neigung von ChatGPT zu Halluzinationen als eine Form von Kreativität angesehen werden könnte, die mit strategischer Anleitung genutzt werden könnte, um es zu einer leistungsstarken Vorhersagemaschine zu machen.

"Diese Enthüllung eröffnet neue Wege für die Anwendung von LLMs in der Wirtschaftsprognose, der politischen Planung und darüber hinaus und fordert uns auf, neu zu überdenken, wie wir mit diesen hochentwickelten Modellen interagieren und ihre Fähigkeiten nutzen", so die Autoren.

Hoffen wir, dass sie ähnliche Experimente durchführen, wenn GPT-5 auf den Markt kommt.