Meta kündigte die Veröffentlichung von Code Llama an, seinem neuen KI-Tool für das Programmieren.

Code Llama ist eine fein abgestimmte Version von Metas Llama 2 LLM, das für das Schreiben und Dokumentieren von Code trainiert wurde. Das neue Werkzeug nimmt Beschreibungen in natürlicher Sprache und wandelt sie in Code um. Es kann auch Code, der als Input geliefert wird, debuggen, erklären und dokumentieren.

Dies ist ein großartiges Werkzeug, wenn Sie gerade erst programmieren lernen, aber es sind die Software-Ingenieure, die am meisten von Code Llama profitieren werden.

Das Tool unterstützt die meisten gängigen Programmiersprachen, darunter Python, C++, Java, PHP, Typescript (Javascript), C#, Bash und andere.

Mit Code Llama können Sie es bitten, eine Funktion in Python zu schreiben, um die ersten 100 Primzahlen zu berechnen, und es wird den Code für Sie generieren.

Tools wie ChatGPT können bereits Code schreiben, aber Code Llama hat eine Reihe von Funktionen, die es wohl zu einem besseren Programmiertool machen.

ChatGPT hat ein Kontextfenster von 4.000 bis 8.000 Token, während Code Llama bis zu 100.000 Token an Kontext verarbeiten kann. Der erste offensichtliche Vorteil eines größeren Kontextfensters ist, dass wesentlich längerer Code geschrieben werden kann.

Die aufregendere Aussicht ist die Möglichkeit, einen großen Teil des Codes einzugeben und ihn dann von Code Llama debuggen zu lassen. Wenn Sie ChatGPT dafür verwenden wollten, müssten Sie kleine Teile auf einmal debuggen.

Heute veröffentlichen wir Code Llama, ein umfangreiches Sprachmodell, das auf Llama 2 aufbaut, für die Codierung optimiert wurde und den neuesten Stand der Technik für öffentlich verfügbare Codierungswerkzeuge darstellt.

Im Einklang mit unserem offenen Ansatz ist Code Llama jetzt sowohl für die Forschung als auch für die kommerzielle Nutzung öffentlich zugänglich.

Mehr ⬇️

- Meta AI (@MetaAI) August 24, 2023

Meta hat 3 Größen von Code Llama mit jeweils 7B, 13B und 34B Parametern herausgebracht. Die kleineren Modelle laufen schneller, benötigen weniger Rechenleistung, sind aber weniger leistungsfähig als das 34B-Modell.

Die beiden kleineren Modelle wurden auch mit der FIM-Fähigkeit (fill-in-the-middle) trainiert. Damit kann ein Programmierer vorhandenen Code eingeben und Code Llama die Aufgaben der Codevervollständigung übernehmen lassen.

Zusätzlich zu den Basismodellen, die mehrere Sprachen unterstützen, hat Meta zwei Versionen veröffentlicht, die speziell auf Python und Instruct trainiert wurden.

Taugt Code Llama etwas?

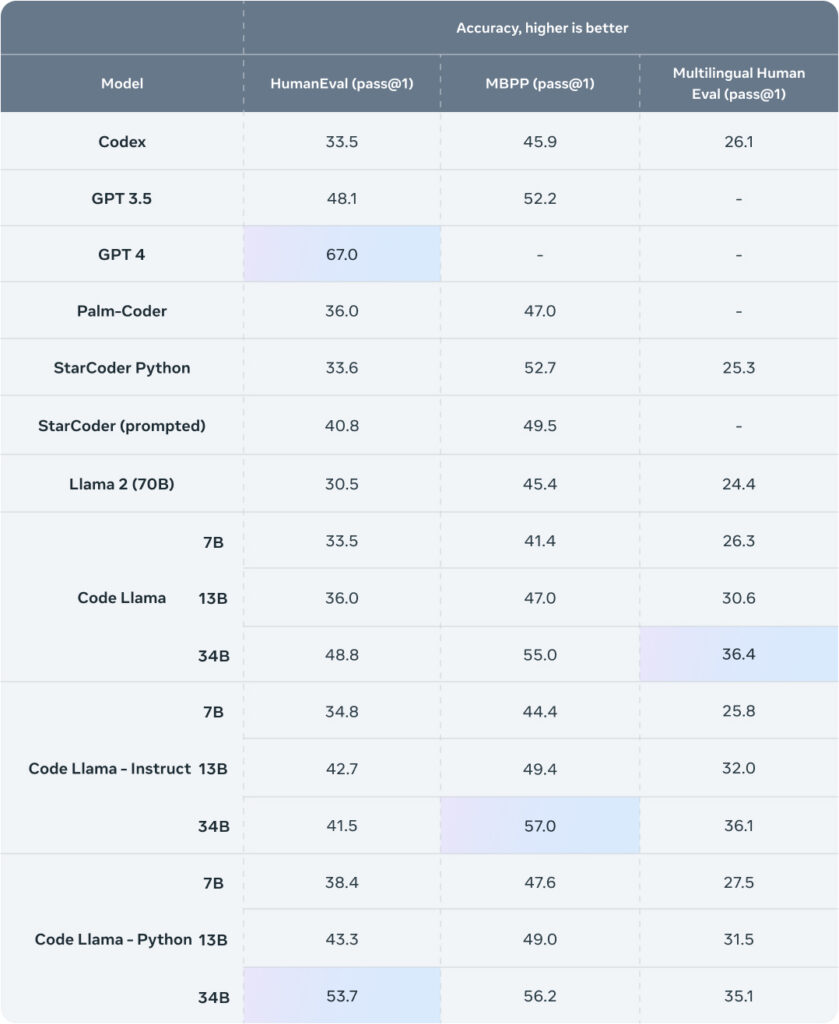

Meta hat eigene Benchmarking-Tests durchgeführt und festgestellt, dass Code Llama "besser abschneidet als quelloffene, code-spezifische LLMs und Llama 2 übertrifft".

Hier ist die Benchmark-Tabelle, die zeigt, wie Code Llama im Vergleich zu anderen Modellen abschneidet.

Quelle: Meta

GPT-4 liegt immer noch mit einigem Abstand vorne, aber es ist ein riesiges Modell, und es ist nicht kostenlos. Code Llama ist kostenlos und die 7B-Version könnte auf Ihrem lokalen Rechner laufen.

Die Verwendung von GPT-4 erfordert, dass Ihr Code über die Server von OpenAI gesendet wird, und für viele Unternehmen stellt dies eine großes Risiko für ihr geistiges Eigentum.

Da Code Llama auf lokalen Servern läuft, besteht kein Risiko, dass private Unternehmensdaten nach außen dringen oder zum Training anderer Modelle verwendet werden.

Zusätzlich zu den freigegebenen Modellen werden die Code Llama Forschungspapier verwies auf ein Modell namens "Unnatural Code Llama". Es erzielte 62,2% im HumanEval-Benchmark, was sehr nahe an den 67% des GPT-4 liegt.

Es ist noch nicht bekannt, wann dieses Modell auf den Markt kommen wird, aber diese Art von Leistung übertrifft Googles PaLM Coder bei weitem und wird sogar den GPT-4 zu einem schwer verkäuflichen Produkt machen.