Stanford- och Google DeepMind-forskare har skapat AI som kan återskapa mänskliga personligheter med kuslig precision efter bara en tvåtimmars konversation.

Genom att intervjua 1.052 personer med olika bakgrund byggde de upp vad de kallar "simuleringsagenter" - digitala kopior som var skrämmande effektiva när det gällde att förutsäga sina mänskliga motsvarigheters övertygelser, attityder och beteenden.

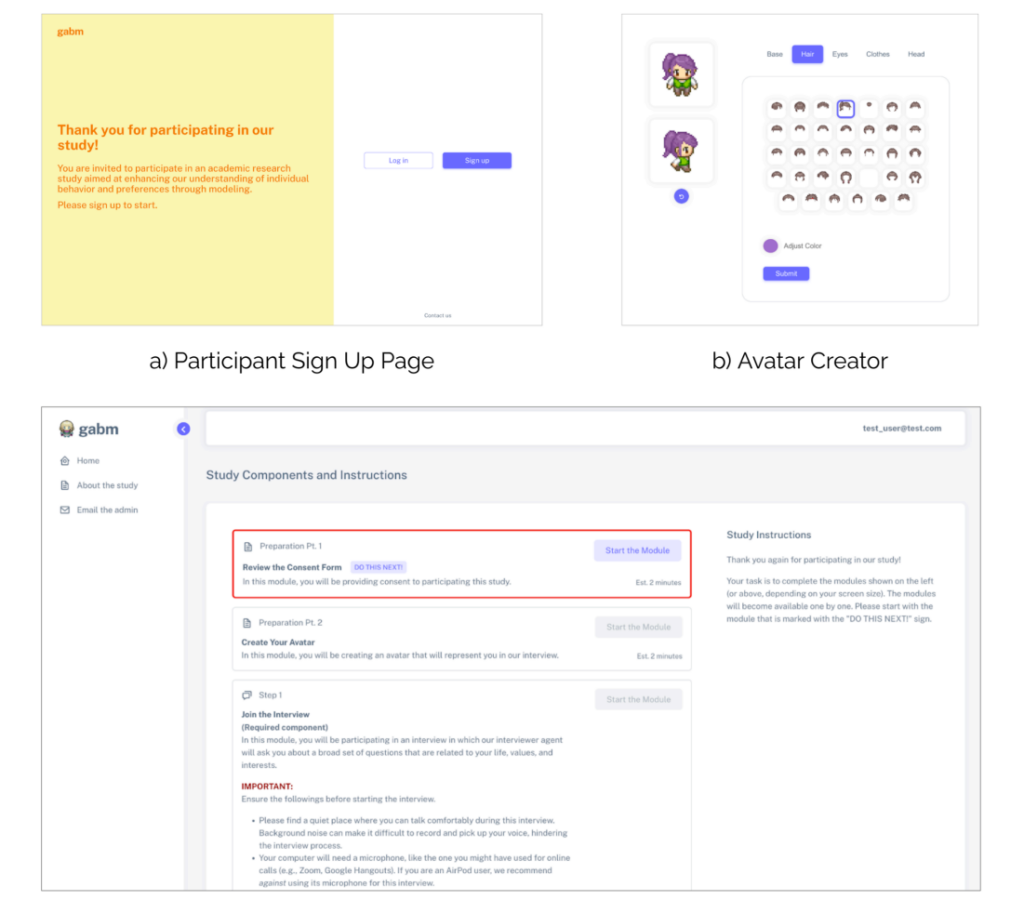

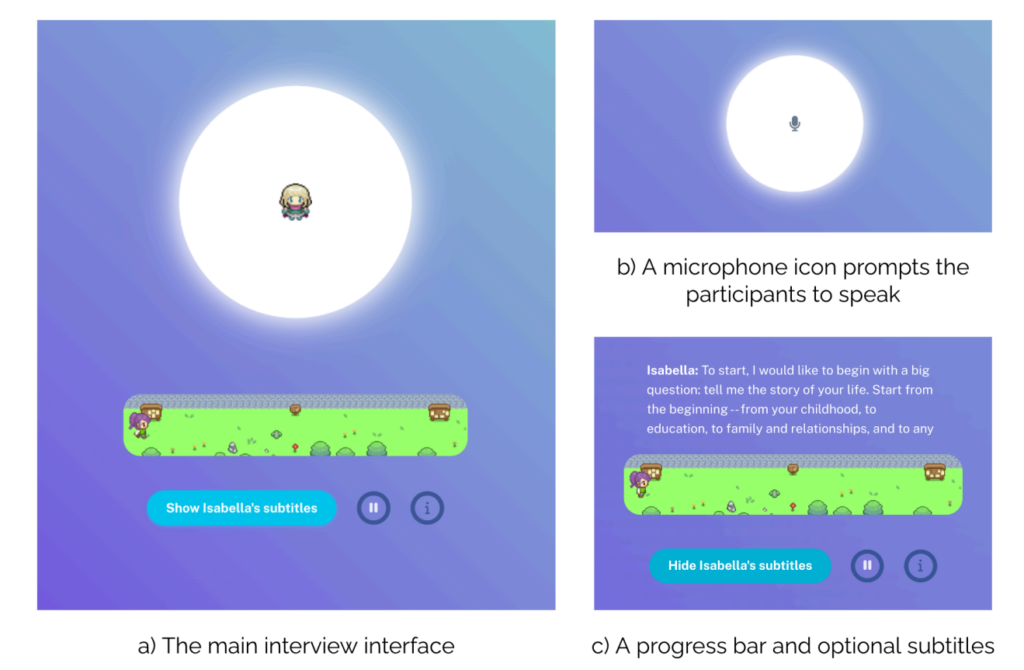

För att skapa de digitala kopiorna använder teamet data från en "AI-intervjuare" som är utformad för att engagera deltagarna i naturliga samtal.

AI-intervjuaren ställer frågor och genererar personliga följdfrågor - i genomsnitt 82 per session - som utforskar allt från barndomsminnen till politiska åsikter.

Under de två timmar långa diskussionerna gjorde varje deltagare detaljerade utskrifter på i genomsnitt 6.500 ord.

När en deltagare till exempel nämner sin barndoms hemstad kan AI:n gå djupare och fråga om specifika minnen eller upplevelser. Genom att simulera ett naturligt samtalsflöde fångar systemet upp nyanserad personlig information som standardundersökningar tenderar att hoppa över.

Bakom kulisserna har studie dokumenterar vad forskarna kallar "expertreflektion" - och uppmanar stora språkmodeller (LLM) att analysera varje konversation ur fyra olika professionella synvinklar:

- Som psykolog identifierar den specifika personlighetsdrag och känslomönster - till exempel genom att notera hur någon värdesätter självständighet utifrån sina beskrivningar av familjerelationer.

- Genom en beteendeekonomisk lins får man insikter om ekonomiskt beslutsfattande och risktolerans, till exempel hur de ser på sparande eller karriärval.

- Statsvetarperspektivet kartlägger ideologiska sympatier och politiska preferenser i olika frågor.

- En demografisk analys fångar upp socioekonomiska faktorer och livsomständigheter.

Forskarna kom fram till att denna intervjubaserade teknik överträffade jämförbara metoder - som att utvinna data från sociala medier - med en betydande marginal.

Test av de digitala kopiorna

Så hur bra var AI-kopiorna? Forskarna lät dem genomgå ett batteri av tester för att ta reda på det.

Först använde de General Social Survey - ett mått på sociala attityder som ställer frågor om allt från politiska åsikter till religiösa övertygelser. Här matchade AI-kopiorna sina mänskliga motsvarigheters svar 85% av tiden.

På Big Five-personlighetstestet, som mäter egenskaper som öppenhet och samvetsgrannhet genom 44 olika frågor, stämde AI-förutsägelserna överens med mänskliga svar ungefär 80% av tiden. Systemet var suveränt på att fånga egenskaper som extraversion och neuroticism.

Tester av ekonomiska spel avslöjade dock fascinerande begränsningar. I "Dictator Game", där deltagarna bestämmer hur de ska dela pengar med andra, hade AI:n svårt att perfekt förutsäga mänsklig generositet.

I "Trust Game", som testar viljan att samarbeta med andra för ömsesidig nytta, matchade de digitala kopiorna bara de mänskliga valen ungefär två tredjedelar av tiden.

Detta tyder på att även om AI kan förstå våra uttalade värderingar, kan det fortfarande inte fullt ut fånga nyanserna i människans sociala beslutsfattande (ännu, naturligtvis).

Experiment i den verkliga världen

Forskarna lät även kopiorna genomgå fem klassiska socialpsykologiska experiment.

I ett experiment där man testade hur upplevd avsikt påverkar skuldbeläggning, visade både människor och deras AI-kopior liknande mönster av att tilldela mer skuld när skadliga handlingar verkade avsiktliga.

I ett annat experiment undersöktes hur rättvisa påverkar känslomässiga reaktioner, där AI-kopior exakt förutspådde mänskliga reaktioner på rättvis respektive orättvis behandling.

AI-replikanterna lyckades reproducera mänskligt beteende i fyra av fem experiment, vilket tyder på att de inte bara kan modellera enskilda aktuella svar utan breda, komplexa beteendemönster.

Enkla AI-kloner: Vilka är konsekvenserna?

AI systems that ‘clone’ human views and behaviors are big business, with Meta tillkännagav nyligen planer på att fylla Facebook och Instagram med AI-profiler som kan skapa innehåll och interagera med användare.

TikTok har också gett sig in i kampen med sin nya "Symphony"-svit med AI-drivna kreativa verktyg, som inkluderar digitala avatarer som kan användas av varumärken och kreatörer för att producera lokaliserat innehåll i stor skala.

Med Symphony Digitala AvatarerTikTok gör det möjligt för kvalificerade skapare att bygga avatarer som representerar verkliga människor, komplett med ett brett utbud av gester, uttryck, åldrar, nationaliteter och språk.

Stanfords och DeepMinds forskning tyder på att sådana digitala repliker kommer att bli mycket mer sofistikerade - och lättare att bygga och distribuera i stor skala.

"Om du kan ha ett gäng små 'du' som springer runt och faktiskt fattar de beslut som du skulle ha fattat - det tror jag i slutändan är framtiden", beskriver huvudforskaren Joon Sung Park, doktorand i datavetenskap vid Stanford, till MIT.

Park beskriver att det finns positiva sidor med sådan teknik, eftersom byggandet av exakta kloner skulle kunna stödja vetenskaplig forskning.

I stället för att genomföra dyra eller etiskt tveksamma experiment på riktiga människor kan forskarna testa hur olika befolkningsgrupper reagerar på vissa faktorer. Det skulle till exempel kunna hjälpa till att förutse reaktioner på folkhälsobudskap eller studera hur samhällen anpassar sig till stora samhällsförändringar.

I slutändan är det dock så att samma egenskaper som gör dessa AI-repliker värdefulla för forskning också gör dem till kraftfulla verktyg för bedrägeri.

I takt med att de digitala kopiorna blir allt mer övertygande har det blivit svårare att skilja äkta mänsklig interaktion från AI, vilket vi har sett i form av en anstormning av djupa förfalskningar.

Vad händer om sådan teknik används för att klona någon mot deras vilja? Vilka är konsekvenserna av att skapa digitala kopior som är exakt likadana som riktiga människor?

Forskargruppen från Stanford och DeepMind erkänner dessa risker. Deras ramverk kräver tydligt samtycke från deltagarna och ger dem möjlighet att dra tillbaka sina uppgifter, vilket innebär att personlighetsreplikering behandlas med samma integritetshänsyn som känslig medicinsk information.

Det ger åtminstone ett visst teoretiskt skydd mot mer skadliga former av missbruk. Men i I vilket fall som helst rör vi oss allt djupare in i de outforskade områdena för interaktion mellan människa och maskin, och de långsiktiga konsekvenserna är fortfarande i stort sett okända.