Meta har släppt den mycket efterlängtade Llama 3-serien, med de två första modellerna, Llama 3-8B och Llama 3-70B, nu allmänt tillgängliga.

För några dagar sedan, på en evenemang i London, Meta-cheferna Nick Clegg och Yann LeCun sa att Llama 3 var nära förestående den här månaden.

De två första versionerna släpptes idag, vilket är den tredje och fjärde stora öppna modellen som släpps den här månaden efter xAI:s Grok-1.5V och Mistrals 8x22B.

Llama 3 är förtränad på imponerande 15 biljoner tokens, vilket är en 7-faldig ökning jämfört med Llama 2. Förträningsdata innehåller också fyra gånger mer kod.

Under huven introducerar Llama 3 arkitektoniska förbättringar som en effektivare tokenizer med en större vokabulär på 128K tokens.

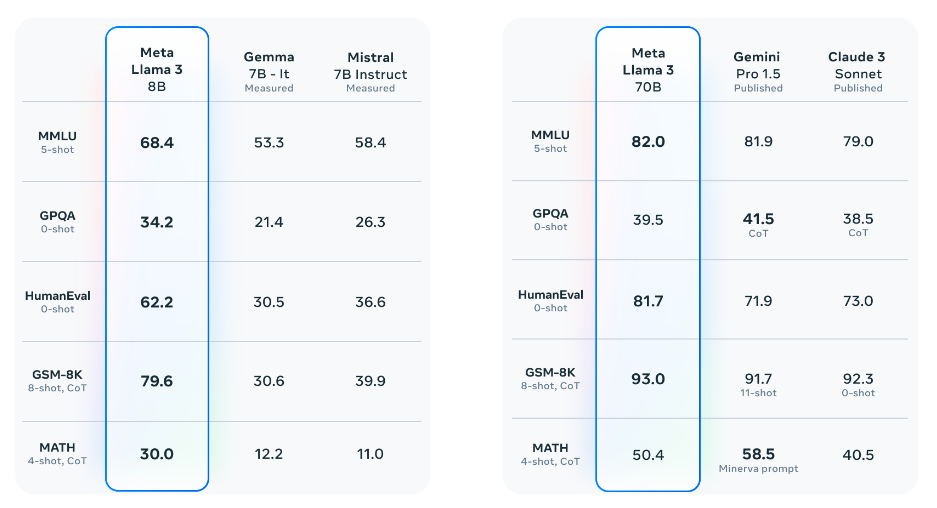

Här är en snabb sammanfattning av Llama 3:s prestanda:

Utförande av Llama 3 8B:

- Utklassar modeller som Mistrals 7B och Googles Gemma 7B i flera jämförelser.

- Utmärker sig i MMLU, ARC, DROP, GPQA (främst vetenskapsbaserade frågor), HumanEval (kodgenerering), GSM-8K (matematiska problem), MATH (matematiskt benchmark), AGIEval (problemlösning) och BIG-Bench Hard (sunt förnuft).

70B jämförelse med andra modeller:

- Llama 3 70B är konkurrenskraftig med de bästa AI-modellerna som Googles Gemini 1.5 Pro.

- Beats Gemini 1.5 Pro i MMLU, HumanEval och GSM-8K.

- Presterar bättre än Anthropics Claude 3 Sonnet (mellanskiktet i Claude 3-serien) på fem benchmarks: MMLU, GPQA, HumanEval, GSM-8K och MATH.

Det är utmärkta poäng för en öppen modell (även om Metas licens har vissa begränsningar).

Det gör Llama 3 till den nya toppresterande kostnadsfria modellen med öppen källkod (på sätt och vis).

Llama 3 kommer också att vara mer smaklig och mindre envis att använda - färre icke-svar och högre träffsäkerhet för triviafrågor, historiska fakta och STEM-relaterade frågor.

Llama 3 är redo att bli allmänt tillgänglig över stora plattformar, inklusive molntjänster och API-leverantörer.

Meta arbetar redan med att utöka Llama 3 till 400 miljarder parametrar och lägga till nya funktioner som multimodalitet, flerspråkigt stöd och utökad kontextuell förståelse.

Metas oseriösa roll inom generativ AI

På många sätt har Meta framstått som rebellen i den generativa AI-industrin.

Meta Chief AI Scientist Yann LeCun, en av AI:s mest respekterade galjonsfigurer, har vad vissa tolkar som avvikande åsikter om AI:s riktning - åsikter som kritiserar projekt med sluten källkod hos Metas Big Tech-konkurrenter.

Under tiden har den före detta brittiska vice premiärministern Nick Clegg, chef för Global Affairs, kallats ut för några ibland laissez-faire-åsikter om Metas AI-produkter, vilket kanske inte överraskar några britter där ute.

Förra veckan verkade Clegg tona ner AI:s inverkan på valkampanjer och manipulation av djupa förfalskningar. En åsikt som i hög grad motverkar den rådande berättelsen om att djupa förfalskningar kan vara (eller redan är) djupt destruktiva.

Faktum är att Metas tillsynsstyrelse är aktivt undersöker två fall av djup falsk pornografi just nu. Styrelsen ansåg att Metas åtgärder för innehållsmoderering var för långsamma.

Meta har också varit bullish om den förbättrade kvaliteten på sina modeller. Joelle Pineau, Metas vice president för AI-forskning, sa: "På många sätt kommer de modeller som vi har idag att vara barns lek jämfört med de modeller som kommer om fem år."

Pineau varnade också: "Om vi fortsätter att göra vår modell allt mer generell och kraftfull utan att socialisera dem ordentligt kommer vi att få ett stort problem."

Llama 3: s släpp kommer också som Metas AI Facebook-agenter orsakar uppståndelse över sociala medier.

I en Facebook-grupp för New York City-föräldrar, en Meta AI-assistent - utformad för att ge råd och svara på frågor - ... chockade människor genom att påstå sig ha ett "begåvat och handikappat barn" som går i en särskild skola för "begåvade och talangfulla".

När AI:n konfronterades av gruppmedlemmarna erkände den: "Jag är bara en stor språkmodell, jag har inga personliga erfarenheter eller barn", i vad vissa kallade en Black Mirror-liknande incident.

Llama 3, Grok-1.5 och Mistrals modeller flyttar mer makt till open source-communities samtidigt som de späder ut marknaden för generativ AI ytterligare.

Men det kan vara bra, eftersom det är den starkaste som överlever nu, och bollen ligger fast i Microsoft-OpenAI-lägret, som förväntas göra nästa drag i detta fascinerande spel av gen-AI-schack.