En grupp ledande forskare har lanserat ett frivilligt initiativ som beskriver en uppsättning värderingar, principer och åtaganden för design av AI-proteiner.

Den brev diskuterar det potentiella missbruket av AI-verktyg som kan designa nya proteiner med en hastighet och effektivitet som saknar motstycke.

Samtidigt som AI är mycket lovande för att hantera angelägna globala utmaningar, från pandemisvar till hållbara energilösningar, väcker det också frågor om möjligheten till skadlig användning, till exempel för att skapa nya biovapen.

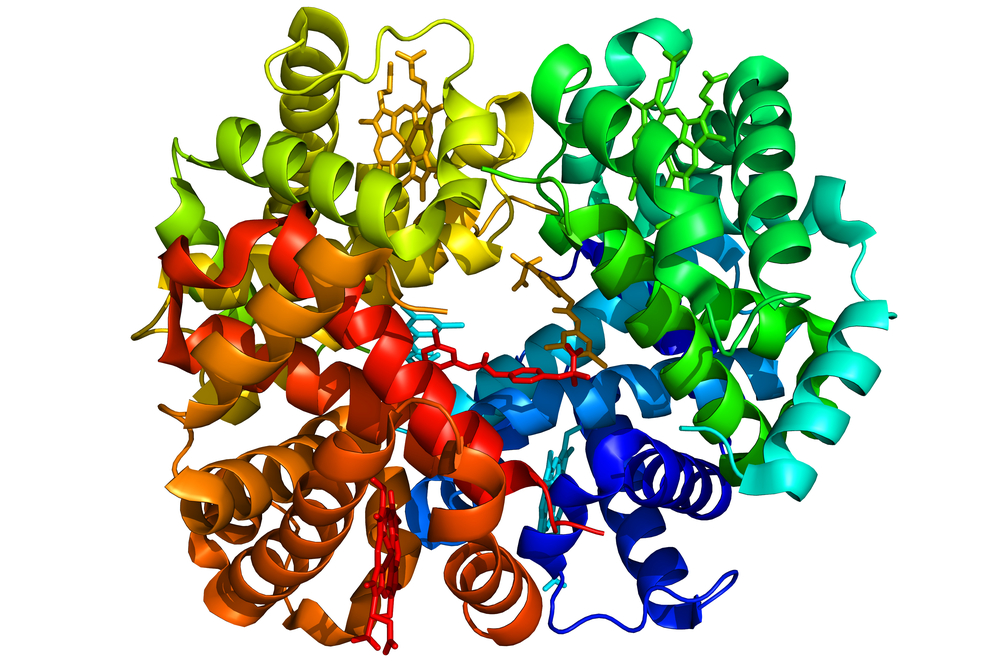

Medan de proteiner som designats av DeepMinds AlphaFold-system och senare av forskare vid University of Washington School of Medicine visat hög affinitet och specificitet mot sina avsedda mål, finns det alltid en möjlighet att dessa proteiner kan interagera med andra molekyler i kroppen på oväntade sätt.

Detta kan leda till negativa biverkningar eller till och med utveckling av nya sjukdomar.

En annan risk är potentialen för missbruk eller skadlig användning av denna teknik. Precis som AI-designade proteiner kan användas för att skapa mycket målinriktade terapier, kan de också konstrueras för att orsaka skada.

En illasinnad aktör skulle till exempel kunna utforma ett protein som riktar sig mot en viss etnisk grupp eller utnyttjar en viss genetisk sårbarhet.

Som David Baker, beräkningsbiofysiker vid University of Washington och en nyckelperson bakom initiativet, konstaterar: "Frågan var: hur, om på något sätt, bör proteindesign regleras och vilka, om några, är farorna?"

De över 100 undertecknarna anser att "fördelarna med nuvarande AI-teknik för proteindesign långt överväger risken för skada", men inser behovet av en proaktiv strategi för riskhantering i takt med att tekniken utvecklas.

AI för biologi har potential att bidra till att lösa några av de viktigaste problem som vårt samhälle står inför. Vetenskaplig öppenhet kommer att vara avgörande för att vårt fält ska kunna utvecklas. Som forskare engagerade i detta arbete, med mer än 90 undertecknare över hela världen, utvecklar vi ett ramverk för... pic.twitter.com/4m81j87Vo9

- Alex Rives (@alexrives) 8 mars 2024

I brevet står det att "med tanke på de förväntade framstegen inom detta område kan det krävas en ny proaktiv riskhanteringsstrategi för att minska risken för att AI-teknik utvecklas som kan missbrukas, avsiktligt eller på annat sätt, för att orsaka skada".

Undertecknad.

En bra idé för säkerhet i proteindesign (AI-driven eller inte): reglera och kontrollera proteinsyntesmaskinerna och firmware, inte själva AI-forskningen.

Det här är en idé som jag förde fram vid UK AI Safety Summit. https://t.co/skcUUcgG5a- Yann LeCun (@ylecun) 8 mars 2024

Som en del av initiativformulerade forskarna en uppsättning värderingar och principer för att vägleda en ansvarsfull utveckling av AI-teknik inom proteinkonstruktion.

Dessa omfattar "trygghet, säkerhet, rättvisa, internationellt samarbete, öppenhet, ansvar och att bedriva forskning till nytta för samhället". De undertecknande parterna har också frivilligt kommit överens om en rad specifika, handlingsinriktade åtaganden som bygger på dessa värderingar och principer.

En viktig aspekt av initiativet fokuserar på att förbättra screeningen av DNA-syntesen, ett avgörande steg för att omvandla AI-designade proteiner till fysiska molekyler.

Forskarna åtar sig att "endast köpa DNA-syntes från leverantörer som kan visa att de följer industristandarder för biosäkerhetsscreening, som syftar till att upptäcka farliga biomolekyler innan de kan tillverkas".

AI:s framsteg inom medicin och bioteknik har varit helt otroliga, vilket har lett till nya antibiotika och läkemedel mot åldrande.

För att driva dessa resultat framåt åtar sig signatärerna att "samarbeta med intressenter från hela världen" och "avstå från forskning som sannolikt leder till allmän skada eller möjliggör missbruk av våra teknologier".