Vi har verkligen kommit in i en tid då man inte kan lita på vad man ser på nätet.

Det påståendet har delvis varit sant i årtionden, men AI har lyft manipuleringen av innehåll till nya nivåer och är betydligt snabbare än vad allmänheten är medveten om.

AI deep fake-teknik kan skapa och ändra bilder, videor och ljudinspelningar, lägga ord i munnen på offentliga personer eller få dem att framstå i situationer som aldrig har inträffat.

I många fall krävs det mer än en andra blick för att avgöra om innehållet är äkta, och falska medier kan samla miljontals visningar innan de identifieras.

Vi bevittnar nu djupa förfalskningar som potentiellt kan störa demokratiska processer, även om det är för tidigt att mäta påtagliga effekter på röstningsbeteendet.

Låt oss undersöka några av de mest anmärkningsvärda politiska AI deep fake-incidenterna som vi hittills har bevittnat.

Joe Biden New Hampshire händelse

Januari 2024, A New Hampshire, USA, a Robocall som imiterar Bidens röst uppmanade väljarna att "spara din röst till valet i november" och antydde felaktigt att ett deltagande i primärvalet oavsiktligt skulle gynna Donald Trump.

Det var kopplat till Kathy Sullivans, en tidigare ordförande för det demokratiska partiet i delstaten, privata mobilnummer. Sullivan fördömde handlingen som en flagrant form av valpåverkan och personliga trakasserier.

New Hampshire Attorney General's Office sade att detta var ett olagligt försök att störa presidentvalets primärval och undertrycka valdeltagandet.

Det fabricerade ljudet visade sig ha genererats med hjälp av ElevenLabs, en branschledare inom talsyntes.

ElevenLabs stängde senare av gärningsmannen bakom den falska Biden-rösten och "Vi är dedikerade till att förhindra missbruk av AI-verktyg för ljud och tar alla incidenter av missbruk extremt allvarligt."

Tysklands förbundskansler Olaf Scholz djupt falsk incident

November 2023 bevittnade Tyskland en AI deep fake som falskeligen avbildade förbundskansler Olaf Scholz som stödde ett förbud mot det högerextrema partiet Alternativ för Tyskland (AfD).

Denna djupt falska video var en del av en kampanj av en konst-aktivistgrupp, the Centrum för politisk skönhet (CPB)och syftar till att uppmärksamma AfD:s ökande inflytande. Kritiken mot AfD föranleds av Tysklands 1930-talshistoria.

CPB-gruppen leds av filosofen och konstnären Philipp Ruch och har som mål att skapa "politisk poesi" och "moralisk skönhet" som tar upp viktiga samtida frågor som kränkningar av mänskliga rättigheter, diktatur och folkmord.

CPB har engagerat sig i ett flertal kontroversiella projekt, som t.ex. Installationen "Search for Us" nära Bundestagsom de påstod innehöll jord från tidigare dödsläger och kvarlevor från Förintelsens offer.

Stödet för AfD har ökat, men många protester runt om i Tyskland visar att det finns ett starkt motstånd mot AfD:s ideologier.

En talesperson för gruppen bakom deep fake sade: "I våra ögon är den högerextremism i Tyskland som sitter i parlamentet farligare."

AfD-tjänstemän kallade den djupt falska kampanjen för en bedräglig taktik som syftar till att misskreditera partiet och påverka den allmänna opinionen.

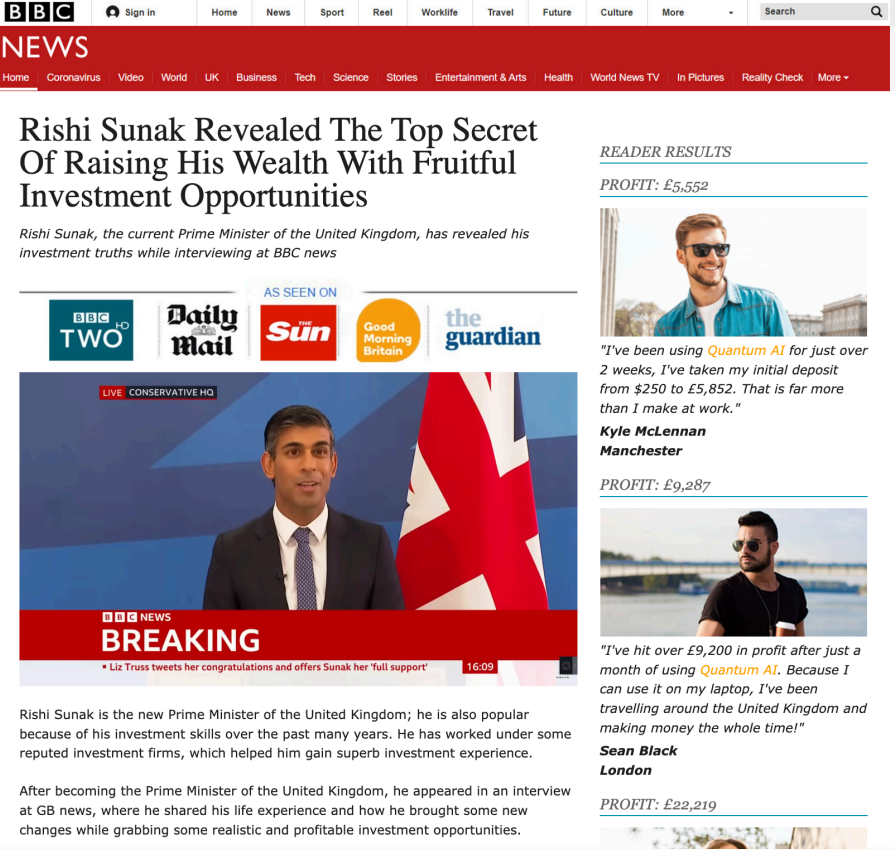

Storbritanniens premiärminister Rishi Sunak inblandad i bedrägerier

I januari 2024 fann ett brittiskt undersökningsföretag att PM Rishi Sunak var inblandad i över 100 vilseledande videoannonser som främst spreds på Facebook och nådde uppskattningsvis 400.000 personer.

Dessa annonser, som kom från olika länder, bland annat USA, Turkiet, Malaysia och Filippinerna, marknadsförde bedrägliga investeringssystem som falskeligen förknippades med högprofilerade personer som Elon Musk.

Undersökningen, som genomfördes av online-kommunikationen företaget Fenimore Harper, framhöll hur sociala medieföretag helt enkelt inte svarar på denna form av innehåll inom en rimlig tidsram.

Marcus Beard, grundare av Fenimore Harper, förklarade hur AI demokratiserar felaktig information: "Nu när det finns billiga och lättanvända röst- och ansiktskloningar krävs det väldigt lite kunskap och expertis för att använda en persons utseende i skadliga syften."

Beard kritiserade också den otillräckliga innehållsmodereringen på sociala medier och konstaterade: "Dessa annonser strider mot flera av Facebooks annonspolicyer. Men väldigt få av de annonser vi stött på verkar ha tagits bort."

Den brittiska regeringen reagerade på risken för bedrägliga djupförfalskningar: "Vi arbetar intensivt inom hela regeringen för att se till att vi är redo att snabbt reagera på eventuella hot mot våra demokratiska processer genom vår arbetsgrupp för att försvara demokratin och särskilda regeringsteam."

Pakistans premiärminister Imran Khan framträder i virtuellt rally

I december 2023 sitter Pakistans tidigare premiärminister Imran Khan fängslad för att ha läckt statshemligheter, framträdde vid ett virtuellt möte med hjälp av AI.

Trots att Khan sitter bakom lås och bom sågs hans digitala avatar av miljontals tittare. Rallyt innehöll bilder från tidigare tal som involverade hans politiska parti, Pakistan Tehreek-e-Insaaf (PTI).

Khans fyra minuter långa tal handlade om motståndskraft och trots mot det politiska förtryck som PTI:s medlemmar utsätts för.

AI-rösten formulerade sig: "Vårt parti tillåts inte hålla offentliga möten. Vårt folk kidnappas och deras familjer trakasseras", och fortsatte: "Historien kommer att minnas era uppoffringar."

För att förvirra situationen försökte den pakistanska regeringen enligt uppgift blockera tillträdet till mötet.

NetBlocks, en organisation som övervakar internet, sade: "Mätningar visar att stora sociala medieplattformar var begränsade i Pakistan i [nästan] 7 timmar på söndagskvällen under en politisk sammankomst på nätet; händelsen överensstämmer med tidigare fall av internetcensur riktad mot oppositionsledaren Imran Khan och hans parti PTI."

ℹ️ ICYMI: Mätningar visar att stora sociala medieplattformar var begränsade i #Pakistan i ~7 timmar på söndagskvällen under en politisk sammankomst på nätet; händelsen är förenlig med tidigare fall av internetcensur riktad mot oppositionsledaren Imran Khan och hans parti PTI https://t.co/AS9SdfwqoH pic.twitter.com/XXMYBhknXd

- NetBlocks (@netblocks) 18 december 2023

Usama Khilji, en förespråkare för yttrandefrihet i Pakistan, kommenterade: "Med en fullständig inskränkning av PTI:s rätt till förenings- och yttrandefrihet genom arresteringar av ledare, markerar partiets användning av artificiell intelligens för att sända ett virtuellt tal med orden från dess fängslade ordförande och tidigare premiärminister Imran Khan en ny punkt i användningen av teknik i pakistansk politik."

Falskt ljud av den före detta sudanesiske presidenten Omar al-Bashir på TikTok

En AI-driven kampanj på TikTok utnyttjade rösten från Sudans tidigare president Omar al-Bashir mitt i landets pågående civila oroligheter.

Sedan slutet av augusti 2023 har ett anonymt konto publicerat vad som påstås vara "läckta inspelningar" av al-Bashir. Analytiker fastställde dock att inspelningarna var AI-genererade förfalskningar.

al-Bashir" har varit frånvarande från offentligheten sedan han fördrevs från landet 2019 på grund av allvarliga anklagelser om krigsbrott.

Slovakiens ljudbedrägeri på valdagen

På valdagen i Slovakien publicerades ett kontroversiellt ljudklipp med djupa förfalskningar av Michal Šimečka, ledare för partiet Progressiva Slovakien, och journalisten Monika Tódová som diskuterade korrupta metoder som röstköp.

Detta uppdagades under Slovakiens mediala blackout före valet, så de inblandade personerna kunde inte enkelt offentligt motbevisa sin inblandning före posttiden.

Båda de inblandade parterna fördömde senare inspelningen som en djup fejk, vilket bekräftades av en faktagranskningsbyrå.

Volodymyr Zelenskiys djupa fejk

År 2023 identifierades en djupt fejkad video av Ukrainas president Volodymyr Zelenskiy, som amatörmässigt antydde att han uppmanade soldater att lämna sina poster, snabbt som fejk och togs bort av stora sociala medieplattformar.

Turkiskt val djupt falskt drama

Inför det turkiska parlaments- och presidentvalet spreds en video på nätet som falskeligen visade att president Recep Tayyip Erdoğans främsta utmanare, Kemal Kılıçdaroğlu, fick stöd från PKK.

Donald Trump djupa förfalskningar

I början av 2023 såg vi realistiska deep fakes av Donald Trump som arresterades och en kampanjvideo av Ron DeSantis med AI-genererade bilder av Trump som omfamnar Anthony Fauci.

Belgiskt politiskt partis Trump-djup falskt

En tidigare incident 2018 i Belgien orsakade politisk uppståndelse när en djupt fejkad video skapad av ett politiskt parti orsakade ett ramaskri bland allmänheten.

Videon visade en falsk bild av president Donald Trump som rådde Belgien att dra sig ur klimatavtalet från Paris.

Videon var en del av en högteknologisk förfalskning, som senare erkändes av partiets medieteam. Det visade hur djupgående förfalskningar kan användas för att fabricera uttalanden av världsledare för att påverka den allmänna opinionen och politiken.

Djup förfalskning av Nancy Pelosi

En manipulerad video av Nancy Pelosi 2020, där det såg ut som om hon sluddrade och var berusad, spreds snabbt på sociala medier.

Detta visade att deep fakes har potential att misskreditera och genera offentliga personer, något som ofta kvarstår efter att innehållet har bedömts vara falskt.

Audio deepfake av Keir Starmer

En annan incident i brittisk politik gällde ett ljudklipp som påstods fånga oppositionsledaren Sir Keir Starmer svärande mot sin personal.

Klippet, som fick stor spridning på sociala medier, visade sig senare vara en AI-genererad deep fake.

I takt med att teknikföretagen utforskar sätt att hantera djupa förfalskningar i stor skala kommer de AI-modeller som används för att skapa falska medier bara att bli mer sofistikerade och enklare att använda.

Den resa som ligger framför oss kräver ett samarbete mellan tekniker, beslutsfattare och allmänheten för att utnyttja AI:s fördelar och samtidigt värna om vårt samhälles grundpelare som tillit och integritet.

Förtroendet för politik och offentliga institutioner är redan minst sagt bräckligt. Djupa förfalskningar kommer att underminera det ytterligare.