Välkommen till veckans sammanställning av AI-nyheter. Vi har hört rykten om att det här är Elon Musks favoritkälla för AI-nyheter.

Den här veckan skämtade AI med presidenter samtidigt som man fifflade med val.

Ett nytt barn på kvarteret säger att OpenAI borde stänga ner och komma och arbeta för dem.

Och AI vet när du sannolikt kommer att dö.

Låt oss gräva i det.

Dubbla problem

Rysslands president Vladimir Putin har avvisat ryktena om att han använder dubbelgångare för säkerhets skull. Vid en direktsänd Q&A var Putin konfronteras med en AI-dubbelgångare som framkallade en rad känslor hos Putin när han anspelade på detta. Skämtaren kan ha fallit ut genom ett fönster efter detta.

På andra sidan AI-ridån kan USA:s president Joe Biden ha haft en partisk hand i utformningen av sin AI Executive Order. En titt på vem som står bakom tankesmedjan RAND ger oss en intressant inblick i vem som drar i trådarna för AI-regleringen.

Vad väntar vi på?

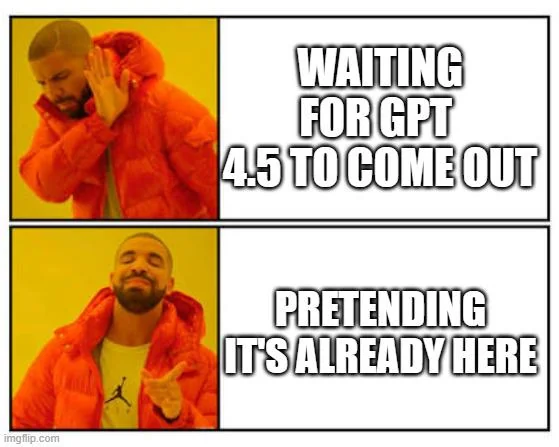

AI-entusiaster har väntat på stora nyheter från OpenAI som ska tillkännages före slutet av 2023. Kommer det att vara GPT-4.5? Kommer vi äntligen att få GPT-5?

Kanske nästa vecka. Eller kanske inte alls, eftersom OpenAI:s styrelse har fått vetorätt på alla modeller som Sam Altman vill släppa. Vissa säger att de senaste förbättringarna av ChatGPT Plus tyder på att GPT-4.5 redan är i bruk.

Tills vidare får vi nöja oss med de första resultaten från OpenAI:s projekt Superalignment. Ilya Sutskevers team försöker ta reda på om människor kommer att kunna utbilda framtida superintelligenta AI:er för att se till att de inte blir oseriösa. De hittade ett intressant sätt att simulera detta.

OpenAI förväntar sig AGI inom de närmaste 10 åren. VERSES säger att dess genombrott kan få det att hända mycket tidigare. Företaget använde en fräck skylt och ett öppet brev för att få OpenAI att släppa vad de håller på med och gå med i VERSES-projektet. Konstigt nog, OpenAI kan behöva följa om de håller vad de lovar.

OpenAI bildade ett mer tveksamt partnerskap med medieutgivaren Axel Springer. Det syftar till att ge nyhetsinnehåll till ChatGPT men förvänta dig inte opartisk täckning av världshändelser.

Om du letar efter en AI-riktning i livet TomTom samarbetar med Microsoft och OpenAI för att få ChatGPT till din GPS och andra system i bilen.

AI i naturen

Medan AI-företag arbetar hårt för att göra sina modeller säkrare, tog Eric Hartford bort alla skyddsräcken från Mistrals senaste modell och släppte den offentligt. Dolphin Mixtral är en helt ocensurerad AI-modell som tillmötesgår alla önskemål, även olagliga. Dess önskan att rädda kattungar är en stor drivkraft.

Kommersiella AI-modeller ger ibland dåliga råd av misstag, men Dolphin Mixtral gör det när det gäller tumlare.

I andra AI-relaterade nyheter om vattenlevande däggdjur är naturvårdare använder AI för att identifiera valar från foton. Hur valarna känner inför ansiktsigenkänningens intrång är det ingen som vet.

AI-laboratorieråttor

Danska forskare byggde en AI-modell som vet när du kommer att dö. Livförsäkringsbolagen kommer att älska detta. När vi ser det datum som modellen spottar ut kanske vi äntligen överväger att göra några hälsosammare livsstilsval.

Forskare från ETH Zürich insisterar på att de arbetade hårt och inte spelade spel när de lärde en robot att bemästra ett labyrintspel med maskininlärning. Vi gissar att stämningen var lite lättare i det här labbet än i det danska.

Forskare har använt AI för att designa proteiner som uppvisar exceptionella bindningsstyrkor för att skapa nya läkemedel som är bättre än antikroppar.

Materialforskare som var trötta på att arbeta sig igenom berg av röntgendiffraktionsdata använde konvolutionella neurala nätverk för att påskynda upptäckten av nya material.

När forskare använder AI för att göra upptäckter lägger de inte till AI-modellens namn i listan över artikelns författare. En brittisk domstol följde efter och beslutade att AI kan inte anges som uppfinnare för patent. Kommer detta att förändras när AGI har uppnåtts och maskinerna uppnår en viss känslighet? De kanske artigt insisterar på att få äran.

På väg mot valkampanjen

Det är valtider i flera länder och AI visar att den kan ljuga bättre än den mest erfarna politiker. AI:s djupa falska felinformation kan påverka hur väljarna i USA och Bangladeshs val rösta.

I närheten, i Pakistan, kunde den tidigare premiärministern Imran Khan tala till sina anhängare trots att han satt i fängelse. Med hjälp av en AI-skapad avatar av sig självKhan kunde hålla ett virtuellt valmöte. Pakistans sittande ledare var inte roade.

I USA var en kandidat från Pennsylvania den första som använde en AI-roboten Ashley ska ringa väljare. Dessa interaktiva AI-robocalls är billiga och effektiva, men de väcker en del knepiga etiska frågor.

Den som vinner det kommande presidentvalet i USA kan komma att få en ny ekonomisk politik att ta ställning till. En amerikansk tillsynsmyndighet har varnat för att AI utgör en växande risk för finansmarknaderna.

Få AI att tänka

Modeller som ChatGPT är verkligen imponerande, men de "tänker" inte riktigt som vi gör eller kommer med nya idéer.

Googles DeepMind har gjort ett stort genombrott för att ändra på detta med hjälp av matematisk maskininlärning. FunSearch-modellen kommer med nya lösningar på matematiska problem som har förvirrat matematiker i årtionden.

Western Sydney University förbereder sig för att slå på sin superdator DeepSouth. DeepSouth kan utföra synaptiska operationer i en takt som matchar den uppskattade operativa kapaciteten hos den mänskliga hjärnan. Det är inte den största superdatorn, men dess neuromorfisk arkitektur gör den unik.

Något som inte förbättrades den här veckan är humöret hos Geminis marknadsföringsteam. Microsoft kastade skugga på Googles påstående att Gemini är bättre än GPT-4. Microsoft-ingenjörer gav GPT-4 en boost med hjälp av en ny uppmaningsteknik som heter Medprompt. Medprompt ser GPT-4 förbättra sitt resonemang och ta tillbaka benchmark-testkronan i en målfotoavslutning.

Förra veckan sa vi att GPT-4 blev lite lat men det verkar mycket bättre nu. När den fortfarande var i semesterläge hade Ethan Mollick den här pärlan av en interaktion med den. Kolla in den första raden i koden som den skrev.

ChatGPT-4 blev plötsligt väldigt bra igen av någon anledning, efter att ha varit opålitlig och lite "tråkig" i flera veckor

(Fast det här kan vara min favoritinteraktion: Jag bad den att skapa filer åt mig, den insisterade på att den inte kunde, jag sa åt den att försöka, den gjorde det, och titta sedan på den översta kodkommentaren) pic.twitter.com/X1WhtxC96e

- Ethan Mollick (@emollick) 17 december 2023

Andra nyheter...

Här är några andra klickvärda AI-berättelser som vi gillade den här veckan:

- Stabilitet AI lanserad Stabil Zero123 som genererar 3D-modeller av hög kvalitet från en enda bild.

- Påven har efterlyst ett fördrag om reglering av AI.

- Den vetenskapliga tidskriften Nature lade till AI på nummer 11 nedan sin lista över de 10 människor som har format vetenskapen år 2023.

- Google tillkännagav VideoPoet. En stor språkmodell för noll-shot generering av text-till-video.

- ByteDance går i graven använder OpenAI-data för att träna sina modeller.

Och det var allt.

Jag försöker bestämma mig för om helt ocensurerade modeller som Dolphin Mixtral är en befriande dröm som går i uppfyllelse eller en skrämmande början på en AI-mardröm. Det finns där ute nu så vi kommer att få reda på det snart nog.

Felaktig AI-information under val är naturligtvis en dålig sak, men kan AI göra en positiv skillnad i demokratier? Om vi matade ChatGPT med all information om potentiella kandidater, skulle den då kunna göra ett bättre val på några sekunder än det som tar miljontals väljare flera dagar att göra?

Kan en AGI kandidera till ett ämbete en dag? Om någon läser det här välkomnar jag i alla fall våra robotöverherrar.

Låt oss veta vad du tycker och skicka oss länkar till coola AI-berättelser som vi kanske har missat.