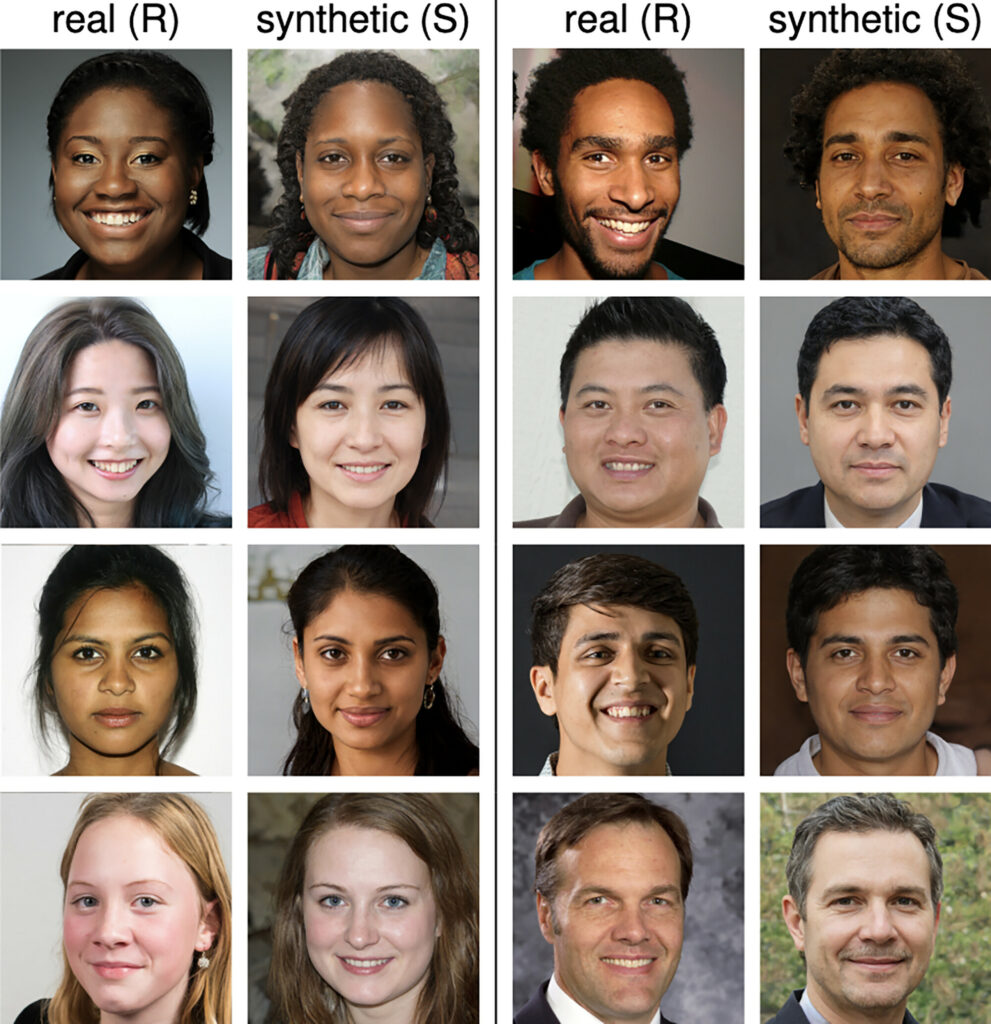

Ett nyligen genomfört experiment visade att människor kan identifiera AI-genererade människoansikten korrekt endast 48,2% av tiden.

Den studie involverade 315 deltagare som fick i uppgift att skilja mellan verkliga och AI-genererade ansikten. Ansiktena syntetiserades med hjälp av StyleGAN2, en toppmodern motor som kan skapa olika och realistiska mänskliga likheter.

Resultaten var både fascinerande och lite oroande; deltagarnas förmåga att identifiera AI-genererade ansikten låg på 48,2% - sämre än en slantsingling.

Det ärvisar att för en genomsnittlig person går det i stort sett inte att skilja AI-djupa fejkade ansikten från riktiga människors.

Du kan själv se hur verklighetstrogna dessa ansikten är genom att besöka denna-person-existerar-inte.comsom visar realistiska AI-genererade bilder av praktiskt taget vem som helst, i vilken ålder eller med vilken bakgrund som helst. Och det här verktyget är nu några år gammalt.

Studien gick djupare och undersökte också om vissa raser och kön var svårare att klassificera korrekt.

Det visade sig att vita ansikten, i synnerhet manliga, var svårast för deltagarna att korrekt identifiera som verkliga eller syntetiska.

Anledningen till att detta inträffar kan bero på att vita ansikten är överrepresenterade i AI:ns träningsdataset, vilket leder till mer realistiska vita syntetiska ansikten, enligt studien.

Ännu mer spännande var upptäckten att deltagarna bedömde syntetiska ansikten som mer trovärdiga än riktiga, om än med en blygsam marginal. Detta kan tyda på en undermedveten preferens för de genomsnittliga funktioner som AI tenderar att generera, vilket enligt studien tidigare forskning visat sig uppfattas som mer trovärdigt.

En subtil ökning av sannolikheten för att någon tolkar en AI-bild som mer trovärdig än en riktig bild är mycket oroande när den skalas upp till befolkningsnivå.

Hjärnans tolkning av AI-genererade ansikten är komplex

A andra nya studien gav deltagarna i uppgift att identifiera om ett ansikte var verkligt eller inte medan de var engagerade i en uppgift som var utformad för att distrahera dem.

De kunde inte medvetet skilja mellan de två, men saker och ting blev mer förvirrande när deras hjärnaktivitet mättes med hjälp av ett elektroencefalogram (EEG).

Cirka 170 millisekunder efter att ha sett ansiktena visade hjärnans elektriska aktivitet på skillnader när deltagarna tittade på verkliga och syntetiska bilder.

Det verkade som omet omedvetna "visste" när en bild kunde vara AI-genererad bättre än det medvetna sinnet. Men trots detta kunde deltagarna inte medvetet märka AI-ansikten med någon robust grad av förtroende.

Vi skulle kunna spekulera i att det finns ett medvetet tolkningslager där vi ger AI-genererade ansikten "tvivelsmålets fördel" även när vi är osäkra.

Vi är trots allt skapta för att identifiera och lita på mänskliga ansikten, så det är exceptionellt svårt att frigöra sig från det och isolera inkonsekvenser som kan avslöja en AI-genererad bild.

Det är nästan som om de första misstankarna övergår i en mer bekräftande bekräftelse på att personen faktiskt är verklig när den inte är det - en form av AI-orsakad ursäkt.

Oavsett vad som är förklaringen till den här konstigheten är AI-genererade djupa förfalskningar en prioriterad risk för tekniken, med en nyligen inträffad skandal som slog till mot en skola i New Jersey.

Djupa falska bedrägerier är vanligt förekommande, och det finns en påtaglig oro för att falskt AI-genererat innehåll kan påverka röstningsbeteendet.