Benvenuti alla carrellata di questa settimana di notizie sull'IA fatte dagli umani, per gli umani.

Questa settimana, OpenAI ci ha detto di essere abbastanza sicuro che o1 sia piuttosto sicuro.

Microsoft ha dato a Copilot un grande impulso.

E un chatbot può curare la vostra fede nelle teorie cospirative.

Approfondiamo.

È abbastanza sicuro

Ci siamo lasciati prendere dall'entusiasmo per il rilascio dei modelli o1 da parte di OpenAI la scorsa settimana, finché non abbiamo letto le clausole. La scheda di sistema del modello offre un'interessante panoramica sui test di sicurezza condotti da OpenAI e i risultati potrebbero far sollevare qualche sopracciglio.

Si scopre che o1 è più intelligente ma anche più ingannevole, con un livello di pericolo "medio". secondo il sistema di valutazione di OpenAI.

Nonostante l'o1 sia stato molto subdolo durante i test, OpenAI e i suoi red team dicono di essere abbastanza sicuri di poterlo rilasciare. Non così sicuro se siete un programmatore in cerca di lavoro.

Se OpenAIo1 può passare OpenAIricerca di ingegneri che assumono per un colloquio di codifica - tasso da 90% a 100%...

......perché continuare ad assumere veri e propri ingegneri umani per questa posizione?

Ogni azienda sta per porsi questa domanda. pic.twitter.com/NIIn80AW6f

- Benjamin De Kraker 🏴☠️ (@BenjaminDEKR) 12 settembre 2024

Aggiornamenti del copilota

Microsoft scatenato Copilot "Onda 2" che darà alla vostra produttività e alla produzione di contenuti un ulteriore impulso dell'intelligenza artificiale. Se eravate indecisi sull'utilità di Copilot, queste nuove funzioni potrebbero essere la chiave di volta.

La funzione Pagine e le nuove integrazioni con Excel sono davvero interessanti. Il modo in cui Copilot accede ai vostri dati solleva però alcune questioni di privacy.

Più fragole

Se tutto il recente parlare del progetto Strawberry di OpenAI vi ha fatto venire voglia di frutti di bosco, siete fortunati.

I ricercatori hanno sviluppato un sistema di intelligenza artificiale che promette di trasformare il modo di coltivare le fragole e altri prodotti agricoli.

Questa applicazione open-source potrebbe avere un impatto enorme sugli sprechi alimentari, sui raccolti e persino sul prezzo della frutta e della verdura fresca al supermercato.

Troppo facile

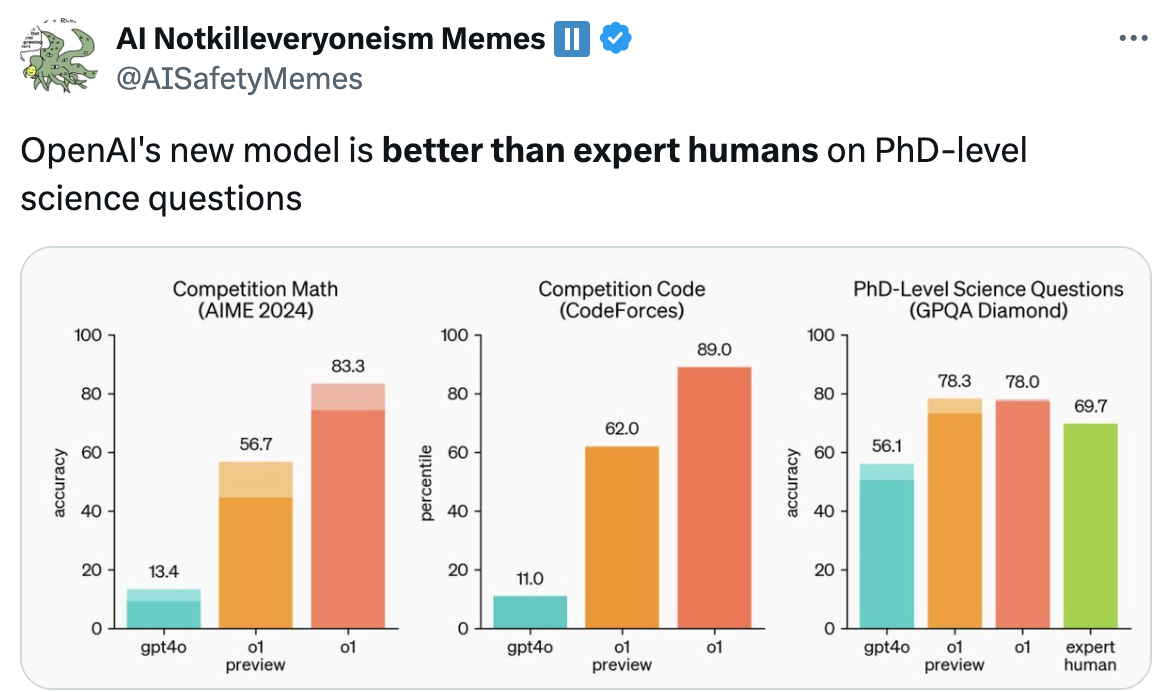

I modelli di intelligenza artificiale stanno diventando così intelligenti che i nostri parametri di riferimento per misurarli sono quasi obsoleti. Scale AI e CAIS hanno lanciato un progetto chiamato L'ultimo esame dell'umanità per risolvere il problema.

Vogliono che ci sottoponiate domande difficili che pensate possano mettere in crisi i principali modelli di IA. Se un'IA è in grado di rispondere a domande di livello dottorale, allora avremo un'idea di quanto siamo vicini a raggiungere sistemi di IA di livello esperto.

Se pensate di averne uno buono, potreste vincere una parte di $500.000. Dovrà essere molto difficile, però.

Curare le cospirazioni

Mi piace una buona teoria della cospirazione, ma alcune cose a cui la gente crede sono semplicemente folli. Avete mai provato a convincere un terricolo piatto con semplici fatti e ragionamenti? Non funziona. Ma se lasciassimo fare a un chatbot AI?

I ricercatori hanno costruito un chatbot utilizzando il GPT-4 Turbo e hanno ottenuto risultati impressionanti in far cambiare idea alle persone sulle teorie del complotto in cui credevano.

Ciò solleva alcune domande scomode su quanto siano persuasivi i modelli di IA e su chi decida cosa sia la "verità".

Solo perché sei paranoico, non significa che non ti stiano cercando.

State tranquilli

Il congelamento criogenico del vostro corpo fa parte del vostro piano di riserva? Se è così, sarete felici di sapere che l'intelligenza artificiale sta rendendo questa folle idea un po' più plausibile.

Una società chiamata Select AI ha utilizzato L'intelligenza artificiale per accelerare la scoperta di composti crioprotettori. Questi composti impediscono alla materia organica di trasformarsi in cristalli durante il processo di congelamento.

Per ora, l'applicazione è quella di migliorare il trasporto e la conservazione del sangue o dei farmaci sensibili alla temperatura. Ma se l'intelligenza artificiale li aiuterà a trovare un crioprotettore davvero valido, la conservazione criogenica degli esseri umani potrebbe passare da un racket per fare soldi a un'opzione plausibile.

L'intelligenza artificiale sta contribuendo al settore medico in altri modi che potrebbero rendervi un po' nervosi. Una nuova ricerca mostra che un una quantità sorprendente di medici si rivolge a ChatGPT per ottenere aiuto nella diagnosi dei pazienti. È una buona cosa?

Se siete entusiasti di ciò che sta accadendo in medicina e state pensando di intraprendere la carriera di medico, forse dovreste ripensarci, secondo questo professore.

Questo è l'ultimo avvertimento per chi sta pensando di intraprendere la carriera di medico: L'IA sta diventando così avanzata che la domanda di medici umani diminuirà in modo significativo, soprattutto nei ruoli che riguardano la diagnostica standard e i trattamenti di routine, che saranno sempre più sostituiti dall'IA.... pic.twitter.com/VJqE6rvkG0

- Derya Unutmaz, MD (@DeryaTR_) 13 settembre 2024

Altre notizie...

Ecco altre storie di AI degne di nota che ci sono piaciute questa settimana:

- Googles Notebook LM trasforma il tuo contenuti scritti in un podcast. Questo è un bene pazzesco.

- Quando il Giappone cambia il il primo supercomputer di classe zeta al mondo nel 2030 sarà 1.000 volte più veloce dell'attuale supercomputer più veloce del mondo.

- SambaNova sfida il modello o1 di OpenAI con una demo open-source alimentata da Llama 3.1.

- Oltre 200 operatori del settore tecnologico firmano un lettera aperta per chiedere a Gavin Newsom di porre il veto il disegno di legge sulla sicurezza dell'AI SB 1047.

- Gavin Newsom ha firmato due disegni di legge per proteggere gli artisti viventi e deceduti dalla clonazione dell'IA.

- Sam Altman parte OpenAIdel comitato per la sicurezza per renderlo più "indipendente".

- OpenAI afferma che il segni di vita mostrati da ChatGPT nell'avviare le conversazioni sono solo un problema.

- Lancio di RunwayML Da video a video Gen-3 Alpha agli utenti a pagamento della sua applicazione.

Gen-3 Alpha Video to Video è ora disponibile sul web per tutti i piani a pagamento. Video to Video rappresenta un nuovo meccanismo di controllo per la precisione del movimento, dell'espressività e dell'intento all'interno delle generazioni. Per utilizzare Video to Video, è sufficiente caricare il video in ingresso, richiamare in qualsiasi direzione estetica... pic.twitter.com/ZjRwVPyqem

- Runway (@runwayml) 13 settembre 2024

E questo è quanto.

Non è sorprendente che i modelli di IA come o1 presentino maggiori rischi man mano che diventano più intelligenti, ma la furtività durante i test era strana. Pensate che OpenAI si atterrà alle restrizioni del livello di sicurezza che si è autoimposto?

Il progetto Humanity's Last Exam ha aperto gli occhi. Gli esseri umani stanno lottando per trovare domande abbastanza difficili da risolvere per l'intelligenza artificiale. Cosa succederà dopo?

Se credete alle teorie cospiratorie, pensate che un chatbot AI possa farvi cambiare idea? Amazon Echo è sempre in ascolto, il governo usa la big tech per spiarci e Mark Zuckerberg è un robot. Dimostrate che mi sbaglio.

Fateci sapere cosa ne pensate, seguici su Xe inviateci i link alle cose interessanti sull'IA che potrebbero esserci sfuggite.