Benvenuti alla nostra carrellata settimanale di notizie sull'intelligenza artificiale creata dall'uomo.

Questa settimana OpenAI ha distribuito delle chicche sulle API.

La legge californiana sulla sicurezza dell'intelligenza artificiale è stata bocciata.

E NVIDIA ci ha sorpreso con un potente modello aperto.

Approfondiamo.

Arrivano gli agenti

OpenAI non ha annunciato nuovi modelli (o Sora) durante il suo evento Dev Day, ma gli sviluppatori sono stati entusiasti delle nuove funzionalità API. L'API Realtime cambierà le carte in tavola per la creazione di applicazioni più intelligenti che parlano con gli utenti e agiscono addirittura come agenti.

Ci sono state voci sul fatto che OpenAI avrebbe intrapreso la strada del "for-profit" e avrebbe assegnato a Sam Altman miliardi di dollari in azioni, ma Altman ha respinto queste voci. Tuttavia, l'azienda è alla ricerca di ulteriori investimenti e si aspetta un ritorno in denaro.

Apple ha integrato i modelli di OpenAI nei suoi dispositivi ma ha abbandonato l'ultimo round di finanziamento per OpenAI che dovrebbe raccogliere circa $6,5 miliardi.

Non siamo sicuri del motivo per cui Apple non voglia una fetta della torta OpenAI, ma potrebbe avere qualcosa a che fare con nuovi sviluppi con il suo Apple Intelligenza. O forse è legato alla richiesta di esclusività di Sam Altman.

Ditemi che non avete un fossato senza dirmi che non avete un fossato. pic.twitter.com/3I18MosvOg

- Pedro Domingos (@pmddomingos) 3 ottobre 2024

Kill Bill

Gavin Newsom ha dovuto decidere se mettere un limitatore di giri di sicurezza agli sviluppatori di IA o lasciarli andare a tutto vapore. Alla fine, ha deciso di porre il veto alla legge californiana SB 1047 sulla sicurezza dell'IA e ha offerto alcuni interessanti motivi per farlo.

Siamo già ad un punto in cui ci troviamo di fronte a veri e propri rischi legati all'IA?

La situazione è degenerata rapidamente https://t.co/xhZCITRJjE pic.twitter.com/aLZn4blS8G

- AI Notkilleveryoneism Memes ⏸️ (@AISafetyMemes) 30 settembre 2024

Nell'ultimo mese Newsom ha firmato una serie di proposte di legge sull'IA relative a deepfakes, watermarking dell'IA, sicurezza dei bambini, diritti degli artisti e disinformazione elettorale. La scorsa settimana ha firmato AB 2013, che darà una bella scossa al creatore di LLM.s.

Il disegno di legge prevede che entro il 1° gennaio 2026 gli sviluppatori dovranno fornire un riepilogo di alto livello del set di dati di addestramento di qualsiasi modello realizzato a partire dal 1° gennaio 2022, se il modello è reso disponibile in California. Alcuni di questi requisiti potrebbero rivelare alcuni sporchi segreti.

Altre norme UE sull'IA

L'UE è chiaramente molto più preoccupata della sicurezza delle IA rispetto al resto del mondo. Oppure si divertono a scrivere e approvare leggi. Questa settimana hanno dato il via a un progetto per la stesura di un codice di condotta per l'IA per cercare di bilanciare innovazione e sicurezza.

Quando si vedrà chi è a capo del gruppo tecnico di sicurezza, si avrà una buona idea di quale sarà la sua posizione.

Modelli di fondotinta liquidi

I modelli Transformer sono quelli che ci hanno regalato il ChatGPT, ma di recente si è discusso molto sul fatto che siano in grado di fornire il prossimo salto di qualità nell'AI. Un'azienda chiamata Liquid AI sta dando una scossa alle cose con il suo Modelli di fondazione liquida (LFM).

Non si tratta delle tipiche IA generative. Le LFM sono specificamente ottimizzate per gestire dati con un contesto più lungo, il che le rende ideali per le attività che devono gestire dati sequenziali come testo, audio o video.

Gli LFM raggiungono prestazioni impressionanti con un modello molto più piccolo, meno memoria e meno calcolo.

NVIDIA si apre

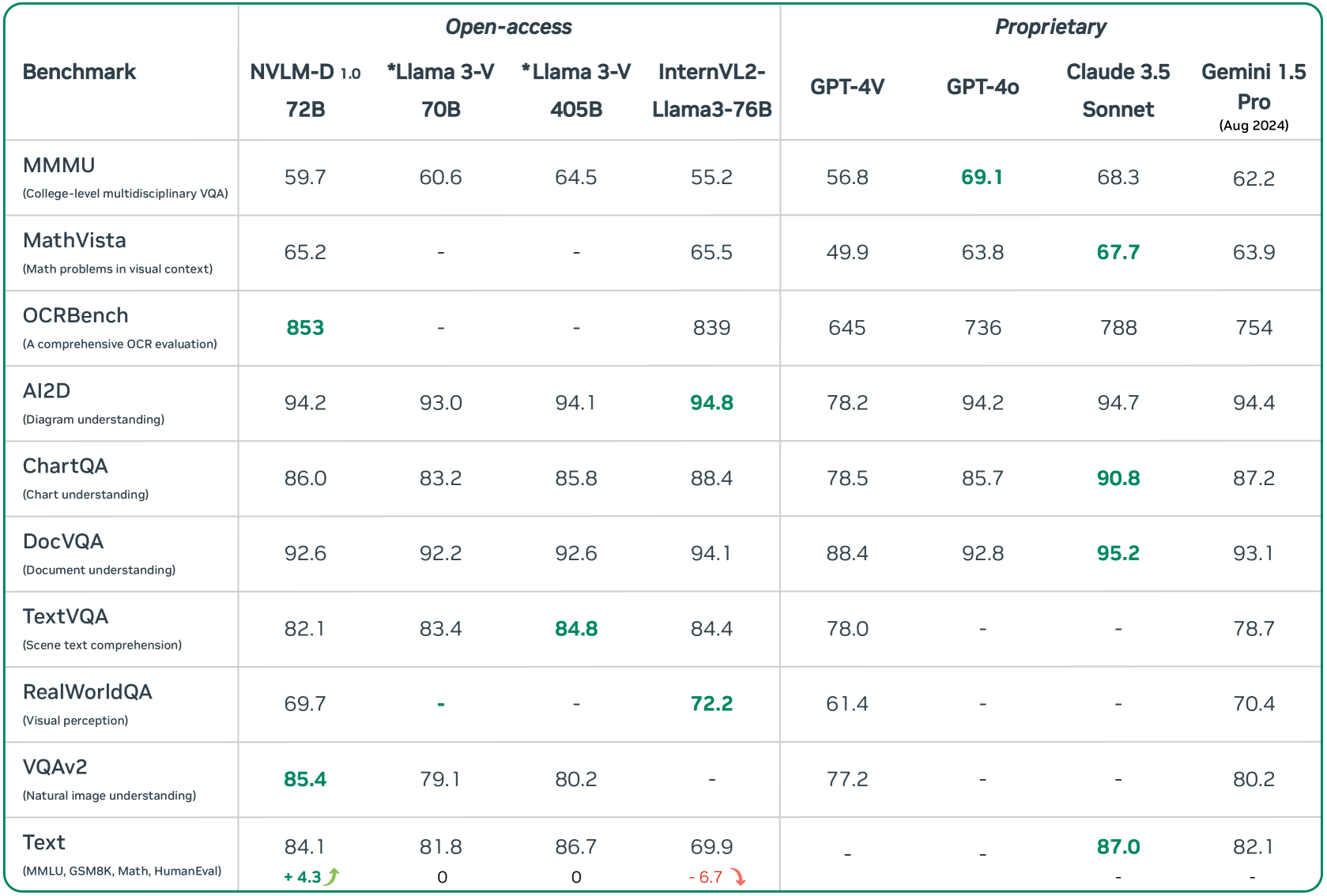

Nvidia ha appena lanciato un gioco che cambia le carte in tavola: un modello di intelligenza artificiale open-source che si confronta con i grandi player come OpenAI e Google. La loro nuova linea NVLM 1.0, guidata dal parametro di punta 72B NVLM-D-72B, brilla sia nelle attività di visione che in quelle linguistiche, migliorando anche le capacità di solo testo.

Con i pesi aperti e la promessa di NVIDIA di rilasciare il codice, è sempre più difficile giustificare il pagamento di modelli proprietari per molti casi d'uso.

Dite solo di sapere

Un nuovo studio ha rilevato che i più recenti modelli linguistici di grandi dimensioni (LLM) sono meno propensi ad ammettere di non conoscere una risposta alla domanda di un utente. Quando gli utenti pongono una domanda a questi modelli, è più probabile che si inventino qualcosa piuttosto che ammettere di non conoscere la risposta.

Lo studio evidenzia la necessità di un cambiamento fondamentale nella progettazione e nello sviluppo dell'IA generica, soprattutto quando viene utilizzata in settori ad alto rischio. I ricercatori stanno ancora cercando di capire perché i modelli di IA sono così desiderosi di accontentarci invece di dire: "Scusa, non conosco la risposta".

AI all'interno

Sembra che tutti stiano apponendo l'etichetta "AI" sui loro prodotti per attirare i clienti. Ecco alcuni strumenti basati sull'intelligenza artificiale che vale la pena di provare.

Bluedot: Registrate, trascrivete e riassumete le vostre riunioni con note generate dall'intelligenza artificiale senza l'ausilio di un bot.

Guida: Guidde trasforma magicamente i vostri flussi di lavoro in guide video passo-passo, complete di voci fuori campo generate dall'intelligenza artificiale e immagini di livello professionale, il tutto in pochi clic.

Altre notizie...

Ecco altre storie di AI degne di nota che ci sono piaciute questa settimana:

- Gli occhiali intelligenti alimentati dall'intelligenza artificiale di Meta aumentano preoccupazioni sulla privacy e sui dati degli utenti.

- Gli strumenti di intelligenza artificiale sono vuotare il sacco su segreti aziendali imbarazzanti.

- Il MIT fa un una svolta nella robotica per gestire il caos della vita reale.

- LinkedIn deve affrontare complicazioni legali sull'integrazione dell'intelligenza artificiale.

- Anthropic assunzioni Durk Kingma, cofondatore di OpenAI.

- Y Combinator è stata criticata dopo aver sostenuto una startup di intelligenza artificiale che ammette di aver clonato un'altra startup di intelligenza artificiale.

E questo è quanto.

Se vivete in California, ci piacerebbe sapere cosa ne pensate del veto alla SB 1047. È un'opportunità mancata per la sicurezza dell'IA o un passo positivo che ci permetterà di ottenere presto l'IA? Con modelli open-source potenti come la nuova bomba di NVIDIA, sarà comunque più difficile regolamentare gli LLM.

L'API in tempo reale di OpenAI è stato il pezzo forte di questa settimana. Anche se non siete sviluppatori, la prospettiva di interagire con bot di assistenza clienti più intelligenti che parlano con voi è piuttosto interessante. A meno che non lavoriate come agenti del servizio clienti e non vogliate mantenere il vostro lavoro.

Fateci sapere cosa ne pensate, seguici su Xe inviateci i link alle cose interessanti sull'IA che potrebbero esserci sfuggite.