Gli esseri umani possono imparare a individuare in modo affidabile i falsi generati dall'intelligenza artificiale? Che impatto hanno su di noi a livello cognitivo?

Il sistema Sora di OpenAI ha recentemente anticipato una nuova ondata di media sintetici alimentati dall'intelligenza artificiale. Probabilmente non passerà molto tempo prima che una qualsiasi forma di media realistico - audio, video o immagine - può essere generato con dei prompt in pochi secondi.

Man mano che questi sistemi di intelligenza artificiale diventano sempre più capaci, dovremo affinare nuove capacità di pensiero critico per separare la verità dalla finzione.

Finora, gli sforzi di Big Tech per rallentare o fermare i deep fake hanno ottenuto ben poco, non per mancanza di convinzione ma perché i contenuti dell'AI sono così realistici.

Questo lo rende difficile da rilevare a livello di pixelmentre altri segnali, come i metadati e le filigrane, hanno i loro difetti.

Inoltre, anche se i contenuti generati dall'intelligenza artificiale fossero rilevabili su scala, è difficile separare i contenuti autentici e mirati da quelli destinati a diffondere disinformazione.

Il passaggio dei contenuti a revisori umani e l'utilizzo di "note della comunità" (informazioni allegate ai contenuti, spesso visibili su X) rappresentano una possibile soluzione. Tuttavia, ciò comporta talvolta un'interpretazione soggettiva e rischia di comportare un'etichettatura errata.

Ad esempio, nel Il conflitto israelo-palestineseAbbiamo assistito a immagini inquietanti etichettate come vere quando invece erano false e viceversa.

Quando un'immagine reale viene etichettata come falsa, si può creare una 'dividendo bugiardoin cui qualcuno o qualcosa può far passare la verità come falsa.

Quindi, in assenza di metodi tecnici per fermare le falsificazioni profonde dal punto di vista tecnologico, cosa possiamo fare?

E in che misura le falsificazioni profonde influiscono sul nostro processo decisionale e sulla nostra psicologia?

Ad esempio, quando le persone sono esposte a immagini politiche false, questo ha un impatto tangibile sul loro comportamento di voto?

Vediamo un paio di studi che valutano proprio questo aspetto.

I falsi profondi influenzano le nostre opinioni e i nostri stati psicologici?

Uno studio del 2020Il progetto "Deepfakes and Disinformation: Exploring the Impact of Synthetic Political Video on Deception, Uncertainty, and Trust in News", ha analizzato come i video deep fake influenzino la percezione del pubblico, in particolare per quanto riguarda la fiducia nelle notizie condivise sui social media.

La ricerca ha coinvolto un esperimento su larga scala con 2.005 partecipanti del Regno Unito, progettato per misurare le reazioni a diversi tipi di video deep fake dell'ex Presidente degli Stati Uniti Barack Obama.

I partecipanti sono stati assegnati in modo casuale alla visione di uno dei tre video:

- Una clip di 4 secondi che mostra Obama che fa una dichiarazione sorprendente senza alcun contesto.

- Una clip di 26 secondi che includeva alcuni accenni alla natura artificiale del video, ma che era soprattutto ingannevole.

- Un video completo con una "rivelazione educativa" in cui viene esplicitamente rivelata la natura artificiale del deep fake, con Jordan Peele che spiega la tecnologia alla base del deep fake.

Risultati principali

Lo studio ha esplorato tre aree chiave:

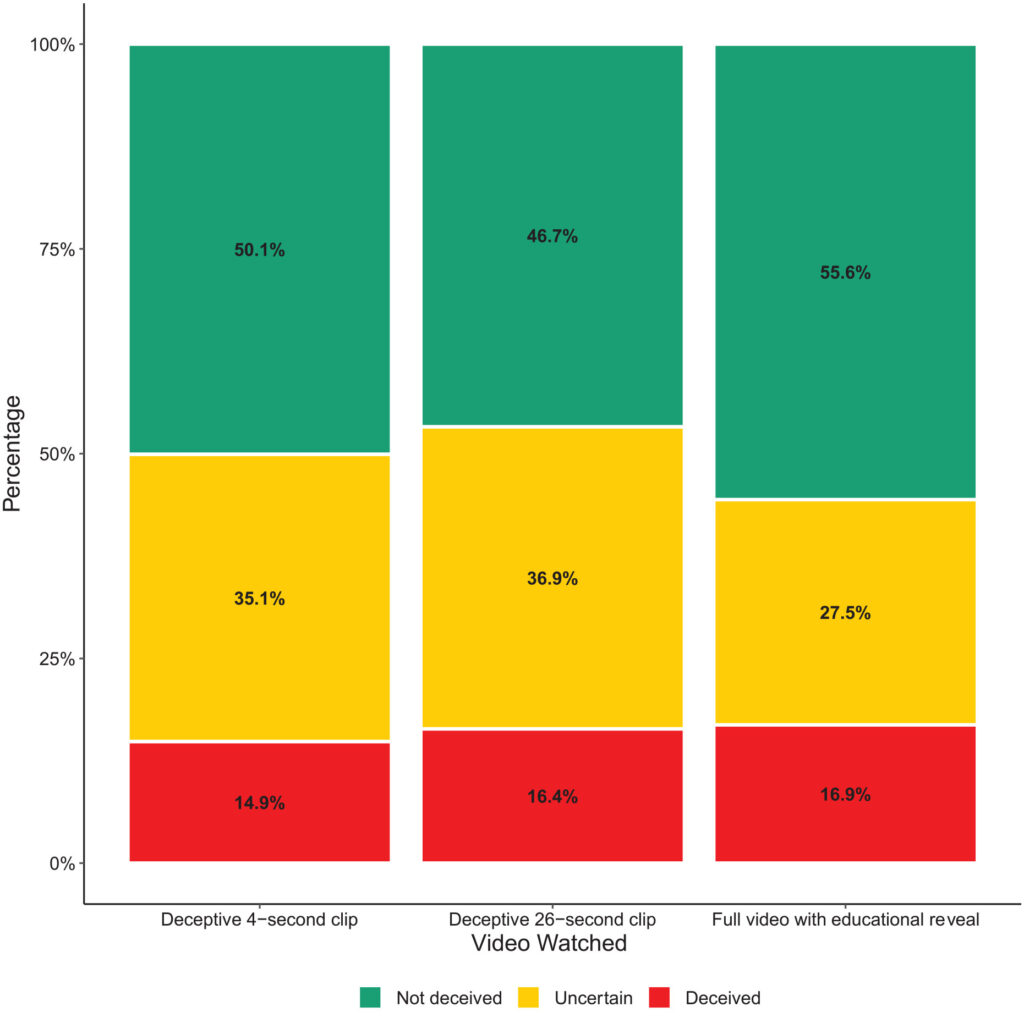

- L'inganno: Lo studio ha trovato prove minime del fatto che i partecipanti credessero alle false affermazioni contenute nei falsi profondi. La percentuale di partecipanti che sono stati ingannati dai falsi profondi è stata relativamente bassa in tutti i gruppi di trattamento.

- Incertezza: Tuttavia, un risultato fondamentale è stato l'aumento dell'incertezza tra gli spettatori, soprattutto quelli che hanno visto i clip più brevi e ingannevoli. Circa il 35,1% dei partecipanti che hanno visto il clip di 4 secondi e il 36,9% che hanno visto il clip di 26 secondi hanno riferito di sentirsi incerti sull'autenticità del video. Al contrario, solo il 27,5% di coloro che hanno visto il video didattico completo si è sentito così.

- Fiducia nelle notizie: Questa incertezza ha influito negativamente sulla fiducia dei partecipanti nelle notizie sui social media. Coloro che sono stati esposti ai falsi ingannevoli hanno mostrato livelli di fiducia inferiori rispetto a coloro che hanno visto la rivelazione educativa.

Questo dimostra che l'esposizione a immagini falsificate profonde provoca un'incertezza a lungo termine.

Nel tempo, le immagini false potrebbero indebolire la fiducia in tutte le informazioni, compresa la verità.

Risultati simili sono stati dimostrati da un studio più recente del 2023Face/Off: Changing the face of movies with deepfake", che ha concluso che le immagini false hanno un impatto a lungo termine.

Le persone "ricordano" i contenuti falsi dopo averli esposti

Condotto su 436 partecipanti, lo studio Face/Off ha analizzato come i falsi profondi possano influenzare il nostro ricordo dei film.

I partecipanti hanno preso parte a un sondaggio online progettato per esaminare le loro percezioni e i loro ricordi dei remake di film reali e immaginari.

Il nucleo del sondaggio consisteva nel presentare ai partecipanti sei titoli di film, che comprendevano un mix di quattro remake di film reali e due di film fittizi.

MI film sono stati randomizzati e presentati in due formati: metà dei film sono stati introdotti attraverso brevi descrizioni testuali, mentre l'altra metà è stata abbinata a brevi videoclip.

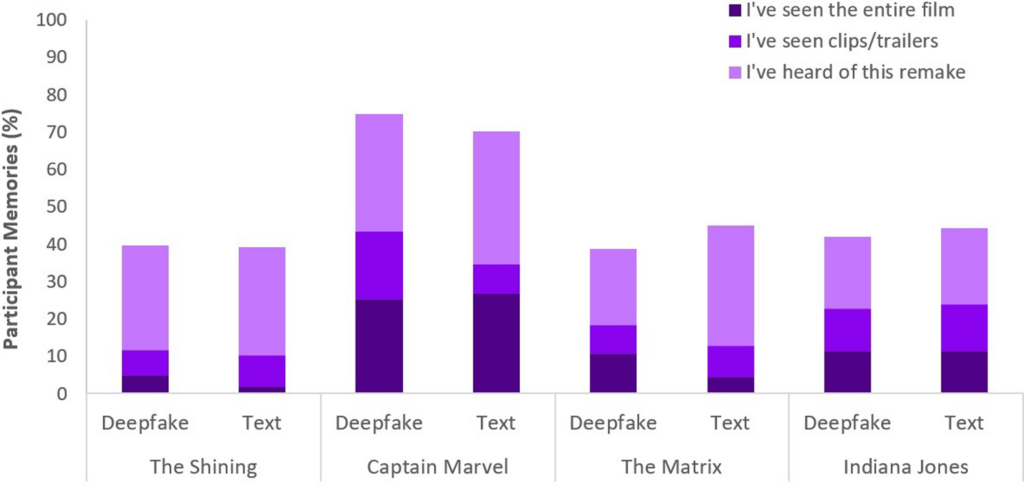

I remake di film fittizi consistevano in versioni di "Shining", "Matrix", "Indiana Jones" e "Capitan Marvel", complete di descrizioni che affermavano falsamente il coinvolgimento di attori di alto profilo in questi remake inesistenti.

Ad esempio, ai partecipanti è stato raccontato di un falso remake di "Shining" con Brad Pitt e Angelina Jolie, che non è mai stato realizzato.

Al contrario, i remake di film reali presentati nel sondaggio, come "Charlie e la fabbrica di cioccolato" e "Total Recall", erano descritti accuratamente e accompagnati da filmati autentici. Questo mix di remake veri e falsi aveva lo scopo di indagare il modo in cui i partecipanti discernono tra contenuti reali e contenuti inventati.

I partecipanti sono stati interrogati sulla loro familiarità con ciascun film, chiedendo loro se avessero visto il film originale o il remake o se ne avessero una conoscenza precedente.

Risultati principali

- Fenomeno della falsa memoria: Un risultato chiave dello studio è la rivelazione che quasi la metà dei partecipanti (49%) ha sviluppato falsi ricordi della visione di remake fittizi, come immaginare Will Smith nei panni di Neo in "Matrix". Ciò illustra l'effetto duraturo che i media suggestivi, siano essi video falsi o descrizioni testuali, possono avere sulla nostra memoria.

- In particolare"Capitan Marvel" è in cima alla lista, con 73% di partecipanti che ricordano il suo remake di AI, seguito da "Indiana Jones" con 43%, "Matrix" con 42% e "Shining" con 40%. Tra coloro che credevano erroneamente in questi remake, 41% pensavano che il remake di "Captain Marvel" fosse superiore all'originale.

- Influenza comparata di falsi profondi e testo: Un'altra scoperta è che i falsi profondi, nonostante il loro realismo visivo e uditivo, non sono stati più efficaci nell'alterare i ricordi dei partecipanti rispetto alle descrizioni testuali dello stesso contenuto fittizio. Ciò suggerisce che il formato della disinformazione - visiva o testuale - non altera significativamente il suo impatto sulla distorsione della memoria nel contesto del film.

Il fenomeno della falsa memoria, oggetto di questo studio, è ampiamente studiato. Dimostra come gli esseri umani costruiscano o ricostruiscano efficacemente falsi ricordi che siamo certi siano reali quando invece non lo sono.

Tutti sono suscettibili di costruire falsi ricordi, e dI falsi sembrano attivare questo comportamento, il che significa che la visione di certi contenuti può cambiare la nostra percezione, anche quando capiamo consapevolmente che non sono autentici.

In entrambi gli studi, i falsi profondi hanno avuto un impatto tangibile e potenzialmente a lungo termine. L'effetto potrebbe essere subdolo e accumularsi nel tempo.

Dobbiamo anche ricordare che i contenuti falsi circolano tra milioni di persone, per cui i piccoli cambiamenti di percezione si estendono a tutta la popolazione globale.

Cosa fare per i falsi profondi?

Fare la guerra ai falsi profondi significa combattere il cervello umano.

Se negli ultimi anni l'aumento delle fake news e della disinformazione ha costretto le persone a sviluppare una nuova alfabetizzazione mediatica, i media sintetici generati dall'IA richiederanno un nuovo livello di adattamento.

Abbiamo già affrontato punti di inflessione di questo tipo in passato, dalla fotografia agli effetti speciali in CGI, ma l'intelligenza artificiale richiederà un'evoluzione dei nostri sensi critici.

Oggi dobbiamo andare oltre la semplice fiducia nei nostri occhi e affidarci maggiormente all'analisi delle fonti e degli indizi contestuali.

È essenziale interrogare gli incentivi o i pregiudizi dei contenuti. Corrisponde ai fatti noti o li contraddice? Esistono prove di conferma da altre fonti attendibili?

Un altro aspetto fondamentale è la definizione di standard legali per identificare i media falsificati o manipolati e ritenere i creatori responsabili.

Il Legge USA sulla DIFESALa legge britannica sulla sicurezza online e le altre leggi equivalenti in tutto il mondo stanno istituendo procedure legali per la gestione dei falsi profondi. Resta da vedere quanto saranno efficaci.

Strategie per svelare la verità

Concludiamo con cinque strategie per identificare e interrogare potenziali falsi profondi.

Anche se nessuna strategia è impeccabile, la promozione di una mentalità critica è la cosa migliore che possiamo fare collettivamente per ridurre l'impatto della disinformazione dell'IA.

- Verifica della fonte: Esaminare la credibilità e l'origine delle informazioni è un passo fondamentale. I contenuti autentici provengono spesso da fonti autorevoli e affidabili.

- Analisi tecnica: Nonostante la loro sofisticatezza, i falsi profondi possono presentare difetti sottili, come espressioni facciali irregolari o illuminazione incoerente. Esaminate i contenuti e valutate se sono stati alterati digitalmente.

- Riferimenti incrociati: La verifica delle informazioni rispetto a più fonti attendibili può fornire una prospettiva più ampia e contribuire a confermare l'autenticità dei contenuti.

- Alfabetizzazione digitale: La comprensione delle capacità e dei limiti delle tecnologie AI è fondamentale per la valutazione dei contenuti. L'educazione all'alfabetizzazione digitale nelle scuole e nei media, compreso il funzionamento dell'IA e le sue implicazioni etiche, sarà fondamentale.

- Interazione cauta: L'interazione con la disinformazione generata dall'IA ne amplifica gli effetti. Fate attenzione quando mettete "mi piace", condividete o ripubblicate contenuti di cui non siete sicuri.

Con l'evoluzione delle falsificazioni profonde, si evolveranno anche le tecniche necessarie per rilevarle e mitigarne i danni. Il 2024 sarà un anno rivelatore, poiché circa la metà della popolazione mondiale voterà alle principali elezioni.

L'evidenza suggerisce che le falsificazioni profonde possono influenzare la nostra percezione, quindi è tutt'altro che stravagante pensare che la disinformazione dell'IA possa avere un impatto concreto sui risultati.

Nel futuro, le pratiche etiche di IA, l'alfabetizzazione digitale, la regolamentazione e l'impegno critico saranno fondamentali per plasmare un futuro in cui la tecnologia amplifichi, anziché oscurare, l'essenza della verità.