Siamo entrati in un'epoca in cui non ci si può fidare di ciò che si vede online.

Sebbene questa affermazione sia stata parzialmente vera per decenni, l'intelligenza artificiale ha elevato la manipolazione dei contenuti a nuovi livelli, superando di gran lunga la consapevolezza del pubblico.

La tecnologia AI deep fake può creare e alterare immagini, video e registrazioni audio, mettendo le parole in bocca a personaggi pubblici o facendoli apparire in situazioni che non si sono mai verificate.

In molti casi, è necessario più di un secondo sguardo per determinare l'autenticità di un contenuto e i media falsi possono accumulare milioni di impressioni prima di essere identificati.

Ora stiamo assistendo a falsificazioni profonde che possono potenzialmente interrompere i processi democratici, anche se è troppo presto per misurare impatti tangibili sul comportamento di voto.

Esaminiamo alcuni dei più importanti incidenti politici di AI deep fake a cui abbiamo assistito finora.

Joe Biden incidente nel New Hampshire

Gennaio 2024, A New Hampshire, USA, a robocall che imita la voce di Biden ha incoraggiato gli elettori a "conservare il voto per le elezioni di novembre", suggerendo erroneamente che la partecipazione alle primarie avrebbe inavvertitamente favorito Donald Trump.

È stata attribuita al numero di cellulare personale di Kathy Sullivan, ex presidente del Partito Democratico. Sullivan ha condannato l'atto come una palese forma di interferenza elettorale e di molestia personale.

L'ufficio del procuratore generale del New Hampshire ha dichiarato che si tratta di uno sforzo illegale per disturbare le primarie presidenziali e sopprimere l'affluenza alle urne.

L'audio fabbricato è stato identificato come generato da ElevenLabs, leader nel settore della sintesi vocale.

ElevenLabs ha poi sospeso il colpevole dietro la falsa voce di Biden e ha dichiarato: "Ci impegniamo a prevenire l'uso improprio degli strumenti di audio AI e prendiamo estremamente sul serio qualsiasi episodio di abuso".

Il cancelliere tedesco Olaf Scholz ha approfondito il falso incidente

Nel novembre 2023, la Germania ha assistito a un deep fake dell'AI che ritraeva falsamente il cancelliere Olaf Scholz mentre appoggiava il divieto del partito di estrema destra Alternativa per la Germania (AfD).

Questo video, profondamente falso, faceva parte di una campagna di un gruppo di attivismo artistico, il Centro per la bellezza politica (CPB)e mira ad attirare l'attenzione sulla crescente influenza dell'AfD. Le critiche all'AfD si rifanno alla storia della Germania degli anni Trenta.

Guidato dal filosofo e artista Philipp Ruch, il gruppo CPB si propone di creare "poesia politica" e "bellezza morale", affrontando temi chiave della contemporaneità come le violazioni dei diritti umani, la dittatura e il genocidio.

Il CPB si è impegnato in numerosi progetti controversi, come ad esempio la Installazione "Search for Us" vicino al Bundestagche, a loro dire, conteneva terra proveniente da ex campi di sterminio e resti di vittime dell'Olocausto.

Mentre il sostegno all'AfD è cresciuto, numerose proteste in tutta la Germania dimostrano una forte opposizione alle ideologie dell'AfD.

Un portavoce del gruppo dietro il deep fake ha dichiarato: "Ai nostri occhi, l'estremismo di destra in Germania che siede in parlamento è più pericoloso".

I funzionari dell'AfD hanno definito la campagna deep fake una tattica ingannevole volta a screditare il partito e a influenzare l'opinione pubblica.

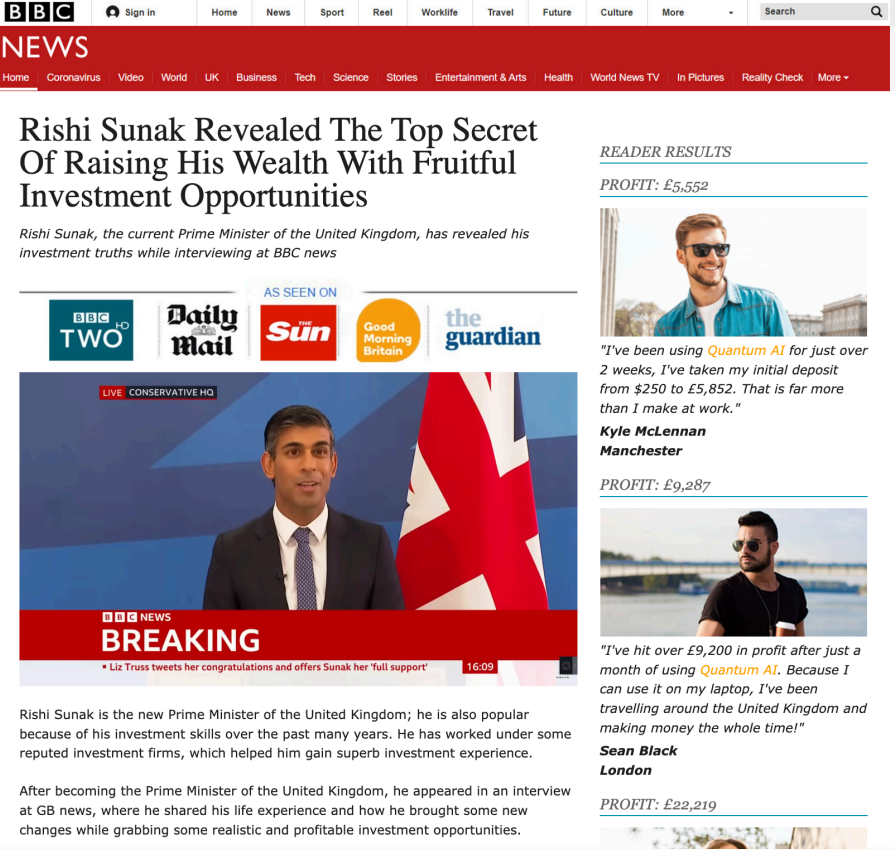

Il primo ministro britannico Rishi Sunak coinvolto in una truffa

Nel gennaio 2024, una società di ricerca britannica ha scoperto che il PM Rishi Sunak era coinvolto in oltre 100 pubblicità video ingannevoli diffuse principalmente su Facebook, raggiungendo circa 400.000 persone.

Questi annunci, provenienti da vari Paesi, tra cui Stati Uniti, Turchia, Malesia e Filippine, promuovevano schemi di investimento fraudolenti falsamente associati a figure di alto profilo come Elon Musk.

La ricerca, condotta dalla società di comunicazione online società Fenimore Harperha evidenziato come le aziende di social media non stiano rispondendo a questa forma di contenuto in tempi ragionevoli.

Marcus Beard, fondatore di Fenimore Harper, ha spiegato come l'AI democratizzi la disinformazione: "Con l'avvento della clonazione vocale e facciale a basso costo e facile da usare, ci vogliono pochissime conoscenze e competenze per usare le sembianze di una persona per scopi malevoli".

Beard ha anche criticato l'inadeguatezza della moderazione dei contenuti sui social media, osservando: "Questi annunci sono contrari a diverse politiche pubblicitarie di Facebook. Tuttavia, pochissimi degli annunci che abbiamo riscontrato sembrano essere stati rimossi".

Il governo britannico ha risposto al rischio di falsificazioni fraudolente: "Stiamo lavorando intensamente in tutto il governo per assicurarci di essere pronti a rispondere rapidamente a qualsiasi minaccia ai nostri processi democratici attraverso la nostra taskforce per la difesa della democrazia e i team governativi dedicati".

Il primo ministro pakistano Imran Khan appare in un raduno virtuale

Nel dicembre 2023, l'ex Primo Ministro del Pakistan, Imran Khan, attualmente in carcere con l'accusa di aver divulgato segreti di Stato, viene arrestato, è apparso in un raduno virtuale utilizzando l'intelligenza artificiale.

Nonostante sia dietro le sbarre, l'avatar digitale di Khan è stato seguito da milioni di persone. La manifestazione conteneva filmati di discorsi tenuti in passato dal suo partito politico, il Pakistan Tehreek-e-Insaaf (PTI).

Il discorso di Khan, durato quattro minuti, ha parlato di resilienza e sfida contro la repressione politica subita dai membri del PTI.

La voce di AI ha articolato: "Al nostro partito non è permesso tenere comizi pubblici. La nostra gente viene rapita e le loro famiglie vengono molestate", continuando: "La storia ricorderà i vostri sacrifici".

Confondendo la situazione, il governo pakistano avrebbe cercato di bloccare l'accesso alla manifestazione.

NetBlocks, un'organizzazione di monitoraggio di Internet, ha dichiarato: "Le metriche mostrano che le principali piattaforme di social media sono state limitate in Pakistan per [quasi] 7 ore domenica sera durante un raduno politico online; l'incidente è coerente con i precedenti casi di censura di Internet che hanno preso di mira il leader dell'opposizione Imran Khan e il suo partito PTI".

ℹ️ ICYMI: le metriche mostrano che le principali piattaforme di social media sono state limitate in #Pakistan per circa 7 ore domenica sera durante un raduno politico online; l'incidente è coerente con i precedenti casi di censura di Internet che hanno colpito il leader dell'opposizione Imran Khan e il suo partito PTI. https://t.co/AS9SdfwqoH pic.twitter.com/XXMYBhknXd

- NetBlocks (@netblocks) 18 dicembre 2023

Usama Khilji, sostenitore della libertà di parola in Pakistan, ha commentato: "Con un giro di vite totale sul diritto alla libertà di associazione e di parola del PTI attraverso l'arresto della leadership, l'uso dell'intelligenza artificiale da parte del partito per trasmettere un discorso virtuale con le parole del suo presidente incarcerato e dell'ex primo ministro Imran Khan segna un nuovo punto nell'uso della tecnologia nella politica pakistana".

Falso audio dell'ex presidente sudanese Omar al-Bashir su TikTok

Una campagna basata sull'intelligenza artificiale su TikTok ha sfruttato la voce di l'ex presidente sudanese Omar al-Bashir in mezzo ai continui disordini civili del Paese.

Dalla fine di agosto 2023, un account anonimo ha pubblicato quelle che sostiene essere "registrazioni trapelate" di al-Bashir. Tuttavia, gli analisti hanno determinato che le registrazioni erano falsi generati dall'intelligenza artificiale.

al-Bashir' è assente dalla scena pubblica da quando è stato estromesso dal Paese nel 2019 a causa di gravi accuse di crimini di guerra.

La truffa audio del giorno delle elezioni in Slovacchia

Il giorno delle elezioni in Slovacchia, un audio controverso presentava falsi profondi di Michal Šimečka, leader del partito Slovacchia Progressista, e della giornalista Monika Tódová che discutevano di pratiche di corruzione come la compravendita di voti.

La vicenda è emersa durante il blackout mediatico pre-elettorale della Slovacchia, per cui le persone coinvolte non hanno potuto facilmente smentire pubblicamente il loro coinvolgimento prima dell'ora solare.

Entrambe le parti coinvolte hanno poi denunciato la registrazione come falso profondo, che un'agenzia di fact-checking ha confermato.

Il falso profondo di Volodymyr Zelenskiy

Nel 2023, un video falso del presidente ucraino Volodymyr Zelenskiy, che suggeriva in modo amatoriale che stesse chiamando i soldati ad abbandonare le loro postazioni, è stato rapidamente identificato come falso e rimosso dalle principali piattaforme di social media.

Elezioni turche: un falso dramma

In vista delle elezioni parlamentari e presidenziali in Turchia, è stato diffuso online un video che mostrava falsamente che il principale sfidante del presidente Recep Tayyip Erdoğan, Kemal Kılıçdaroğlu, riceveva sostegno dal PKK.

Donald Trump falso profondo

All'inizio del 2023, abbiamo assistito a simulazioni realistiche dell'arresto di Donald Trump e a un video della campagna elettorale di Ron DeSantis con immagini generate dall'intelligenza artificiale di Trump che abbraccia Anthony Fauci.

Il partito politico belga ha dichiarato che Trump è un falso profondo

Un precedente incidente nel 2018 in Belgio ha causato un tumulto politico, quando un video falso creato da un partito politico ha suscitato l'indignazione dell'opinione pubblica.

Il video ritraeva falsamente il Presidente Donald Trump che consigliava al Belgio di ritirarsi dall'accordo sul clima di Parigi.

Il video faceva parte di un falso ad alta tecnologia, che è stato poi riconosciuto dal team mediatico del partito. Ha dimostrato come i falsi profondi possano essere usati per fabbricare dichiarazioni di leader mondiali per influenzare l'opinione pubblica e la politica.

Il falso profondo di Nancy Pelosi

Un video manipolato di Nancy Pelosi nel 2020, fatto apparire come se stesse biascicando e fosse ubriaca, si è diffuso rapidamente sui social media.

Ciò ha dimostrato il potenziale dei deep fake per screditare e mettere in imbarazzo personaggi pubblici, che spesso persiste anche dopo che il contenuto è stato ritenuto falso.

Audio deepfake di Keir Starmer

Un altro incidente nella politica britannica ha riguardato una clip audio che avrebbe ripreso il leader dell'opposizione Sir Keir Starmer mentre imprecava contro il suo staff.

La clip, ampiamente diffusa sui social media, è stata poi rivelata essere un deep fake generato dall'AI.

Man mano che le aziende tecnologiche esplorano modi per affrontare le falsificazioni profonde su scala, i modelli di intelligenza artificiale utilizzati per creare i media falsi diventeranno sempre più sofisticati e facili da usare.

Il viaggio che ci attende richiede uno sforzo di collaborazione tra tecnologi, politici e pubblico per sfruttare i vantaggi dell'IA salvaguardando i pilastri di fiducia e integrità della nostra società.

La fiducia nella politica e nelle istituzioni pubbliche è già a dir poco inconsistente. I falsi profondi la minano ulteriormente.