L'intelligenza artificiale sta permeando la vita di milioni di persone in tutto il mondo, ma nonostante l'ampia diffusione, la tecnologia si sta rivelando difficile da monetizzare tra costi sempre più elevati.

Gli strumenti di intelligenza artificiale generativa come ChatGPT sono costosi da eseguire e richiedono server di fascia alta, GPU costose e hardware ausiliario esteso che consuma molta energia.

Anche se in gran parte non verificato, Dylan Patel di SemiAnalysis ha raccontato le informazioni che OpenAI avrebbe fatto un fork di alcuni $700.000 al giorno per far funzionare i suoi modelli, registrando perdite per quasi $500 milioni nel 2022.

John Hennessy, presidente della società madre di Google, Alphabet, ha affermato che un singolo prompt su Bard costa fino a 10 volte di più di una ricerca su GoogleGli analisti ritengono che Google sosterrà spese miliardarie per l'intelligenza artificiale nei prossimi anni.

Il 2023 è stato un banco di prova per la monetizzazione dell'IA. Giganti tecnologici come Microsoft, Google e Adobe, tra gli altri, stanno tentando un'ampia varietà di approcci diversi per creare, promuovere e prezzare le loro offerte di IA.

La maggior parte dei modelli commerciali come ChatGPT, Bard e Claude 2 di Anthropic limitano già gli utenti a un certo numero di richieste all'ora o al giorno, comprese le versioni a pagamento come ChatGPT Plus. Adobe sta fissando dei limiti di utilizzo mensili per i suoi modelli Firefly.

I costi immensi dell'IA stanno colpendo anche le imprese. Adam Selipsky, CEO di Amazon Web Services (AWS), ha commentato i costi proibitivi per gli utenti aziendali che desiderano creare carichi di lavoro di IA: "Molti dei clienti con cui ho parlato non sono soddisfatti dei costi che vedono per l'esecuzione di alcuni di questi modelli".

Chris Young, responsabile della strategia aziendale di Microsoft, ha osservato che è ancora presto per le imprese che vogliono sfruttare gli attuali modelli di IA, affermando: "Ci vorrà tempo perché le aziende e i consumatori capiscano come vogliono usare l'IA e quanto sono disposti a pagare per questo".

E ha aggiunto: "Siamo chiaramente a un punto in cui dobbiamo tradurre l'entusiasmo e il livello di interesse in una vera e propria adozione".

Modelli di intelligenza artificiale e software

L'intelligenza artificiale non offre la stessa economia del software convenzionale, poiché richiede calcoli specifici per ogni compito.

Quando gli utenti sollecitano un modello come ChatGPT, questo cerca modelli e sequenze dai suoi dati di addestramento nell'architettura della rete neurale e calcola una risposta specifica. Ogni interazione consuma energia e comporta costi continui.

Di conseguenza, con l'aumento dell'adozione, aumentano anche le spese, ponendo una sfida alle aziende che offrono servizi di IA a tariffe forfettarie.

Ad esempio, Microsoft ha recentemente collaborato con OpenAI per introdurre GitHub Copilot, rivolto a programmatori e sviluppatori.

Finora, i suoi alti costi operativi non sono stati redditizi. Nei primi mesi dell'anno, Microsoft ha fatto pagare un abbonamento di $10 al mese per questo assistente AI e ha subito una perdita media di oltre $20 al mese per ogni utente. Alcuni utenti hanno subito perdite fino a $80 al mese, come rivelato da un'indagine di Microsoft. fonte al WSJ.

La suite Copilot di Microsoft per Microsoft 365 (il cui nome è confusamente uguale a quello dello strumento GitHub) prevede un costo aggiuntivo di $30 al mese. Questo strumento offre funzionalità come la stesura autonoma di e-mail, la creazione di presentazioni PowerPoint e di fogli di calcolo Excel.

Allo stesso modo, anche Google si appresta a rilasciare una funzione di assistente AI per i suoi strumenti di lavoro, imponendo un costo mensile aggiuntivo di $30 oltre alle tariffe esistenti.

Sia Microsoft che Google puntano su una tariffa forfettaria mensile, sperando che l'aumento delle tariffe possa compensare adeguatamente i costi medi di alimentazione di questi strumenti di intelligenza artificiale.

Sebbene $30/mese possa sembrare conveniente in alcuni paesi occidentali più sviluppati, questi modelli di prezzo non comprendono gran parte della popolazione mondiale.

Quando ChatGPT Plus è stato lanciato sul mercato indiano, per esempio, molti si sono lamentati del fatto che era troppo costosoche costa una parte significativa del salario mensile medio di $330. Escludere miliardi di utenti dall'IA può costare caro agli sviluppatori quando commercializzano gli strumenti al pubblico.

Il costo non è irrilevante nemmeno per coloro che vivono nei Paesi più ricchi: i sondaggi dimostrano che gli abbonamenti sono tra le prime cose che vengono abbandonate quando si cerca di ridurre le spese.

Perché l'IA è così difficile da monetizzare?

L'intelligenza artificiale presenta un vuoto tra le visioni apparentemente infinite degli sviluppatori e le risorse limitate disponibili per realizzarle.

Sam Altman, CEO di OpenAI afferma che un mondo futuristico integrato nell'IA è semplicemente "inevitabile", in cui le macchine intelligenti vivono accanto a noi, eseguendo i nostri ordini, in cui le persone vivono per centinaia di anni o in modo immortale e in cui le IA integrate nel nostro cervello ci aiutano a svolgere compiti complessi attraverso il nostro solo pensiero.

Mustafaya Suleman, CEO di Inflection, ha recentemente pubblicato il libro "The Coming Wave", in cui paragona l'IA all'esplosione cambriana di 500 milioni di anni fa, che ha portato alla più rapida esplosione dell'evoluzione mai vista sul nostro pianeta.

L'IA generativa è destinata a esplodere, con un fatturato che dovrebbe superare i $1 trilioni entro il 2032. Da dove è partita a dove si trova ora e dove arriverà è sconvolgente... ogni settore sarà trasformato in meglio. pic.twitter.com/0licQGfphn

- Mustafa Suleyman (@mustafasuleyman) 20 ottobre 2023

Le ambizioni alimentano le idee, ma il denaro alimenta l'industria tecnologica. La ricerca e lo sviluppo dell'IA sono costosi, quindi i leader del settore, come OpenAI, Google e Facebook, investono molto per rimanere all'avanguardia.

Nel 2021 le aziende di IA hanno attirato ben $94 miliardi di investimenti, con diversi round di finanziamento che hanno raggiunto $500 milioni o più. L'anno 2023 ha aumentato la posta in gioco, con investimenti nelle startup Antropico e Inflessione superando la soglia di $1 miliardi.

Gli specialisti dell'IA richiedono stipendi importanti, spesso milionari, a causa della concorrenza agguerrita, e i modelli necessitano di una regolare messa a punto e di stress-test, con conseguenti costi aggiuntivi.

Ci sono anche costi accessori relativi ai centri dati e alla manutenzione, in particolare il raffreddamentoPoiché questo tipo di hardware si surriscalda ed è soggetto a guasti se non viene mantenuto alla temperatura ottimale.

In alcune circostanze, le GPU hanno una durata di vita breve, inferiore ai cinque anni, e richiedono spesso una manutenzione specializzata.

Strategie di monetizzazione dell'IA

Alla luce di queste sfide, come stanno affrontando le aziende tecnologiche la sfida della monetizzazione dell'IA?

Aumentare la produttività

Le aziende possono trarre vantaggio dall'IA aumentando in modo significativo la produttività netta della società. Automatizzando le attività ripetitive, le aziende consentono ai professionisti umani di concentrarsi su funzioni a più alto valore aggiunto.

Questo li aiuterà ad attingere a fondi pubblici e privati. Ad esempio, DeepMind collabora con il Servizio Sanitario Nazionale (NHS) nel Regno Unito e le aziende tecnologiche stanno lavorando con i governi per affrontare il cambiamento climatico.

Tuttavia, la produttività guidata dall'IA potrebbe avere un impatto sugli altri flussi di reddito delle aziende tecnologiche. Ad esempio, la società di Google I ricavi pubblicitari sono in calo perché l'AI sottrae traffico al suo motore di ricerca. Quest'anno i ricavi di Google derivanti dagli annunci su YouTube diminuiscono di 2,6%e i ricavi delle reti pubblicitarie si riducono di un 8,3% senza precedenti.

Vendite di hardware

L'addestramento e l'hosting dei modelli di intelligenza artificiale richiedono hardware specializzato di fascia alta. Le GPU sono indispensabili per l'esecuzione di sofisticati algoritmi di IA e rappresentano quindi una componente redditizia dell'ecosistema dell'IA.

Il leader del settore Nvidia è il grande vincitore, con il suo market cap che ha raggiunto la soglia dei $1 trilioni, ma altri produttori di hardware per l'intelligenza artificiale di basso livello ne hanno beneficiato anche loro.

Abbonamenti

L'offerta di miglioramenti dell'intelligenza artificiale come parte di pacchetti di abbonamento è la soluzione ideale per generare entrate da parte di utenti pubblici e aziende che non vogliono o non devono seguire la strada delle API.

ChatGPT Plus è il servizio di AI con il maggior numero di abbonati a livello globale, ma mancano informazioni che descrivano l'entità dei ricavi generati.

OpenAI ha lanciato il suo Variante aziendale quest'anno per incrementare le entrate derivanti dagli abbonamenti e ha dichiarato che l'azienda punta a raggiungere $1 miliardo di entrate nel prossimo anno.

API

Aziende come OpenAI utilizzano un approccio di fatturazione basato su token per gli utenti aziendali e commerciali per le loro API.

Questo sistema garantisce che gli utenti siano fatturati in base all'effettivo carico computazionale delle loro richieste, assicurando equità e trasparenza.

I modelli di prezzo delle API si rivolgono a un ampio spettro di utenti, da quelli che effettuano chiamate sporadiche e leggere a quelli che svolgono attività intensive.

L'intelligenza artificiale come caratteristica intrinseca

Alcune aziende stanno integrando le funzionalità di intelligenza artificiale nei loro prodotti senza farli pagare immediatamente. Questa strategia mira ad aumentare il valore intrinseco del prodotto.

Con il tempo, una volta che gli utenti hanno integrato le funzionalità di IA nei loro flussi di lavoro e ne hanno compreso il valore, sono più propensi ad accettare un successivo aumento dei prezzi. Tuttavia, l'IA deve offrire vantaggi progressivi se i costi aumentano costantemente.

I costi di formazione sull'intelligenza artificiale open source sono sempre più bassi

C'è una discussione parallela: perché qualcuno dovrebbe pagare per l'IA se non la possiede mai?

Alcuni - come il "padrino" dell'IA Yann LeCun - sostengono che l'IA dovrebbe diventare parte della nostra infrastruttura pubblica, sottolineando la necessità per gli sviluppatori di costruire modelli open source che siano economici e di facile accesso.

Un articolo del NYT sul dibattito se i modelli di base dei LLM debbano essere chiusi o aperti.

Meta sostiene l'apertura, a partire dal rilascio di LaMa (per uso non commerciale), mentre OpenAI e Google vogliono mantenere le cose chiuse e proprietarie.

Sostengono che l'apertura può essere...

- Yann LeCun (@ylecun) 18 maggio 2023

Mentre le soluzioni di IA diventano parte integrante delle aziende, molte di esse non dispongono del budget necessario per sviluppare modelli proprietari da zero. Tradizionalmente, si sono rivolti alle API delle startup emergenti di IA o ai sistemi off-the-shelf.

Tuttavia, con la diminuzione dei costi di formazione e la crescente esigenza di riservatezza dei dati, la collaborazione con fornitori specializzati nella personalizzazione di modelli privati e open-source è sempre più favorita.

Naveen Rao, CEO e cofondatore di MosaicML, ha spiegato a The Register che i modelli open source sono allettanti perché più economici, più flessibili e permettono alle aziende di mantenere i carichi di lavoro privati.

MosaicML ha lanciato una serie di modelli linguistici di grandi dimensioni (LLM) open source basati sulla sua architettura MPT-7B. A differenza di molti altri LLM, questo modello è commercialmente accessibile alle masse.

Rao ha spiegato le ragioni che stanno alla base di questo modello: "C'è sicuramente una forte attrazione per questo tipo di cose e lo abbiamo fatto per diversi motivi". E ha aggiunto: "Uno è che volevamo avere un modello che fosse autorizzato all'uso commerciale. Non vogliamo soffocare questo tipo di innovazione".

Per quanto riguarda la convenienza economica, Rao ha dichiarato: "Se un cliente venisse da noi e ci chiedesse di formare questo modello, potremmo farlo per $200.000 e guadagneremmo comunque".

MosaicML fornisce inoltre alle aziende gli strumenti per ospitare in modo efficiente i loro modelli personalizzati su piattaforme cloud. "I loro dati non vengono condivisi con la startup e sono proprietari dei pesi del modello e della sua proprietà intellettuale", ha confermato Rao.

Rao ha anche parlato dei limiti delle API commerciali, affermando: "Le API commerciali sono un ottimo strumento di prototipazione. Penso che con i servizi di tipo ChatGPT la gente li userà per l'intrattenimento e forse per alcune cose personali, ma non per le aziende. I dati sono un fossato molto importante per le aziende".

Rao ha inoltre evidenziato i costi dell'architettura in-house, affermando che "le GPU si guastano molto spesso", "se un nodo va in tilt e c'è bisogno di un intervento manuale e ci sono volute cinque ore [per risolverlo], si è appena bruciato $10.000 senza lavoro, giusto?".

Ha inoltre affrontato il problema incombente della carenza di chip nel settore"Vivremo in questo mondo di carenza di GPU per almeno due anni, forse cinque".

Se le aziende possono attingere all'IA open source per addestrare i loro modelli a basso costo con una sovranità e un controllo totali dei dati, ciò rappresenta una sfida per l'IA pubblica come ChatGPT.

I colli di bottiglia incombenti dell'IA?

Oltre alla carenza di GPU evidenziata da Rao, un altro ostacolo alla monetizzazione dell'IA è rappresentato dai requisiti energetici del settore.

A studio recente prevede che entro il 2027 l'energia consumata dall'industria dell'intelligenza artificiale potrebbe essere equivalente a quella di una piccola nazione.

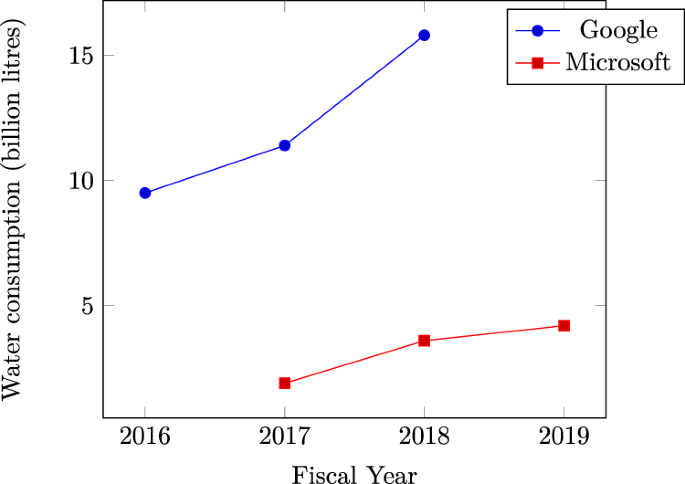

Microsoft consumo d'acqua dei data center alle stelle afferma l'immensa sete di risorse naturali dell'IA. Le prove indicano che i recenti picchi di utilizzo dell'acqua da parte di giganti tecnologici come Microsoft e Google sono attribuiti a carichi di lavoro intensivi legati all'IA.

Su una scala più ampia, l'energia cumulativa utilizzata dai data center supera già le 1% del consumo globale di elettricità, secondo il Agenzia Internazionale dell'Energia (AIE).

Se la domanda di energia continua ad aumentare, le aziende di IA potrebbero essere costrette a rivolgere la loro attenzione allo sviluppo di approcci più efficienti all'addestramento dei modelli, il che potrebbe danneggiare la traiettoria a breve termine della tecnologia.

Narrazioni contrastanti

Il nascente settore dell'intelligenza artificiale è ancora giovane e la sua direzione futura è eccezionalmente difficile da prevedere.

Le figure centrali dell'IA riconoscono che i loro preconcetti non sono sempre in linea con la realtà.

Ad esempio, parlando al podcast di Joe Rogan, Sam Altman ha ammesso di essersi sbagliato sul percorso di sviluppo dell'IA, descrivendo che il percorso per realizzare forme di IA altamente intelligenti sarà granulare piuttosto che esplosivo.

Da un lato, l'IA si sta dimostrando difficile da monetizzare, il che fa dubitare che l'entusiasmo iniziale si plachi, portando a un processo più lento di maturazione della tecnologia.

D'altra parte, l'industria potrebbe aver già compiuto progressi sufficienti per spingere l'IA verso una "singolarità" in cui supera la cognizione umana.

Nei prossimi anni, se l'umanità riuscirà a progredire in campi essenziali come la produzione di energia e la costruzione di hardware e architetture di intelligenza artificiale a basso consumo - e Quest'anno sono stati fatti dei progressi in questo campo - allora la tecnologia potrebbe eliminare i colli di bottiglia a breve termine e continuare il suo scellerato ritmo di sviluppo.