L'IA a une myriade d'utilisations, mais l'une de ses applications les plus préoccupantes est la création de faux médias et de fausses informations.

Une nouvelle étude de Google DeepMind et Scie sauteuseun incubateur technologique de Google qui surveille les menaces sociétales, a analysé l'utilisation abusive de l'IA entre janvier 2023 et mars 2024.

Elle a évalué quelque 200 incidents réels d'utilisation abusive de l'IA, révélant que la création et la diffusion de "deep fake media" trompeurs, en particulier ceux qui ciblent les politiciens et les personnalités publiques, est la forme la plus courante d'utilisation malveillante de l'IA.

Les "deep fakes", médias synthétiques générés à l'aide d'algorithmes d'IA pour créer des images, des vidéos et des sons très réalistes mais faux, sont devenus de plus en plus réalistes et omniprésents.

Des incidents tels que Des fausses images explicites de Taylor Swift apparues sur X ont montré que de telles images peuvent atteindre des millions de personnes avant d'être supprimées.

Mais le plus insidieux, ce sont les contrefaçons profondes ciblées sur des questions politiques, comme le conflit israélo-palestinien. Dans certains cas, même les vérificateurs de faits chargés de les qualifier de "générés par l'IA" ne sont pas en mesure de détecter leur authenticité de manière fiable.

L'étude DeepMind a recueilli des données à partir d'un large éventail de sources, y compris des plateformes de médias sociaux comme X et Reddit, des blogs en ligne et des rapports des médias.

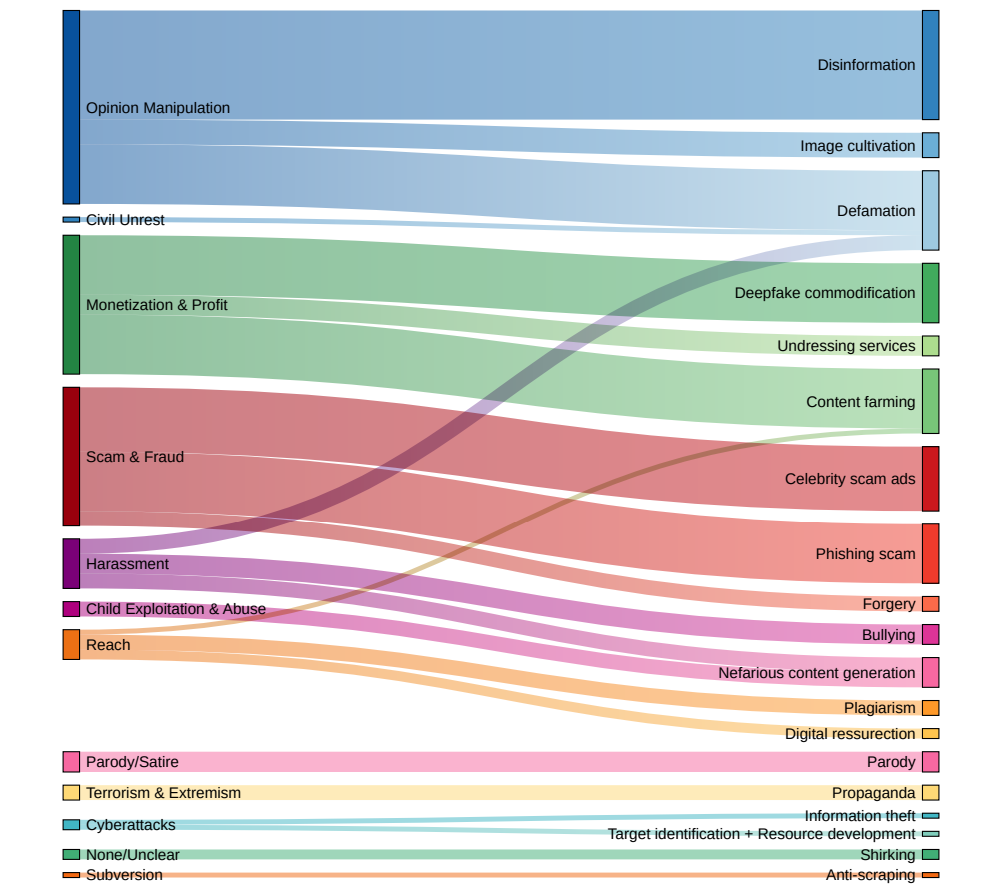

Chaque incident a été analysé afin de déterminer le type spécifique de technologie d'IA utilisée à mauvais escient, l'objectif visé par l'abus et le niveau d'expertise technique requis pour mener à bien l'activité malveillante.

Les "deep fakes" sont la principale forme d'utilisation abusive de l'IA

Les résultats dressent un tableau alarmant du paysage actuel de l'utilisation malveillante de l'IA :

- Les "deep fakes" sont apparus comme la forme dominante d'utilisation abusive de l'IA, représentant près de deux fois plus d'incidents que la catégorie suivante la plus répandue.

- Le deuxième type d'abus d'IA le plus fréquemment observé est l'utilisation de modèles de langage et de chatbots pour générer et diffuser de la désinformation en ligne. En automatisant la création de contenus trompeurs, les acteurs malveillants peuvent inonder les médias sociaux et d'autres plateformes de fake news et de propagande à une échelle sans précédent.

- Influencer l'opinion publique et les récits politiques était la principale motivation de plus d'un quart (27%) des cas d'utilisation abusive de l'IA analysés. Cela illustre la menace que les deep fakes et la désinformation générée par l'IA font peser sur les processus démocratiques et l'intégrité des élections dans le monde entier. incidents récents très médiatisés.

- Le gain financier a été identifié comme le deuxième moteur le plus courant de l'activité d'IA malveillante, des acteurs peu scrupuleux proposant des services rémunérés pour créer des contrefaçons profondes, y compris des images explicites non consensuelles, et utilisant l'IA générative pour produire en masse des contenus falsifiés à des fins lucratives.

- La majorité des incidents liés à l'utilisation abusive de l'IA impliquaient des outils et des services facilement accessibles dont le fonctionnement ne nécessitait qu'une expertise technique minimale. Cette faible barrière à l'entrée élargit considérablement le bassin d'acteurs malveillants potentiels, rendant plus facile que jamais pour les individus et les groupes de se livrer à la tromperie et à la manipulation au moyen de l'IA.

Nahema Marchal, de DeepMind, a expliqué l'évolution du paysage de l'utilisation abusive de l'IA à l'Assemblée générale des Nations unies. Financial Times: "Il y a eu beaucoup d'inquiétudes compréhensibles concernant des cyber-attaques assez sophistiquées facilitées par ces outils".Nous avons vu des utilisations abusives assez courantes de la GenAI [telles que les deep fakes qui] pourraient passer un peu plus inaperçues".

Les décideurs politiques, les entreprises technologiques et les chercheurs doivent collaborer pour élaborer des stratégies globales de détection et de lutte contre les "deepfakes", la désinformation générée par l'IA et d'autres formes d'utilisation abusive de l'IA.

Mais la vérité est qu'ils ont déjà essayé, et qu'ils ont largement échoué. Récemment, nous avons observé un plus grand nombre d'incidents de les enfants se font prendre dans de faux incidents profondsLes résultats de cette étude montrent que les dommages sociétaux qu'ils infligent peuvent être graves.

À l'heure actuelle, les entreprises technologiques ne peuvent pas détecter de manière fiable les "deep fakes" à grande échelle, et ils deviendront de plus en plus réalistes et de plus en plus difficiles à détecter avec le temps.

Et lorsque des systèmes de conversion de texte en vidéo tels que Sora d'OpenAI feront leur apparition, il y aura une toute nouvelle dimension d'imitations profondes à gérer.