La Comisión Federal de Comercio (FTC) tiene la misión de proteger a los consumidores de fraudes y estafas, pero la clonación de voz mediante inteligencia artificial, cada vez más perfeccionada, está dificultando este reto.

Aunque la clonación de voz por IA ha suscitado numerosos debates, existen casos de uso legítimos que hacen que merezca la pena seguir utilizando esta tecnología.

Restaurar un medio personal de comunicación a alguien que ha perdido la voz, o poner voz a un personaje cinematográfico conocido mucho después de que el locutor original haya fallecido, son sólo dos ejemplos. El año pasado, el alcalde de Nueva York, Eric Adams, utilizó un AI clon de su voz para comunicarse en varios idiomas con los residentes de la ciudad.

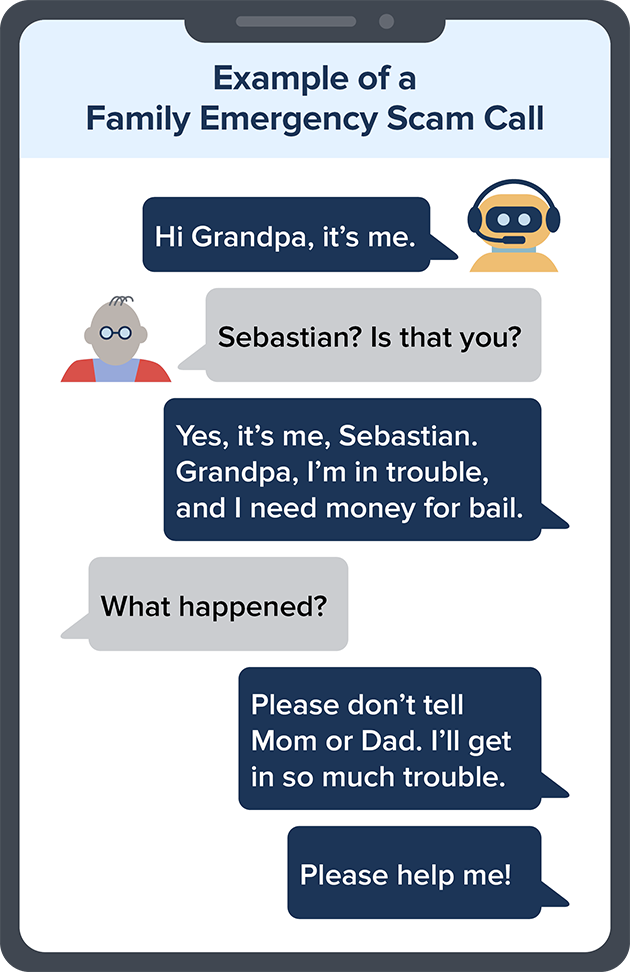

Pero la tecnología también ha facilitado mucho a estafadores y defraudadores la tarea de engañar a personas desprevenidas cuando responden a una llamada telefónica. El año pasado, un Informe McAfee observó un repunte de los fraudes de voz por IA y la FTC advirtió a los consumidores sobre las "estafas de emergencia familiar", en las que quien llama se hace pasar por un familiar en apuros.

Aparte de terminar la llamada y luego llamar a la persona en el número que tiene para ellos, es realmente difícil identificar una voz AI clon de una persona real.

La FTC ha lanzado un reto a particulares u organizaciones para que presenten "ideas innovadoras destinadas a prevenir, controlar y evaluar el uso malintencionado de la tecnología de clonación de voz"

El reto durará del 2 al 12 de enero, y la idea ganadora recibirá una recompensa de $25.000. Si tienes alguna idea brillante puedes envíelos aquí.

Las propuestas deben abordar al menos uno de los tres puntos de intervención que la FTC quiere conseguir:

- Prevención o autenticación: Debe proporcionar una forma de limitar el uso o la aplicación del software de clonación de voz por parte de usuarios no autorizados.

- Detección o supervisión en tiempo real: Debe proporcionar una forma de detectar voces clonadas o el uso de tecnología de clonación de voz.

- Evaluación posterior al uso: Debe proporcionar una forma de comprobar si un clip de audio contiene voces clonadas.

Samuel Levine, Director de la Oficina de Protección de los Consumidores de la FTC, ha declarado: "Utilizaremos todas las herramientas a nuestro alcance para prevenir los daños al público derivados de los abusos de la tecnología de clonación de voz."

Como indicación de dónde puede trasladar la FTC la responsabilidad de estas estafas, Stephanie T. Nguyen, Directora de Tecnología de la FTC, dijo: "El desafío está redactado de forma que garantice que las empresas son responsables de los efectos de primer y segundo orden de los productos que lanzan al mercado."

Eso puede ser difícil, o incluso imposible de hacer. Aunque las empresas reputadas añadan una "marca de agua" al audio que generan sus herramientas, ya hay soluciones de código abierto disponibles gratuitamente que los estafadores pueden utilizar.

Si has enviado una nota de voz a alguien, has dejado un mensaje en un servicio de contestador o has colgado un vídeo tuyo en YouTube, cualquiera podría utilizarlo para clonar tu voz.

A medida que mejora la IA generativa, la mejor defensa que tenemos puede ser volvernos mucho más escépticos y no confiar demasiado rápido en nuestros ojos y oídos.