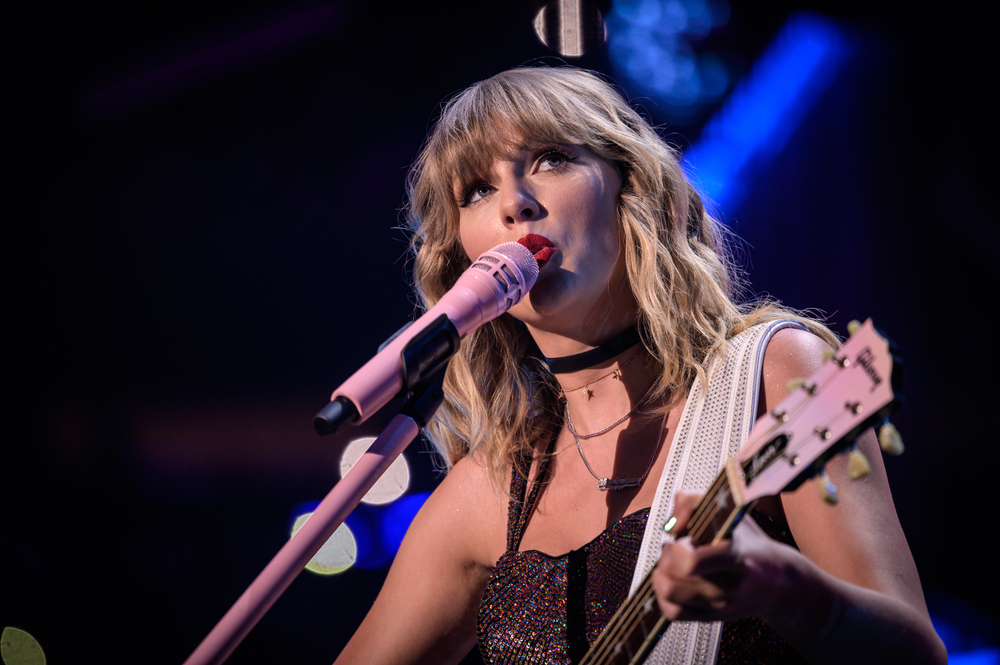

Recientemente circularon por las redes sociales imágenes falsas y profundas de la estrella del pop Taylor Swift, generadas por inteligencia artificial, que provocaron un gran revuelo.

A pesar de las estrictas normas contra este tipo de contenido, estas imágenes no consentidas mostraban a Swift en posturas sexualmente explícitas y estuvieron en directo durante 19 horas, acumulando más de 27 millones de visitas y 260.000 "me gusta" antes de que se suspendiera la cuenta de publicación.

El incidente contribuye a un diluvio de preguntas sobre la eficacia de las políticas de medios sociales contra falsa desinformación profunda.

¿Se puede detener? Parece que no. ¿Cómo combatirlo? Bueno, los servicios de detección de IA (similares a los verificadores de hechos) y las "Notas de la Comunidad", adjuntas a los mensajes en X, son dos posibles soluciones, pero ambas tienen sus defectos.

Las imágenes explícitas de Taylor Swift circularon principalmente en la plataforma de redes sociales X pero también llegaron a otras redes sociales, como Facebook, lo que demuestra que los contenidos controvertidos de la IA se propagan como la pólvora.

Un portavoz de Meta respondió al incidente, declarando: "Este contenido viola nuestras políticas, y lo estamos eliminando de nuestras plataformas y tomando medidas contra las cuentas que lo publicaron. Seguimos vigilando y, si identificamos más contenido infractor, lo eliminaremos y tomaremos las medidas oportunas."

Millones de usuarios acudieron a Reddit para debatir las ramificaciones y repercusiones de este y otros recientes incidentes virales de deep fake, incluida una foto de la Torre Eiffel en llamas.

Está circulando un vídeo de TikTok, visto millones de veces, en el que se afirma que la Torre Eiffel está ardiendo. La Torre Eiffel no está ardiendo. pic.twitter.com/IxlsKOqOsI

- Alistair Coleman (@alistaircoleman) 22 de enero de 2024

Aunque muchos percibirían estas imágenes como obviamente falsas, no podemos suponer que el público en general sea consciente de ello.

Un comentarista en Reddit dijo sobre el incidente de Taylor Swift: "Ahora sé cuánta gente no sabe lo que son los deepfakes", dando a entender un escaso conocimiento del tema.

Los expertos del sector también debatieron el tema con Ed Newton-Rex, ex directivo de Stability, argumentando que la actitud agresiva de las empresas tecnológicas y el escaso compromiso de los responsables de la toma de decisiones contribuyen al problema.

Los deepfakes de IA explícitos y no consentidos son el resultado de toda una serie de fallos.

- La cultura de la IA generativa de "embarcar lo más rápido posible", sin importar las consecuencias

- Ignorancia deliberada dentro de las empresas de IA sobre para qué se utilizan sus modelos.

- Un desprecio total por la confianza y...- Ed Newton-Rex (@ednewtonrex) 26 de enero de 2024

Ben Decker, de Memetica, una agencia de investigaciones digitales, comentó la falta de control sobre los impactos de la IA: "Este es un excelente ejemplo de las formas en que la IA se está desencadenando por un montón de razones nefastas sin que existan suficientes barandillas para proteger la plaza pública".

También señaló las deficiencias de las estrategias de supervisión de contenidos de las empresas de medios sociales.

Los informes sugieren que Taylor Swift está considerando ahora emprender acciones legales contra el sitio de pornografía falsa profunda que aloja las imágenes.

Se han producido numerosos incidentes similares de falsificaciones profundas explícitas, en su mayoría protagonizadas por mujeres y niños, a veces con la intención de sobornar a la gentetambién llamada "sexploitation".

Las imágenes de IA de abusos sexuales a menores son el impacto más oscuro y preocupante de la tecnología de generación de imágenes. Un estadounidense fue recientemente condenado a 40 años en prisión por poseer dichas imágenes.

A raíz de éste y otros incidentes similares, se han multiplicado las peticiones de legislación para hacer frente a esta forma de uso indebido de la IA.

El representante estadounidense Joe Morelle calificó de "espantosa" la difusión de los deepfakes de Swift y abogó por una acción legal urgente. Señaló: "Lo que le ha ocurrido a Taylor Swift no es nada nuevo", subrayando el impacto desproporcionado de estos contenidos en las mujeres.

La falsa desinformación profunda también se debatió ampliamente en el Foro Económico Mundial de Davos con el aumento temores ante la posibilidad de que los contenidos manipulados influyan en los mercados bursátiles, las elecciones y la opinión pública.

Se están realizando esfuerzos para combatir las falsificaciones profundas, y tanto las empresas emergentes como los gigantes tecnológicos están desarrollando tecnologías de detección.

Intel, por ejemplo, lanzó un producto capaz de detectar vídeos falsos con una precisión 96%.

Sin embargo, el reto sigue siendo en gran medida insuperable por ahora, ya que la tecnología evoluciona rápidamente y se extiende por Internet.