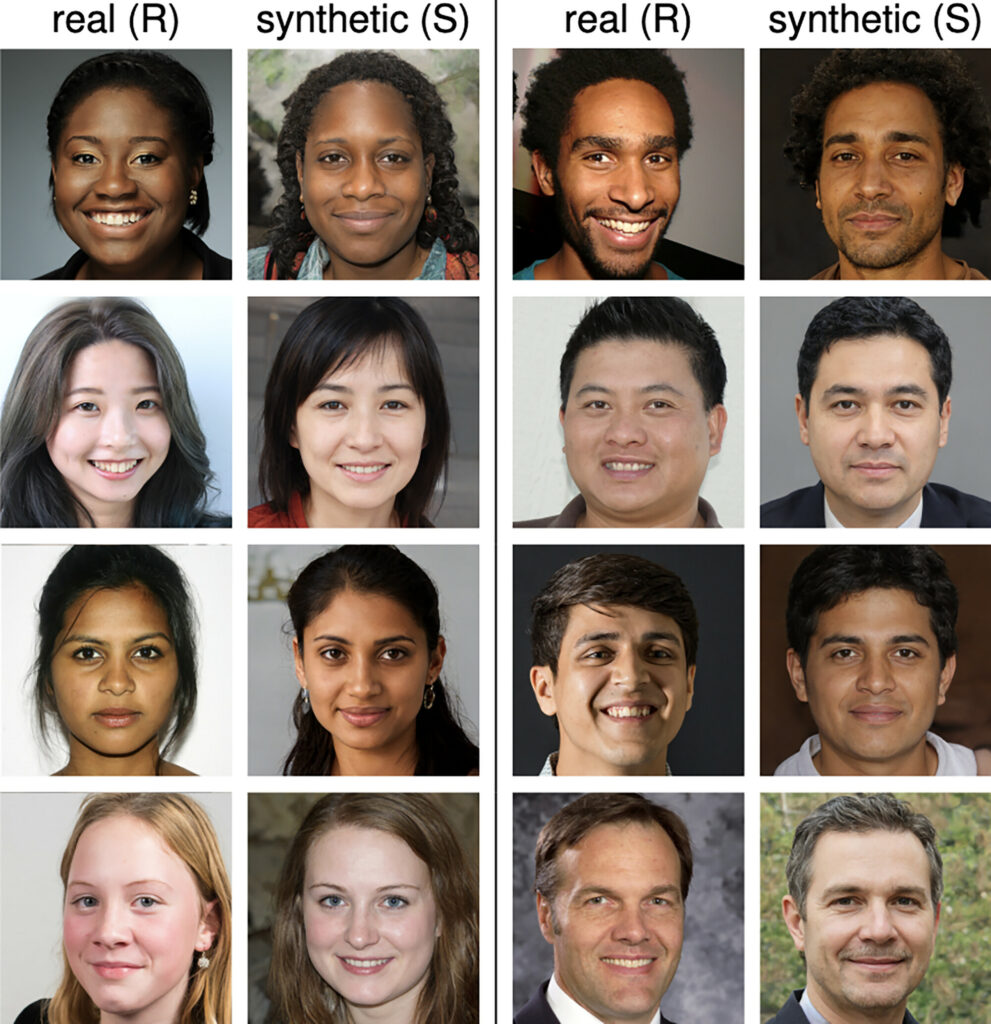

Según un experimento reciente, los humanos pueden identificar correctamente rostros humanos generados por IA sólo el 48,2% de las veces.

En estudiar en el que participaron 315 personas a las que se pidió que distinguieran entre rostros reales y rostros generados por inteligencia artificial. Las caras se sintetizaron con StyleGAN2, un motor de última generación capaz de crear semejanzas humanas diversas y realistas.

Los resultados fueron a la vez fascinantes y ligeramente desconcertantes: la capacidad de los participantes para identificar rostros generados por la IA rondó el 48,2%, es decir, peor que lanzar una moneda al aire.

Es sugiere que, para una persona normal, las caras falsas profundas de la IA son prácticamente indistinguibles de las de los seres humanos reales.

Puede comprobar por sí mismo el realismo de estos rostros visitando esta-persona-no-existe.comque muestra imágenes realistas generadas por inteligencia artificial de prácticamente cualquier persona, de cualquier edad o procedencia. Y esta herramienta tiene ya unos cuantos años.

Profundizando más, el estudio también exploró si ciertas razas y géneros eran más difíciles de clasificar correctamente.

Se observó que los rostros blancos, sobre todo los masculinos, eran los que más les costaba a los participantes identificar correctamente como reales o sintéticos.

Según el estudio, esto puede deberse a la sobrerrepresentación de rostros blancos en el conjunto de datos de entrenamiento de la IA, lo que da lugar a rostros sintéticos blancos más realistas.

Aún más intrigante fue descubrir que los participantes valoraban las caras sintéticas como más fiables que las reales, aunque por un margen modesto. Esto podría indicar una preferencia subconsciente por los rasgos medios que suele generar la IA, que, según el estudio, se perciben como más fiables en investigaciones anteriores.

Un sutil aumento de la probabilidad de que alguien interprete una imagen de IA como más fiable que una real es muy preocupante una vez escalado a niveles de población.

El cerebro interpreta de forma compleja los rostros generados por la IA

A segundo estudio reciente encargó a los participantes que identificaran si una cara era real o no mientras realizaban una tarea diseñada para distraerlos.

No podían diferenciar conscientemente entre los dos, pero las cosas se volvieron más confusas cuando se midió su actividad cerebral mediante un electroencefalograma (EEG).

Aproximadamente 170 milisegundos después de ver las caras, la actividad eléctrica del cerebro mostraba diferencias cuando los participantes miraban imágenes reales y sintéticas.

Parecía quea mente inconsciente "sabía" cuándo una imagen podía ser generada por IA mejor que la mente consciente. Pero, a pesar de ello, los participantes no podían etiquetar conscientemente los rostros de la IA con un grado de confianza sólido.

Podríamos especular que existe una capa consciente de interpretación en la que concedemos a los rostros generados por la IA "el beneficio de la duda" incluso cuando no estamos seguros.

Al fin y al cabo, estamos intrínsecamente programados para identificar y confiar en los rostros humanos, por lo que es excepcionalmente difícil desligarse de ello y aislar las incoherencias que pueda revelar una imagen generada por la IA.

Es casi como si las sospechas iniciales dieran paso a una confirmación más afirmativa de que la persona es, de hecho, real cuando no lo es: una forma de disculpa instigada por la IA.

Sea cual sea la explicación de esta rareza, las falsificaciones profundas generadas por IA son un riesgo prioritario para la tecnología, con una escándalo reciente golpeando una escuela de Nueva Jersey.

Estafas profundas y falsas y existe una preocupación palpable de que los contenidos falsos generados por IA podría afectar a los comportamientos de voto.