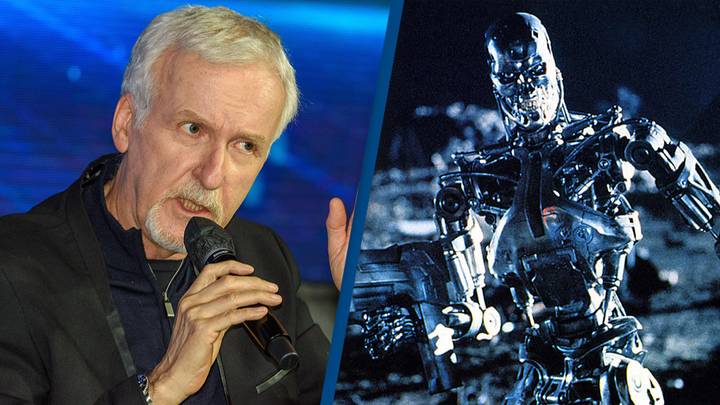

El director de cine canadiense James Cameron, famoso por su monumental legado cinematográfico desde "Titanic" hasta "Avatar", lleva tiempo manifestando su preocupación por el rápido avance de la inteligencia artificial (IA).

En una entrevista reciente, Cameron subrayó que su icónica superproducción de ciencia ficción de 1984 "Terminator" debería haber servido de advertencia sobre los peligros potenciales de la IA. De forma coloquial, compartió su creencia de que el "armamentismo" de la IA podría tener consecuencias catastróficas para la humanidad.

Cuando se le preguntó sobre la posibilidad de que la IA conduzca a la extinción de la humanidad -un temor compartido por muchos líderes de la industria y personas por igual-, Cameron se mostró profundamente de acuerdo.

"Comparto absolutamente su preocupación. Os lo advertí en 1984 y no me escuchasteis", dijo.

Cameron dijo esto a propósito de su película "Terminator", que gira en torno a un asesino cibernético creado por un superordenador inteligente conocido como Skynet.

Según Cameron, el peligro más importante reside en el armamentismo de la IA. Expresó su preocupación por que la humanidad pueda verse envuelta en una carrera armamentística de la IA, con consecuencias potencialmente devastadoras.

"Creo que entraremos en el equivalente de una carrera armamentística nuclear con la IA. Y si no la construimos nosotros, seguro que la construirán los demás, y entonces la cosa irá a más", advirtió.

En la visión de Cameron, la IA en el campo de batalla podría operar tan rápidamente que los humanos serían incapaces de intervenir, eliminando la posibilidad de conversaciones de paz o tácticas de desescalada.

No es la primera vez que James Cameron expresa su preocupación por la IA: ya ha reconocido que, aunque ofrece numerosas ventajas, también puede tener consecuencias desastrosas que podrían suponer el fin del mundo. En algunas de sus declaraciones, incluso especuló con la posibilidad de que los ordenadores sintientes ya estuvieran manipulando el mundo "sin nuestro conocimiento, con un control total sobre todos los medios y la información".

Estas preocupaciones no se limitan únicamente a James Cameron. Los principales expertos en el campo de la IA, incluidos gigantes tecnológicos como OpenAI y DeepMind de Google, junto con académicos, legisladores y empresarios, también se han hecho eco de advertencias similares. Hacen hincapié en que abordar los riesgos asociados a la IA debería ser una prioridad mundial, al mismo nivel que abordar las pandemias y los riesgos de guerra nuclear.

En una carta abierta firmada por más de 1.000 expertos y ejecutivos, entre ellos Elon Musk y Steve Wozniak, han pedido una pausa de seis meses en el entrenamiento de potentes sistemas de IA hasta que se puedan garantizar sus efectos positivos y gestionar eficazmente los riesgos. La preocupación parte de la creencia de que la IA podría plantear profundos riesgos para la sociedad y la humanidad en general.

Los avances en IA son sin duda notables y tienen el potencial de revolucionar positivamente varias industrias. Sin embargo, no se pueden ignorar las preocupaciones planteadas por expertos y visionarios como James Cameron. Garantizar que la IA se desarrolle y utilice de forma responsable es crucial para nuestro futuro colectivo.

A medida que seguimos presenciando un crecimiento exponencial de las capacidades de la IA, se hace cada vez más vital que los gobiernos, las organizaciones y los individuos colaboren y establezcan directrices y normativas claras. Lograr un equilibrio entre innovación y seguridad será la clave para aprovechar todo el potencial de la IA sin sucumbir a sus consecuencias imprevistas.

En conclusión, la advertencia de James Cameron sobre la IA es una llamada de atención para la humanidad. Su película clásica "Terminator" fue algo más que un simple entretenimiento: fue un vistazo a un posible futuro que debemos esforzarnos por evitar. Reconocer los riesgos y tomar medidas proactivas para garantizar el desarrollo y uso responsables de la IA será crucial para salvaguardar nuestro mundo para las generaciones venideras.

"Os lo advertí en 1984": James Cameron, director de "Terminator", sobre la IA